遗留物与盗移物检测方法、设备和存储介质.pdf

玉怡****文档

亲,该文档总共18页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

遗留物与盗移物检测方法、设备和存储介质.pdf

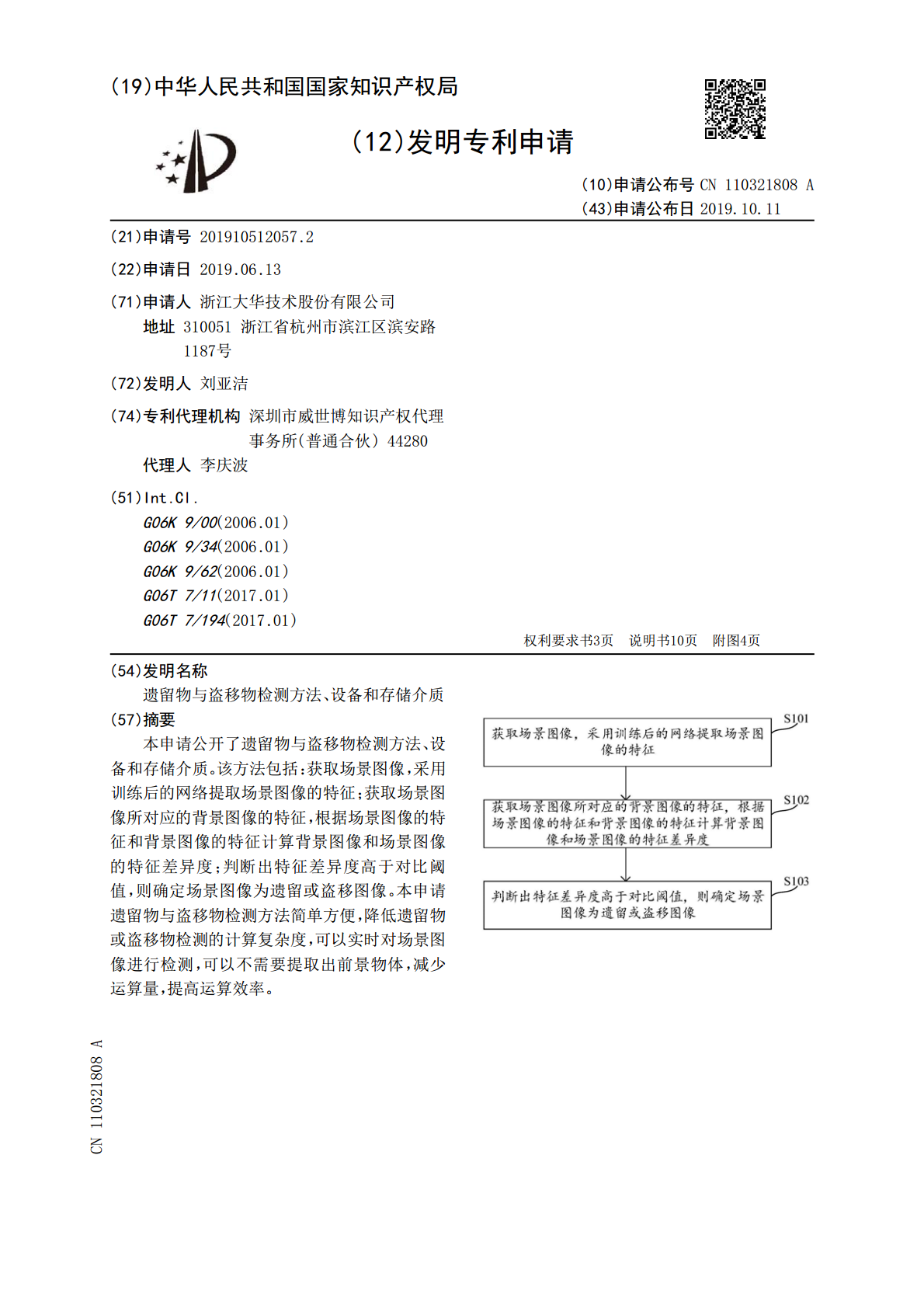

本申请公开了遗留物与盗移物检测方法、设备和存储介质。该方法包括:获取场景图像,采用训练后的网络提取场景图像的特征;获取场景图像所对应的背景图像的特征,根据场景图像的特征和背景图像的特征计算背景图像和场景图像的特征差异度;判断出特征差异度高于对比阈值,则确定场景图像为遗留或盗移图像。本申请遗留物与盗移物检测方法简单方便,降低遗留物或盗移物检测的计算复杂度,可以实时对场景图像进行检测,可以不需要提取出前景物体,减少运算量,提高运算效率。

遗留物检测方法、相关设备和存储介质.pdf

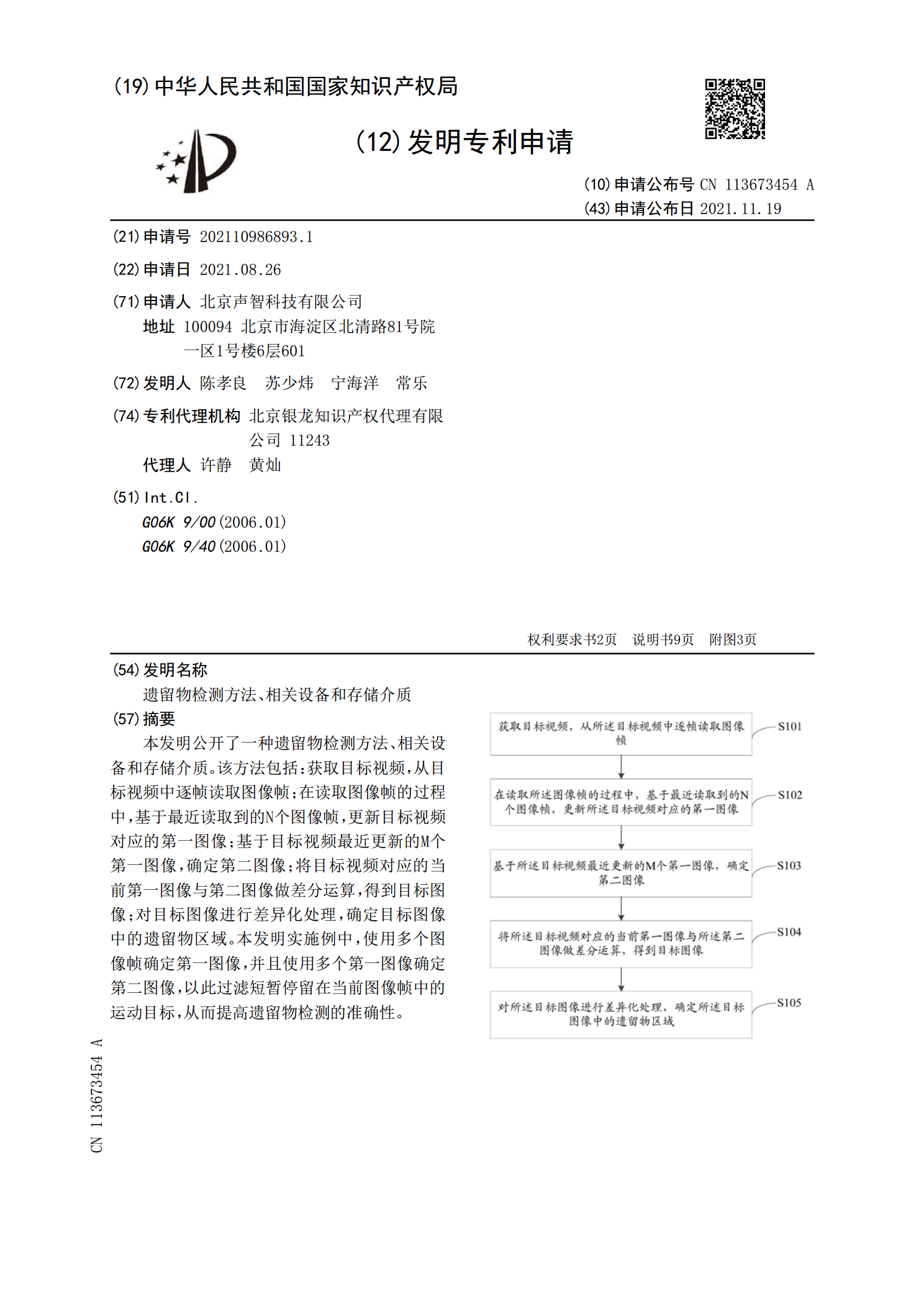

本发明公开了一种遗留物检测方法、相关设备和存储介质。该方法包括:获取目标视频,从目标视频中逐帧读取图像帧;在读取图像帧的过程中,基于最近读取到的N个图像帧,更新目标视频对应的第一图像;基于目标视频最近更新的M个第一图像,确定第二图像;将目标视频对应的当前第一图像与第二图像做差分运算,得到目标图像;对目标图像进行差异化处理,确定目标图像中的遗留物区域。本发明实施例中,使用多个图像帧确定第一图像,并且使用多个第一图像确定第二图像,以此过滤短暂停留在当前图像帧中的运动目标,从而提高遗留物检测的准确性。

桌面遗留物检测方法、装置、设备及存储介质.pdf

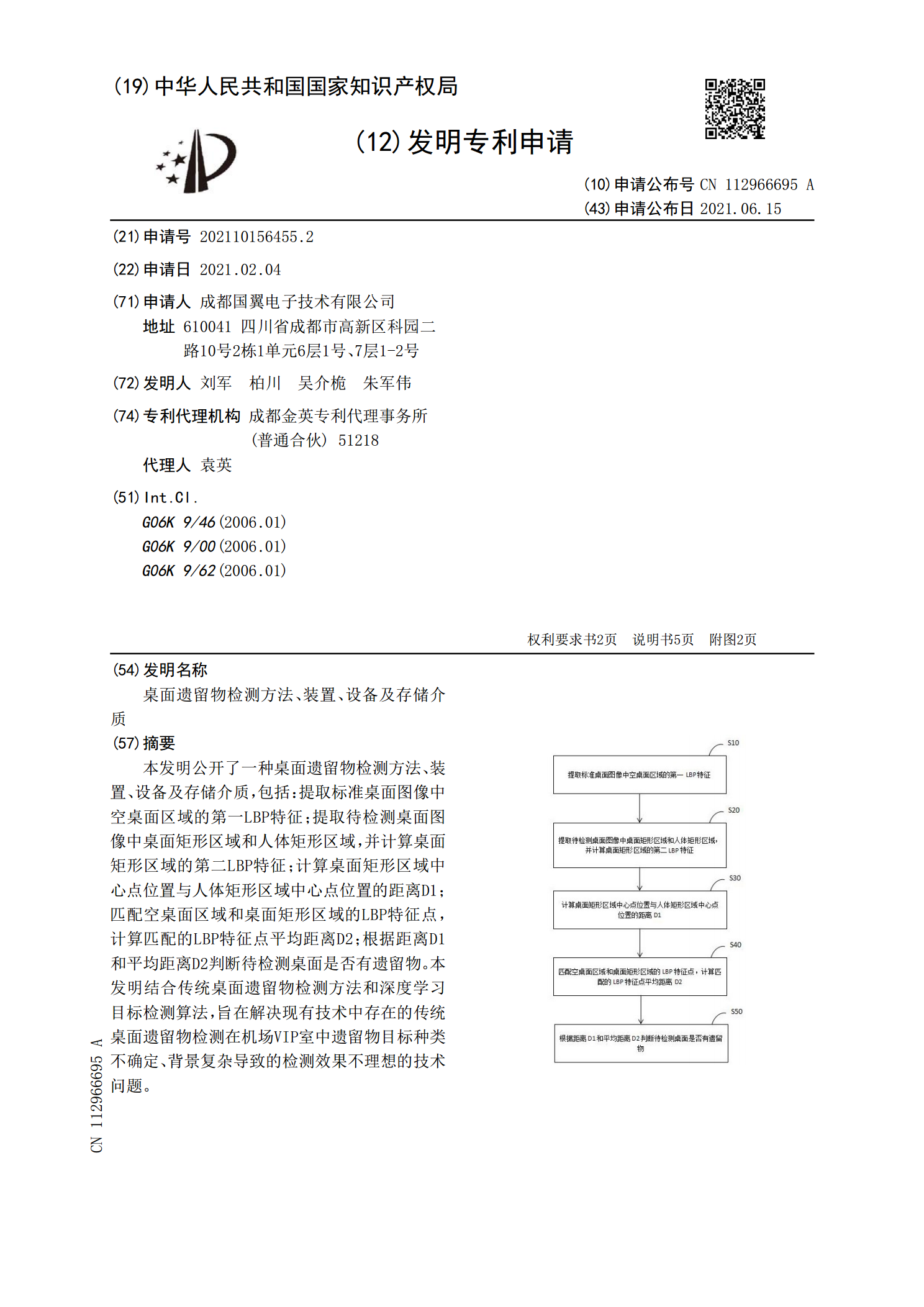

本发明公开了一种桌面遗留物检测方法、装置、设备及存储介质,包括:提取标准桌面图像中空桌面区域的第一LBP特征;提取待检测桌面图像中桌面矩形区域和人体矩形区域,并计算桌面矩形区域的第二LBP特征;计算桌面矩形区域中心点位置与人体矩形区域中心点位置的距离D1;匹配空桌面区域和桌面矩形区域的LBP特征点,计算匹配的LBP特征点平均距离D2;根据距离D1和平均距离D2判断待检测桌面是否有遗留物。本发明结合传统桌面遗留物检测方法和深度学习目标检测算法,旨在解决现有技术中存在的传统桌面遗留物检测在机场VIP室中遗留物

遗留物与遗失物的检测方法、装置、终端设备及存储介质.pdf

本发明公开了一种遗留物与遗失物的检测方法、装置、终端设备及存储介质,所述方法包括:获取待检测图像序列;根据所述待检测图像序列确定运动目标区域;统计所述运动目标区域的持续时间,若持续时间达到预设的第一阈值,则判定所述运动目标区域为遗留物或遗失物;获取所述运动目标区域的外接区域;对所述运动目标区域进行颜色直方图计算,得到第一颜色直方图;对所述外接区域进行颜色直方图计算,得到第二颜色直方图;计算所述第一颜色直方图和所述第二颜色直方图的相似度;判断所述相似度是否小于预设的第二阈值,若是,则所述运动目标区域为遗留物

一种遗留物检测方法、装置、电子设备及存储介质.pdf

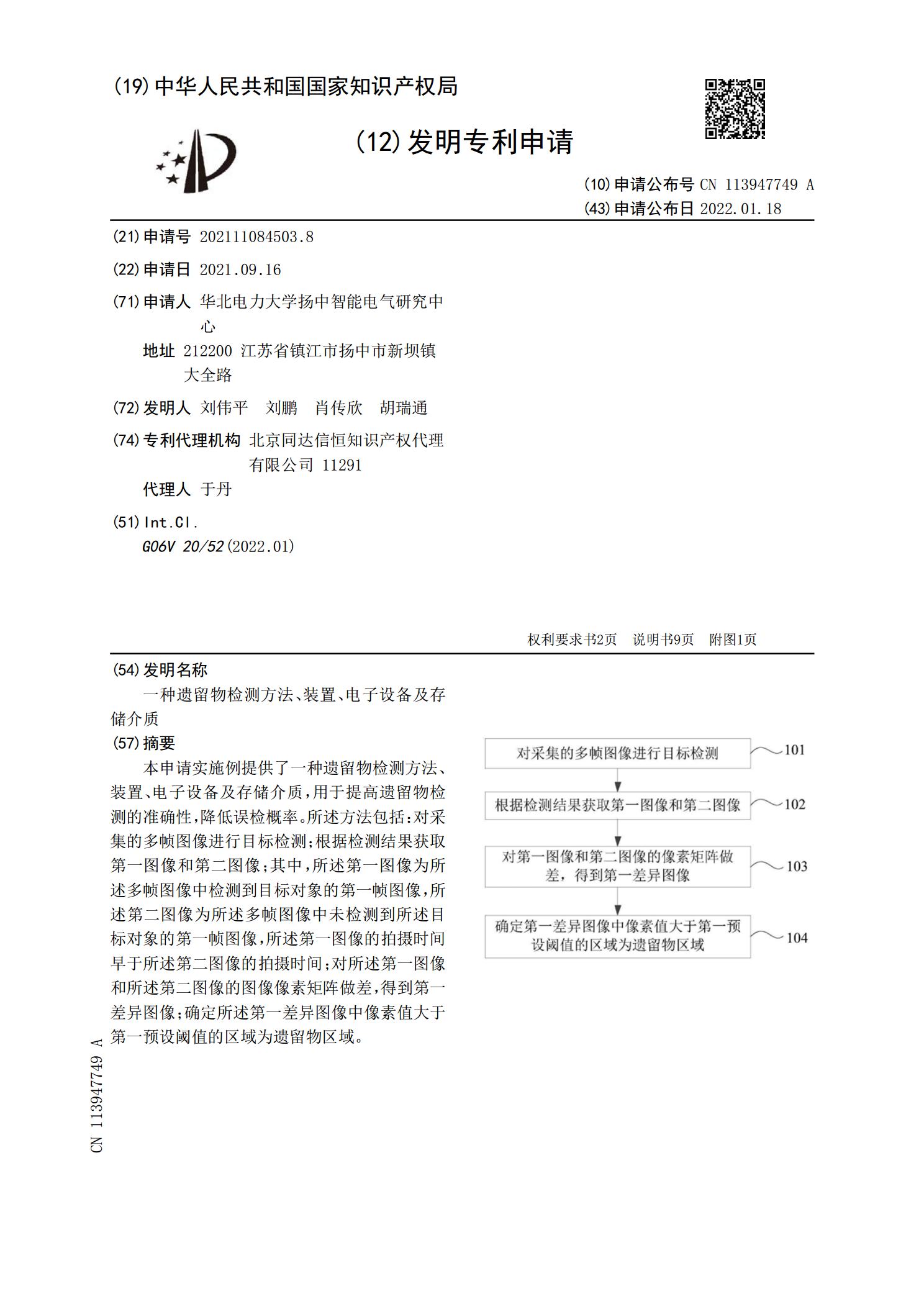

本申请实施例提供了一种遗留物检测方法、装置、电子设备及存储介质,用于提高遗留物检测的准确性,降低误检概率。所述方法包括:对采集的多帧图像进行目标检测;根据检测结果获取第一图像和第二图像;其中,所述第一图像为所述多帧图像中检测到目标对象的第一帧图像,所述第二图像为所述多帧图像中未检测到所述目标对象的第一帧图像,所述第一图像的拍摄时间早于所述第二图像的拍摄时间;对所述第一图像和所述第二图像的图像像素矩阵做差,得到第一差异图像;确定所述第一差异图像中像素值大于第一预设阈值的区域为遗留物区域。