一种基于双目视觉的快递包裹抓取装置和抓取方法.pdf

英哲****公主

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

一种基于双目视觉的快递包裹抓取装置和抓取方法.pdf

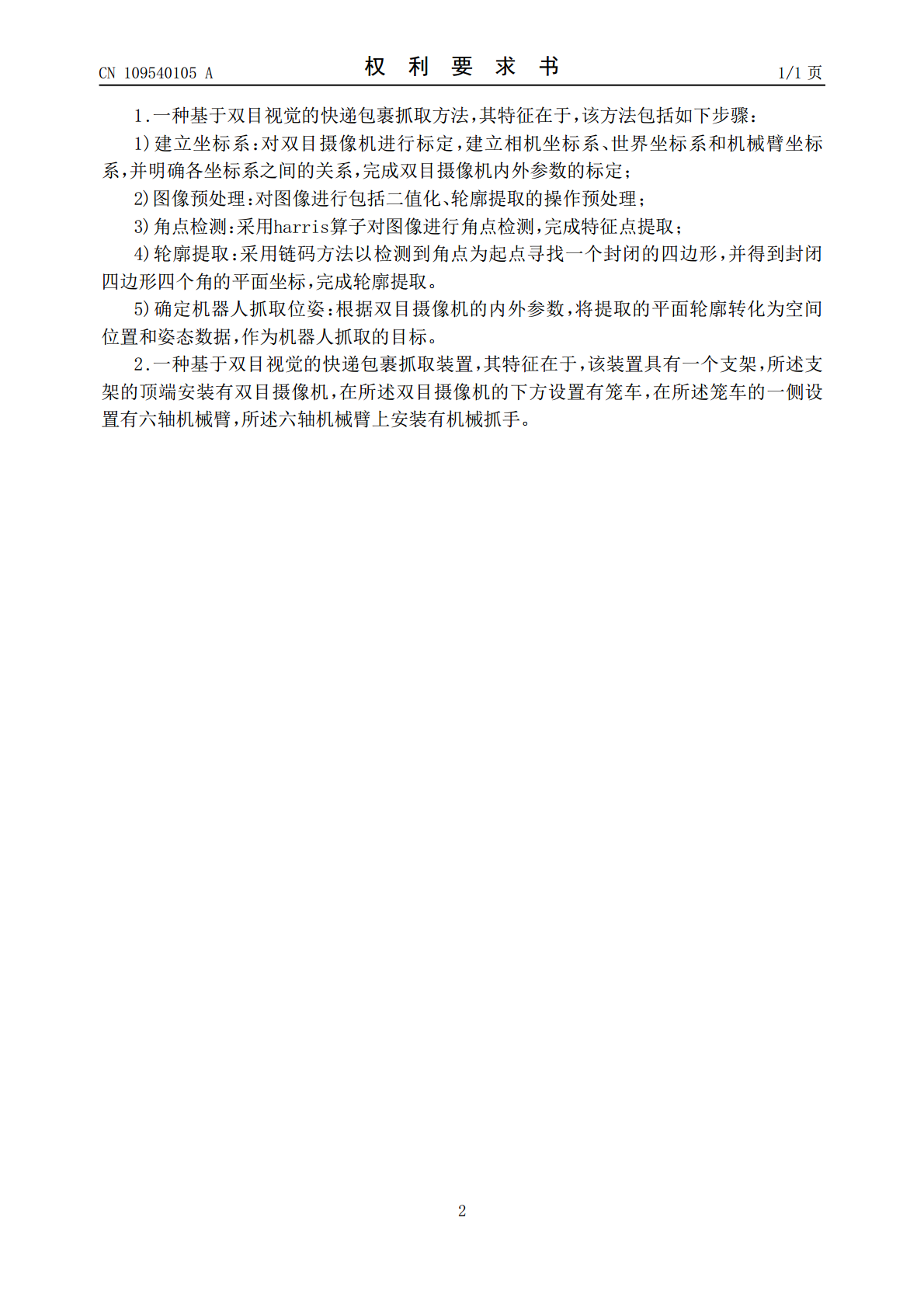

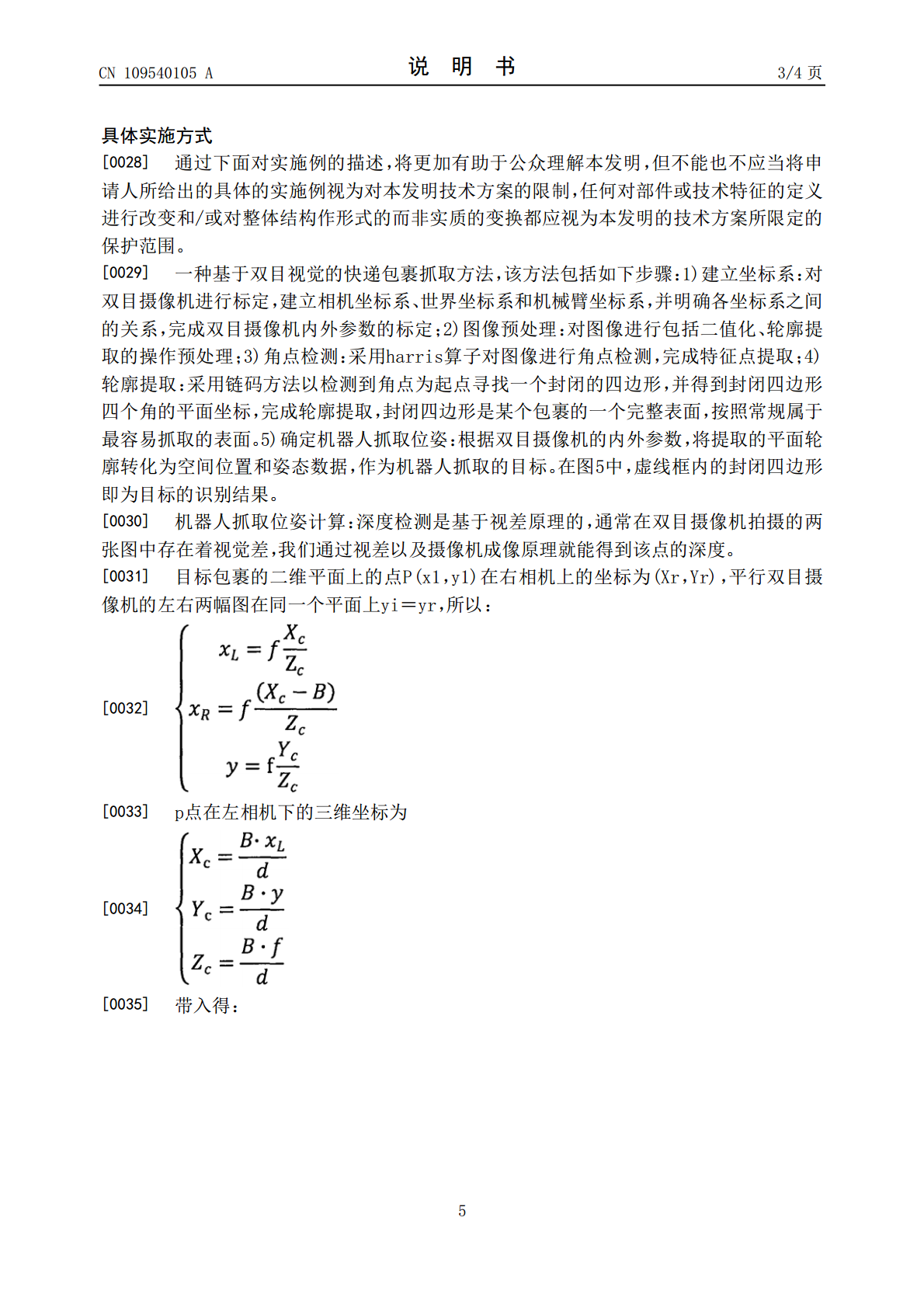

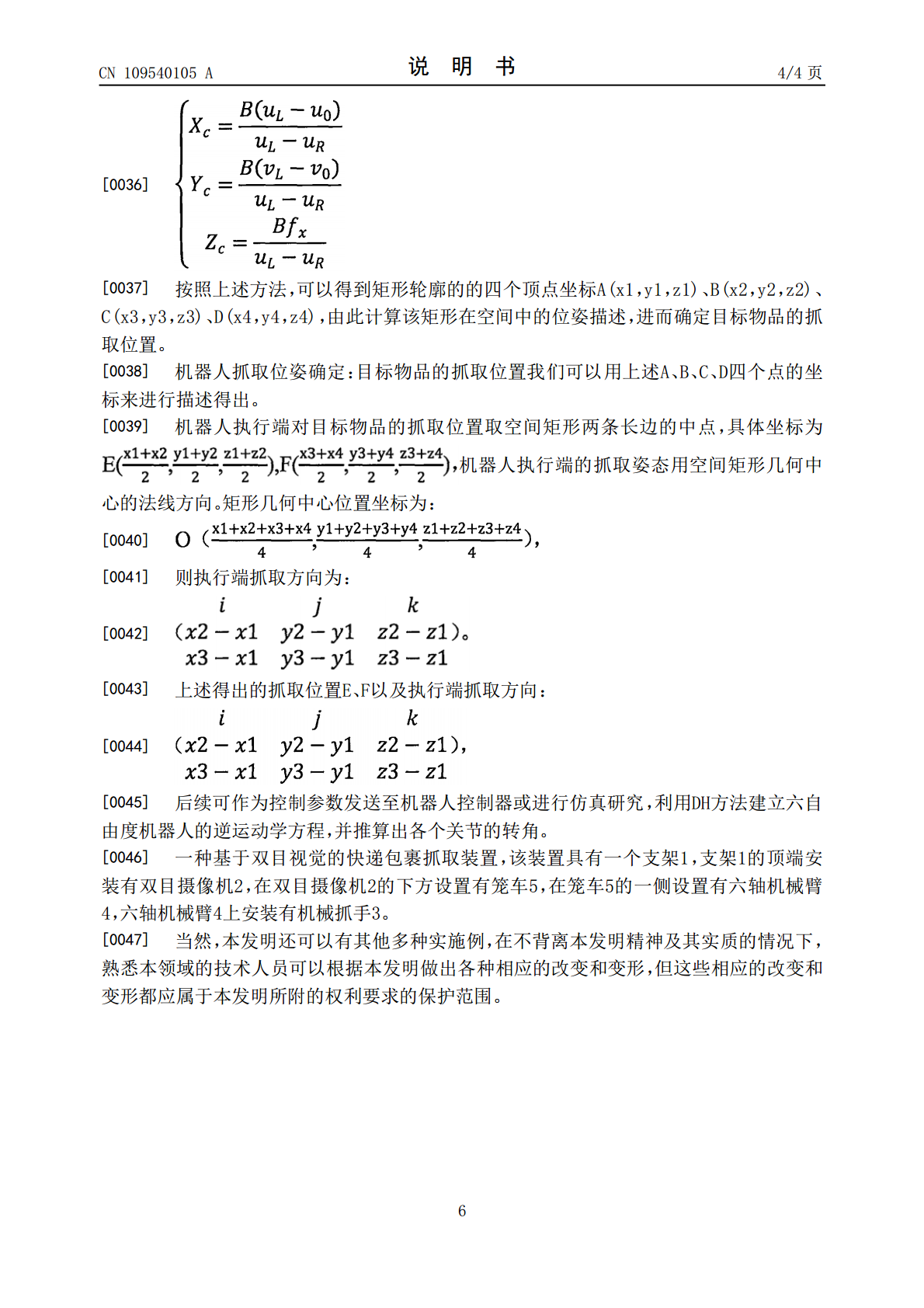

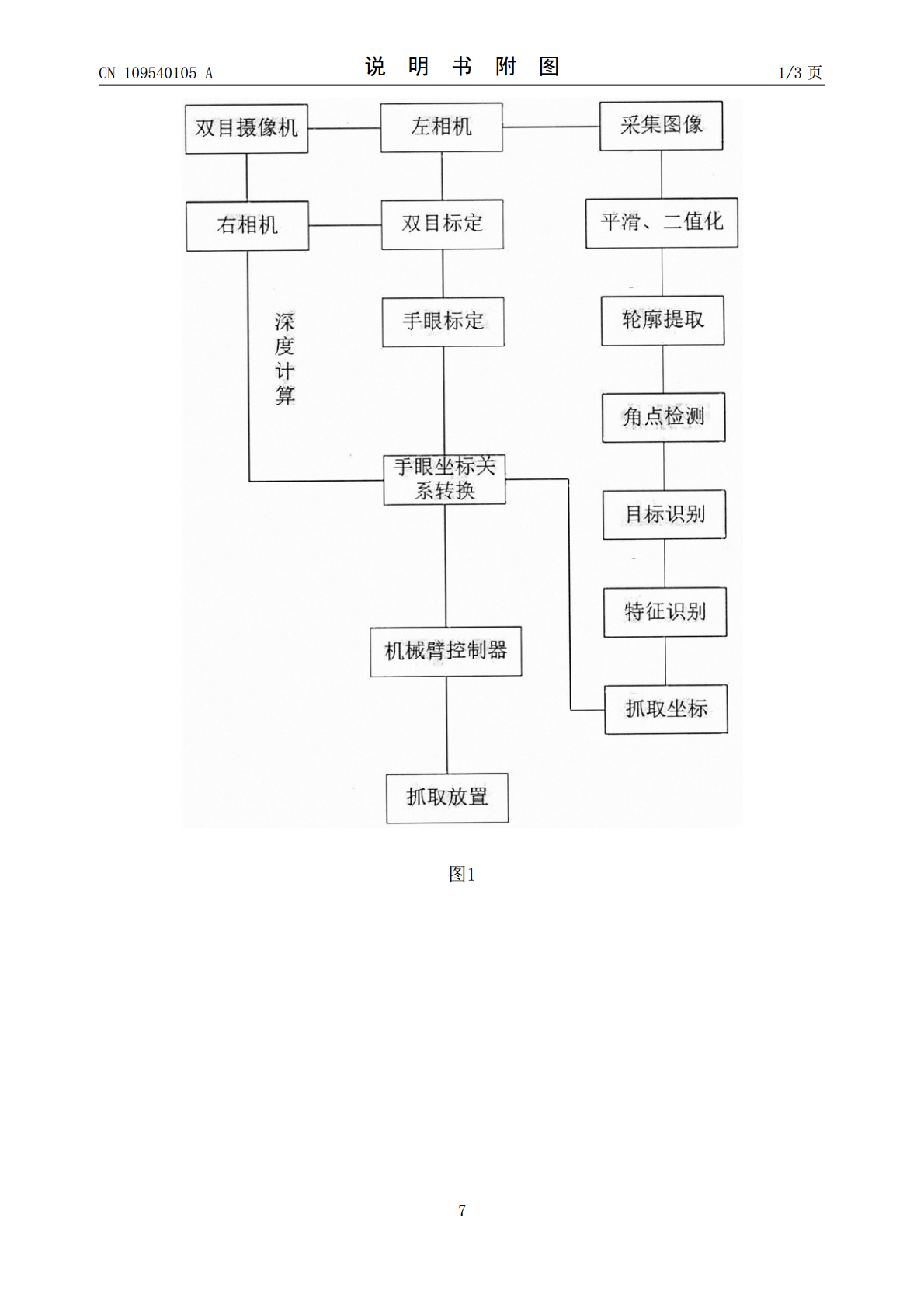

本发明公开了一种基于双目视觉的快递包裹抓取方法和装置,方法包括建立坐标系、图像预处理、角点检测、轮廓提取、确定机器人抓取位姿;快递包裹抓取装置,装置支架的顶端安装有双目摄像机,在双目摄像机的下方设置有笼车,笼车的一侧设置有六轴机械臂,六轴机械臂上安装有机械抓手。本发明的有益技术效果是:操作对象为快递包裹,形状基本近似于长方体,装置的主要功能包括图像中的关键点识别、包裹轮廓识别、抓取机器人末端抓取位姿计算、抓取轨迹控制等,实现了功能一体化,节省工作空间,保证操作精度,提升工作的智能化水平,后续可与更大范围的

一种基于双目视觉的物流单件抓取装置.pdf

本发明公开了一种基于双目视觉的物流单件抓取装置,包括底座,底座的一侧设有PLC控制器,底座的上侧设有第一沉槽,第一沉槽内安装有传送带,底座的上侧设有安装架,安装架的下侧设有扫描仪,底座的下侧设有驱动腔,驱动腔内转动连接有两个蜗杆,驱动腔的内壁另外两侧均转动连接有转轴,转轴的外侧固定连接有蜗轮,底座的两侧均转动连接有若干个转动杆,转动杆的一端固定连接有锥齿轮,转轴的外侧转动连接有锥齿环,转动杆的一侧固定连接有拨动板。本发明通过设置两个夹板,能够与提琴的表面相贴合,避免校音器本体从提琴上滑落,同时通过设置蜗轮

一种方便抓取的基于视觉检测的抓取装置.pdf

本实用新型提供一种方便抓取的基于视觉检测的抓取装置,属于视觉检测技术领域,包括:底座,所述底座的表面安装有调节组件,所述调节组件的表面安装有两个机械臂,两个所述机械臂的表面安装有夹爪,所述底座的表面且位于调节组件的两侧均安装有输送带,所述输送带两侧的表面均安装有限位板,所述输送带的表面安装有供能电机,本实用新型通过底座、调节组件、机械臂、夹爪、限位板、输送带、往复组件、安装板和视觉检测仪的配合使用,可以对限位板表面的产品进行识别并在识别完成后对瑕疵品进行抓取,提高生产的效率,同时可以对输送带表面不同位置的

一种基于双目视觉的机械臂抓取控制方法.pdf

本发明的技术方案是这样实现的:一种基于双目视觉的机械臂抓取控制方法,其特征在于,包括如下步骤:S1安装:将机械臂安装到工作台上,调节机械臂的位置和角度,基于机械臂的主控计算机与视觉处理单元进行调试,位置调试完成后等待抓取;S2抓取:在调试完成后,机械臂的抓取单元与零件对准,通过夹持与吸附同时进行的方式对零件进行抓取;S3拨动清理:在机械臂难以对零件进行抓取时,通过吹气的方式或拨动的方式改变零件的状态使其便于抓取工作;在抓取完成后,吹过吹气和毛刷对工作台进行清理;本发明本发明抓取零件方便稳定,工作效率高,能

基于双目视觉的无序抓取方法、系统及存储介质.pdf

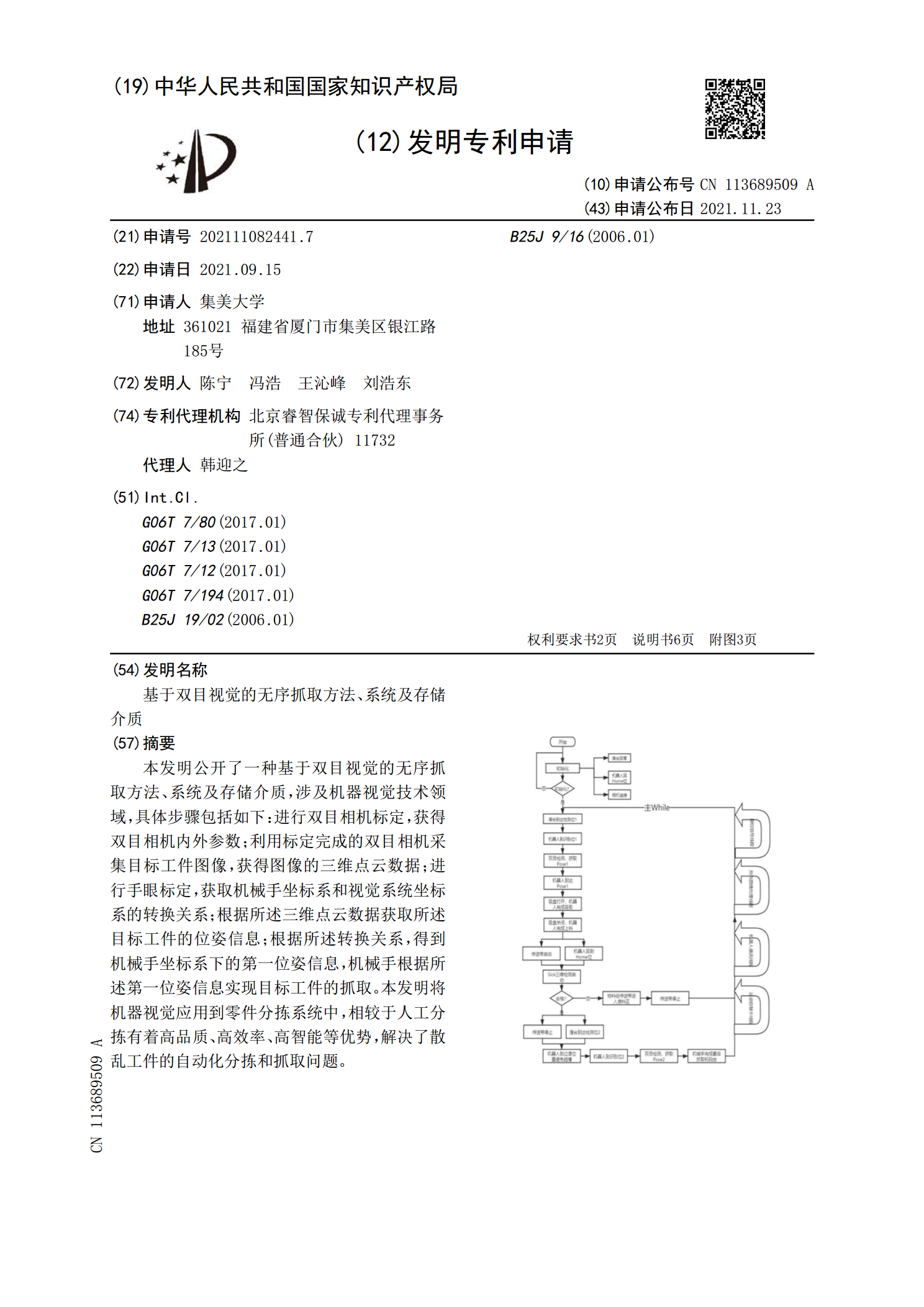

本发明公开了一种基于双目视觉的无序抓取方法、系统及存储介质,涉及机器视觉技术领域,具体步骤包括如下:进行双目相机标定,获得双目相机内外参数;利用标定完成的双目相机采集目标工件图像,获得图像的三维点云数据;进行手眼标定,获取机械手坐标系和视觉系统坐标系的转换关系;根据所述三维点云数据获取所述目标工件的位姿信息;根据所述转换关系,得到机械手坐标系下的第一位姿信息,机械手根据所述第一位姿信息实现目标工件的抓取。本发明将机器视觉应用到零件分拣系统中,相较于人工分拣有着高品质、高效率、高智能等优势,解决了散乱工件的