基于深度相机的三维场景实时重建方法.pdf

涵蓄****09

亲,该文档总共14页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于深度相机的三维场景实时重建方法.pdf

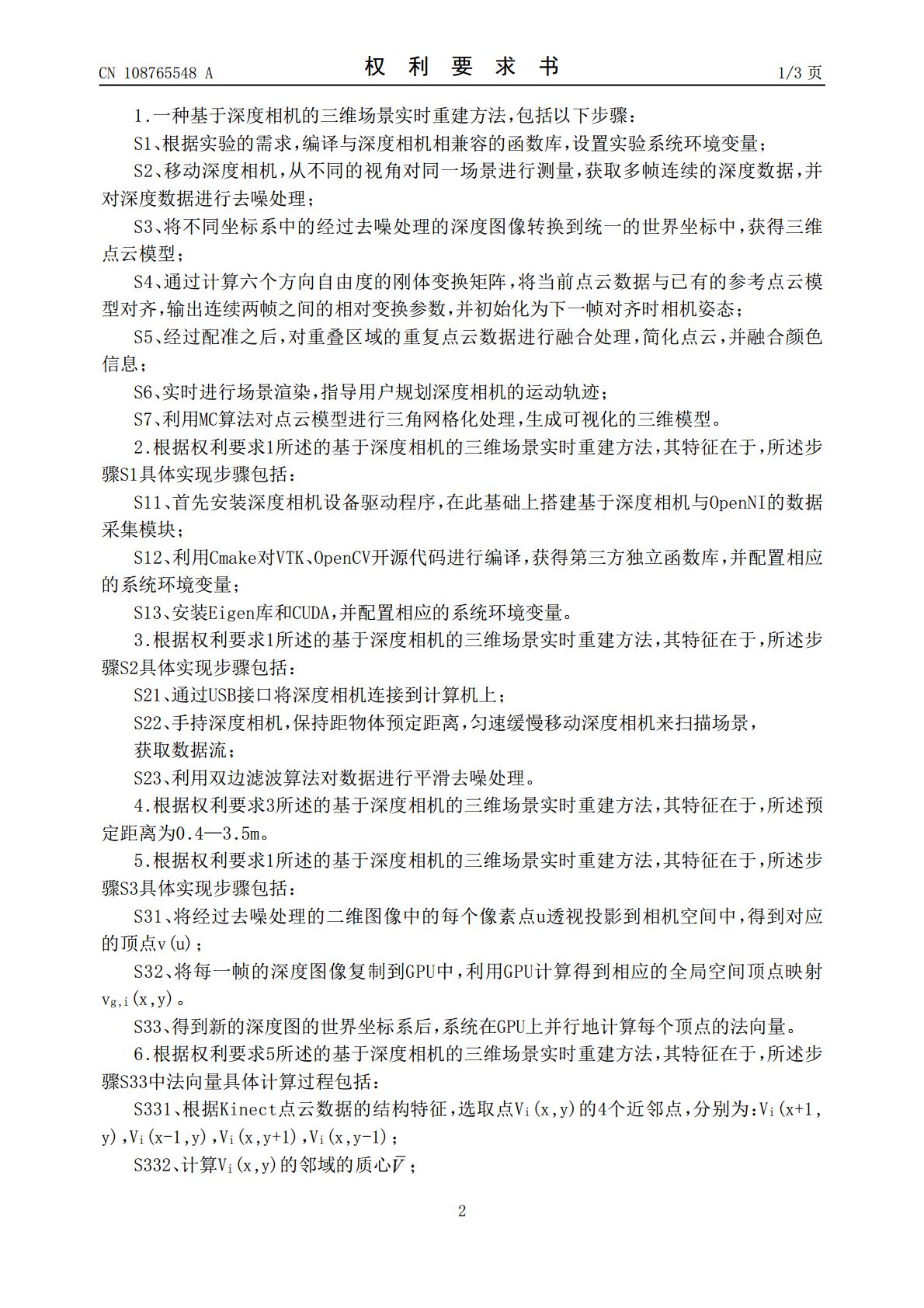

本发明公开了一种基于深度相机的三维场景实时重建方法,包括以下步骤:原始深度数据和颜色数据的获取,深度数据去噪处理,深度图像坐标转换,相机姿态追踪,点云融合和记录颜色信息,点云模型隐含表面渲染,场景模型重建。本发明利用单个深度相机扫描场景,获得场景的深度数据流,在计算机上完成对数据的实时处理,并生成相应的三维模型,该方法可以提供低成本、易操作、高质量、具有实时性的三维重建系统,产生高质量、可视化强的三维模型。

实时三维场景重建方法及装置.pdf

本申请公开了一种实时三维场景重建方法及装置,其中,方法包括:获取单目相机的相机内参;提取单目相机的目标图片的实际相机位姿和由稀疏深度先验得到的稀疏深度点;以及利用预设三维场景重建网络,基于由相机内参、实际相机位姿和稀疏深度点得到的融合时空信息生成三维场景重建结果。由此,解决了相关技术中忽视粗略稀疏特征点的深度估计数据,对空间信息的利用不完善,导致三维重建结果连续性、准确性较差,且实用性较差的技术问题。

基于全局线性方法的三维场景重建和相机参数恢复.docx

基于全局线性方法的三维场景重建和相机参数恢复三维场景重建和相机参数恢复是计算机视觉领域的重要研究方向。随着3D数码相机的普及,大量的3D图像和视频数据被获取和存储,如何利用这些数据进行三维场景重建和相机参数恢复,已成为计算机视觉领域的热点话题。本文将主要介绍基于全局线性方法的三维场景重建和相机参数恢复的研究进展。一、三维场景重建三维场景重建是基于各种技术和算法将二维图像数据转换为三维模型的过程。目前,主要的三维场景重建方法可以分为基于视觉几何方法和基于统计方法。1.基于视觉几何方法的三维场景重建基于视觉几

基于深度相机和追踪相机的实时三维重建技术研究的任务书.docx

基于深度相机和追踪相机的实时三维重建技术研究的任务书任务书一、任务背景随着科技的不断进步,人们对于三维重建技术的需求也越来越高。三维重建技术可以将现实世界中的物体、场景等信息转换为数字化的三维模型,提高科研、工程、文化等领域的效率和应用价值。在实际应用中,常见的三维重建技术主要有基于深度相机和追踪相机的实时三维重建技术。基于深度相机的三维重建技术主要是通过激光或红外线等方式测得物体或场景的距离,从而构建出高精度的三维模型;追踪相机的三维重建技术则是通过追踪相机获取物体或场景的位置和姿态信息,从而生成三维模

一种基于多视角深度相机的三维人像实时重建及渲染方法.pdf

本发明公开的基于多视角深度相机的三维人像实时重建及渲染方法,涉及计算机视觉领域,通过对多个相机进行标定,得到多个相机之间的相对位姿并根据相对位姿,将多个相机输出的深度信息转置于统一的三维坐标系之内,形成点云,分别判断各个体素是否被点云占据,若是,则根据相对位姿及预先创建的人像掩膜,分别为各个体素构建基于截断的符号距离函数,对各个体素对应的基于截断的符号距离函数进行加权平均并利用点云网格化算法,得到人体三维网格,对颜色信息进行加权平均,得到携带颜色信息的人体三维网格,将人体三维网格输入预先构建的对抗神经网络