一种虚拟现实的直播方法、装置和系统.pdf

St****12

亲,该文档总共15页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种虚拟现实的直播方法、装置和系统.pdf

本发明公开了一种虚拟现实的直播方法、装置和系统。方法包括以下步骤:创建虚拟的3D角色,并导入至图形引擎,生成VR主播模型;实时捕捉真实的演员动作信息,然后关联和控制所述VR主播模型;将所述VR主播模型合成至VR场景,然后实时与直播平台对接,生成直播画面。装置包括对应于所述方法各个步骤的模块。系统包括:动捕装置,用于实时捕捉真实演员的肢体动作;面部表情捕捉器,用于捕捉真实演员的面部表情;图形引擎,用于生成和处理3D角色模型,运算3D角色模型的物理动力学动作,转换动画视频输出至视频传播软件;特效生成模块,用于

一种基于虚拟现实的音乐直播系统和方法.pdf

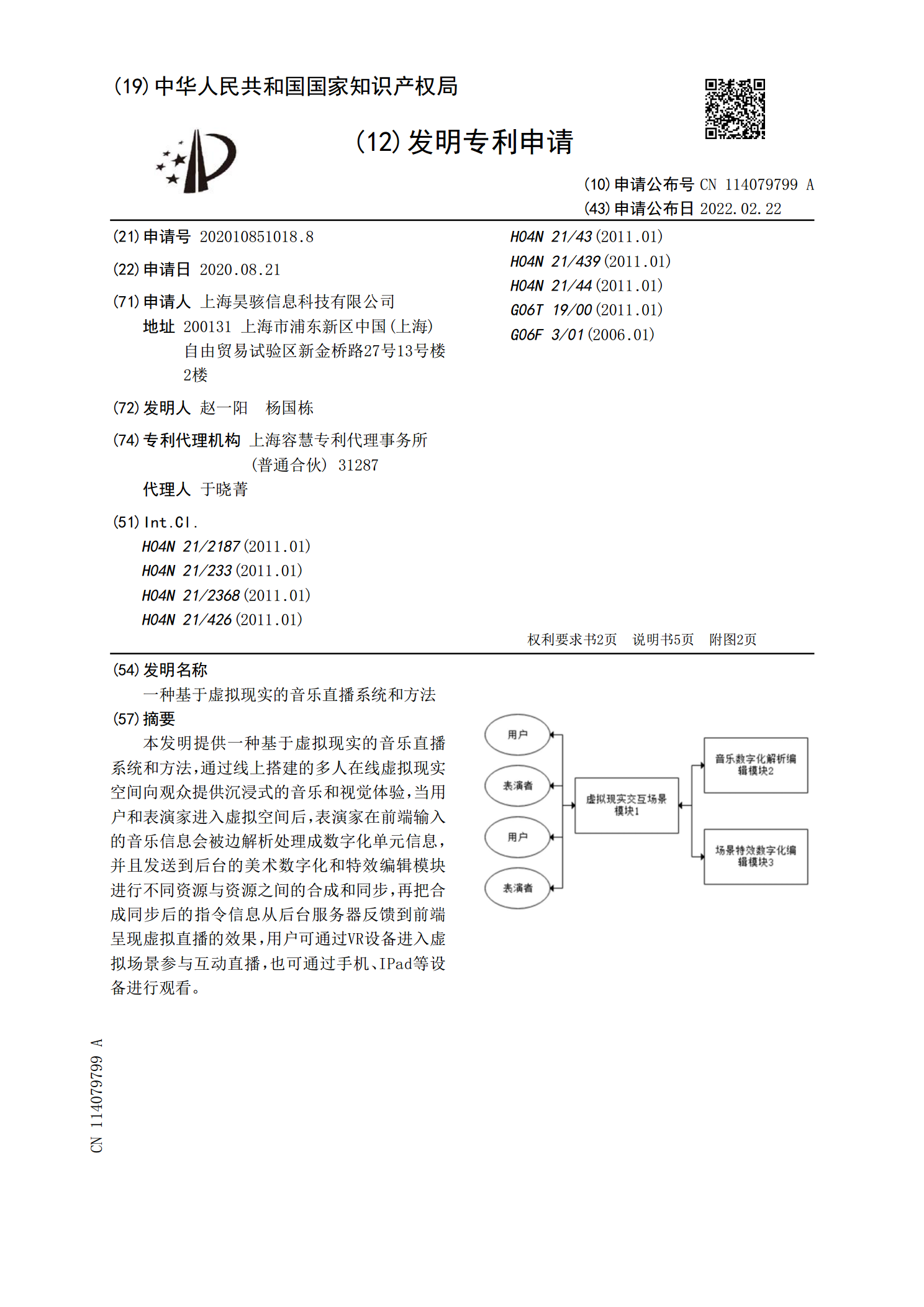

本发明提供一种基于虚拟现实的音乐直播系统和方法,通过线上搭建的多人在线虚拟现实空间向观众提供沉浸式的音乐和视觉体验,当用户和表演家进入虚拟空间后,表演家在前端输入的音乐信息会被边解析处理成数字化单元信息,并且发送到后台的美术数字化和特效编辑模块进行不同资源与资源之间的合成和同步,再把合成同步后的指令信息从后台服务器反馈到前端呈现虚拟直播的效果,用户可通过VR设备进入虚拟场景参与互动直播,也可通过手机、IPad等设备进行观看。

一种基于虚拟现实的音乐直播方法和系统.pdf

本发明提供的一种基于虚拟现实的音乐共享系统和方法,当主播端和用户端登陆虚拟场景服务器后,主播端输入的音乐内容信息会被边解析处理成数字化单元信息,在虚拟场景中进行不同资源与资源之间的合成和同步,再把合成同步后的指令信息从虚拟场景服务器反馈到前端呈现虚拟直播的效果,由于虚拟现实中大量的数据对网络带宽要求较高,本发明在VR场景中进行数据同步时采用分布式分发和点对点技术共享的方式实现数据的快速传输,而无需占用大量的带宽。

一种虚拟现实交互方法、装置和系统.pdf

本发明提供一种虚拟现实交互方法、装置和系统。该方法包括:通过第一红外摄像头采集标定物的至少两张第一红外图像,以及通过第二红外摄像头采集标定物至少两张第二红外图像,提取各标定点在各第一红外图像中对应的特征信息以及在各第二红外图像中对应的特征信息,利用各标定点在第一红外图像中对应的特征信息以及在第二红外图像中对应的特征信息,确定各标定点的三维运动轨迹信息,并通过各标定点的三维运动轨迹信息进行虚拟现实交互。通过两个红外摄像头同时采集标定物的红外图像进行虚拟现实交互,因此解决了现有技术通过三维深度摄像头采集图像进

一种虚拟现实系统的控制方法和装置.pdf

本发明实施例涉及一种虚拟现实系统的控制方法和装置,通过基于所述虚拟现实头盔接收到的控制命令生成数字信号,将所述数字信号发送至所述智能终端,基于所述智能终端接收的所述数字信号获取所述控制命令,以及使所述智能终端执行该控制命令。本发明实施例能够实现用户对VR系统的控制,在此过程中,用户不直接与智能终端交互,实现了用户对智能终端和VR头盔的集中管理且简化了控制流程。