一种基于Anchor angle机制的机械臂抓取检测方法.pdf

鸿朗****ka

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于Anchor angle机制的机械臂抓取检测方法.pdf

本发明公开了一种基于Anchorangle机制的机械臂抓取检测方法,包括:对训练集进行聚类得到先验信息;将训练集中的RGB图片和点云数据输入检测模型进行回归得到预测结果;基于预测结果与先验信息的差异对检测模型的参数进行优化调整,减小预测结果与先验信息的差异;优化后的预测结果包括一个抓取位置及其对应的尺寸信息,还包括K个抓取旋转角信息及每个抓取旋转角信息对应的置信度,将最高置信度对应的抓取旋转角信息与抓取位置及其对应的尺寸信息结合得到抓取信息。本发明在抓取检测的过程中保留了原有的点云特征,提高了检测抓取的精

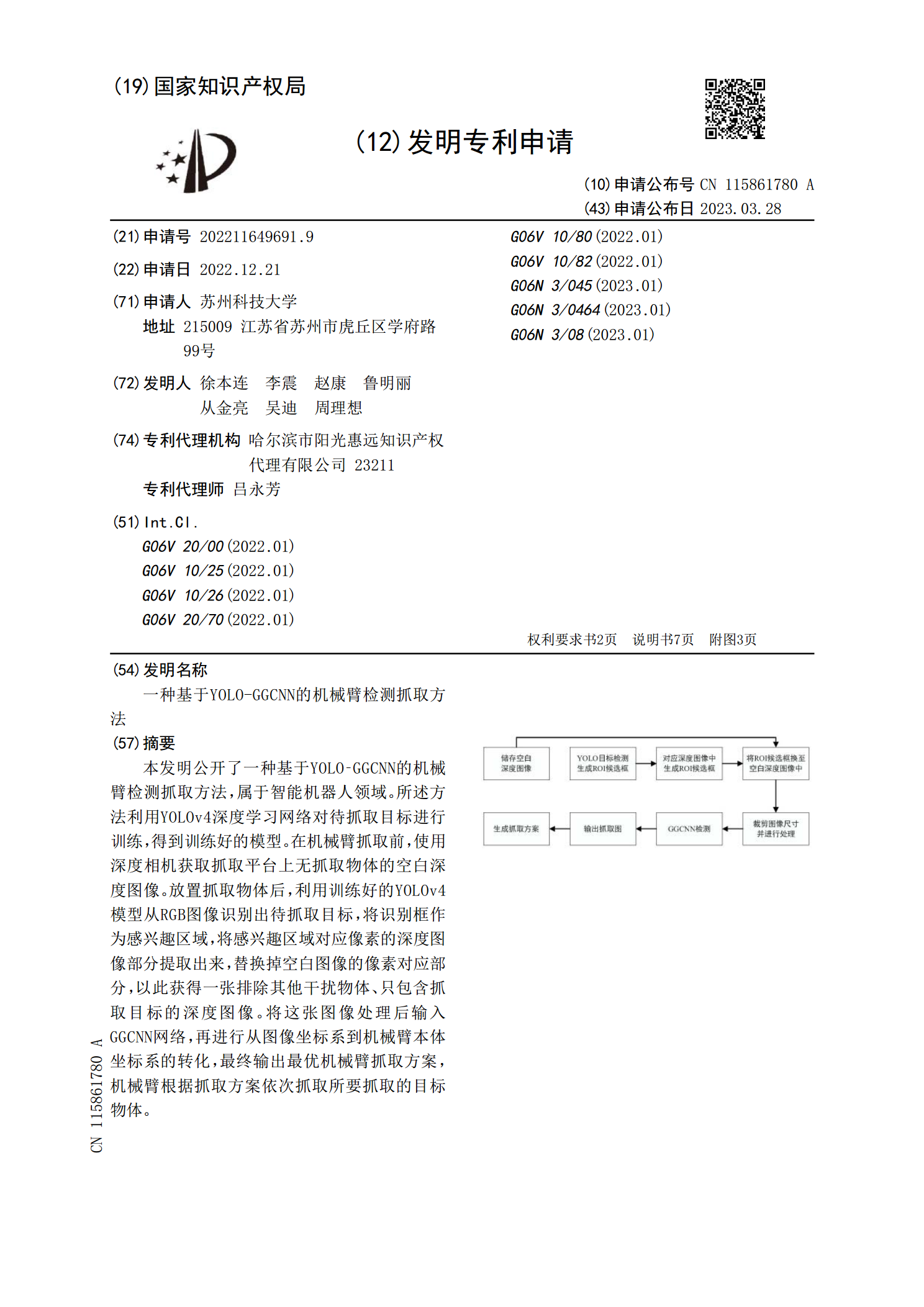

一种基于YOLO-GGCNN的机械臂检测抓取方法.pdf

本发明公开了一种基于YOLO?GGCNN的机械臂检测抓取方法,属于智能机器人领域。所述方法利用YOLOv4深度学习网络对待抓取目标进行训练,得到训练好的模型。在机械臂抓取前,使用深度相机获取抓取平台上无抓取物体的空白深度图像。放置抓取物体后,利用训练好的YOLOv4模型从RGB图像识别出待抓取目标,将识别框作为感兴趣区域,将感兴趣区域对应像素的深度图像部分提取出来,替换掉空白图像的像素对应部分,以此获得一张排除其他干扰物体、只包含抓取目标的深度图像。将这张图像处理后输入GGCNN网络,再进行从图像坐标系到

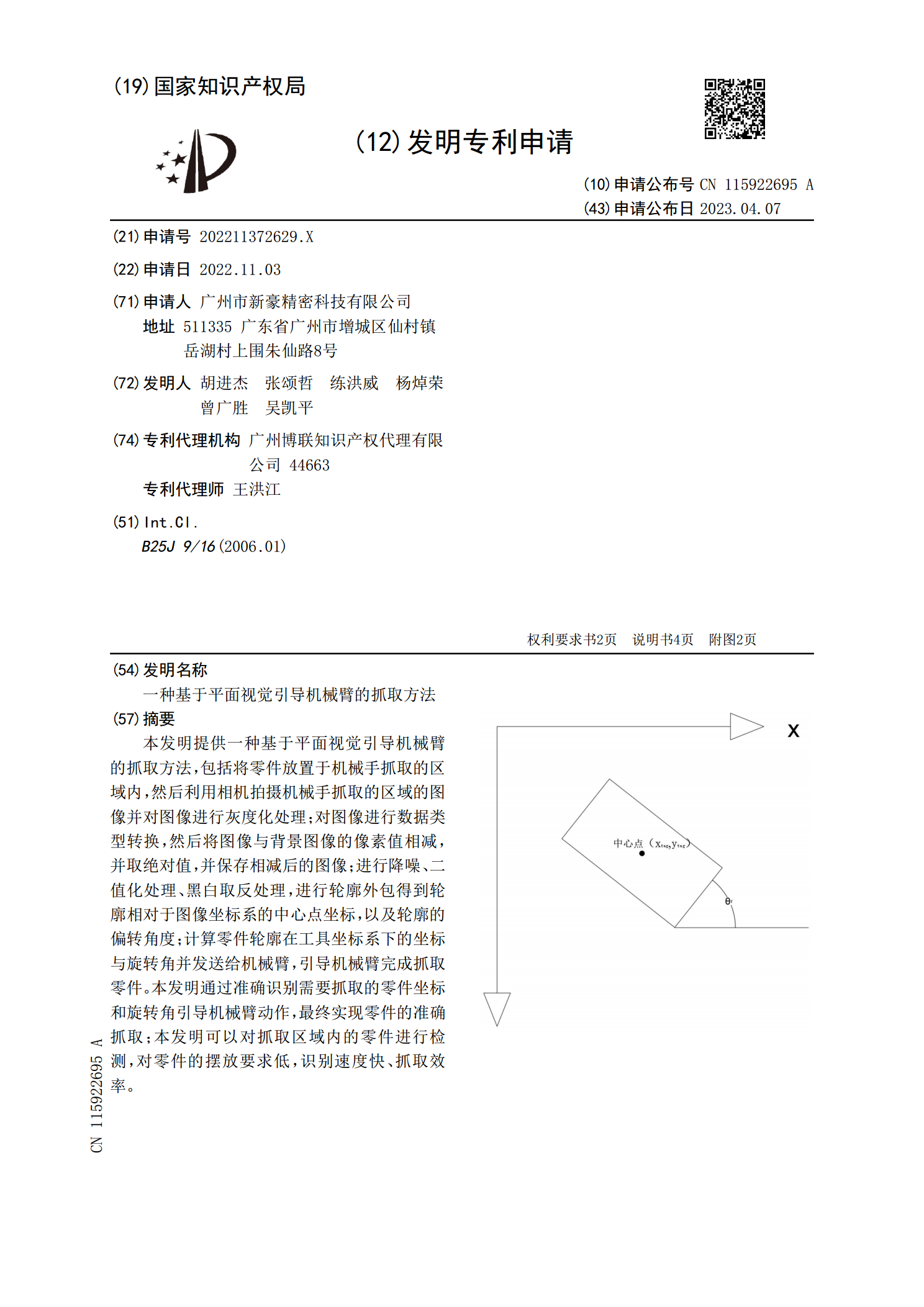

一种基于平面视觉引导机械臂的抓取方法.pdf

本发明提供一种基于平面视觉引导机械臂的抓取方法,包括将零件放置于机械手抓取的区域内,然后利用相机拍摄机械手抓取的区域的图像并对图像进行灰度化处理;对图像进行数据类型转换,然后将图像与背景图像的像素值相减,并取绝对值,并保存相减后的图像;进行降噪、二值化处理、黑白取反处理,进行轮廓外包得到轮廓相对于图像坐标系的中心点坐标,以及轮廓的偏转角度;计算零件轮廓在工具坐标系下的坐标与旋转角并发送给机械臂,引导机械臂完成抓取零件。本发明通过准确识别需要抓取的零件坐标和旋转角引导机械臂动作,最终实现零件的准确抓取;本发

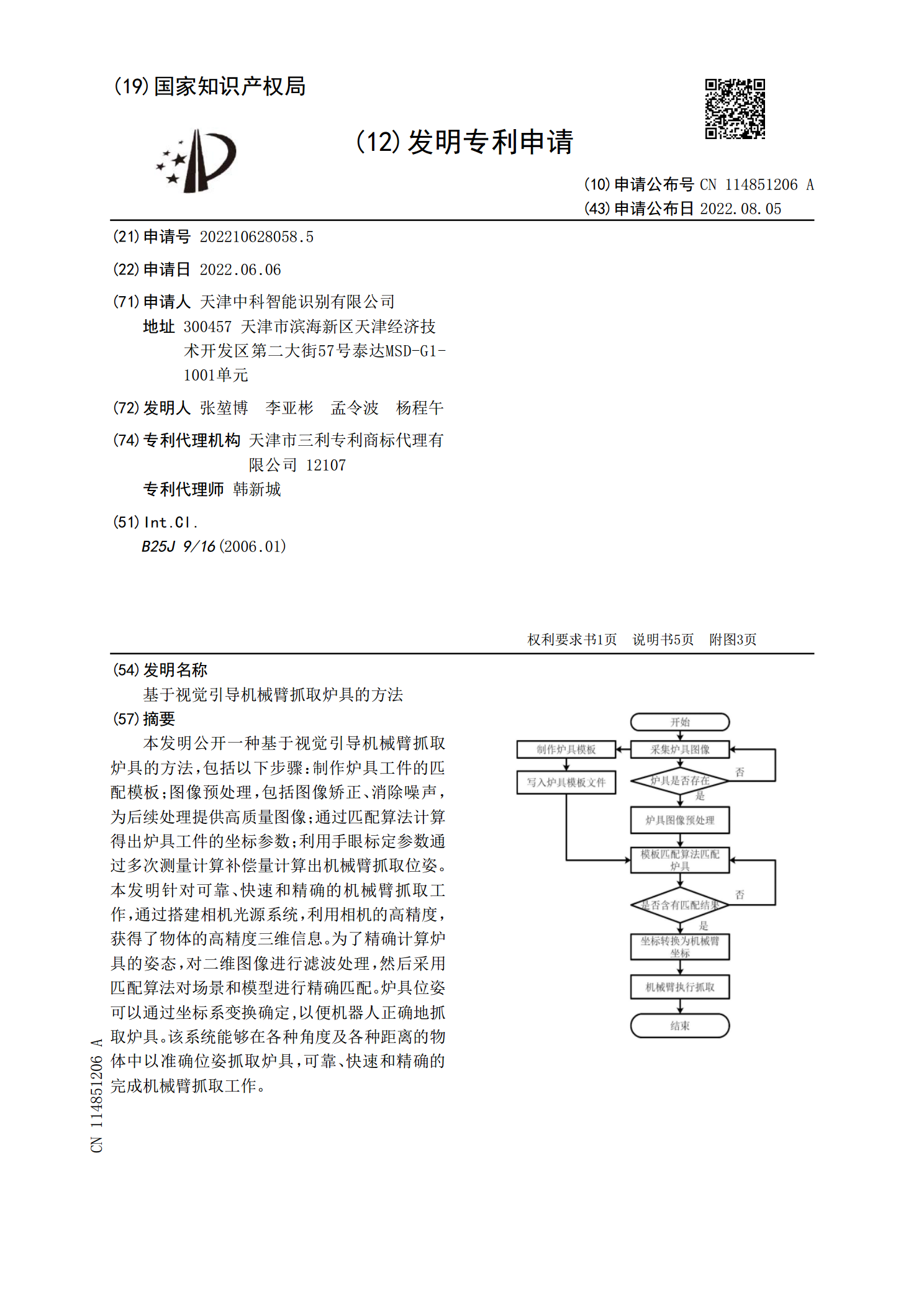

基于视觉引导机械臂抓取炉具的方法.pdf

本发明公开一种基于视觉引导机械臂抓取炉具的方法,包括以下步骤:制作炉具工件的匹配模板;图像预处理,包括图像矫正、消除噪声,为后续处理提供高质量图像;通过匹配算法计算得出炉具工件的坐标参数;利用手眼标定参数通过多次测量计算补偿量计算出机械臂抓取位姿。本发明针对可靠、快速和精确的机械臂抓取工作,通过搭建相机光源系统,利用相机的高精度,获得了物体的高精度三维信息。为了精确计算炉具的姿态,对二维图像进行滤波处理,然后采用匹配算法对场景和模型进行精确匹配。炉具位姿可以通过坐标系变换确定,以便机器人正确地抓取炉具。该

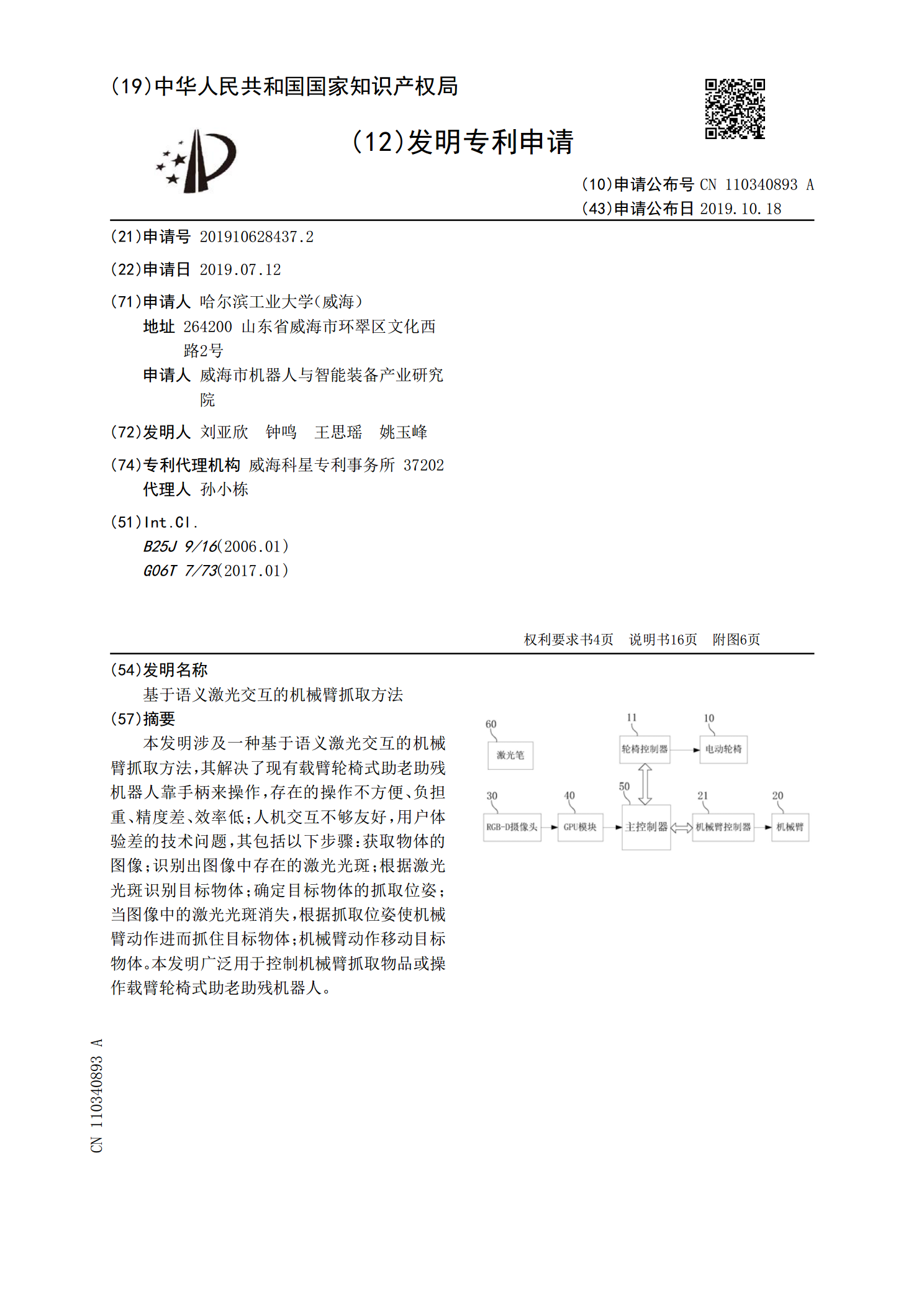

基于语义激光交互的机械臂抓取方法.pdf

本发明涉及一种基于语义激光交互的机械臂抓取方法,其解决了现有载臂轮椅式助老助残机器人靠手柄来操作,存在的操作不方便、负担重、精度差、效率低;人机交互不够友好,用户体验差的技术问题,其包括以下步骤:获取物体的图像;识别出图像中存在的激光光斑;根据激光光斑识别目标物体;确定目标物体的抓取位姿;当图像中的激光光斑消失,根据抓取位姿使机械臂动作进而抓住目标物体;机械臂动作移动目标物体。本发明广泛用于控制机械臂抓取物品或操作载臂轮椅式助老助残机器人。