基于PSO的路牌识别模型黑盒对抗攻击方法.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于PSO的路牌识别模型黑盒对抗攻击方法.docx

基于PSO的路牌识别模型黑盒对抗攻击方法摘要在基于粒子群优化算法的路牌识别模型中,黑盒攻击是一种常见的攻击方式,它可以引起模型预测错误,从而导致识别错误的结果。本文介绍了黑盒攻击的原理及其对基于PSO的路牌识别模型的影响。接着,我们就如何避免黑盒攻击进行了探讨。最后,我们通过实验验证了我们提出的防御策略的有效性。关键词:黑盒对抗攻击;粒子群算法;路牌识别;防御策略;模型鲁棒性引言目前,深度学习技术在图像处理、自然语言处理、语音识别等领域中得到了广泛的应用。在这些领域中,卷积神经网络(Convolution

一种基于梯度先验的高效黑盒对抗攻击方法.pdf

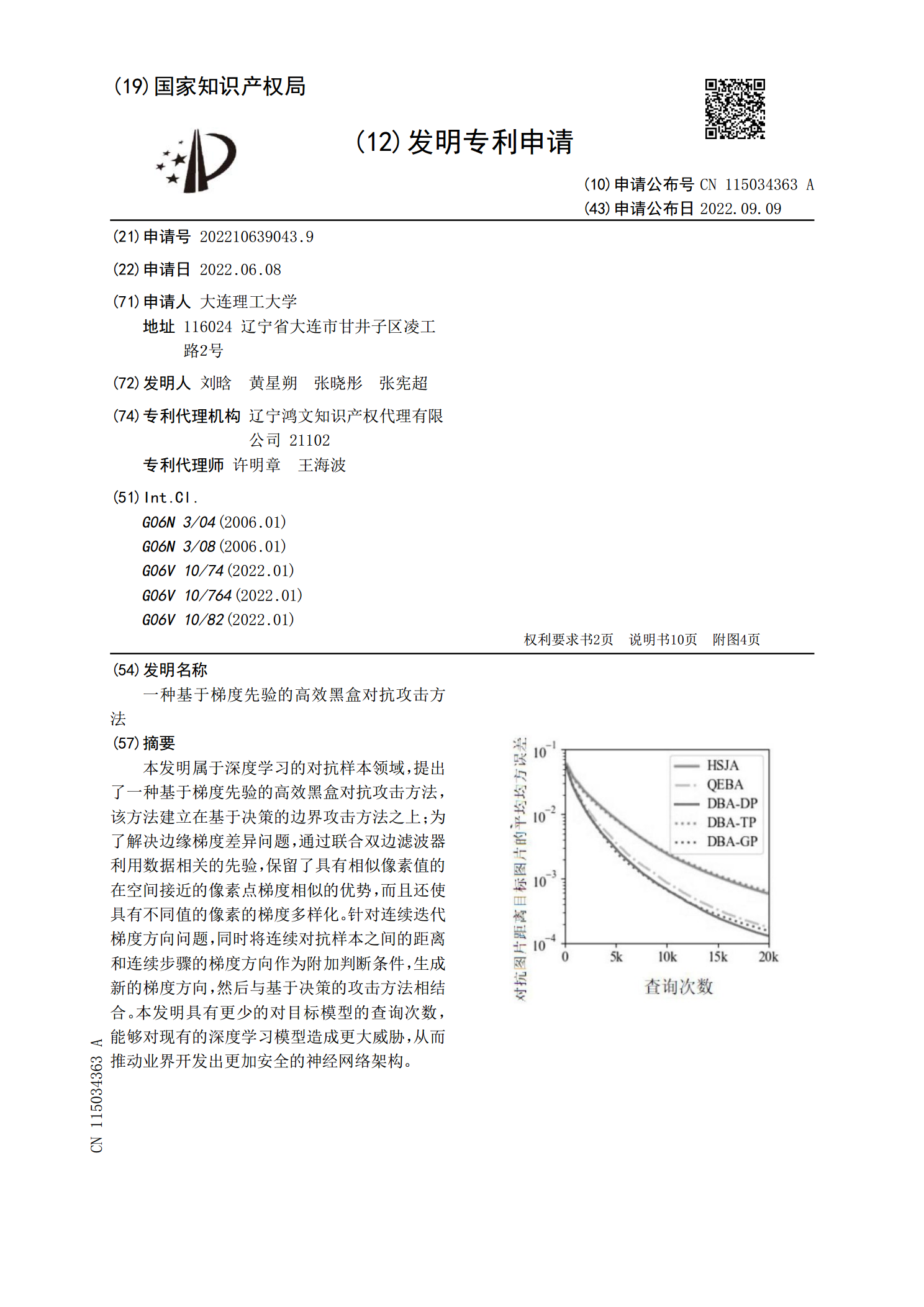

本发明属于深度学习的对抗样本领域,提出了一种基于梯度先验的高效黑盒对抗攻击方法,该方法建立在基于决策的边界攻击方法之上;为了解决边缘梯度差异问题,通过联合双边滤波器利用数据相关的先验,保留了具有相似像素值的在空间接近的像素点梯度相似的优势,而且还使具有不同值的像素的梯度多样化。针对连续迭代梯度方向问题,同时将连续对抗样本之间的距离和连续步骤的梯度方向作为附加判断条件,生成新的梯度方向,然后与基于决策的攻击方法相结合。本发明具有更少的对目标模型的查询次数,能够对现有的深度学习模型造成更大威胁,从而推动业界开

检测对抗攻击的方法和训练对抗攻击检测模型的方法.pdf

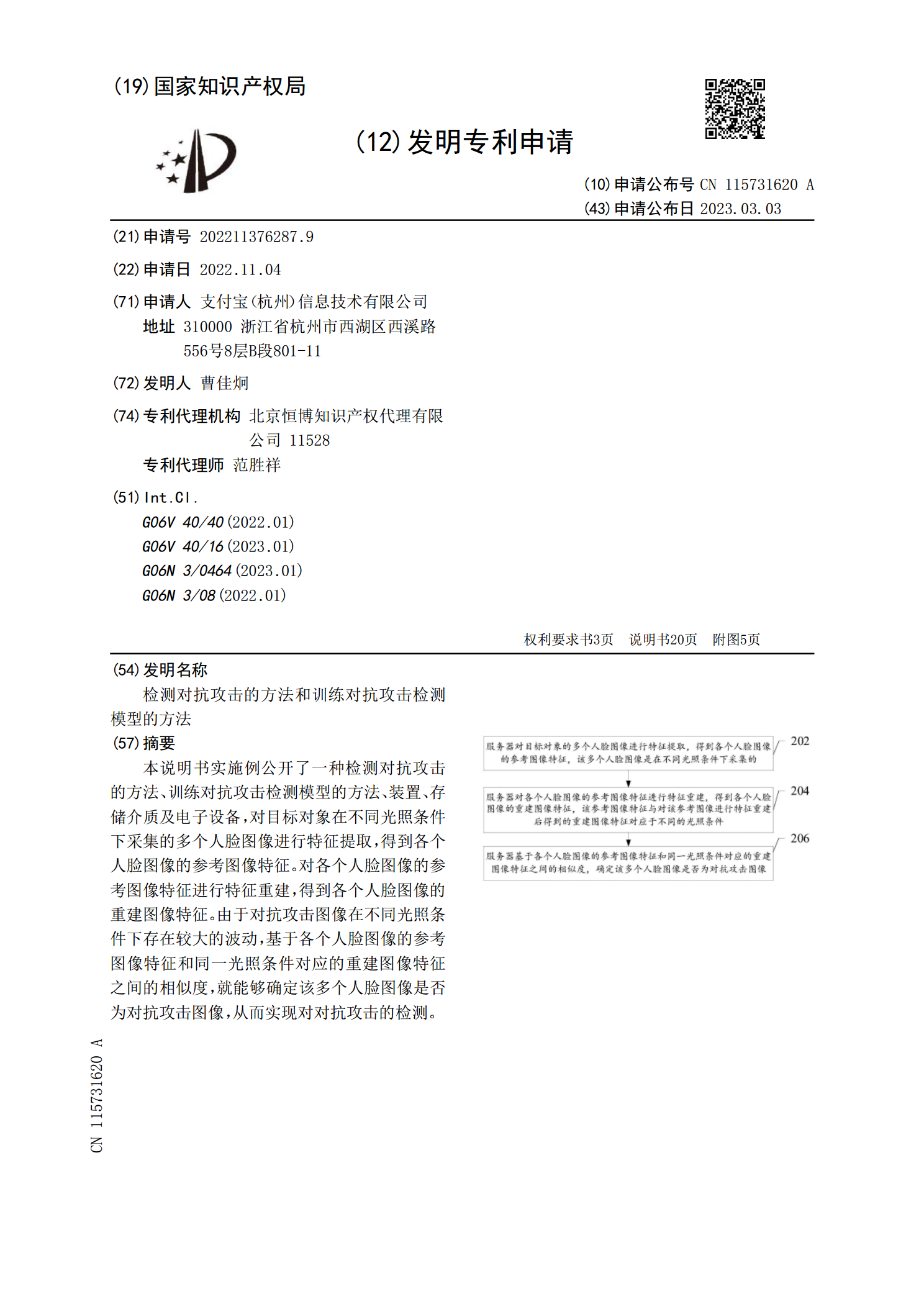

本说明书实施例公开了一种检测对抗攻击的方法、训练对抗攻击检测模型的方法、装置、存储介质及电子设备,对目标对象在不同光照条件下采集的多个人脸图像进行特征提取,得到各个人脸图像的参考图像特征。对各个人脸图像的参考图像特征进行特征重建,得到各个人脸图像的重建图像特征。由于对抗攻击图像在不同光照条件下存在较大的波动,基于各个人脸图像的参考图像特征和同一光照条件对应的重建图像特征之间的相似度,就能够确定该多个人脸图像是否为对抗攻击图像,从而实现对对抗攻击的检测。

物理对抗攻击方法、物理对抗攻击模型训练方法及装置.pdf

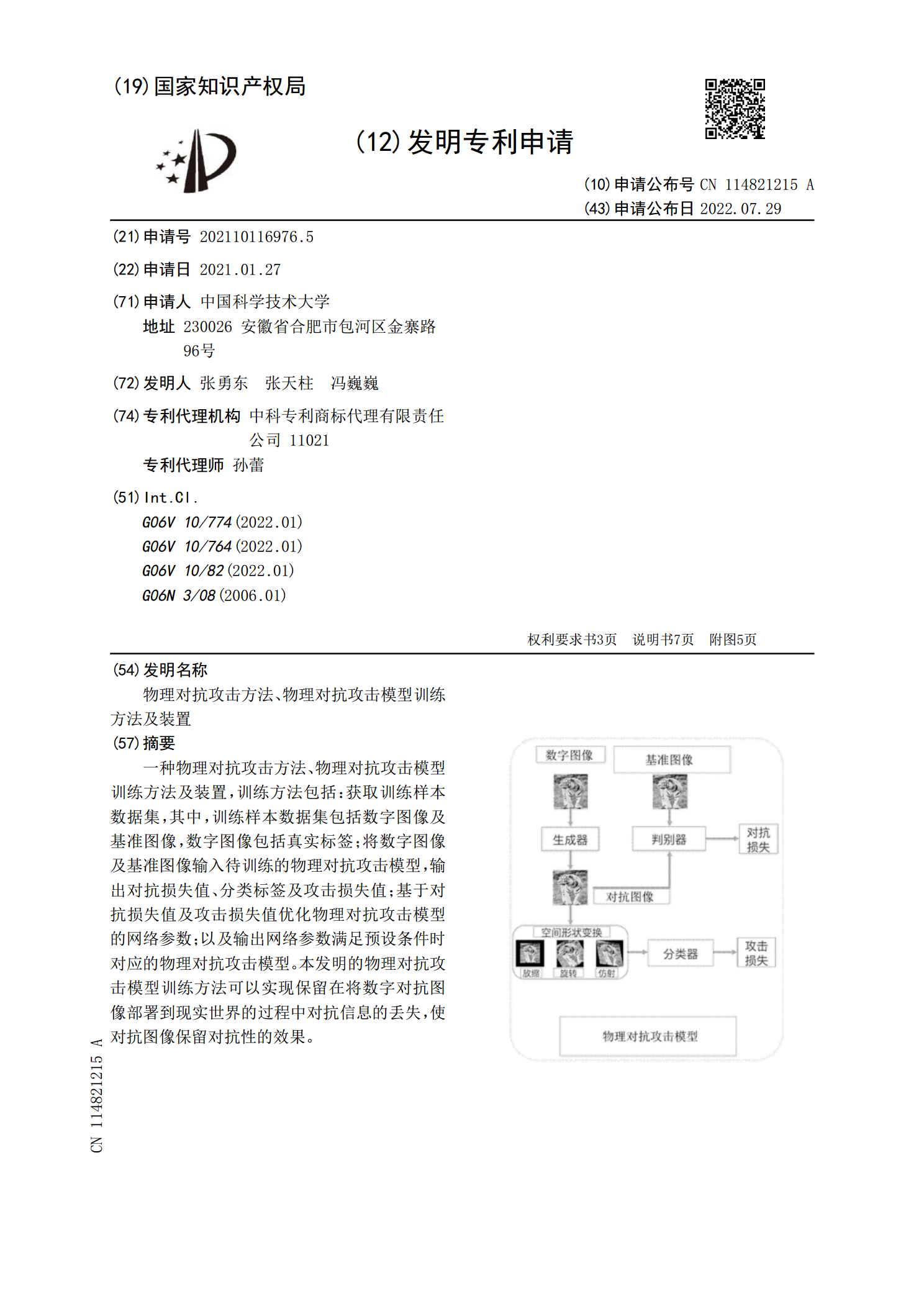

一种物理对抗攻击方法、物理对抗攻击模型训练方法及装置,训练方法包括:获取训练样本数据集,其中,训练样本数据集包括数字图像及基准图像,数字图像包括真实标签;将数字图像及基准图像输入待训练的物理对抗攻击模型,输出对抗损失值、分类标签及攻击损失值;基于对抗损失值及攻击损失值优化物理对抗攻击模型的网络参数;以及输出网络参数满足预设条件时对应的物理对抗攻击模型。本发明的物理对抗攻击模型训练方法可以实现保留在将数字对抗图像部署到现实世界的过程中对抗信息的丢失,使对抗图像保留对抗性的效果。

对基于深度学习的人脸识别模型的对抗攻击的任务书.docx

对基于深度学习的人脸识别模型的对抗攻击的任务书任务书:基于深度学习的人脸识别模型的对抗攻击一、任务背景随着深度学习在计算机视觉领域的广泛应用,基于深度学习的人脸识别技术在安全监控、身份验证等领域得到了广泛应用。但是,近年来,研究者们已经证明,人脸识别模型易受到对抗样本的攻击,从而降低了人脸识别的准确性和安全性。有必要研究如何对基于深度学习的人脸识别模型进行对抗攻击。二、任务描述本任务要求参赛者对基于深度学习的人脸识别模型进行对抗攻击,要求攻击效果较好,攻击对抗样本难以被原模型识别出来,同时也可用于提高原模