对基于深度学习的人脸识别模型的对抗攻击的任务书.docx

骑着****猪猪

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

对基于深度学习的人脸识别模型的对抗攻击的任务书.docx

对基于深度学习的人脸识别模型的对抗攻击的任务书任务书:基于深度学习的人脸识别模型的对抗攻击一、任务背景随着深度学习在计算机视觉领域的广泛应用,基于深度学习的人脸识别技术在安全监控、身份验证等领域得到了广泛应用。但是,近年来,研究者们已经证明,人脸识别模型易受到对抗样本的攻击,从而降低了人脸识别的准确性和安全性。有必要研究如何对基于深度学习的人脸识别模型进行对抗攻击。二、任务描述本任务要求参赛者对基于深度学习的人脸识别模型进行对抗攻击,要求攻击效果较好,攻击对抗样本难以被原模型识别出来,同时也可用于提高原模

深度学习人脸识别系统的对抗攻击算法研究.docx

深度学习人脸识别系统的对抗攻击算法研究深度学习人脸识别系统的对抗攻击算法研究摘要:随着深度学习的迅猛发展,人脸识别系统在安全和便利性上取得了巨大的突破。然而,近年来对人脸识别系统进行对抗攻击的研究也日益增加。对抗攻击可以通过精心设计的扰动来欺骗人脸识别系统,使其无法正确识别人脸。本文将探讨深度学习人脸识别系统的对抗攻击算法研究,包括对抗样本生成方法、防御对抗攻击的方法以及对抗攻击在人脸识别系统中的潜在威胁。1.引言随着深度学习技术的发展,人脸识别系统在各个领域得到了广泛应用。人脸识别系统可以通过分析人脸图

基于PSO的路牌识别模型黑盒对抗攻击方法.docx

基于PSO的路牌识别模型黑盒对抗攻击方法摘要在基于粒子群优化算法的路牌识别模型中,黑盒攻击是一种常见的攻击方式,它可以引起模型预测错误,从而导致识别错误的结果。本文介绍了黑盒攻击的原理及其对基于PSO的路牌识别模型的影响。接着,我们就如何避免黑盒攻击进行了探讨。最后,我们通过实验验证了我们提出的防御策略的有效性。关键词:黑盒对抗攻击;粒子群算法;路牌识别;防御策略;模型鲁棒性引言目前,深度学习技术在图像处理、自然语言处理、语音识别等领域中得到了广泛的应用。在这些领域中,卷积神经网络(Convolution

基于人脸深度信息的人脸识别系统对抗防御方法.pdf

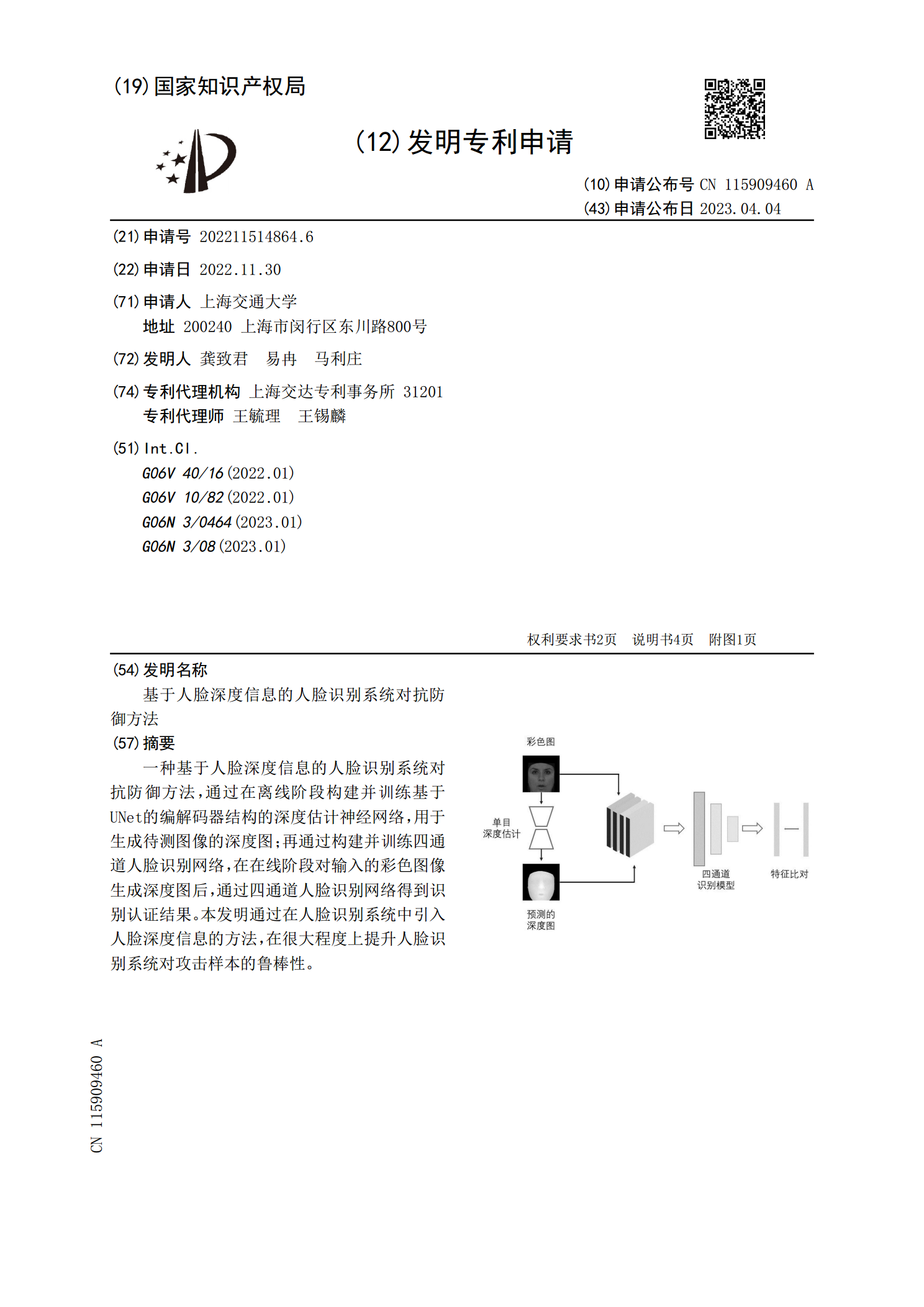

一种基于人脸深度信息的人脸识别系统对抗防御方法,通过在离线阶段构建并训练基于UNet的编解码器结构的深度估计神经网络,用于生成待测图像的深度图;再通过构建并训练四通道人脸识别网络,在在线阶段对输入的彩色图像生成深度图后,通过四通道人脸识别网络得到识别认证结果。本发明通过在人脸识别系统中引入人脸深度信息的方法,在很大程度上提升人脸识别系统对攻击样本的鲁棒性。

基于深度学习的图像识别与对抗样本攻击防御研究的开题报告.docx

基于深度学习的图像识别与对抗样本攻击防御研究的开题报告一、研究背景和意义随着深度学习技术的不断发展,图像识别技术已经在很多领域得到了广泛应用,包括人脸识别、街景识别、医学影像识别等。这些应用场景要求图像识别系统具有高准确率和高鲁棒性,即在识别图像时精度高,同时对噪声和干扰有很强的容错能力。但是图像识别系统也面临着对抗样本攻击的威胁。对抗样本攻击是指对输入图像进行微小修改,使得图像识别系统的分类结果产生显著错误。对抗样本攻击不仅可以造成对识别系统的破坏,还可能对社会造成巨大的安全威胁。例如,对人脸识别系统的