基于循环共同注意力Transformer的多模态蒙汉翻译方法.pdf

明轩****la

亲,该文档总共22页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于循环共同注意力Transformer的多模态蒙汉翻译方法.pdf

一种基于循环共同注意力Transformer的多模态蒙汉翻译方法,利用YOLO‑V4对输入图像进行目标检测,通过相关性检测对比蒙古文本与目标标签,保留与蒙古文本相关的目标图像,并利用编码层将蒙古文本编码为张量;利用重参数化VGG网络和三重注意力机制提取并关注目标图像特征,采用形变双向长短期记忆网络对目标图像特征与编码后的蒙古文本特征即张量分别进行数次交互,之后送入到循环共同注意力Transformer网络中进行蒙汉翻译,通过数次循环交互,将蒙古语言特征与视觉特征充分融合,输出目标语言。本发明从视觉和语言两

基于Transformer算法的单模态标签生成和多模态情感判别方法.pdf

本发明公开了一种基于Transformer算法的单模态标签生成和多模态情感判别方法,包括:1获取多模态非对齐数据集,并进行预处理得到对应模态的嵌入表达特征;2建立ITE网络模块,提取模态内特征;3单模态标签预测和多模态情感决策判别标签的融合生成;4建立模态间BTE网络模块和模态增强MTE网络模块,并经过全局自注意力STE网络模块获取模态间特征和模态增强特征;5获取多模态情感深层预测的标签。本发明对目前多模态数据集仅有一个多模态标签的情况,通过自监督的带权投票机制进行决策融合产生单模态标签,基于多种跨模态T

基于transformer神经网络的汉蒙机构名翻译研究.pptx

汇报人:目录PARTONEPARTTWOTransformer神经网络的基本结构Transformer神经网络的工作原理Transformer神经网络在机器翻译领域的应用PARTTHREE汉蒙语言交流的重要性机构名翻译的难点和挑战机构名翻译准确性的意义PARTFOUR数据预处理和标注模型架构设计和实现训练和优化过程模型评估指标和测试结果PARTFIVE不同模型之间的比较翻译准确率的提升翻译质量的评估和改进PARTSIX基于Transformer神经网络的汉蒙机构名翻译研究的贡献和价值对未来研究的建议和展望

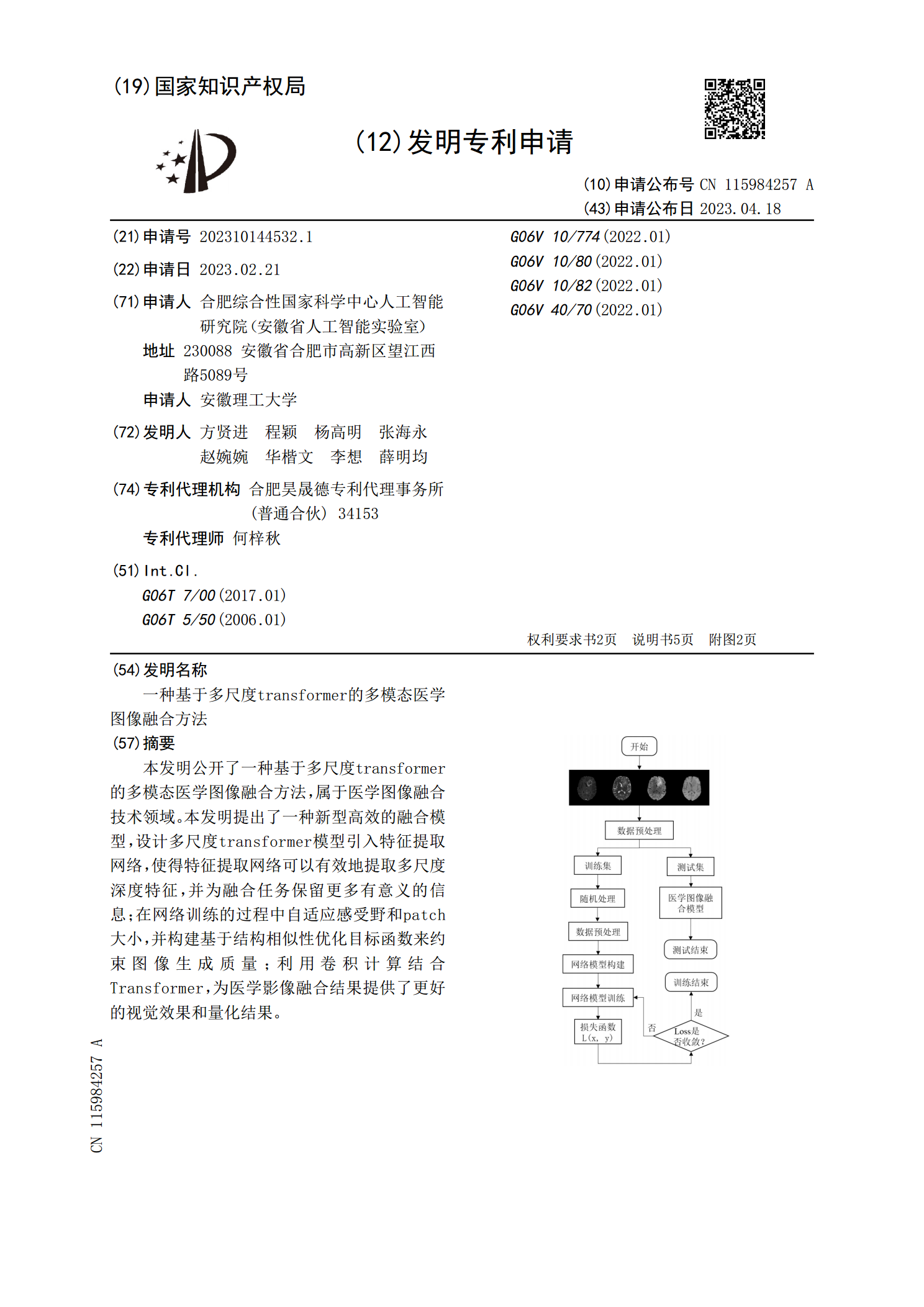

一种基于多尺度transformer的多模态医学图像融合方法.pdf

本发明公开了一种基于多尺度transformer的多模态医学图像融合方法,属于医学图像融合技术领域。本发明提出了一种新型高效的融合模型,设计多尺度transformer模型引入特征提取网络,使得特征提取网络可以有效地提取多尺度深度特征,并为融合任务保留更多有意义的信息;在网络训练的过程中自适应感受野和patch大小,并构建基于结构相似性优化目标函数来约束图像生成质量;利用卷积计算结合Transformer,为医学影像融合结果提供了更好的视觉效果和量化结果。

一种基于依存句法信息和Transformer模型的蒙汉神经机器翻译方法.pdf

本发明公开了一种基于依存句法信息和Transformer模型的蒙汉神经机器翻译方法,包括:依据蒙汉平行语料库抽取出汉语依存句法信息,并将依存句法信息转换成邻接矩阵;在Transformer模型的输出端额外增加一路,则Transformer模型的一路用于预测汉语目标语句,另一路学习汉语依存句法知识;在编码器端显式地加入用于学习蒙语句法信息的模块,利用汉语句法知识强化蒙语语法的学习,原始Transformer模型默认隐式地学习了源语言、目标语言的句法信息,本发明显式地利用目标语言端的句法信息指导模型对源语言的