基于注意力机制的多模态数据融合三维目标检测方法.pdf

山柳****魔王

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于注意力机制的多模态数据融合三维目标检测方法.pdf

本发明提出了一种基于注意力机制的多模态数据融合三维目标检测方法,实现步骤为:建立训练和测试样本集并对数据进行预处理;构建基于注意力机制的多模态数据融合三维目标检测网络;定义基于注意力机制的多模态数据融合三维目标检测网络的损失函数;对网络模型进行迭代训练;获取三维目标的检测结果。本发明利用特征学习网络,初步提取出一些候选区域,然后将候选区域中的点云数据、点的位置特征以及对应的图像信息进行了融合,充分利用了点云的规则化空间位置信息、点特征的精细化空间结构信息和图像的语义信息,减小了误差累积,进而提高了局部空间

一种基于注意力机制与多尺度融合的目标检测方法.pdf

本发明公开了一种基于注意力机制与多尺度融合的目标检测方法,包括步骤Step1.改进YOLOv5s网络,得到算法模型PE‑YOLOv5s;Step2.将数据集图像输入到算法模型PE‑YOLOv5s内,提取特征;Step3.将步骤Step2得到的特征图进行特征重建融合;Step4.将步骤Step3得到的特征进行特征筛选;Step5.对步骤Step4得到的特征进行分类和回归,得到基于注意力机制与多尺度融合的YOLOv5目标检测模型;本方法通过对YOLOv5s的网络基础进行改进,有效解决了复杂环境下的动态目标进行

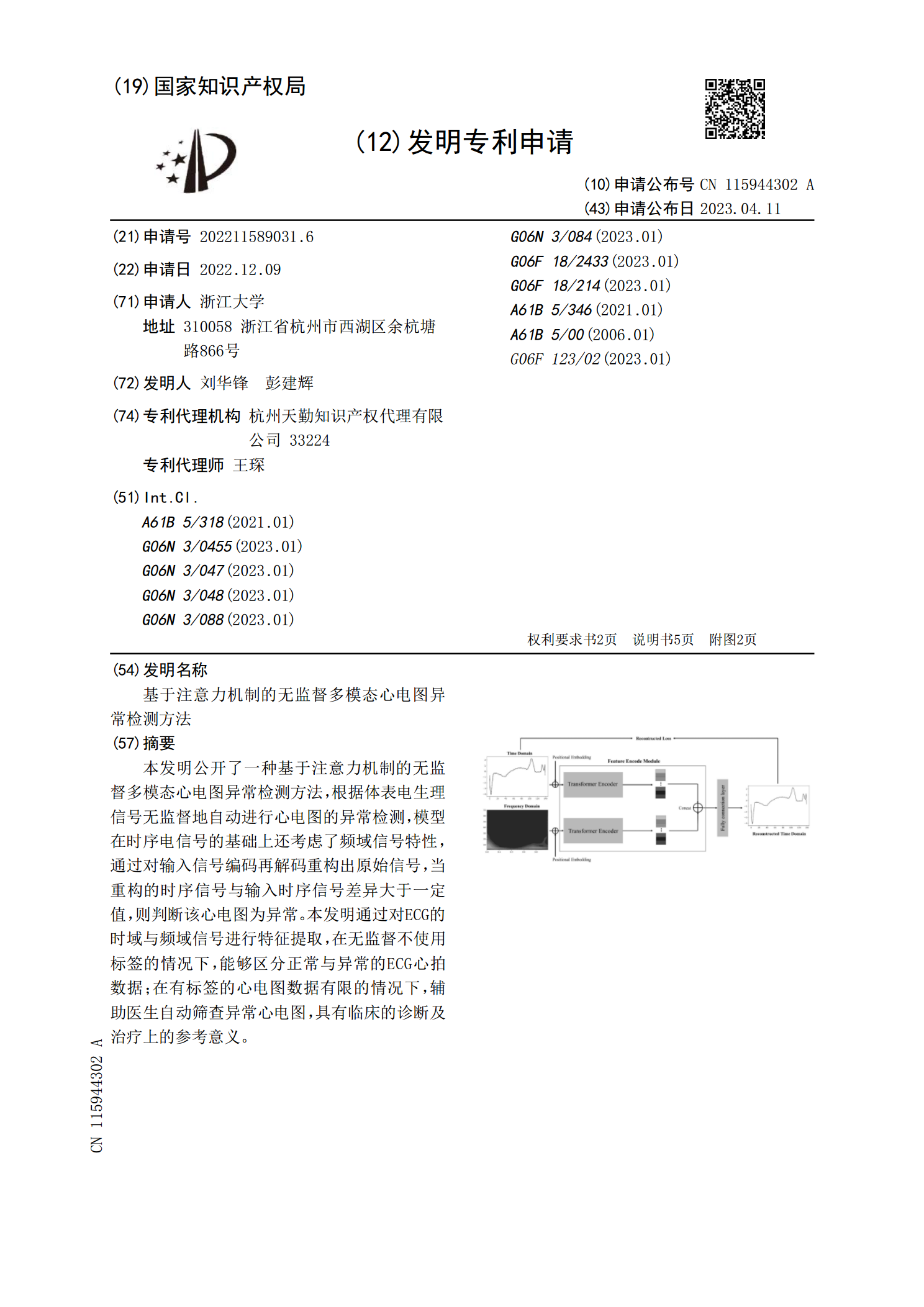

基于注意力机制的无监督多模态心电图异常检测方法.pdf

本发明公开了一种基于注意力机制的无监督多模态心电图异常检测方法,根据体表电生理信号无监督地自动进行心电图的异常检测,模型在时序电信号的基础上还考虑了频域信号特性,通过对输入信号编码再解码重构出原始信号,当重构的时序信号与输入时序信号差异大于一定值,则判断该心电图为异常。本发明通过对ECG的时域与频域信号进行特征提取,在无监督不使用标签的情况下,能够区分正常与异常的ECG心拍数据;在有标签的心电图数据有限的情况下,辅助医生自动筛查异常心电图,具有临床的诊断及治疗上的参考意义。

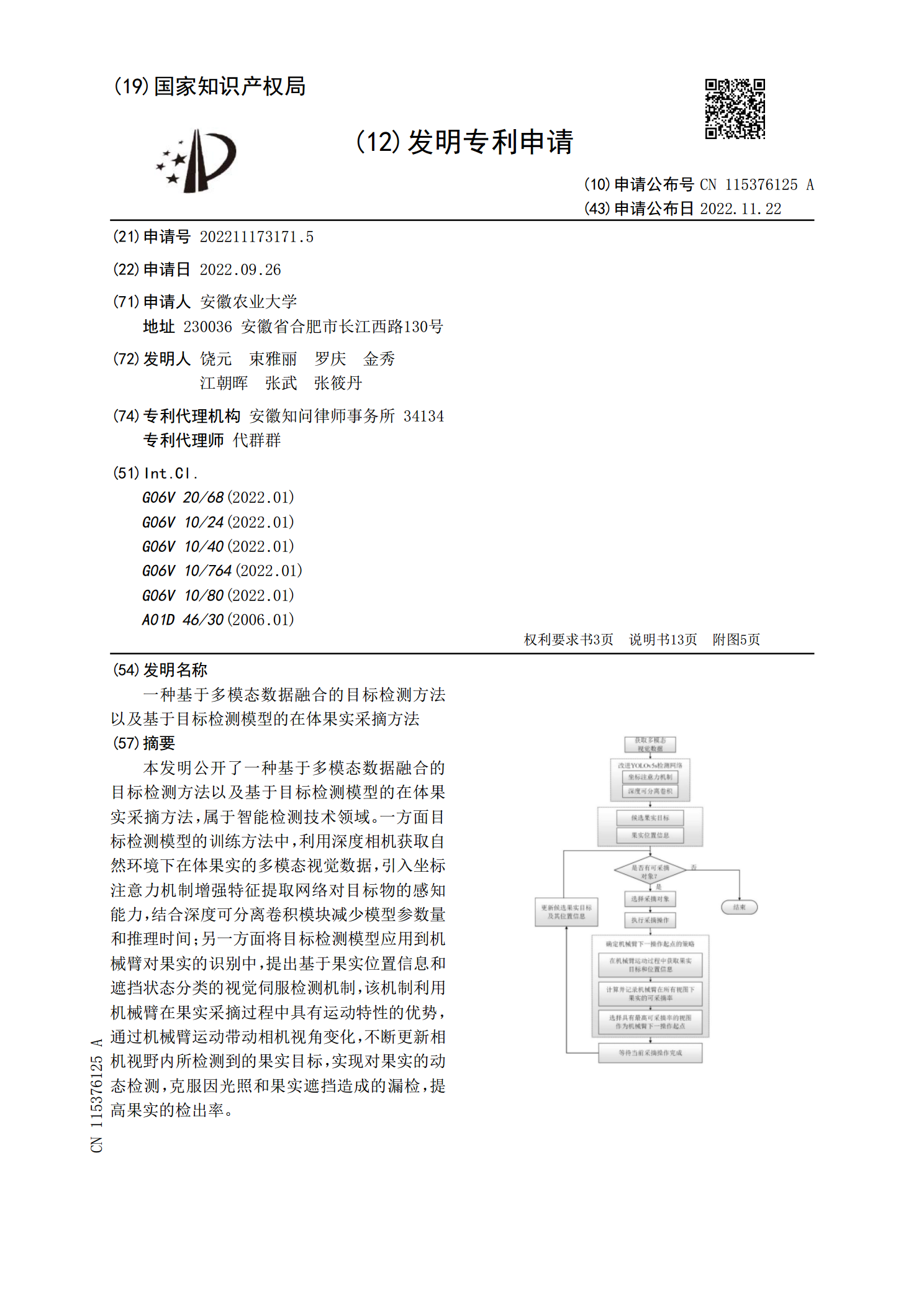

一种基于多模态数据融合的目标检测方法以及基于目标检测模型的在体果实采摘方法.pdf

本发明公开了一种基于多模态数据融合的目标检测方法以及基于目标检测模型的在体果实采摘方法,属于智能检测技术领域。一方面目标检测模型的训练方法中,利用深度相机获取自然环境下在体果实的多模态视觉数据,引入坐标注意力机制增强特征提取网络对目标物的感知能力,结合深度可分离卷积模块减少模型参数量和推理时间;另一方面将目标检测模型应用到机械臂对果实的识别中,提出基于果实位置信息和遮挡状态分类的视觉伺服检测机制,该机制利用机械臂在果实采摘过程中具有运动特性的优势,通过机械臂运动带动相机视角变化,不断更新相机视野内所检测到

基于交叉注意力机制的图像点云融合三维目标检测方法.pdf

本发明涉及一种基于交叉注意力机制的图像点云融合三维目标检测方法及系统,属于三维目标检测领域。方法包括:对图像进行目标检测及分割处理,得到实例掩码;根据点云图像空间投影关系得到每一个实例掩码内的点云集合;使用DBSCAN聚类算法对每一个点云集合内的点云进行聚类,为前景点集合中的所有点云逐点拼接实例分割结果向量,将经图像特征渲染的点云所占的整个三维空间划分成多个柱体并进行特征拆分和重组,引入交叉注意力机制聚合柱体内每个点的位置特征和图像特征,多个柱体的融合特征构成伪图像特征;使用RPN网络提取并整合伪图像特征