一种虚拟试衣方法及系统.pdf

一吃****成益

亲,该文档总共16页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种虚拟试衣方法及系统.pdf

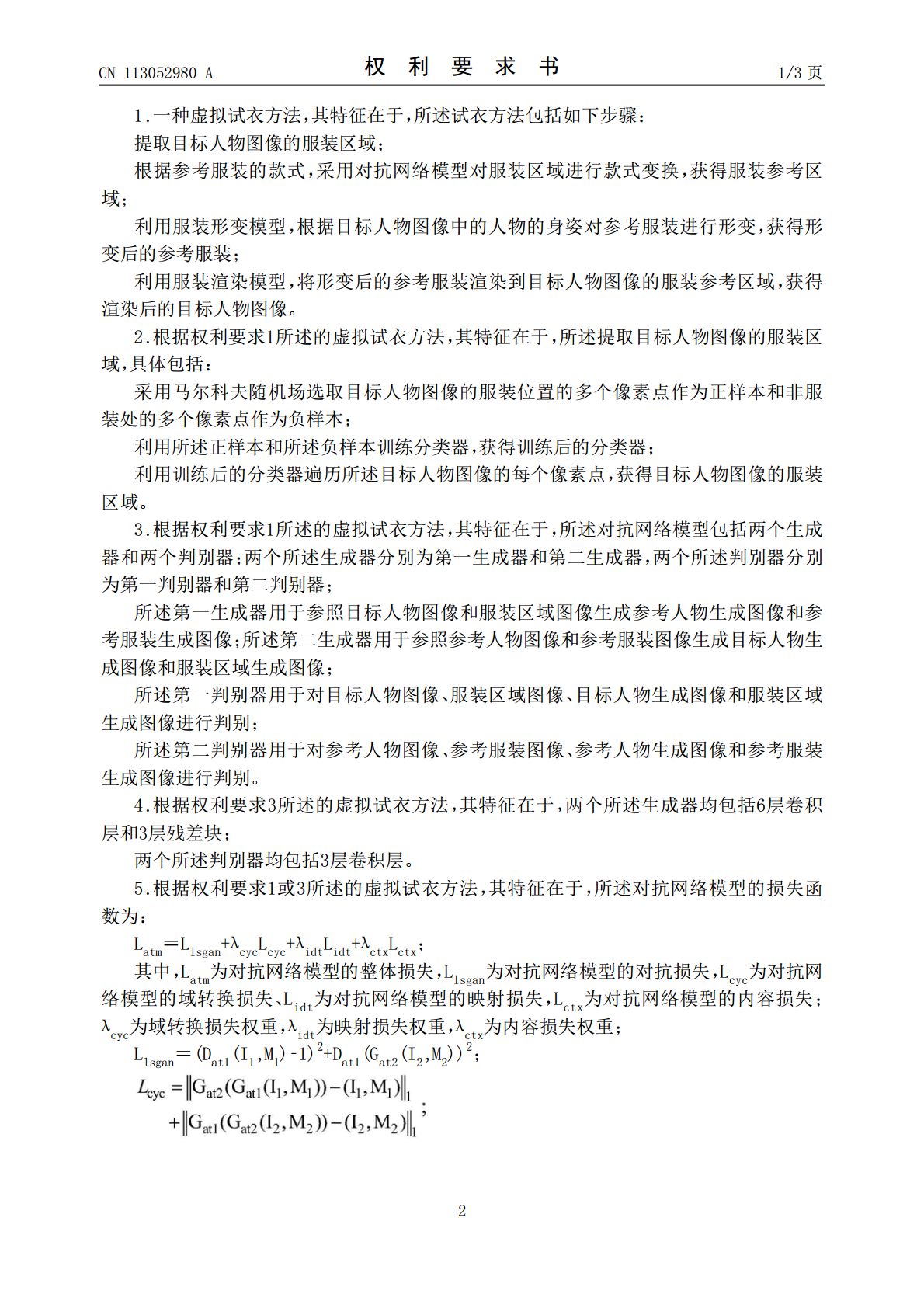

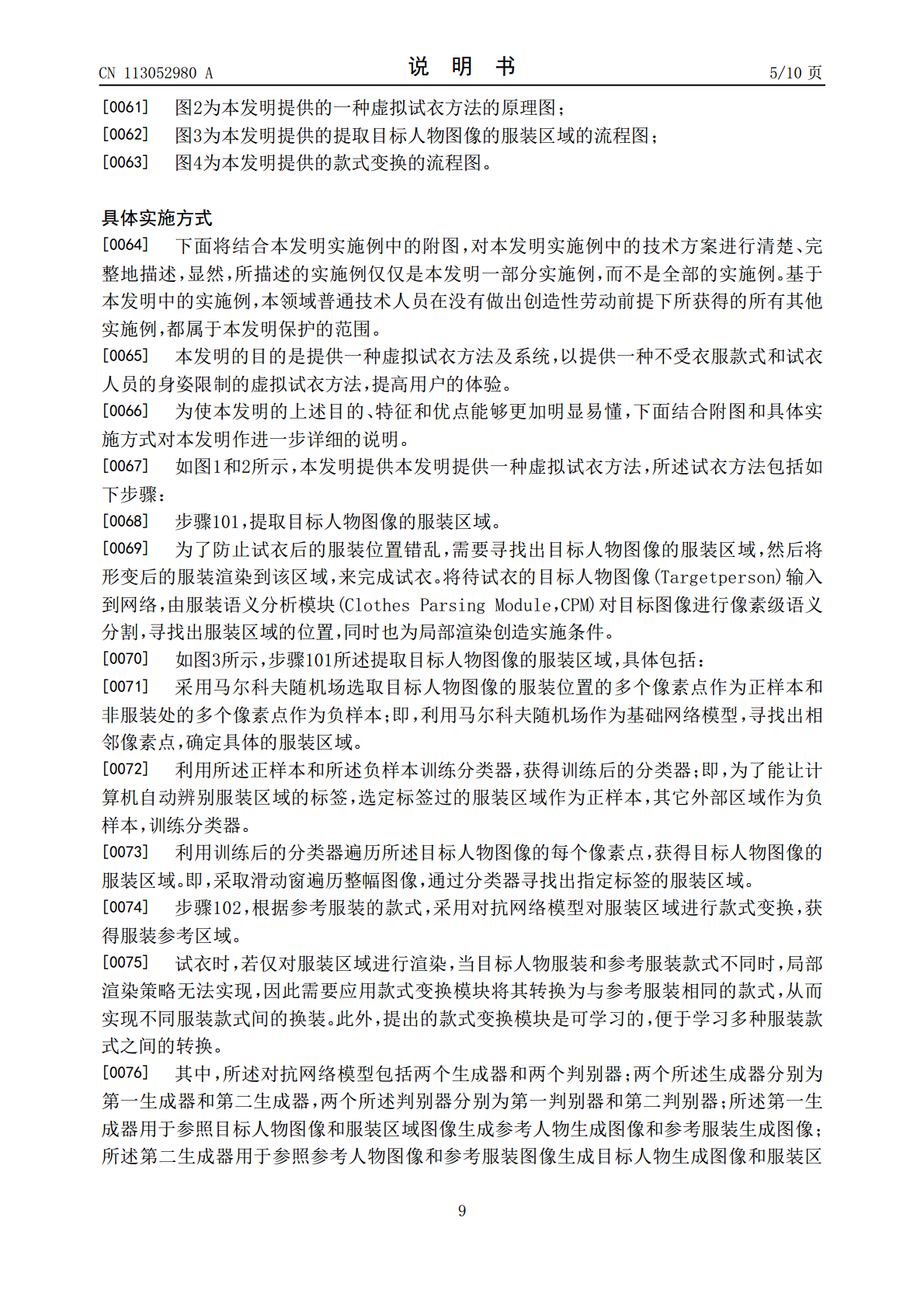

本发明公开了一种虚拟试衣方法,所述试衣方法包括如下步骤:提取目标人物图像的服装区域;根据参考服装的款式,采用对抗网络模型对服装区域进行款式变换,获得服装参考区域;利用服装形变模型,根据目标人物图像中的人物的身姿对参考服装进行形变,获得形变后的参考服装;利用服装渲染模型,将形变后的参考服装渲染到目标人物图像的服装参考区域,获得渲染后的目标人物图像。本发明利用对抗网络模型对服装区域进行款式变换,使虚拟试衣不受款式的限制,利用服装形变模型对参考服装进行形变,使其适用于不同的身姿,使虚拟试衣不受身姿的限制,本发明

一种虚拟试衣装置及其虚拟试衣系统.pdf

本发明公开了一种虚拟试衣装置及其虚拟试衣系统,包括本体和处理器,所述处理器设置在本体的内部,所述本体的一侧通过合页连接有箱门,所所述箱门的内表面固定安装有试衣背景墙,所述本体的内部顶端通过支撑架固定安装有照明灯,所述本体的内壁上固定安装有若干个摄像头和体感装置,所述本体的内部底端设置有感应区,所述本体的内壁上固定安装有控制器,所述本体的一侧内壁上开设有放置槽,所述放置槽的内部设置有VR眼镜,所述本体的内表面固定安装有展示屏。本发明根据采集结果获取衣物图像,将获取的衣物图像与用户的体征图像进行融合,以得出用

新型虚拟试衣方法及系统.pdf

本发明揭示了一种新型虚拟试衣方法及系统。该方法可包括步骤:在使用者二维照片中置入骨架关节点,并获取二维照片中使用者的体型轮廓;将二维服饰图与设置骨架绑定,形成三维服饰图;?加载所述使用者的体型轮廓以及三维服饰图,将服饰与体型轮廓骨架关节点对应形成虚拟试衣效果图。本发明中虚拟模型以及服饰的制作速度快,普通使用者试衣只需较短时间,生成一次二维模型后可长期使用到不同服饰的试穿上,同时运用使用者自己照片,使得试衣过程更加逼真;通过绑定骨架的方式,使得三维服饰可跟随二维模型的动作,增加试衣的形象性;三维服饰可与二维

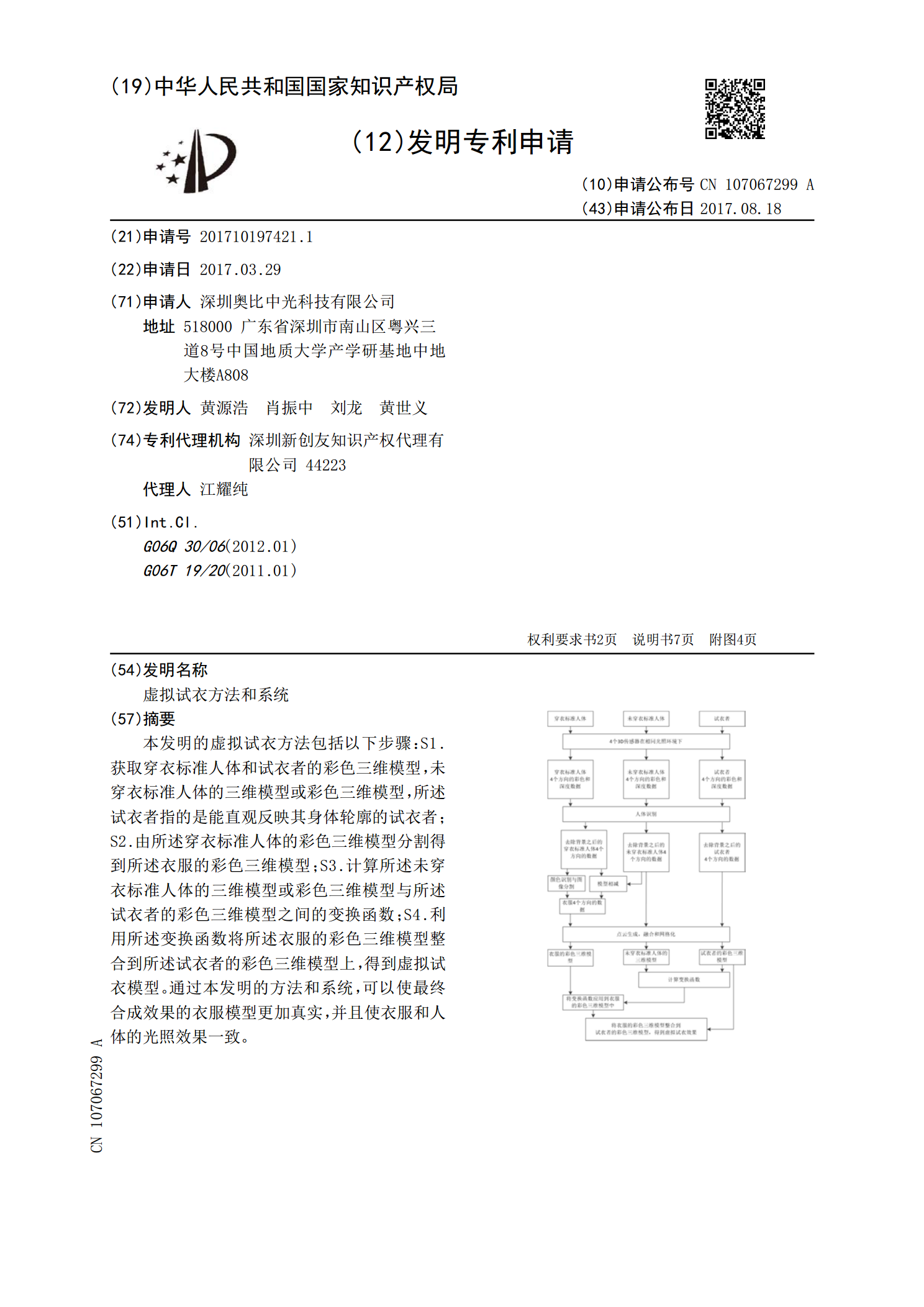

虚拟试衣方法和系统.pdf

本发明的虚拟试衣方法包括以下步骤:S1.获取穿衣标准人体和试衣者的彩色三维模型,未穿衣标准人体的三维模型或彩色三维模型,所述试衣者指的是能直观反映其身体轮廓的试衣者;S2.由所述穿衣标准人体的彩色三维模型分割得到所述衣服的彩色三维模型;S3.计算所述未穿衣标准人体的三维模型或彩色三维模型与所述试衣者的彩色三维模型之间的变换函数;S4.利用所述变换函数将所述衣服的彩色三维模型整合到所述试衣者的彩色三维模型上,得到虚拟试衣模型。通过本发明的方法和系统,可以使最终合成效果的衣服模型更加真实,并且使衣服和人体的光

一种商场虚拟试衣系统.pdf

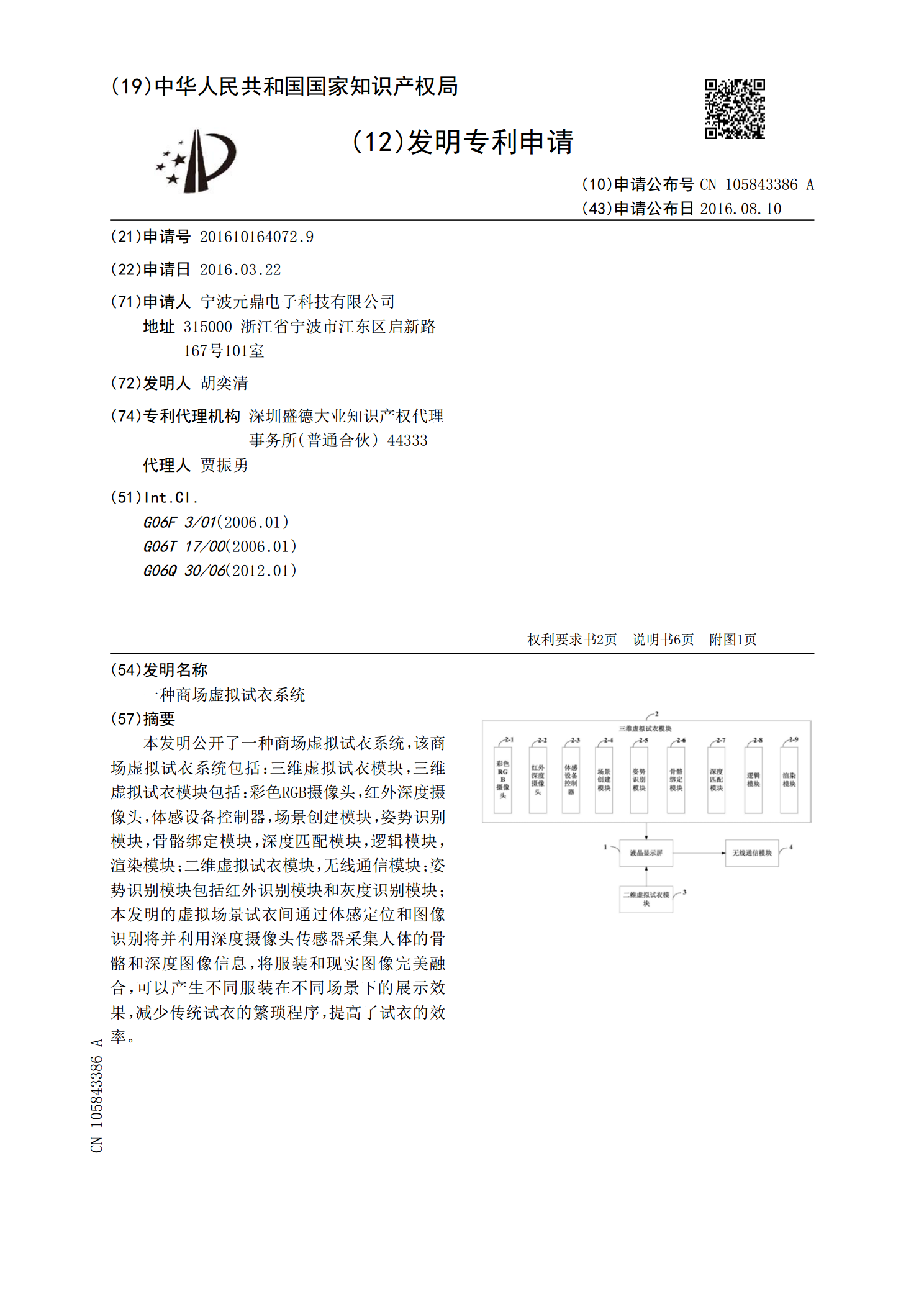

本发明公开了一种商场虚拟试衣系统,该商场虚拟试衣系统包括:三维虚拟试衣模块,三维虚拟试衣模块包括:彩色RGB摄像头,红外深度摄像头,体感设备控制器,场景创建模块,姿势识别模块,骨骼绑定模块,深度匹配模块,逻辑模块,渲染模块;二维虚拟试衣模块,无线通信模块;姿势识别模块包括红外识别模块和灰度识别模块;本发明的虚拟场景试衣间通过体感定位和图像识别将并利用深度摄像头传感器采集人体的骨骼和深度图像信息,将服装和现实图像完美融合,可以产生不同服装在不同场景下的展示效果,减少传统试衣的繁琐程序,提高了试衣的效率。