基于YOLACT实例分割模型的动态场景SLAM方法.pdf

Jo****63

亲,该文档总共11页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于YOLACT实例分割模型的动态场景SLAM方法.pdf

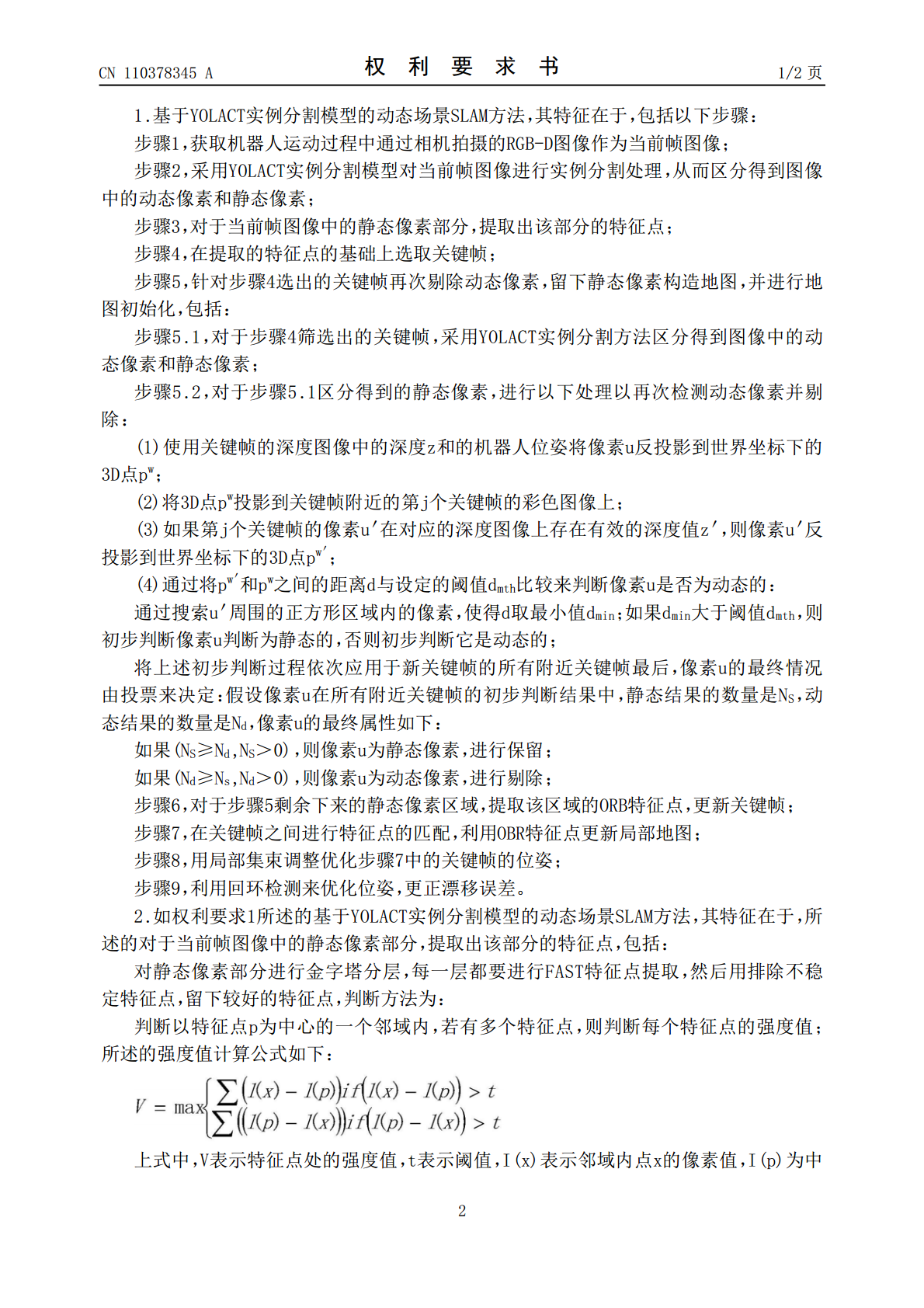

本发明公开了一种基于YOLACT实例分割模型的动态场景SLAM方法,首先采用YOLACT实例分割模型对当前帧图像进行实例分割处理,从而区分得到图像中的动态像素和静态像素;对于当前帧图像中的静态像素部分,提取出该部分的特征点;在提取的特征点的基础上选取关键帧;针对选出的关键帧再次剔除动态像素,留下静态像素构造地图,并进行地图初始化;对于剩余下来的静态像素区域,提取该区域的ORB特征点,更新关键帧;在关键帧之间进行特征点的匹配,利用OBR特征点更新局部地图;用局部集束调整优化关键帧的位姿;利用回环检测来优化位

基于语义分割网络的动态场景视觉SLAM算法.docx

基于语义分割网络的动态场景视觉SLAM算法标题:基于语义分割网络的动态场景视觉SLAM算法摘要:随着机器人技术的发展,动态场景下的视觉SLAM算法变得越来越重要。视觉SLAM技术在无人驾驶、增强现实等领域具有广泛应用。然而,传统的视觉SLAM算法在处理动态场景时面临诸多困难,例如遮挡、运动模糊等。本文提出了一种基于语义分割网络的动态场景视觉SLAM算法,通过结合语义信息和图像序列的视觉信息,可以在动态场景下实现更稳定的定位和地图建立。1.引言视觉SLAM是一种同时实现定位与地图构建的技术,可以帮助机器人在

基于精细化实例分割的动态语义SLAM的方法研究的开题报告.docx

基于精细化实例分割的动态语义SLAM的方法研究的开题报告一、研究背景在机器人领域中,SLAM是一种广泛应用的技术,在实用机器人中具有重要意义。传统的SLAM使用传感器获得丰富的信息,并进行精确估计,在地图构建和自主导航中发挥着至关重要的作用。然而,传统的SLAM通常存在一些问题,如机器人在高速运动时的性能下降,建立的地图不够精细,对于不同的场景和环境在精度上有所差异等。因此,为了进一步提高SLAM的精度和鲁棒性,需要采用更高级别的技术。与此同时,实例分割是一种有效的图像处理技术,可以将图像中不同物体的特征

一种基于实例分割的语义SLAM方法.pdf

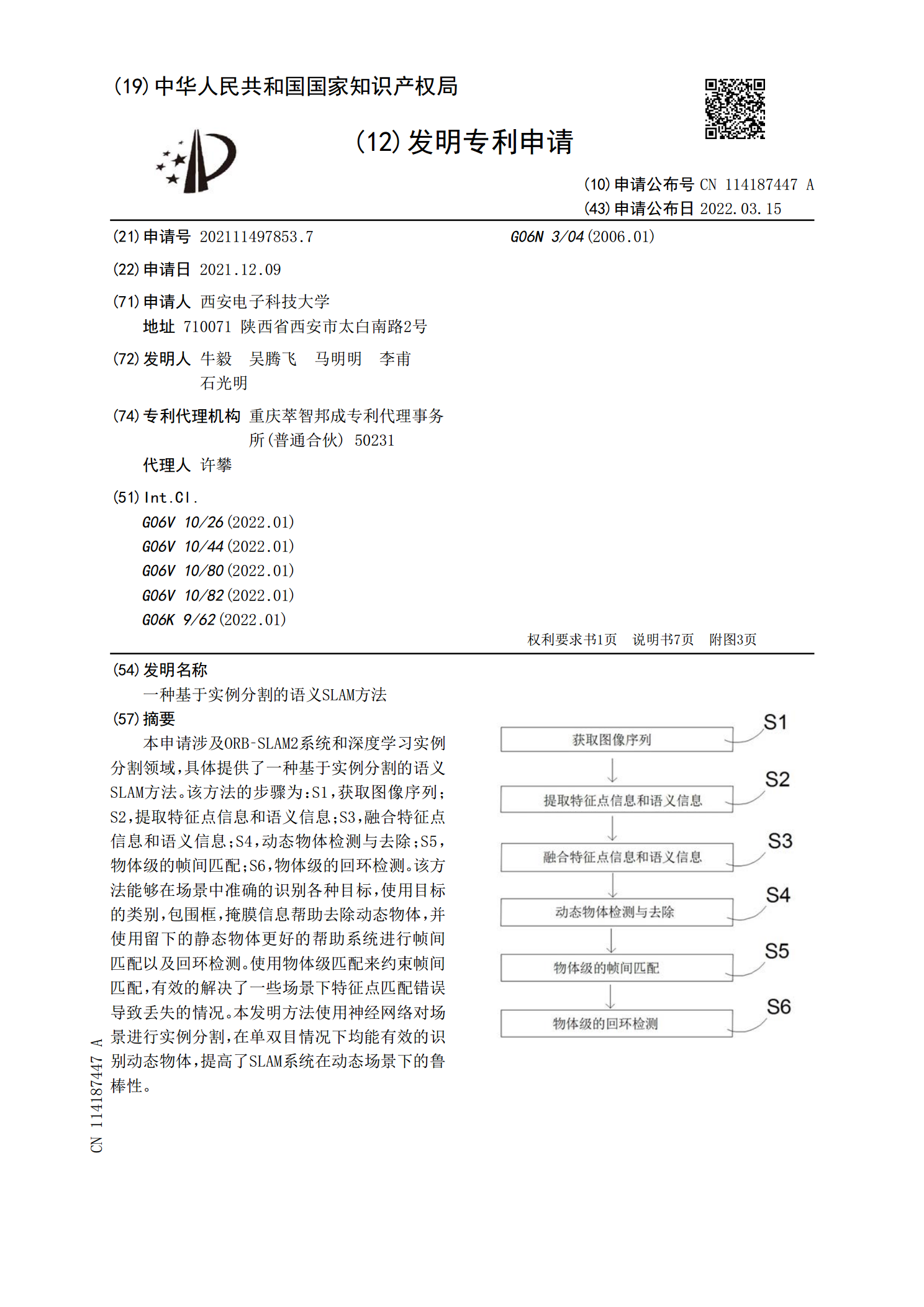

本申请涉及ORB‑SLAM2系统和深度学习实例分割领域,具体提供了一种基于实例分割的语义SLAM方法。该方法的步骤为:S1,获取图像序列;S2,提取特征点信息和语义信息;S3,融合特征点信息和语义信息;S4,动态物体检测与去除;S5,物体级的帧间匹配;S6,物体级的回环检测。该方法能够在场景中准确的识别各种目标,使用目标的类别,包围框,掩膜信息帮助去除动态物体,并使用留下的静态物体更好的帮助系统进行帧间匹配以及回环检测。使用物体级匹配来约束帧间匹配,有效的解决了一些场景下特征点匹配错误导致丢失的情况。本发

基于实例分割的视觉SLAM算法.pptx

基于实例分割的视觉SLAM算法目录添加章节标题视觉SLAM算法概述视觉SLAM的定义视觉SLAM的应用场景实例分割在视觉SLAM中的重要性基于实例分割的视觉SLAM算法原理实例分割的基本概念算法流程及实现方式关键技术细节解析算法优势与局限性算法优势分析算法局限性分析未来改进方向探讨实验结果及分析实验设置及数据集介绍实验结果展示结果分析及其对实际应用的影响实际应用案例机器人导航领域应用增强现实领域应用其他相关领域应用案例分析总结与展望基于实例分割的视觉SLAM算法总结未来研究方向与展望THANKYOU