一种基于特征增强和IoU感知的目标检测方法.pdf

书錦****by

亲,该文档总共13页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于特征增强和IoU感知的目标检测方法.pdf

本发明涉及一种基于特征增强和IoU感知的目标检测方法,属于计算机视觉目标检测领域。本方法利用RoI分类回归网络中卷积特征图的空间信息提高目标分类和定位的精度,利用注意力机制抑制RoI特征中的背景信息和增强RoI特征中的语义信息,利用IoU重打分策略增加类别得分和边界框置信度之间的相关性,保留高质量的边界框。本方法通过RoI分类回归分支网络,能有效利用特征图中的空间信息,有效提高了目标检测模型的分类和定位能力;通过边界框级别的语义分割分支网络和注意力机制,增强了RoI分类回归分支网络中的特征;通过IoU预测

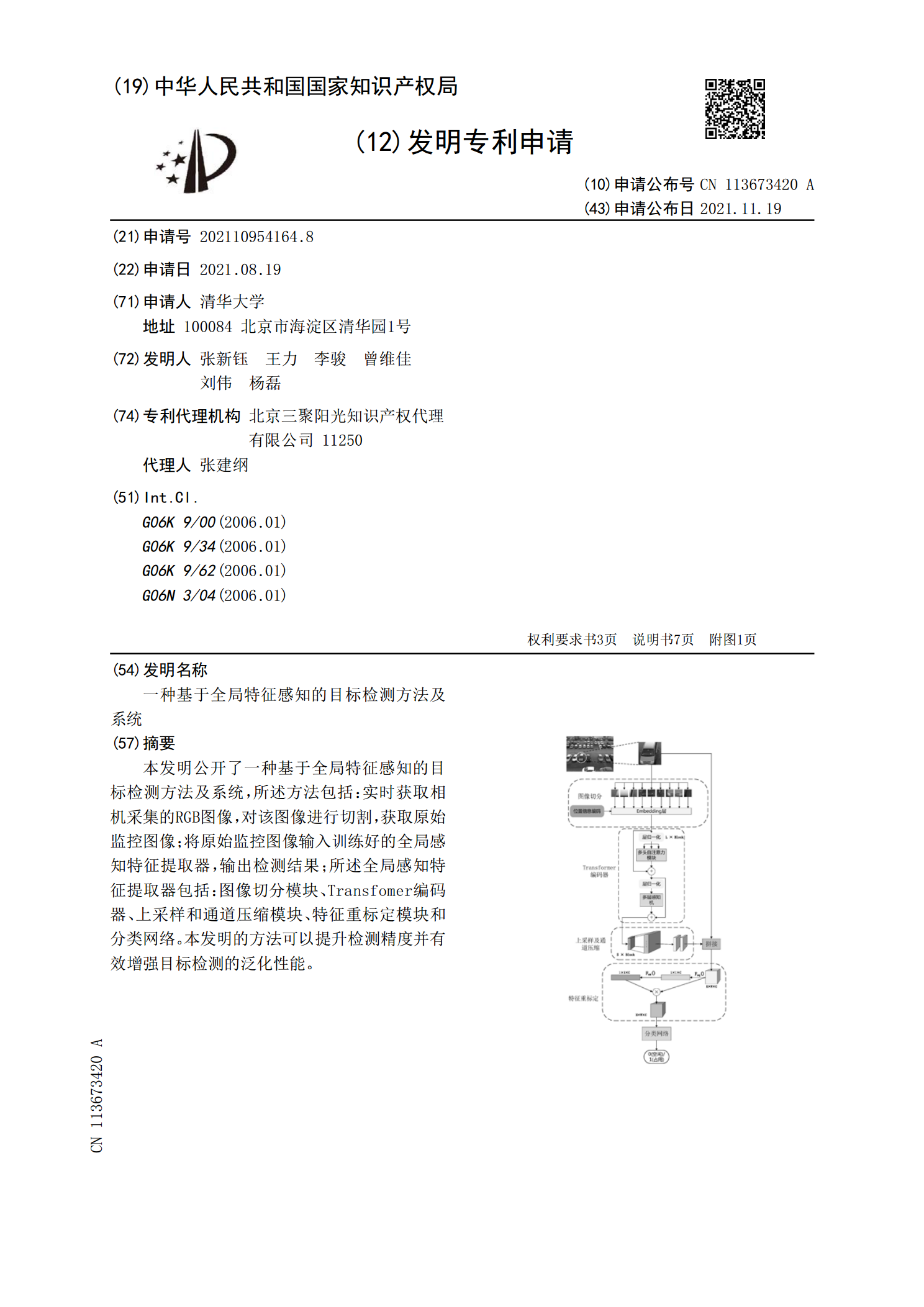

一种基于全局特征感知的目标检测方法及系统.pdf

本发明公开了一种基于全局特征感知的目标检测方法及系统,所述方法包括:实时获取相机采集的RGB图像,对该图像进行切割,获取原始监控图像;将原始监控图像输入训练好的全局感知特征提取器,输出检测结果;所述全局感知特征提取器包括:图像切分模块、Transfomer编码器、上采样和通道压缩模块、特征重标定模块和分类网络。本发明的方法可以提升检测精度并有效增强目标检测的泛化性能。

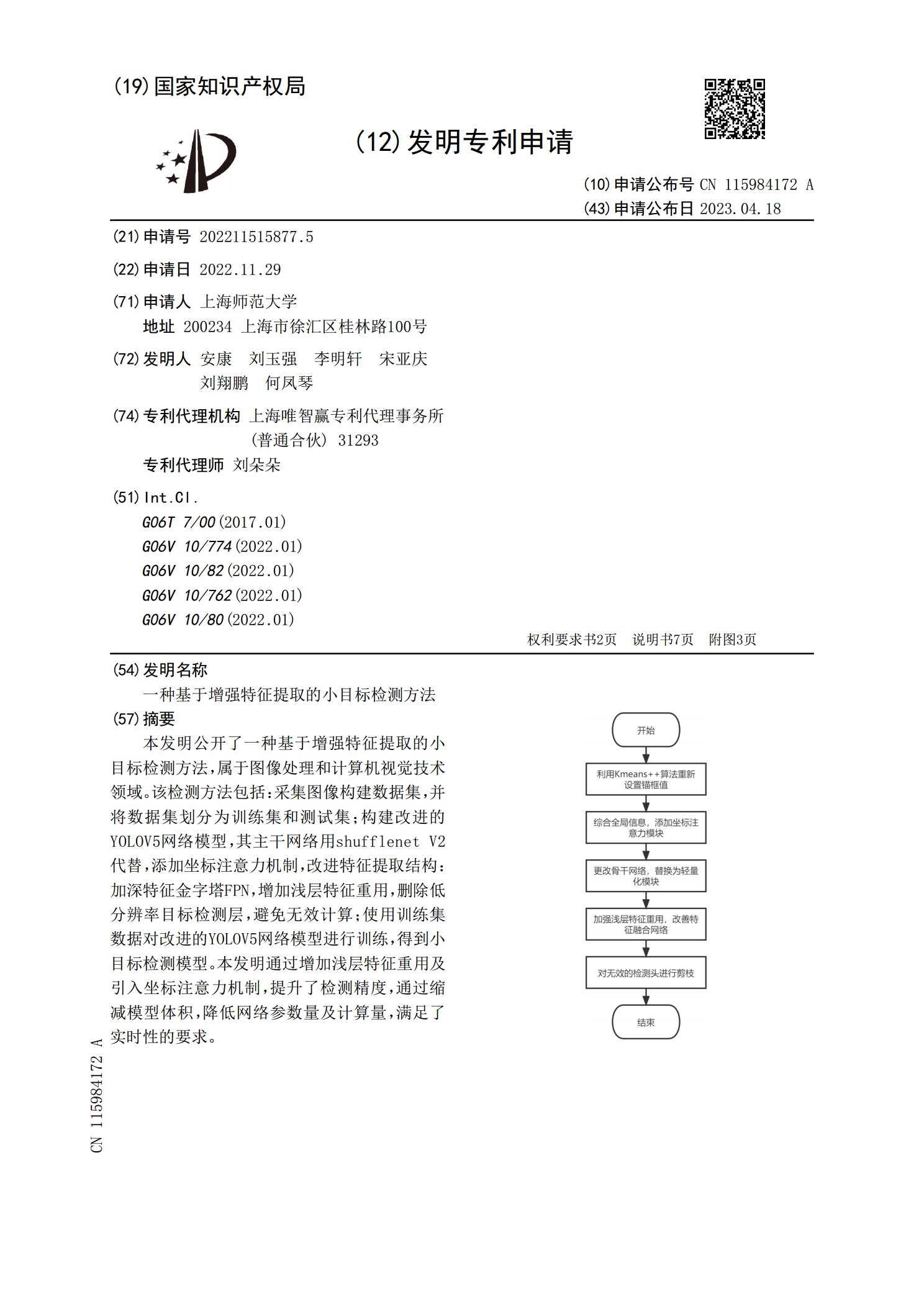

一种基于增强特征提取的小目标检测方法.pdf

本发明公开了一种基于增强特征提取的小目标检测方法,属于图像处理和计算机视觉技术领域。该检测方法包括:采集图像构建数据集,并将数据集划分为训练集和测试集;构建改进的YOLOV5网络模型,其主干网络用shufflenetV2代替,添加坐标注意力机制,改进特征提取结构:加深特征金字塔FPN,增加浅层特征重用,删除低分辨率目标检测层,避免无效计算;使用训练集数据对改进的YOLOV5网络模型进行训练,得到小目标检测模型。本发明通过增加浅层特征重用及引入坐标注意力机制,提升了检测精度,通过缩减模型体积,降低网络参数

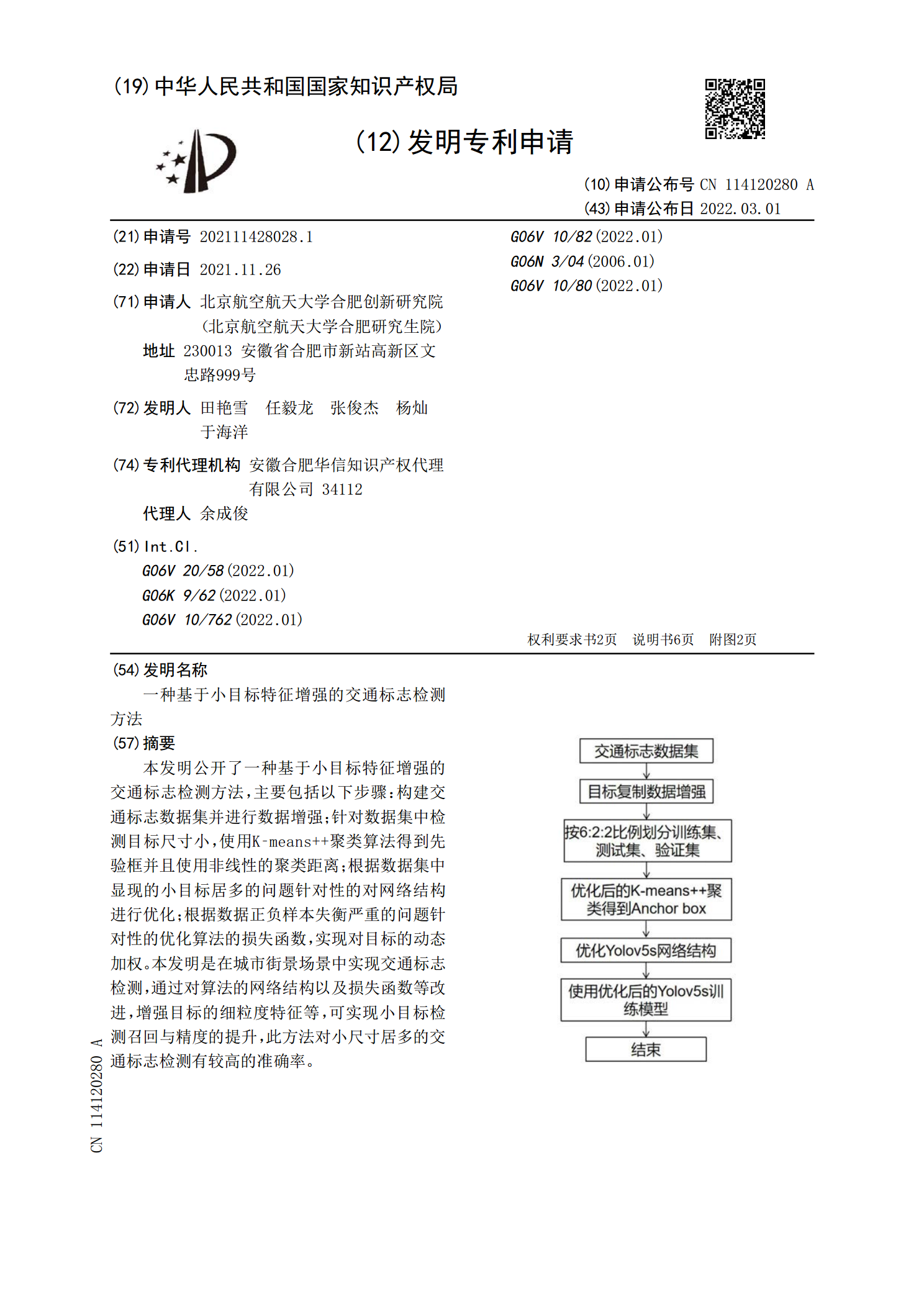

一种基于小目标特征增强的交通标志检测方法.pdf

本发明公开了一种基于小目标特征增强的交通标志检测方法,主要包括以下步骤:构建交通标志数据集并进行数据增强;针对数据集中检测目标尺寸小,使用K‑means++聚类算法得到先验框并且使用非线性的聚类距离;根据数据集中显现的小目标居多的问题针对性的对网络结构进行优化;根据数据正负样本失衡严重的问题针对性的优化算法的损失函数,实现对目标的动态加权。本发明是在城市街景场景中实现交通标志检测,通过对算法的网络结构以及损失函数等改进,增强目标的细粒度特征等,可实现小目标检测召回与精度的提升,此方法对小尺寸居多的交通标志

一种基于密集连接与特征增强的遥感图像目标检测方法.pdf

本发明涉及一种基于密集连接与特征增强的遥感图像目标检测方法,包括以下步骤:建立遥感图像数据集,将遥感图像数据集输入到遥感图像检测模型进行训练,将待检测的遥感图像输入到训练好的遥感图像检测模型中获取目标检测结果,所述的遥感图像检测模型包括特征提取单元、特征增强单元和特征金字塔单元和预测器,所述的遥感图像检测模型的输入图像依次经过特征提取单元、特征增强单元和特征金字塔单元和预测器处理,获取目标检测结果。与现有技术相比,本发明提升网络的特征提取能力,增大输入图像的分辨率,在减小参数的同时保留了低纬度的特征信息,