一种多特征融合的表情识别方法.pdf

一吃****永贺

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种多特征融合的表情识别方法.pdf

本发明提出一种基于自我修正与融合多尺度特征改进VGGNet的表情识别方法。该方法首先在VGGNet16网络前端新增一个多尺度特征提取网络结构,并将不同深度网络提取的多种特征进行支路特征融合,保留更完善的特征信息;然后通过在每个卷积层之后使用批量标准化,并在全连接层之后使用Dropout,以此加快网络模型收敛速率,降低网络模型发生梯度消失与过拟合的概率;最后在网络的后端加入自我修正网络,抑制样本的标注不确定性为网络模型训练带来的影响。该方法可在标注不确定数据集上以更高的精度识别出七种基本的表情。

一种多特征融合驾驶员异常表情识别方法.pdf

本发明公开了一种多特征融合驾驶员异常表情识别方法,该方法包括:S1、通过安装在驾驶员侧的摄像头对驾驶员的表情动作进行实时跟踪监测;S2、对实时驾驶员视频中的表情细节进行精确识别;S3、检测眼睛位置,判断其是否疲劳;S4、定位嘴部边缘轮廓,判断其是否出现哈欠动作;S5、检测头部动作,判断是否出现疲劳;S6、对眼睛状态、嘴部状态、头部运动状态的检测结果进行加权,最终判断其是否出现疲劳,并进行输出;S7、结合当前帧的识别结果作为后续帧的识别的预估位置,分别检测后续帧中的动作,实现对驾驶员异常行为的连续检测识别。

一种基于注意力和多尺度特征融合的表情识别方法.pdf

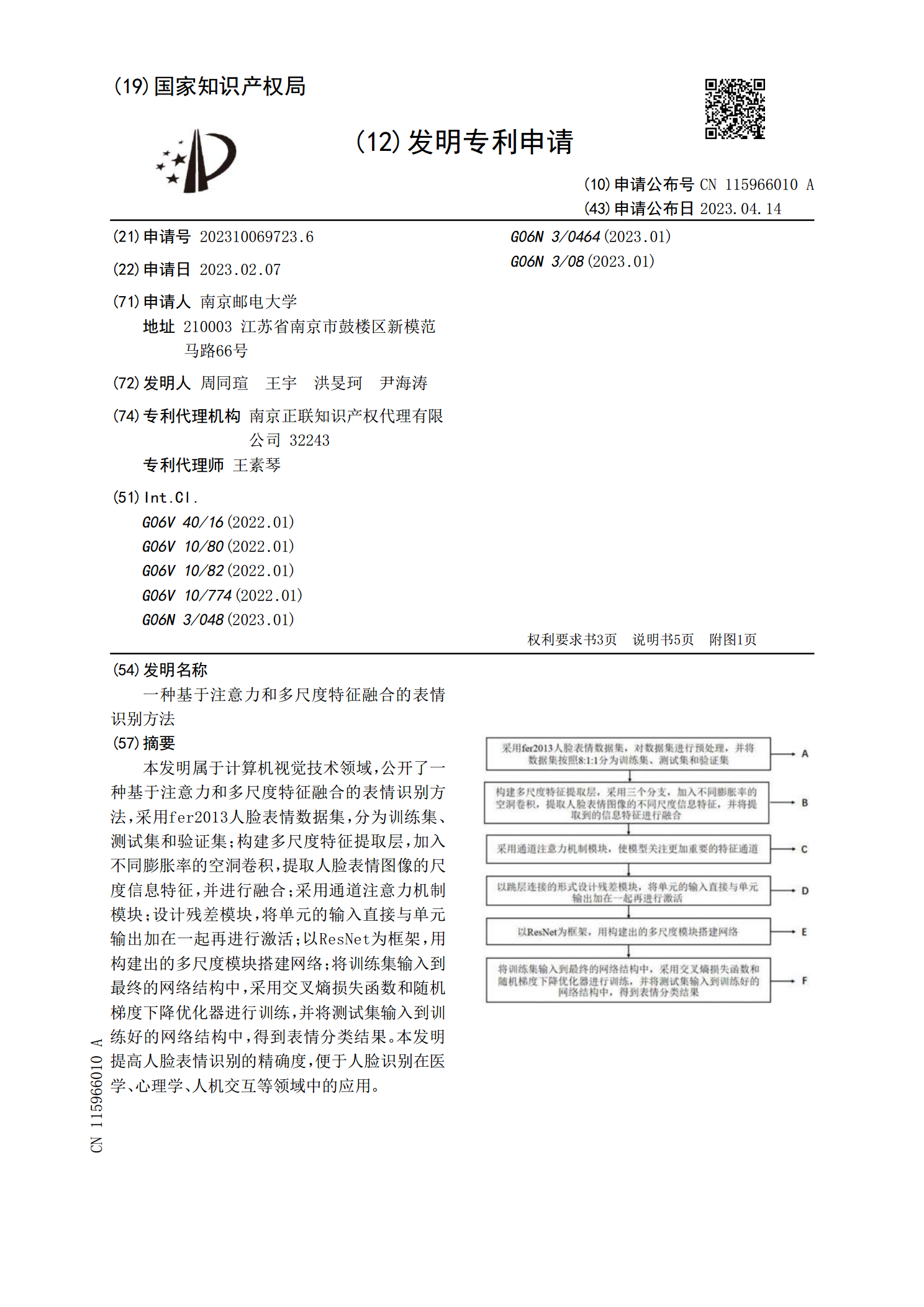

本发明属于计算机视觉技术领域,公开了一种基于注意力和多尺度特征融合的表情识别方法,采用fer2013人脸表情数据集,分为训练集、测试集和验证集;构建多尺度特征提取层,加入不同膨胀率的空洞卷积,提取人脸表情图像的尺度信息特征,并进行融合;采用通道注意力机制模块;设计残差模块,将单元的输入直接与单元输出加在一起再进行激活;以ResNet为框架,用构建出的多尺度模块搭建网络;将训练集输入到最终的网络结构中,采用交叉熵损失函数和随机梯度下降优化器进行训练,并将测试集输入到训练好的网络结构中,得到表情分类结果。本发

一种基于面部纹理特征融合的人脸表情识别方法.docx

一种基于面部纹理特征融合的人脸表情识别方法高婷婷李航殷守林摘要:针对人脸表情识别领域受噪声和遮挡等因素影响识别率不高的问题,结合局部和全局特征,提出一种基于面部表情的情感分析混合方法。首先,通过将梯度直方图(HOG)与复合局部三元模式(C-LTP)融合来进行特征提取;其次,将HOG和C-LTP提取的特征融合到单个特征向量中;最后,采用多类支持向量机分类器把特征向量进行情感分类;最后,将提出的方法在3个公共表情图像数据库中与现有的表情识别方法进行对比实验。结果表明,提出的方法在MMI,JAFFE,CK+数据

一种多尺度特征融合的行为识别方法.pdf

本发明公开了一种多尺度特征融合的行为识别方法,具体包括如下步骤:步骤1,数据预处理;步骤2,构建外观特征提取模块;步骤3,构建运动趋势特征提取模块;步骤4,构建特征融合模块。采用本发明,通过实验结果表明,与主流方法相比,本方法鲁棒性更好,适应性更强,效果更好,丰富了人工智能和计算机视觉的方法体系,支撑了行为识别领域的发展,为行为识别的低成本识别技术提供了一种选择。