基于极限学习机(ELM)的视线落点估计方法.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于极限学习机(ELM)的视线落点估计方法.docx

基于极限学习机(ELM)的视线落点估计方法基于极限学习机(ExtremeLearningMachine,ELM)的视线落点估计方法摘要:视线落点估计是一项重要的人机交互技术,可以用于眼球跟踪、手势控制、注意力识别等应用。本文提出了一种基于极限学习机(ELM)的视线落点估计方法,该方法具有高效、快速训练和准确、稳定的预测能力。通过对眼动数据进行特征提取和ELM训练,我们可以实现视线落点的准确估计。实验证明,本文所提出的方法在高效性和准确性上达到了较好的效果。关键词:视线落点估计;极限学习机;特征提取;预测能

ELM极限学习机相关.docx

简单易学的机器学习算法——极限学习机(ELM)一、极限学习机的概念极限学习机(ExtremeLearningMachine)ELM,是由黄广斌提出来的求解单隐层神经网络的算法。ELM最大的特点是对于传统的神经网络,尤其是单隐层前馈神经网络(SLFNs),在保证学习精度的前提下比传统的学习算法速度更快。二、极限学习机的原理ELM是一种新型的快速学习算法,对于单隐层神经网络,ELM可以随机初始化输入权重和偏置并得到相应的输出权重。(选自黄广斌老师的PPT)对于一个单隐层神经网络(见Figure1),假设有个任

基于改进极限学习机ELM的光伏发电预测方法研究.docx

基于改进极限学习机ELM的光伏发电预测方法研究摘要随着光伏发电的普及和应用,预测光伏发电量的准确性越来越受到关注。本文涉及的研究将改进极限学习机(ELM)应用于光伏发电预测中,通过利用时间序列数据进行训练,建立一个能够准确预测光伏发电量的模型。通过实验,结果表明,改进的ELM模型可以有效地提高光伏发电的预测准确性。关键词:光伏发电预测;ELM模型;时间序列;预测准确性AbstractWiththepopularizationandapplicationofphotovoltaicpowergenerati

极限学习机(ELM)网络结构调整方法综述.docx

极限学习机(ELM)网络结构调整方法综述极限学习机(ExtremeLearningMachine,ELM)是一种基于单层前馈神经网络的机器学习方法,它通过随机初始化输入层和隐藏层之间的连接权重,来加速训练过程并提高网络的泛化能力。在ELM中,隐藏层的神经元使用非线性激活函数来模拟复杂的非线性关系。随着ELM的逐渐发展,研究者们提出了许多方法来改进和优化ELM的网络结构,以进一步提高其性能和应用范围。本文将对这些方法进行综述和分析。一种常见的方法是调整ELM的隐藏层神经元数量。隐藏层神经元的数量对ELM的性

视线落点确定方法和装置.pdf

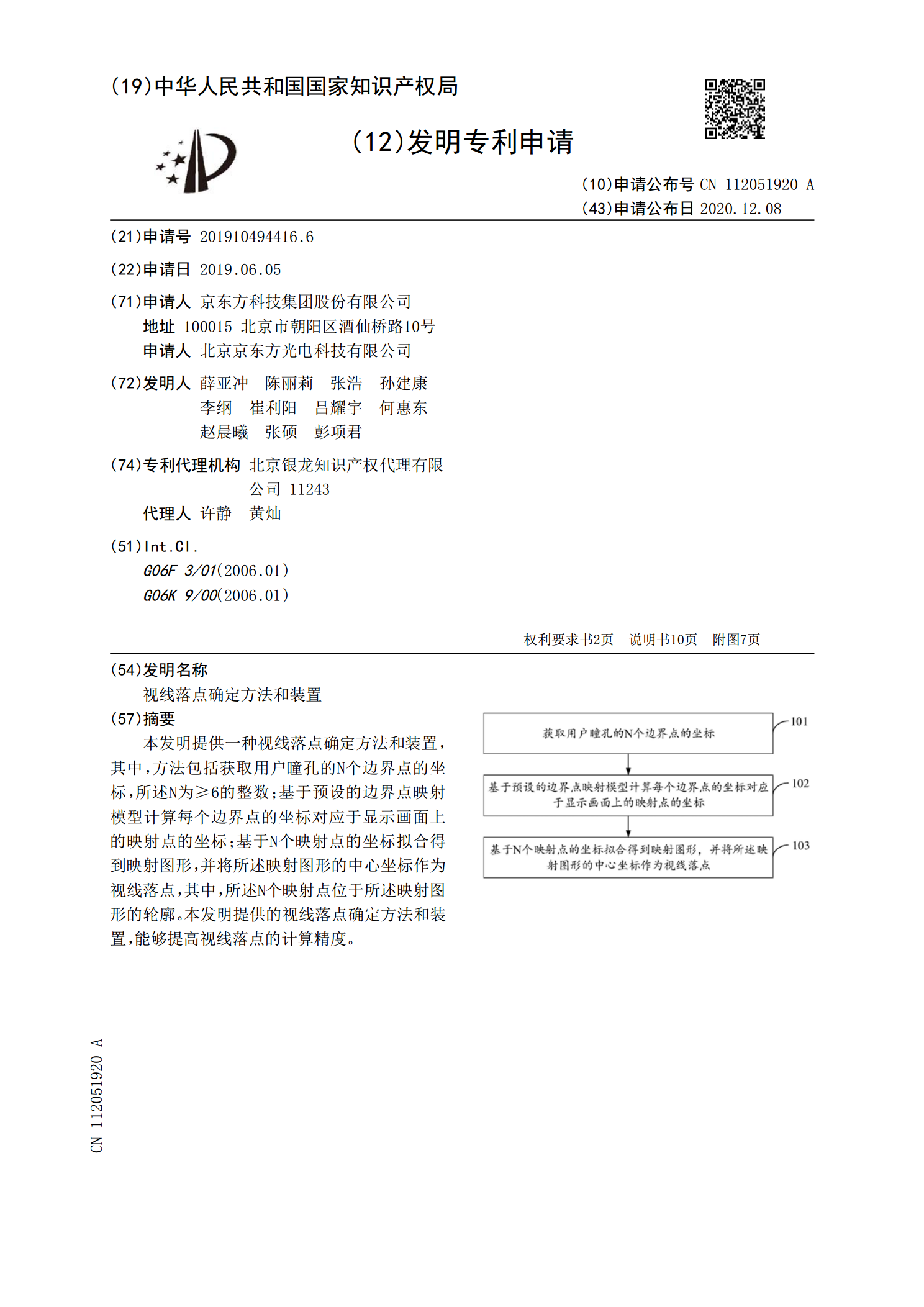

本发明提供一种视线落点确定方法和装置,其中,方法包括获取用户瞳孔的N个边界点的坐标,所述N为≥6的整数;基于预设的边界点映射模型计算每个边界点的坐标对应于显示画面上的映射点的坐标;基于N个映射点的坐标拟合得到映射图形,并将所述映射图形的中心坐标作为视线落点,其中,所述N个映射点位于所述映射图形的轮廓。本发明提供的视线落点确定方法和装置,能够提高视线落点的计算精度。