基于多尺度卷积特征融合的行人重识别.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于多尺度卷积特征融合的行人重识别.docx

基于多尺度卷积特征融合的行人重识别摘要:行人重识别是一个具有挑战性的问题,因为它涉及到许多问题,如目标尺度变化,姿势变化,遮挡和光照变化。这篇论文提出了一种基于多尺度卷积特征融合的行人重识别方法。我们首先通过特征提取网络提取全局和局部特征,然后使用多尺度卷积处理这些特征以增强特征表示能力,最后使用特征融合模型将多个特征合并并进行分类。实验结果表明,我们的方法相对于最新的行人重识别方法,具有更好的准确性和鲁棒性。关键词:行人重识别,多尺度卷积,特征提取,特征融合引言:随着计算机视觉技术的不断发展,行人重识别

基于动态卷积与注意力的多特征融合行人重识别.docx

基于动态卷积与注意力的多特征融合行人重识别标题:基于动态卷积与注意力的多特征融合行人重识别摘要:行人重识别是计算机视觉领域中的一个重要问题,其目标是从不同监控摄像头中准确地识别出同一个行人。本论文提出了一种基于动态卷积和注意力机制的多特征融合方法用于行人重识别任务。该方法通过动态卷积网络从行人图像中提取多尺度的特征图,并在特征图的每个位置上应用注意力机制,以强调重要特征。通过将不同尺度和注意力加权的特征进行融合,我们能够获得更具判别性和鲁棒性的特征表示。实验结果表明,所提出的方法在多个常用行人重识别数据集

一种基于多尺度特征融合的行人重识别方法.pdf

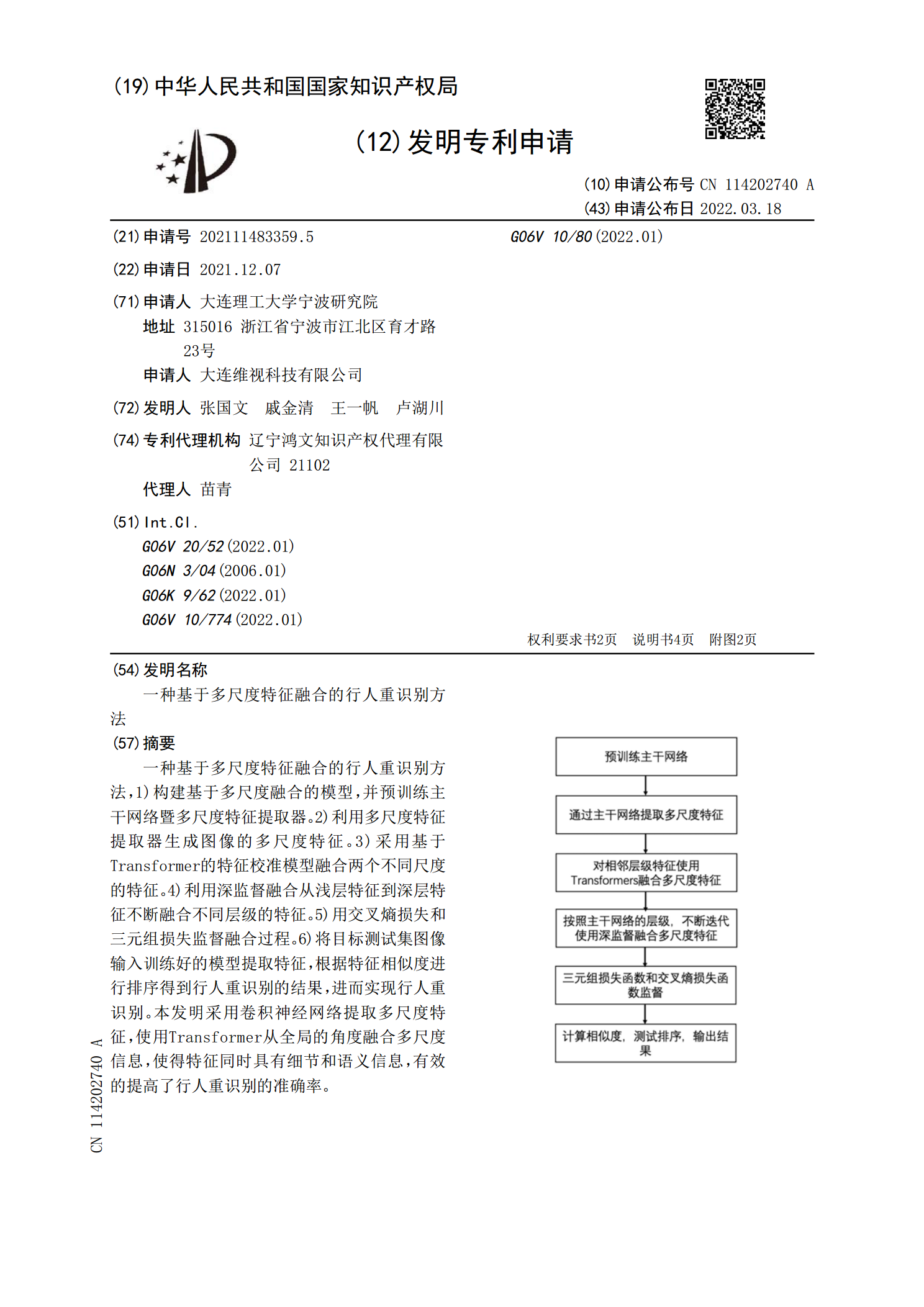

一种基于多尺度特征融合的行人重识别方法,1)构建基于多尺度融合的模型,并预训练主干网络暨多尺度特征提取器。2)利用多尺度特征提取器生成图像的多尺度特征。3)采用基于Transformer的特征校准模型融合两个不同尺度的特征。4)利用深监督融合从浅层特征到深层特征不断融合不同层级的特征。5)用交叉熵损失和三元组损失监督融合过程。6)将目标测试集图像输入训练好的模型提取特征,根据特征相似度进行排序得到行人重识别的结果,进而实现行人重识别。本发明采用卷积神经网络提取多尺度特征,使用Transformer从全局的

基于卷积特征及其多尺度融合的行人检测技术研究.docx

基于卷积特征及其多尺度融合的行人检测技术研究基于卷积特征及其多尺度融合的行人检测技术研究摘要:近年来,行人检测技术在计算机视觉领域中得到了广泛的关注和研究。以深度学习为代表的卷积神经网络在行人检测任务中取得了显著的成果。本文针对行人检测任务,提出了一种基于卷积特征及其多尺度融合的行人检测技术。首先,通过使用卷积神经网络提取图像特征,并结合预训练模型进行特征的迁移学习。然后,利用多尺度相关特征对图像进行多尺度检测,以提高行人检测的性能。实验证明,该方法在行人检测任务中相较于传统方法具有更高的准确率和检测速度

一种基于多尺度特征融合的视频行人重识别方法.pdf

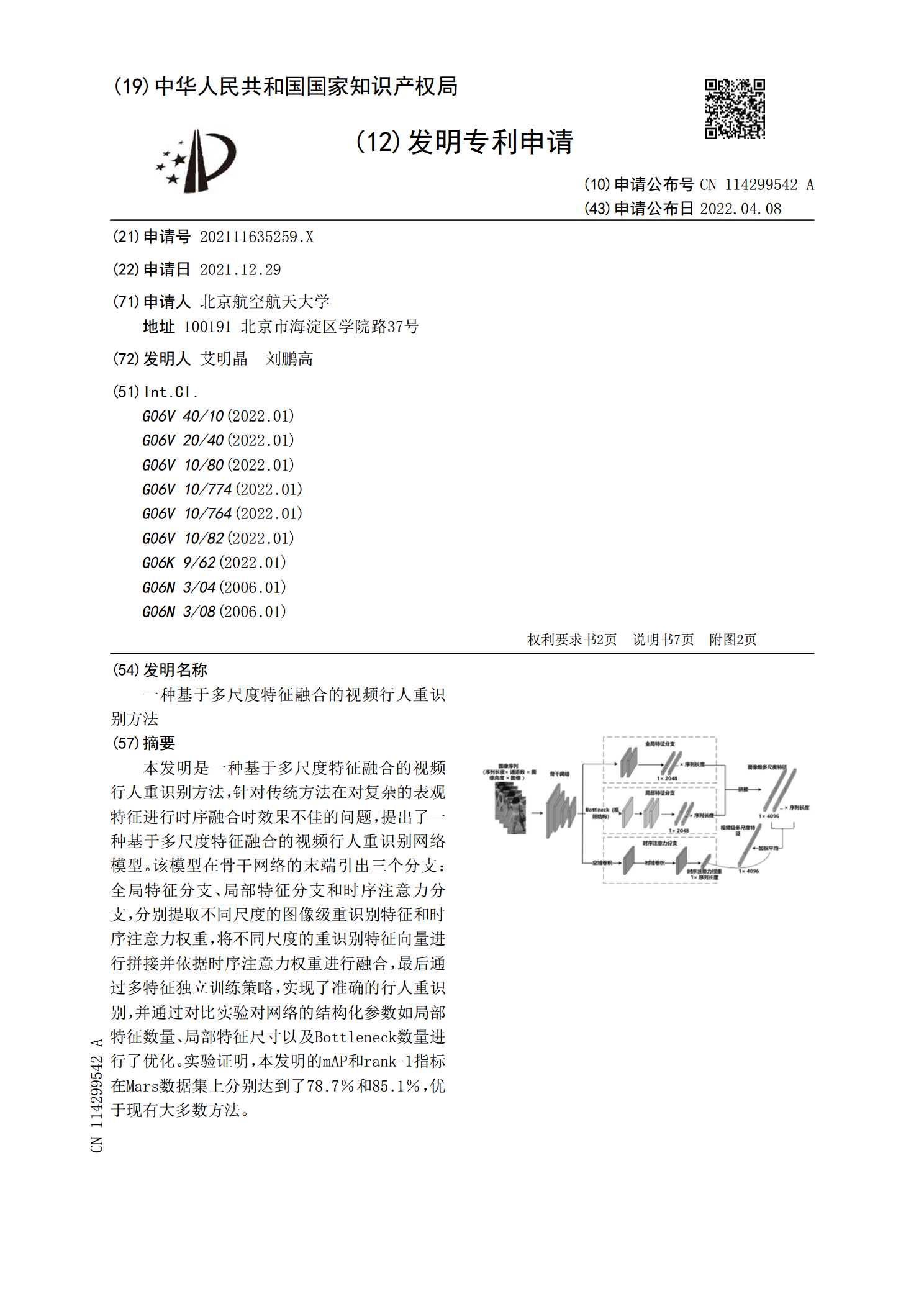

本发明是一种基于多尺度特征融合的视频行人重识别方法,针对传统方法在对复杂的表观特征进行时序融合时效果不佳的问题,提出了一种基于多尺度特征融合的视频行人重识别网络模型。该模型在骨干网络的末端引出三个分支:全局特征分支、局部特征分支和时序注意力分支,分别提取不同尺度的图像级重识别特征和时序注意力权重,将不同尺度的重识别特征向量进行拼接并依据时序注意力权重进行融合,最后通过多特征独立训练策略,实现了准确的行人重识别,并通过对比实验对网络的结构化参数如局部特征数量、局部特征尺寸以及Bottleneck数量进行了优