一种基于多尺度特征融合的视频行人重识别方法.pdf

梅雪****67

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于多尺度特征融合的视频行人重识别方法.pdf

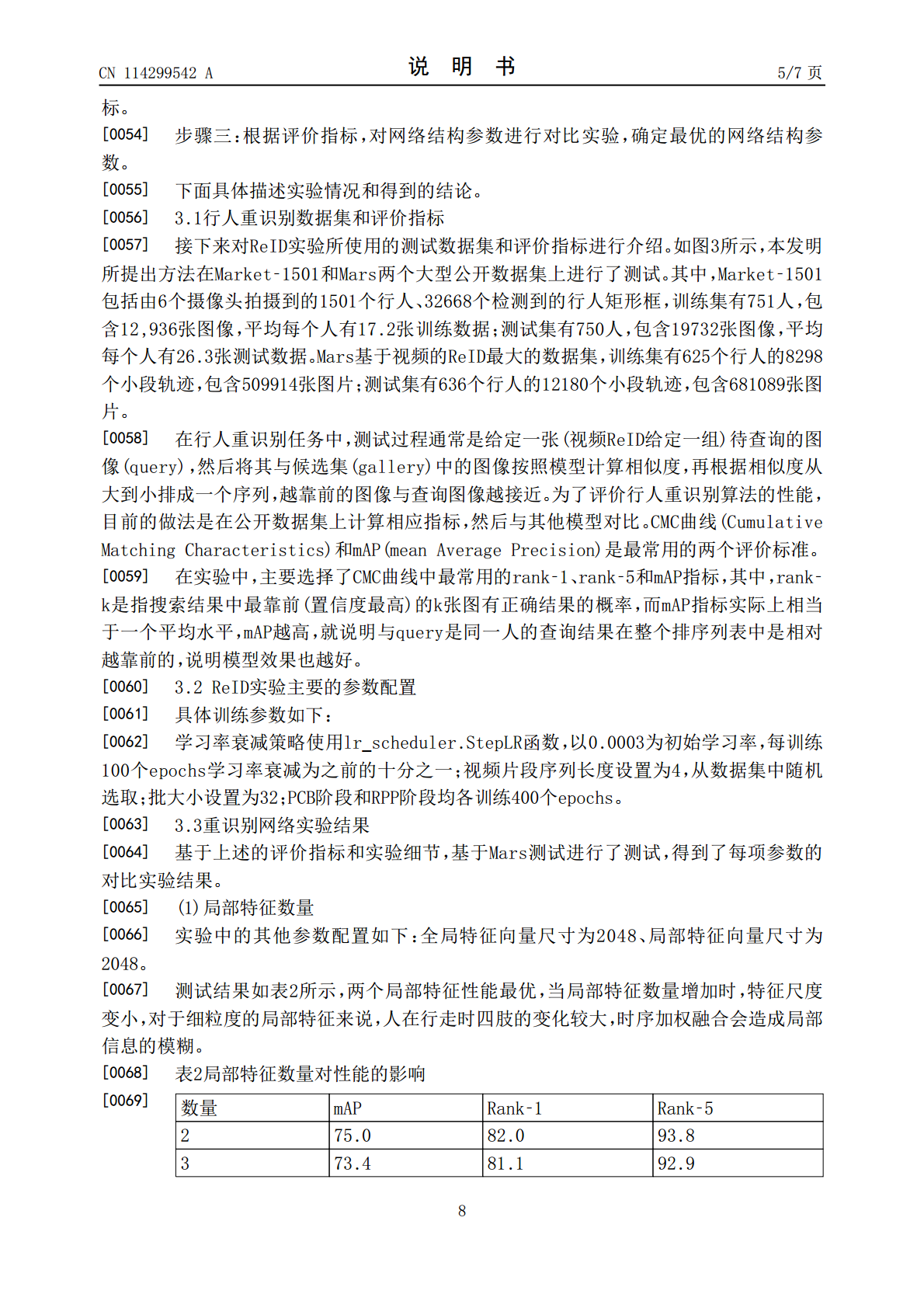

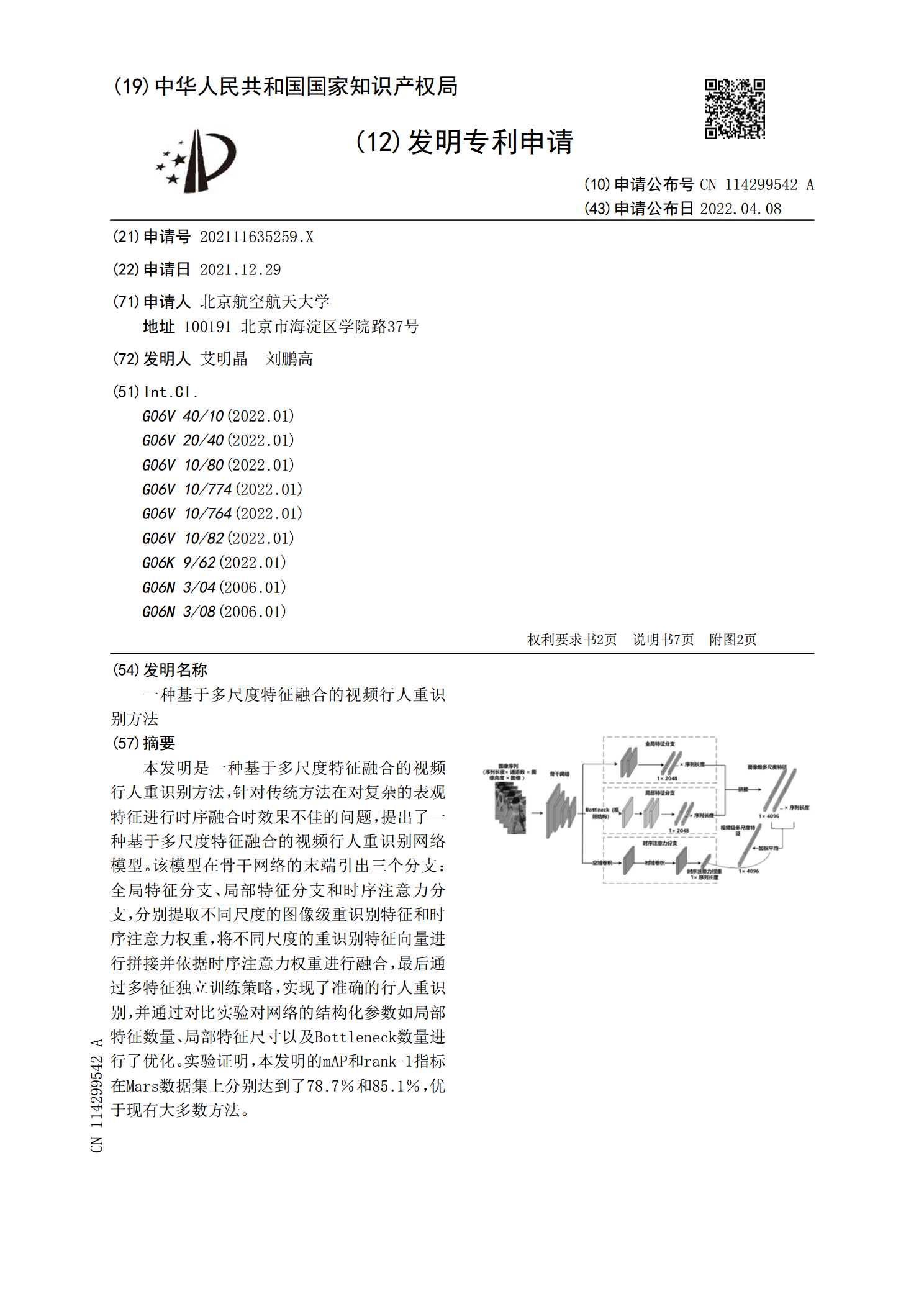

本发明是一种基于多尺度特征融合的视频行人重识别方法,针对传统方法在对复杂的表观特征进行时序融合时效果不佳的问题,提出了一种基于多尺度特征融合的视频行人重识别网络模型。该模型在骨干网络的末端引出三个分支:全局特征分支、局部特征分支和时序注意力分支,分别提取不同尺度的图像级重识别特征和时序注意力权重,将不同尺度的重识别特征向量进行拼接并依据时序注意力权重进行融合,最后通过多特征独立训练策略,实现了准确的行人重识别,并通过对比实验对网络的结构化参数如局部特征数量、局部特征尺寸以及Bottleneck数量进行了优

一种基于多尺度特征融合的行人重识别方法.pdf

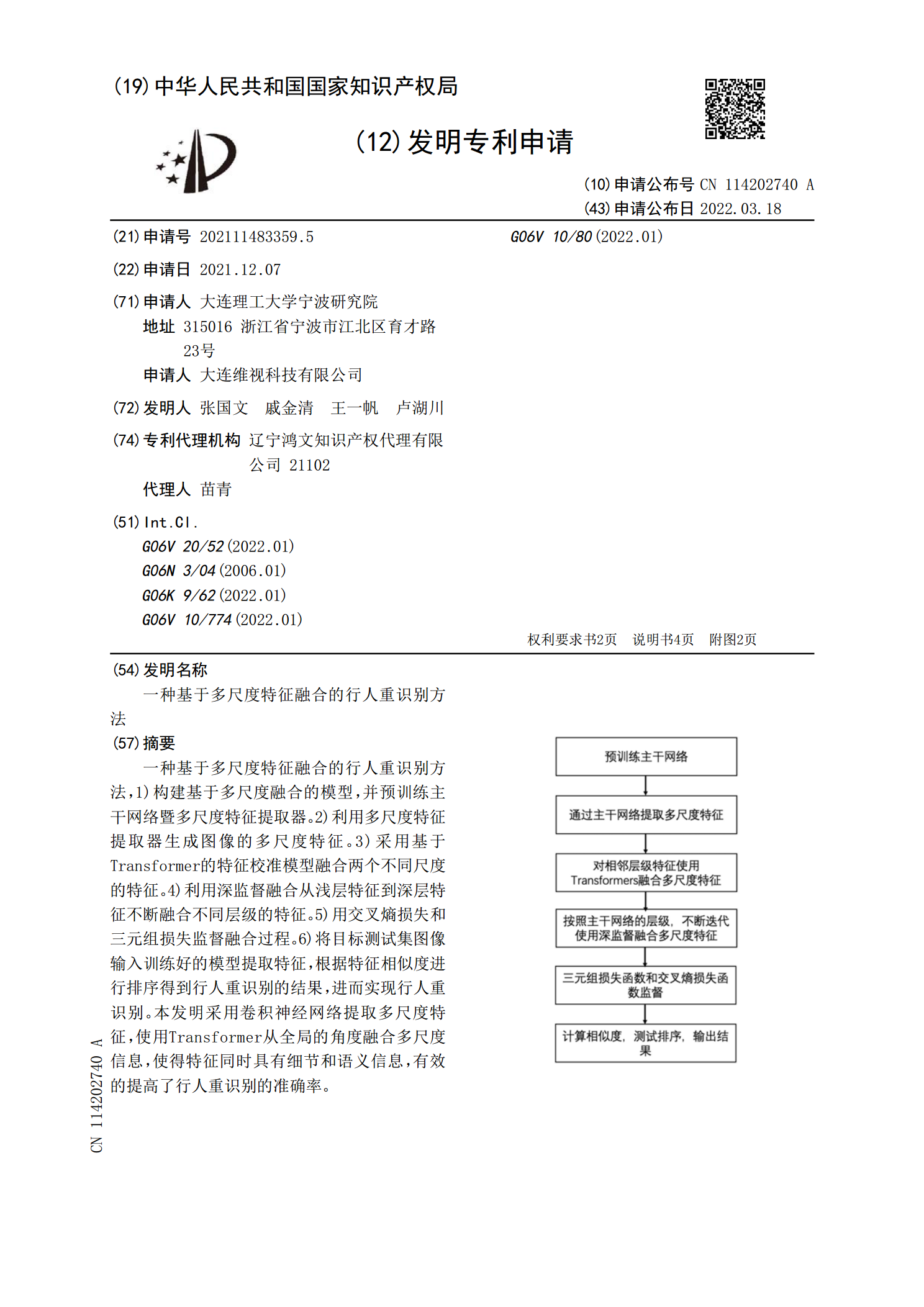

一种基于多尺度特征融合的行人重识别方法,1)构建基于多尺度融合的模型,并预训练主干网络暨多尺度特征提取器。2)利用多尺度特征提取器生成图像的多尺度特征。3)采用基于Transformer的特征校准模型融合两个不同尺度的特征。4)利用深监督融合从浅层特征到深层特征不断融合不同层级的特征。5)用交叉熵损失和三元组损失监督融合过程。6)将目标测试集图像输入训练好的模型提取特征,根据特征相似度进行排序得到行人重识别的结果,进而实现行人重识别。本发明采用卷积神经网络提取多尺度特征,使用Transformer从全局的

基于多尺度卷积特征融合的行人重识别.docx

基于多尺度卷积特征融合的行人重识别摘要:行人重识别是一个具有挑战性的问题,因为它涉及到许多问题,如目标尺度变化,姿势变化,遮挡和光照变化。这篇论文提出了一种基于多尺度卷积特征融合的行人重识别方法。我们首先通过特征提取网络提取全局和局部特征,然后使用多尺度卷积处理这些特征以增强特征表示能力,最后使用特征融合模型将多个特征合并并进行分类。实验结果表明,我们的方法相对于最新的行人重识别方法,具有更好的准确性和鲁棒性。关键词:行人重识别,多尺度卷积,特征提取,特征融合引言:随着计算机视觉技术的不断发展,行人重识别

基于特征融合的行人重识别方法.docx

基于特征融合的行人重识别方法基于特征融合的行人重识别方法随着摄像监控技术的不断发展,行人重识别技术在实际应用中变得越来越广泛。传统的行人重识别方法通常基于手工设计的特征,有效性受限。针对这个问题,近年来研究者们开始探索使用深度学习进行特征提取和融合,以提高行人重识别的准确性和鲁棒性。本文将介绍基于特征融合的行人重识别方法。1.基于深度学习的特征提取深度学习在人类视觉任务中取得了巨大成功。使用深度学习进行特征提取可以避免手工特征的限制,并在行人重识别领域中取得了显著的成果。目前,基于深度学习的行人重识别方法

一种多尺度批量特征丢弃网络的行人重识别方法.pdf

本发明公开了一种多尺度批量特征丢弃网络的行人重识别方法,涉及行人识别技术领域,具体包括如下步骤:S1、利用IBN‑Net50‑a为基础骨干网络提取特征;S2、对最后两层卷积层融合批量特征丢弃方法;S3、拼接不同维度的特征,能够包含更多浅层、深层的有用信息,IBN包括IN和BN,IN提取的鲁棒特征是不随一些外观变化而变化的,如颜色、风格、虚拟/真实,BN则是保留与内容相关的信息,本发明以IBN‑Net50‑a为骨干网的改进的网络模型,对最后两层卷积层融合批量特征丢弃方法,以增强局部区域的专注特征学习。采取多