一种基于LMBP神经网络的图像复原方法.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

一种基于LMBP神经网络的图像复原方法.docx

一种基于LMBP神经网络的图像复原方法标题:基于LMBP神经网络的图像复原方法摘要:本文提出了一种基于LMBP(Levenberg-Marquardt反向传播)神经网络的图像复原方法。该方法可以用于恢复受损或噪声干扰的图像。首先,介绍了图像复原的背景和意义,然后详细描述了LMBP神经网络的原理和算法。接着,提出了图像复原方法的框架,并详细说明了预处理、网络架构设计、训练和测试等关键步骤。最后,通过实验验证了该方法的有效性和优越性,并对未来研究方向进行了展望。关键词:LMBP神经网络、图像复原、损伤恢复、噪

基于MEA-BP神经网络的图像复原方法.docx

基于MEA-BP神经网络的图像复原方法论文题目:基于MEA-BP神经网络的图像复原方法摘要:随着数字图像处理技术的不断发展,图像复原方法得到了广泛的研究和应用。神经网络是一种非常有效的图像复原方法,它可以通过训练使神经网络学习到复原模型。本文提出一种基于MEA-BP神经网络的图像复原方法,该方法通过MEA(MinimumErrorAlgorithm)算法对BP(BackPropagation)神经网络进行优化,从而提高图像复原的精度和效率。实验结果表明,该方法在图像复原方面具有很高的性能和实用性。关键词:

一种基于卷积神经网络CNN的三片简单透镜图像复原方法.pdf

本发明公开一种基于卷积神经网络CNN的三片简单透镜图像复原方法。首先生成三片简单透镜对应的模糊图像与清晰图像数据集,然后构建用于端到端图像复原的卷积神经网络CNN模型,并利用生成的数据集训练CNN模型,对于新拍摄的模糊图像,可利用已训练好的CNN模型直接得到复原清晰图像。本发明可避免现有方法中盲卷积和非盲卷积图像复原的大量优化迭代过程,也无需单独估计简单透镜的PSF,使三片简单透镜的图像复原过程更加简单方便,而且图像处理速度快,在简单透镜计算成像领域具有重要意义。

基于卷积神经网络的图像复原方法研究的任务书.docx

基于卷积神经网络的图像复原方法研究的任务书一、背景随着数字图像处理技术的发展,图像复原成为了重要的研究领域之一。图像复原的目标是恢复被损坏的图像,使其恢复原来的清晰度和质量。这涉及到多种技术,包括降噪、去模糊、超分辨率等。近年来,基于卷积神经网络的图像复原方法得到了广泛关注,并在图像复原领域取得了很多成功的应用。二、任务本次任务的目标是针对卷积神经网络在图像复原领域中的应用进行研究,熟悉其原理、方法及应用。具体任务如下:1.综述卷积神经网络在图像复原领域的应用现状,包括常用算法、技术特点及最新研究成果等。

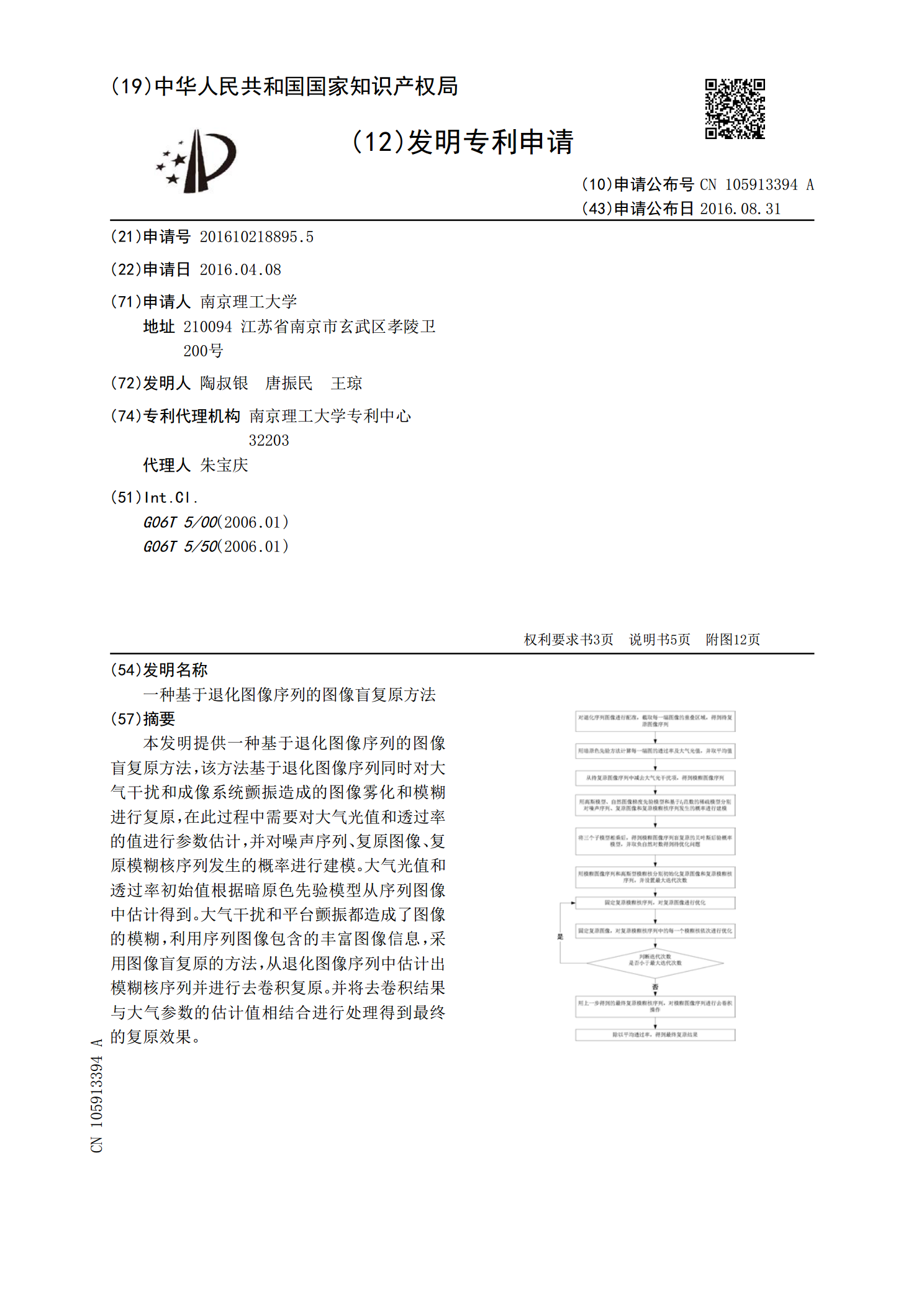

一种基于退化图像序列的图像盲复原方法.pdf

本发明提供一种基于退化图像序列的图像盲复原方法,该方法基于退化图像序列同时对大气干扰和成像系统颤振造成的图像雾化和模糊进行复原,在此过程中需要对大气光值和透过率的值进行参数估计,并对噪声序列、复原图像、复原模糊核序列发生的概率进行建模。大气光值和透过率初始值根据暗原色先验模型从序列图像中估计得到。大气干扰和平台颤振都造成了图像的模糊,利用序列图像包含的丰富图像信息,采用图像盲复原的方法,从退化图像序列中估计出模糊核序列并进行去卷积复原。并将去卷积结果与大气参数的估计值相结合进行处理得到最终的复原效果。