一种基于深层特征和浅层特征融合的目标检测方法.pdf

Th****s3

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于深层特征和浅层特征融合的目标检测方法.pdf

本发明提供了一种基于深层特征和浅层特征融合的目标检测方法。步骤如下:构建目标检测网络模型,获取数字图像,分为训练集和测试集;将图像增强过后的图片x首先输入到分类网络进行特征提取,然后再将特征提取的结果输入到特征融合网络进行特征融合,最后利用融合后的特征图对模型进行分类和回归得到预测值,使用预测值、标签y、预选框匹配结果和Loss函数计算得到误差进行反向传播,得到了保存模型参数的文件;对模型进行测试,首先计算冗余的预测值,最后通过NMS算法去除冗余的预测值,得到最终结果。经验证我们的方法在PascalVOC

一种基于光谱特征与空间特征融合的目标检测方法.pdf

一种基于光谱特征与空间特征融合的目标检测方法,包括:S1,对采集的图像进行数据预处理,生成卷积神经网络所需的特征图层数据;S2,构建特征提取网络,采用基于光谱特征与空间特征融合的卷积神经网络进行目标识别;构建跨模态特征融合模型(CFT模型),进行单个特征图层内和多个特征图层间的特征融合,实现基于被检测对象的光谱特征及空间特征融合的精准目标检测。本发明的方法通过同时融合被检测对象的光谱特征和空间特征,提高在被检测对象光谱特征或空间特征不稳定、特征部分缺失条件下的检测精度和可靠性。

一种基于目标检测的多尺度特征融合方法.pdf

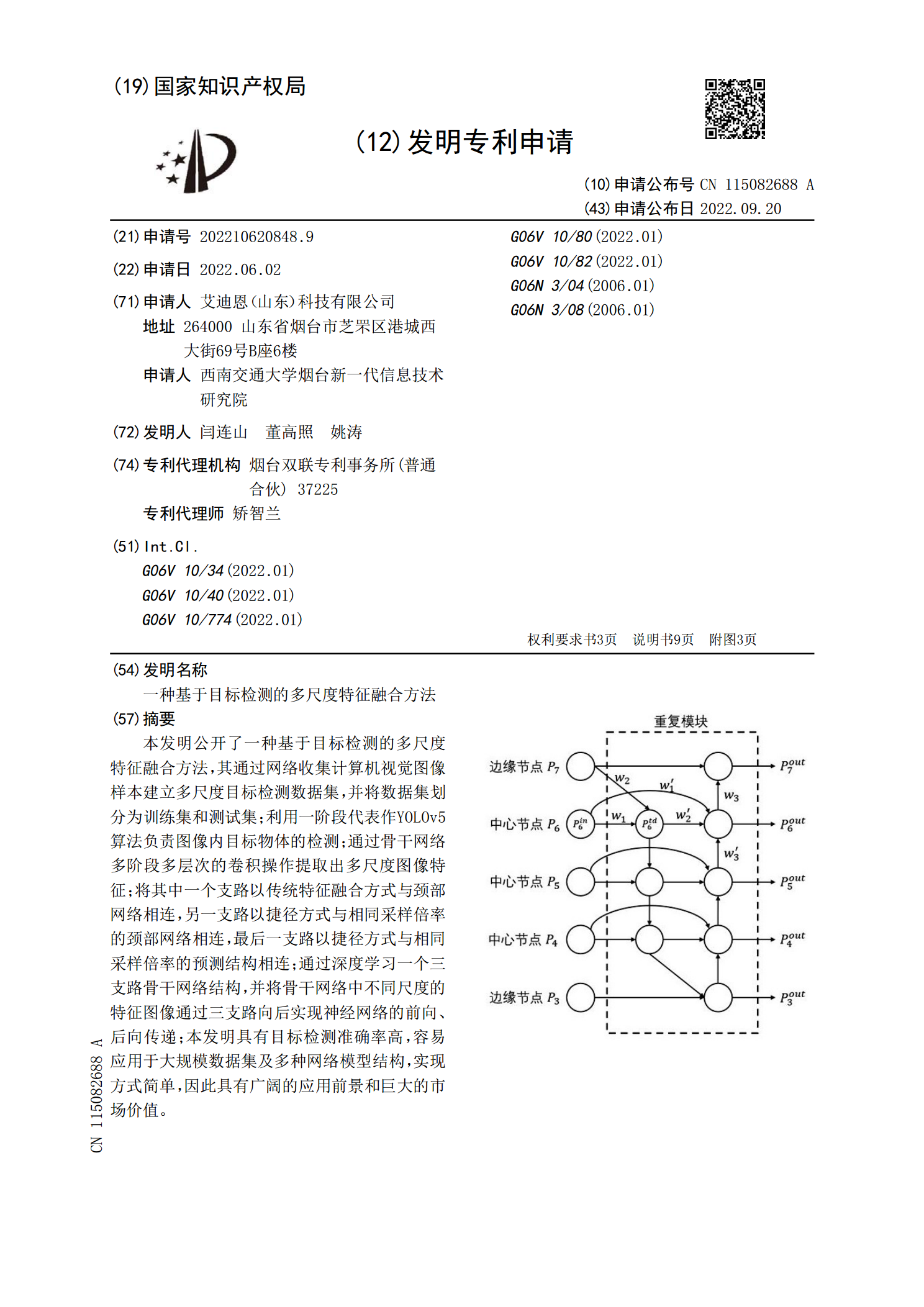

本发明公开了一种基于目标检测的多尺度特征融合方法,其通过网络收集计算机视觉图像样本建立多尺度目标检测数据集,并将数据集划分为训练集和测试集;利用一阶段代表作YOLOv5算法负责图像内目标物体的检测;通过骨干网络多阶段多层次的卷积操作提取出多尺度图像特征;将其中一个支路以传统特征融合方式与颈部网络相连,另一支路以捷径方式与相同采样倍率的颈部网络相连,最后一支路以捷径方式与相同采样倍率的预测结构相连;通过深度学习一个三支路骨干网络结构,并将骨干网络中不同尺度的特征图像通过三支路向后实现神经网络的前向、后向传递

一种基于多尺度特征融合的目标检测方法.pdf

本发明具体涉及一种基于多尺度特征融合的目标检测方法,包括:构建目标检测模型并进行训练;获取待检测目标的图像数据;将待检测目标的图像数据输入经过训练的目标检测模型中;首先基于图像数据提取多尺度的特征图;然后通过逐层特征融合和反馈特征融合的方式对低层特征图进行充分融合,得到对应的低层融合特征图;再通过注意力机制仅对高层特征图进行融合更新,得到对应的高层融合特征图;最后基于低层融合特征图和高层融合特征图生成对应的多尺度融合特征图;基于多尺度融合特征图完成目标检测。本发明中基于多尺度特征融合的目标检测方法能够充分

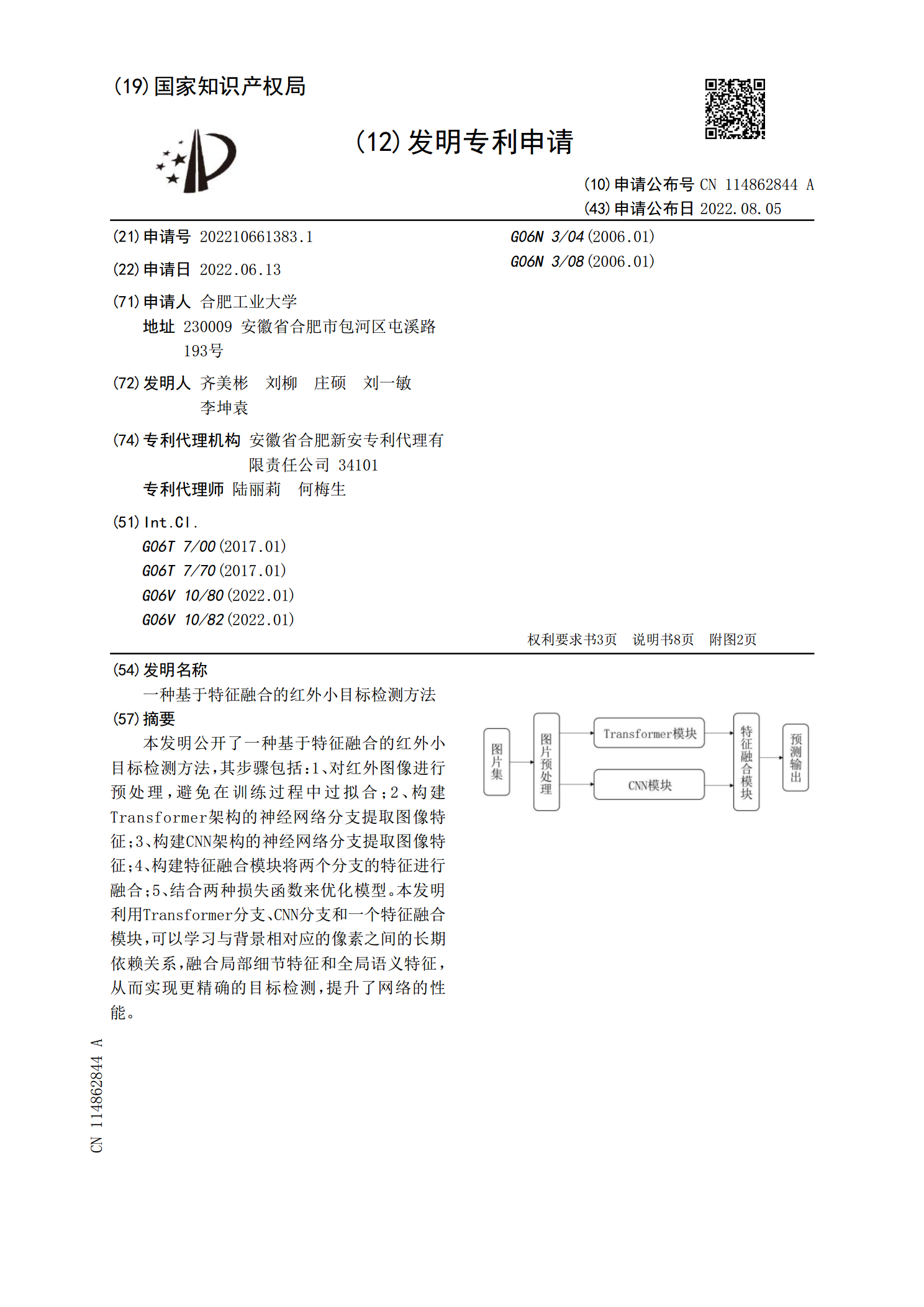

一种基于特征融合的红外小目标检测方法.pdf

本发明公开了一种基于特征融合的红外小目标检测方法,其步骤包括:1、对红外图像进行预处理,避免在训练过程中过拟合;2、构建Transformer架构的神经网络分支提取图像特征;3、构建CNN架构的神经网络分支提取图像特征;4、构建特征融合模块将两个分支的特征进行融合;5、结合两种损失函数来优化模型。本发明利用Transformer分支、CNN分支和一个特征融合模块,可以学习与背景相对应的像素之间的长期依赖关系,融合局部细节特征和全局语义特征,从而实现更精确的目标检测,提升了网络的性能。