一种基于自注意力机制的行人检索方法.pdf

文阁****23

亲,该文档总共18页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于自注意力机制的行人检索方法.pdf

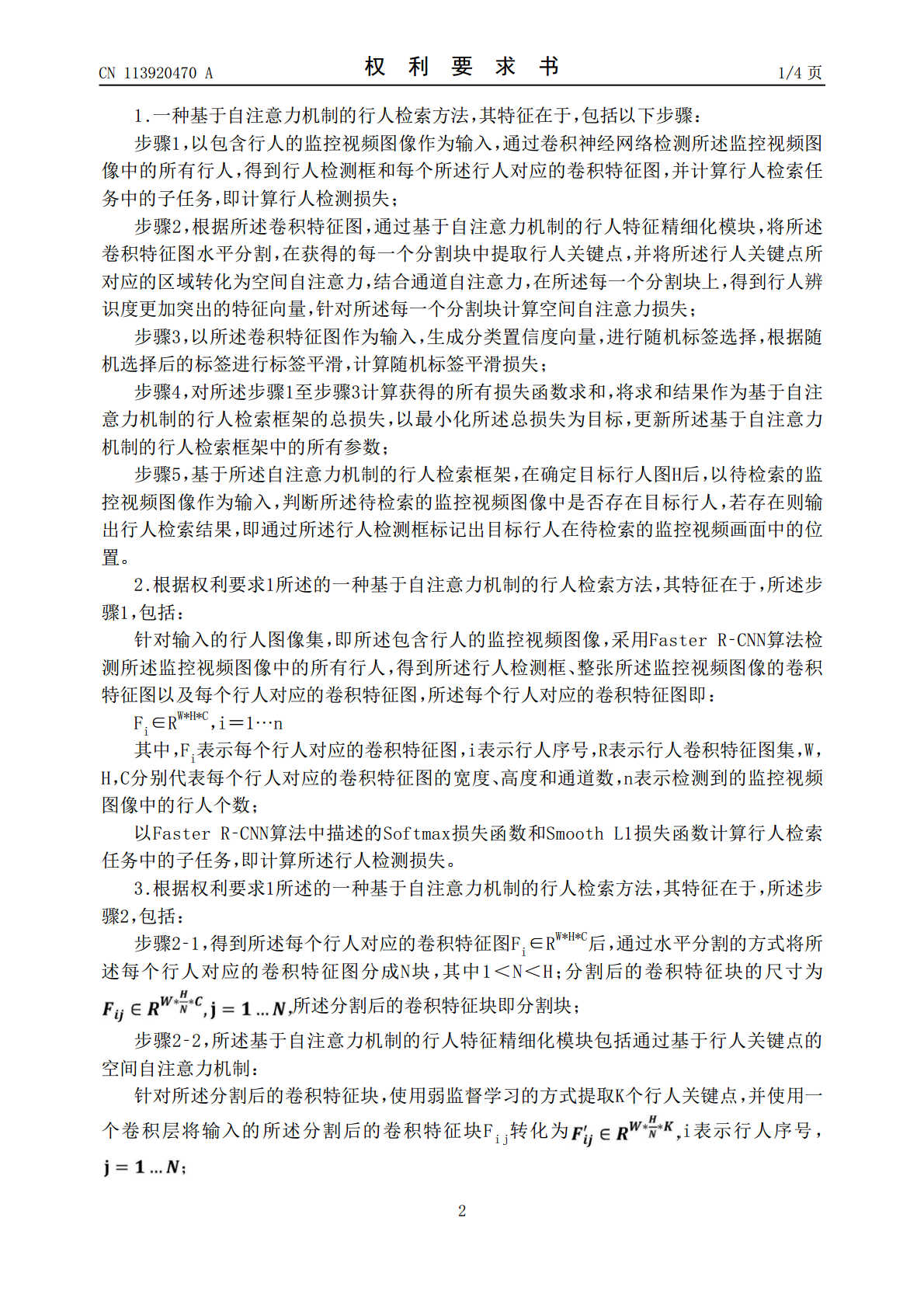

本发明提供了一种基于自注意力机制的行人检索方法,针对输入的行人图片集,该方法先利用FasterR‑CNN检测行人框,并提取卷积特征图以及计算损失;基于自注意力的行人特征精细化,在对行人卷积特征图进行水平分割后,针对每个分割区域提取行人关键点,计算空间自注意力和通道自注意力,基于这两种自注意力对卷积特征图进行优化调整,计算分割块损失函数;基于随机标签平滑策略的行人特征差异化,在利用L‑Softmax函数生成分类置信度向量的基础上,通过降采样进行随机标签选择,并计算随机标签平滑损失;网络训练,以上述三种损失

一种基于注意力机制的行人目标对齐方法.pdf

本发明提供一种基于注意力机制的行人目标对齐方法,本发明为解决目标丢失和遮挡问题,通过过程优化和局部特征提取来提高对齐精度、改善对齐性能。本发明对齐精度高,充分利用行人图像特征的全局结构信息和局部原始信息,有效处理行人目标遮挡问题并缓解了局部特征不对齐问题对算法性能的影响。

一种基于自注意力机制的推荐方法.pdf

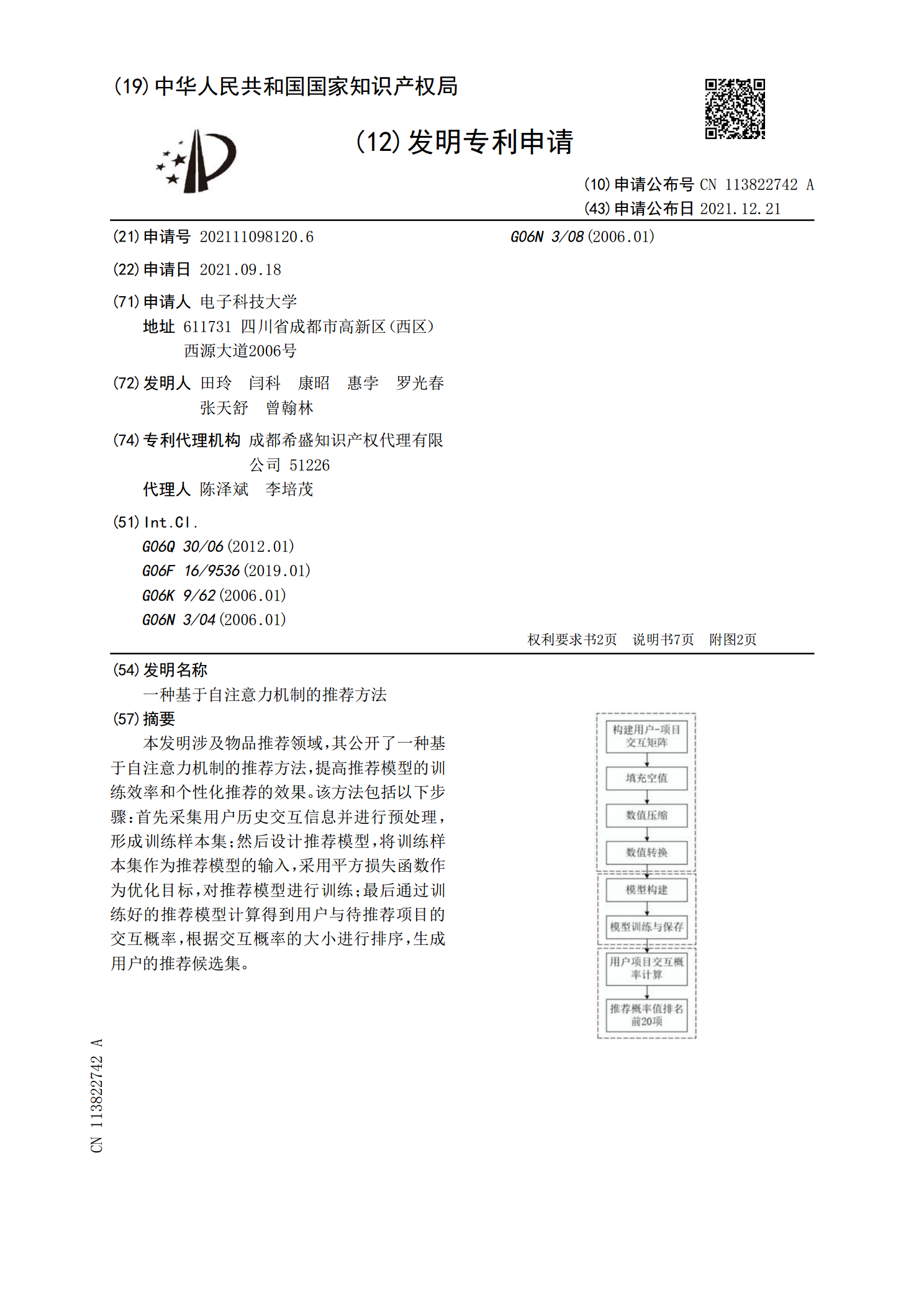

本发明涉及物品推荐领域,其公开了一种基于自注意力机制的推荐方法,提高推荐模型的训练效率和个性化推荐的效果。该方法包括以下步骤:首先采集用户历史交互信息并进行预处理,形成训练样本集;然后设计推荐模型,将训练样本集作为推荐模型的输入,采用平方损失函数作为优化目标,对推荐模型进行训练;最后通过训练好的推荐模型计算得到用户与待推荐项目的交互概率,根据交互概率的大小进行排序,生成用户的推荐候选集。

融合自注意力机制的跨模态食谱检索方法.docx

融合自注意力机制的跨模态食谱检索方法标题:融合自注意力机制的跨模态食谱检索方法摘要:随着互联网的发展,人们获取食谱的途径越来越多样化,但传统的食谱搜索引擎往往只基于文本信息进行检索,无法满足用户对多模态信息的需求。为此,本文提出了一种基于自注意力机制的跨模态食谱检索方法。该方法利用图像和文本的多模态特征,通过自注意力机制动态地关注不同位置的信息,从而增强模型对重要特征的捕捉能力。实验证明,该方法能够有效地提升跨模态食谱检索的精度和效果。1.引言食谱作为人们获取烹饪信息的重要途径,越来越受到人们的关注。然而

一种基于自注意力机制的自融合代码理解方法.pdf

本发明提出了一种基于自注意力机制的路径融合的代码理解方法,用于将Java源代码文件理解为低维稠密语义向量,并基于该向量表示代码中的语义与语法信息。同时,本方法基于代码方法名称预测与代码文本相似度评估两个方面,对代码理解方法进行训练以及评估。该发明的主要创新在于(1)基于自注意力机制,提出了一种全新的AST路径解析方法;(2)提出了一种基于循环神经网络的源代码理解方法,获得更为全面准确的语义信息;(3)提出了更为合理的源代码翻译模型与相似度评估模型,并超越了现有方法。