线性回归模型中自变量选择问题.pdf

qw****27

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

线性回归模型中自变量选择问题.pdf

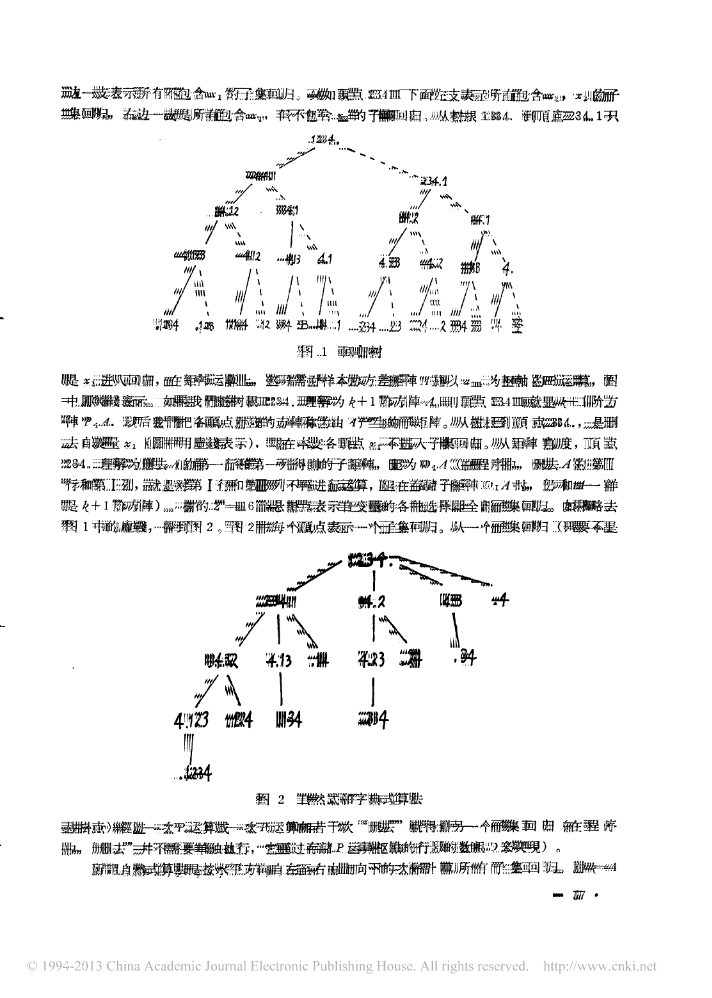

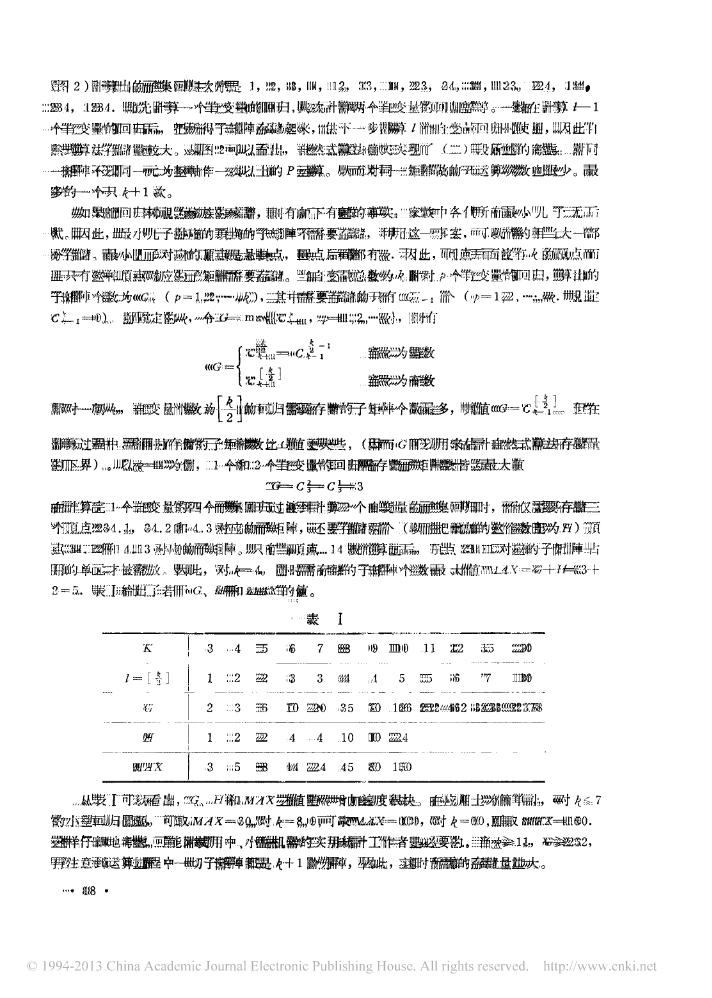

第10卷1期中国科学技术大学学报1980年线性回归模型中自变量选择问题不‘子拜~.抓}内月口二(一)回归自变量的选择问题。在一个大型回归周题中,可供选择的自变量为数很多国内地鬓工作者使用的“趋势面。。分析”,自变量可多达二十多个在将回归固题用于气象予报方面,也存在这种尚题在国外,将回归分析用于污染因子与死亡率的关系研究中,在汽事役蔚因子与每公里耗油率的关。系的研究中,所用的自变量在十到二十个之简据报导,在有些周题中涉及的自变量个数有。可能达到50一70个之多因此,在实用回归分析的研究中,关于从一大批可能的

关于二元线性回归模型中自变量内相关问题的讨论.docx

关于二元线性回归模型中自变量内相关问题的讨论二元线性回归模型是一种常用的统计模型,用于研究两个变量之间的关系。当我们建立这样的模型时,自变量之间可能存在相关关系。在这种情况下,需要对自变量内相关问题进行讨论。自变量内相关问题在统计学中是一个比较普遍的问题。当我们进行二元线性回归建模时,常常需要考虑自变量之间的关系。如果自变量之间存在相关关系,那么模型的解释力和预测能力都会受到影响。因此,需要在建模之前对自变量内相关问题进行分析和判断。从统计学的角度来看,自变量内相关可以分为两种情况。一种是完全相关,即自变

自变量选择与逐步回归.doc

自变量选择与逐步回归一、全模型和选模型设研究某一实际问题,涉及对因变量有影响的因素共有m个,由因变量y和m个自变量构成的回归模型称为全模型。如果从可供选择的m个变量中选出p个,由选出的p个自变量组成的回归模型称为选模型。二、自变量选择对预测的影响自变量选择对预测的影响可以分为两种情况考虑,第一种情况是全模型正确而误用了选模型;第二种情况是选模型正确而无用了全模型。以下是这两种情况对回归的影响。1、全模型正确而误用选模型的情况性质1,在与的相关系数不全为0时,选模型回归系数的最小二乘估计是全模型相应参数的有

自变量优化的一元线性回归.docx

自变量优化的一元线性回归一元线性回归是统计学中一个重要的概念。它常被用于分析两个变量之间的关系,其中一个变量被称为因变量,另一个变量被称为自变量。这里将探讨如何在自变量中优化一元线性回归。在一元线性回归中,我们试图找到一个直线,它能最好地拟合因变量和自变量之间的关系。和其他回归模型一样,我们需要对数据进行训练以最大化模型的准确性和精度。因此,问题就转化成了如何优化自变量。我们可以使用不同的统计方法和数学工具来评估和优化自变量。这里介绍其中的两种方法:最小二乘法和梯度下降法。首先,最小二乘法是一种统计方法,

自变量选择和逐步回归.ppt

自变量选择和逐步回归逐步回归与多元线性回归模型选择逐步回归的数学模型逐步回归的数学模型检验新变量的显著性逐步回归的数学模型逐步回归的数学模型检验新变量的显著性检验新变量的显著性检验新变量的显著性剔除变量剔除变量的准则和方法剔除变量的准则和方法剔除变量的准则和方法剔除变量的准则和方法剔除变量的准则和方法逐步回归的计算方法数据标准化标准化数据的模型及回归步骤自变量选择的准则自变量选择的方法前进法前进法前进法后退法后退法最优子集法最优子集法关于自变量选择的几个标准原则1:修正的复决定系数最大修正的复决定系数修正