一种基于增强全局信息注意力的多尺度监控行人重识别方法.pdf

东耀****哥哥

亲,该文档总共25页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于增强全局信息注意力的多尺度监控行人重识别方法.pdf

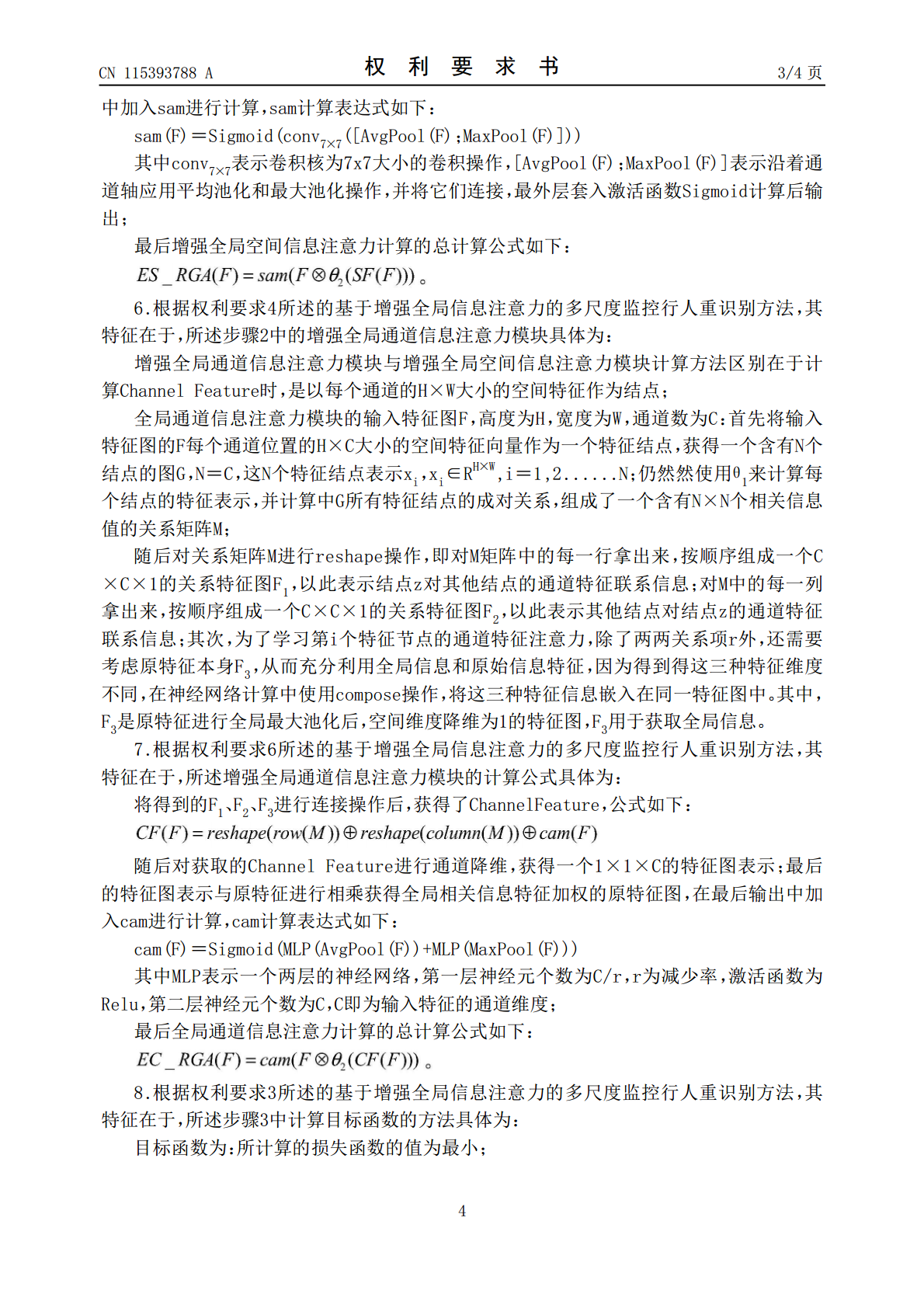

本发明公开了一种基于增强全局信息注意力的多尺度监控行人重识别方法,包括以下步骤:构建行人监控的数据集,划分为训练集和测试集;构建基于增强全局信息注意力的多尺度行人重识别网络模型,该模型以多分支深度网络模型为基础架构提取局部特征,引入增强全局信息注意力机制,通过多尺度网络提取局部特征并使用注意力为局部特征赋予全局信息;输入训练集对模型进行训练,通过多次的目标函数计算,反向传播后调整参数,直到目标函数完成收敛;通过测试集进行测试;输入待识别的查询集,通过多尺度行人重识别网络模型进行识别,得到行人重识别的结果。

一种基于多尺度特征融合的行人重识别方法.pdf

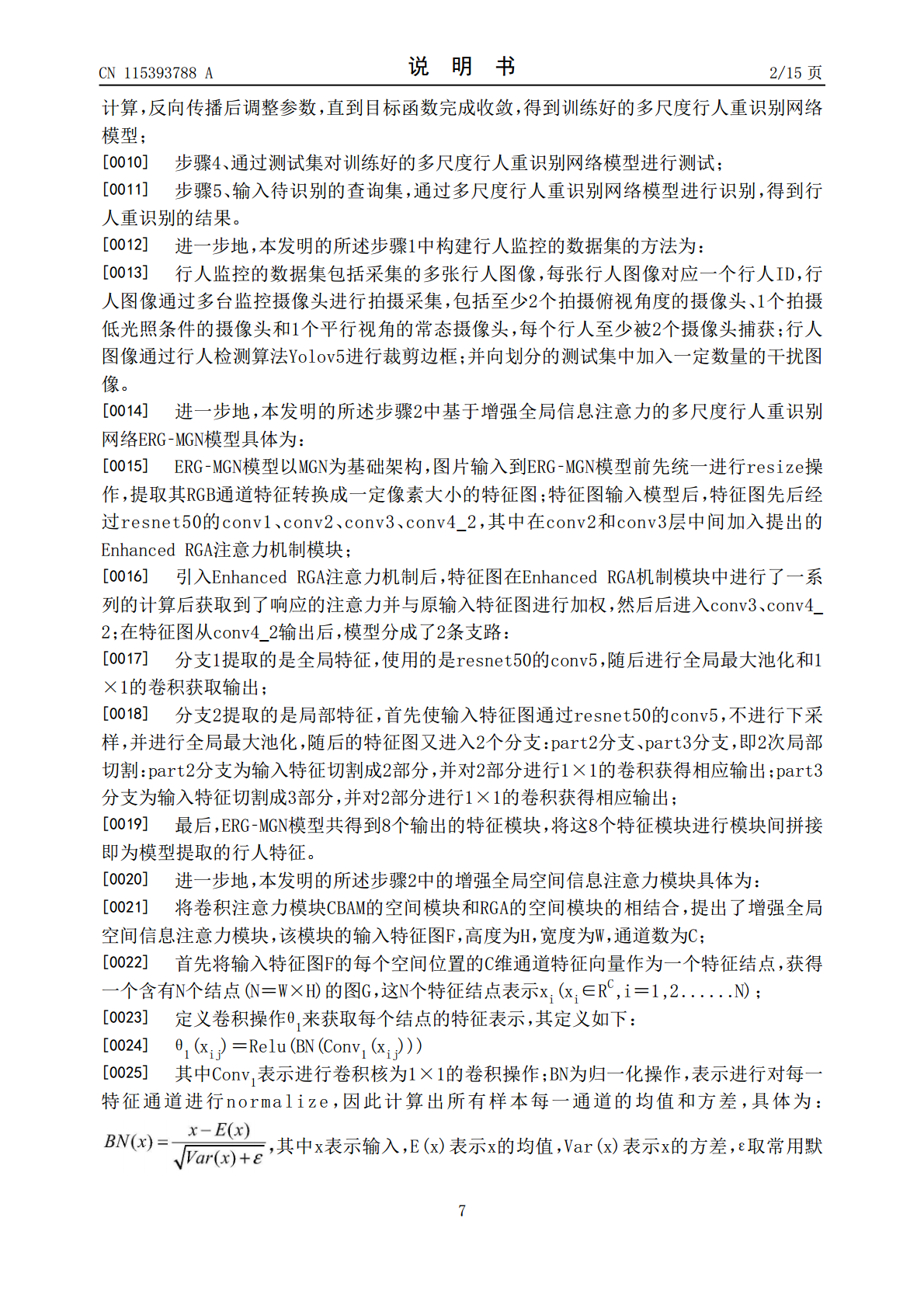

一种基于多尺度特征融合的行人重识别方法,1)构建基于多尺度融合的模型,并预训练主干网络暨多尺度特征提取器。2)利用多尺度特征提取器生成图像的多尺度特征。3)采用基于Transformer的特征校准模型融合两个不同尺度的特征。4)利用深监督融合从浅层特征到深层特征不断融合不同层级的特征。5)用交叉熵损失和三元组损失监督融合过程。6)将目标测试集图像输入训练好的模型提取特征,根据特征相似度进行排序得到行人重识别的结果,进而实现行人重识别。本发明采用卷积神经网络提取多尺度特征,使用Transformer从全局的

一种基于多尺度特征融合的视频行人重识别方法.pdf

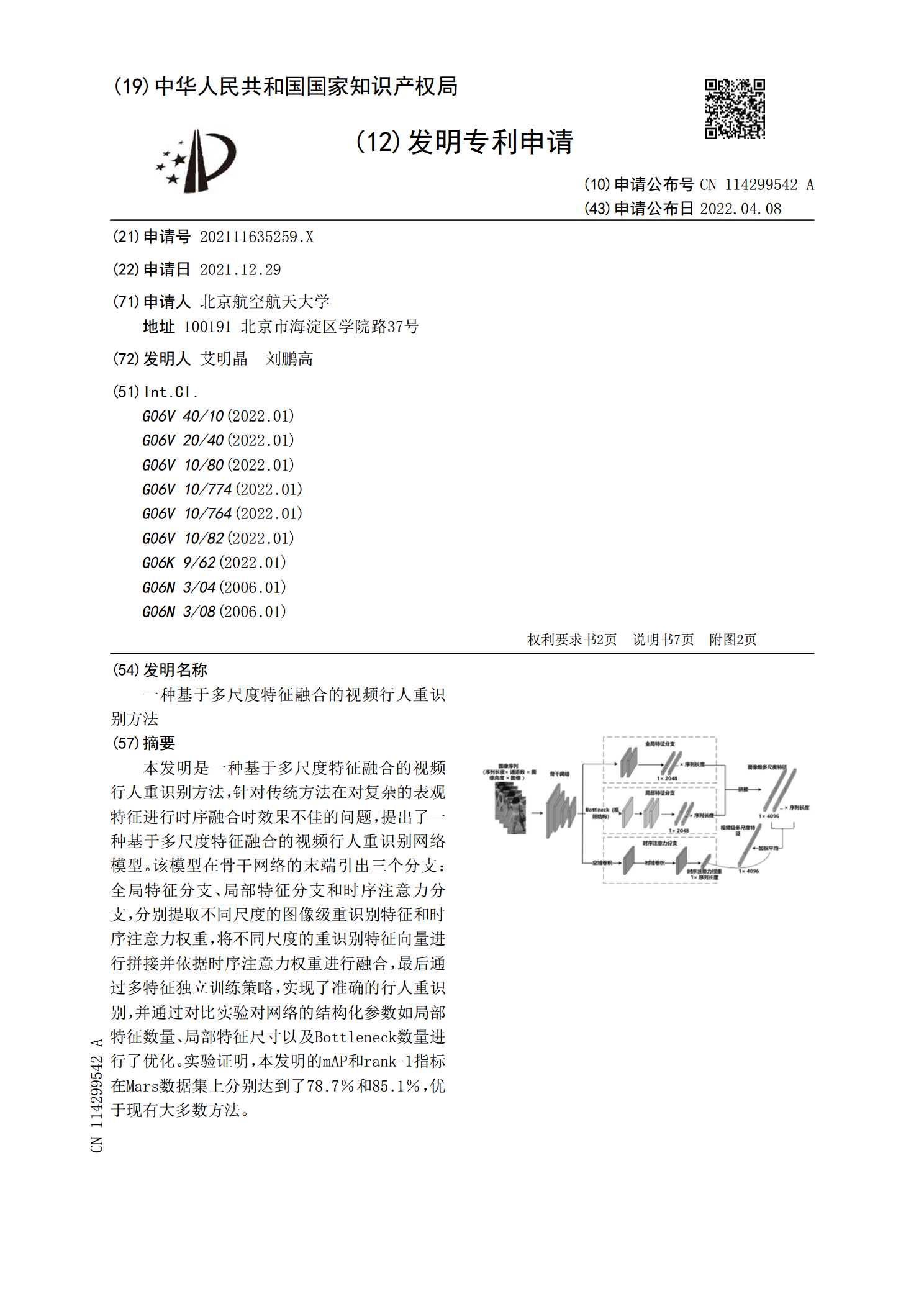

本发明是一种基于多尺度特征融合的视频行人重识别方法,针对传统方法在对复杂的表观特征进行时序融合时效果不佳的问题,提出了一种基于多尺度特征融合的视频行人重识别网络模型。该模型在骨干网络的末端引出三个分支:全局特征分支、局部特征分支和时序注意力分支,分别提取不同尺度的图像级重识别特征和时序注意力权重,将不同尺度的重识别特征向量进行拼接并依据时序注意力权重进行融合,最后通过多特征独立训练策略,实现了准确的行人重识别,并通过对比实验对网络的结构化参数如局部特征数量、局部特征尺寸以及Bottleneck数量进行了优

基于多尺度自注意力增强的多方对话角色识别方法.pptx

汇报人:目录PARTONEPARTTWO不同尺度的自注意力机制不同尺度的自注意力机制在对话角色识别中的作用多尺度自注意力机制的优点多尺度自注意力机制的实现方式PARTTHREE传统的对话角色识别方法基于深度学习的对话角色识别方法基于多尺度自注意力增强的对话角色识别方法基于多尺度自注意力增强的对话角色识别方法的优势PARTFOUR实验数据集介绍实验设置与参数选择实验结果对比分析基于多尺度自注意力增强的对话角色识别方法的性能分析PARTFIVE基于多尺度自注意力增强的对话角色识别方法的应用场景基于多尺度自注意

基于多尺度生成对抗网络的遮挡行人重识别方法.docx

基于多尺度生成对抗网络的遮挡行人重识别方法基于多尺度生成对抗网络的遮挡行人重识别方法摘要:遮挡问题一直是行人重识别领域的一个关键挑战。本文提出了一种基于多尺度生成对抗网络的遮挡行人重识别方法。该方法结合了生成对抗网络和多尺度特征提取的思想,通过生成器和判别器的对抗训练,实现了对遮挡行人的准确重识别。实验结果表明,该方法在遮挡行人重识别任务中取得了较好的效果。关键词:遮挡行人;重识别;生成对抗网络;多尺度特征提取1.引言行人重识别是计算机视觉领域的一个重要问题。它的目标是在视频监控等场景下,通过不同的摄像头