一种基于联邦学习方式训练神经网络模型的方法及系统.pdf

一只****ua

亲,该文档总共14页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于联邦学习方式训练神经网络模型的方法及系统.pdf

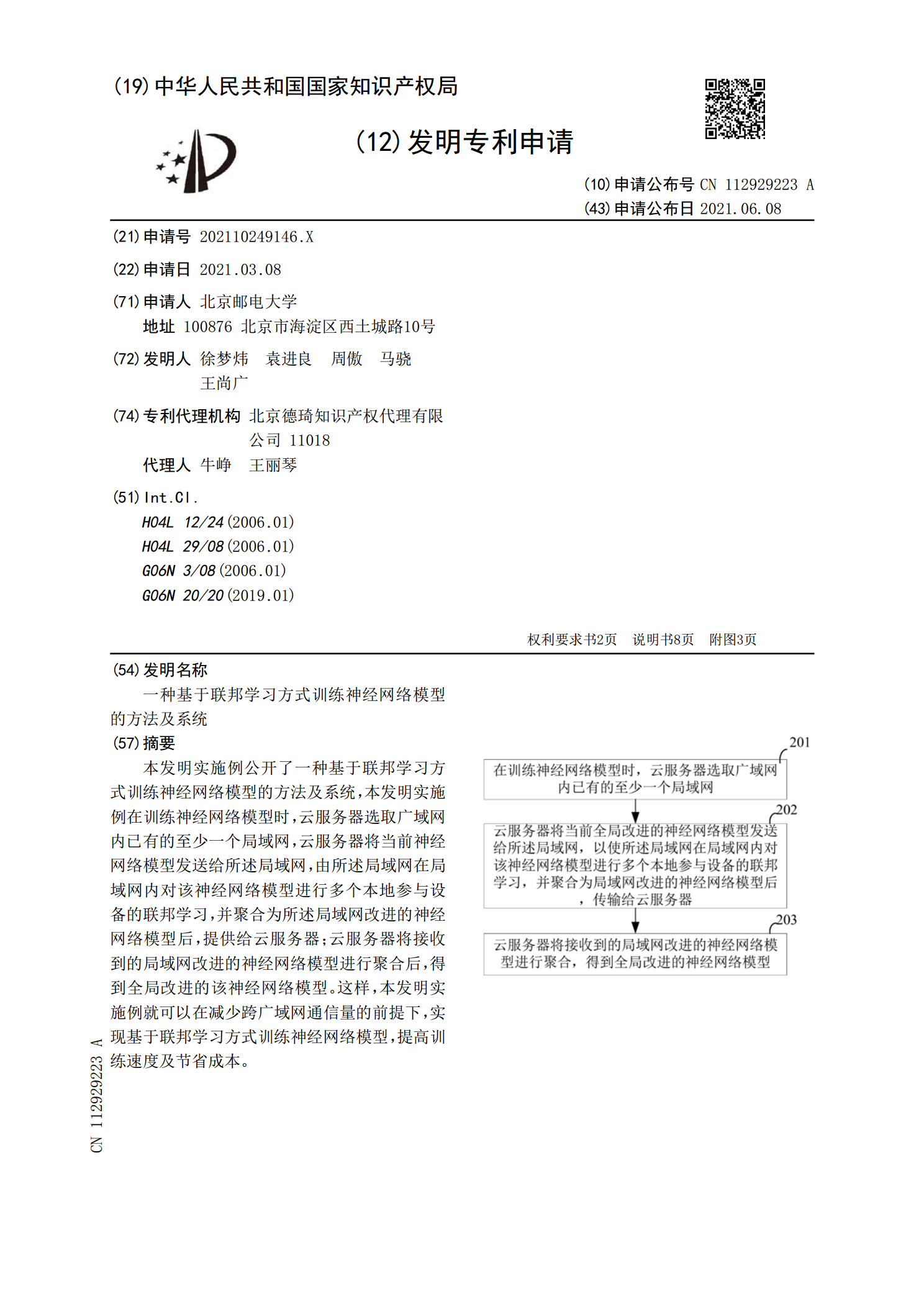

本发明实施例公开了一种基于联邦学习方式训练神经网络模型的方法及系统,本发明实施例在训练神经网络模型时,云服务器选取广域网内已有的至少一个局域网,云服务器将当前神经网络模型发送给所述局域网,由所述局域网在局域网内对该神经网络模型进行多个本地参与设备的联邦学习,并聚合为所述局域网改进的神经网络模型后,提供给云服务器;云服务器将接收到的局域网改进的神经网络模型进行聚合后,得到全局改进的该神经网络模型。这样,本发明实施例就可以在减少跨广域网通信量的前提下,实现基于联邦学习方式训练神经网络模型,提高训练速度及节省成

基于联邦学习的模型训练方法和联邦学习系统.pdf

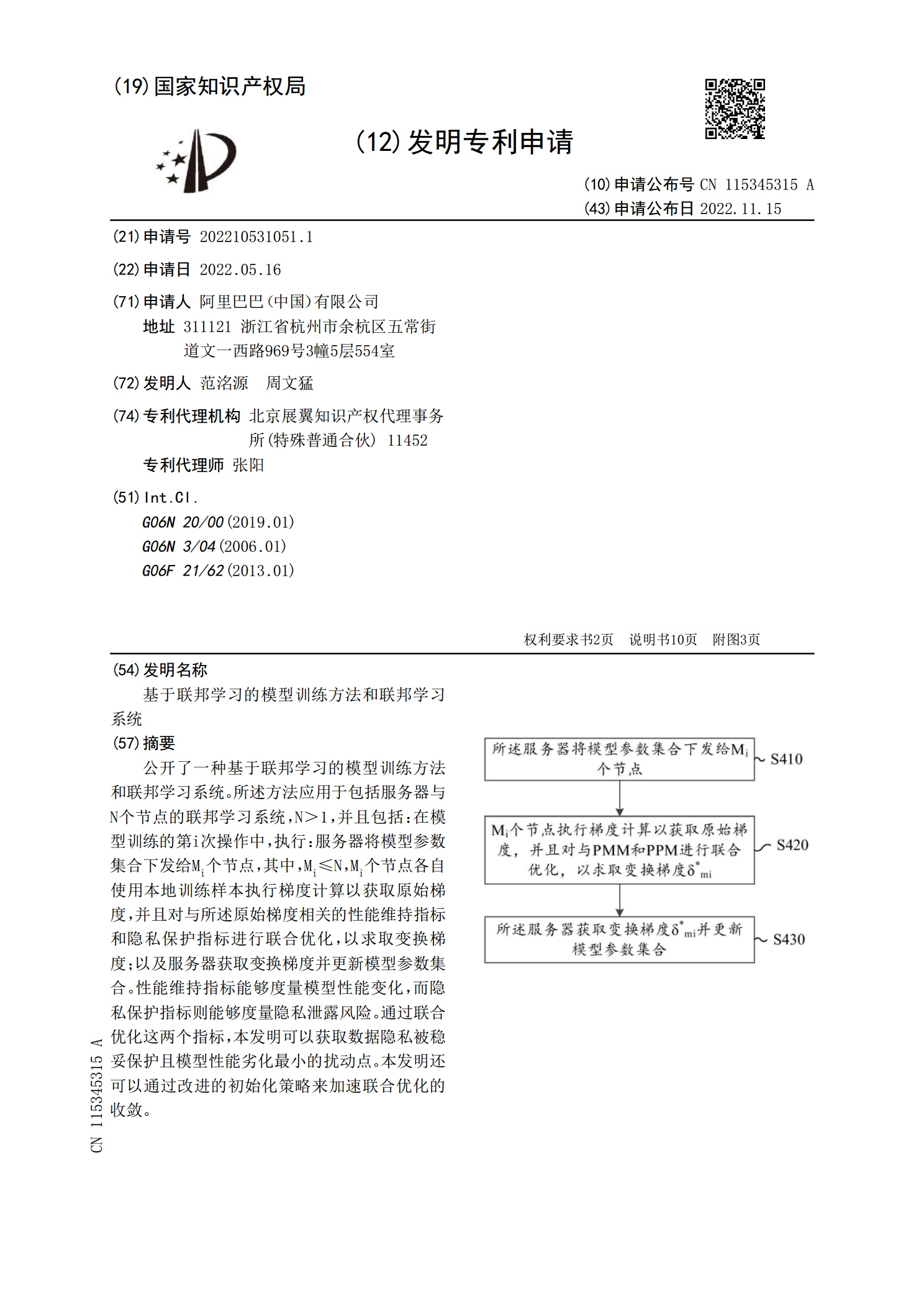

公开了一种基于联邦学习的模型训练方法和联邦学习系统。所述方法应用于包括服务器与N个节点的联邦学习系统,N>1,并且包括:在模型训练的第i次操作中,执行:服务器将模型参数集合下发给M<base:Sub>i</base:Sub>个节点,其中,M<base:Sub>i</base:Sub>≤N,M<base:Sub>i</base:Sub>个节点各自使用本地训练样本执行梯度计算以获取原始梯度,并且对与所述原始梯度相关的性能维持指标和隐私保护指标进行联合优化,以求取变换梯度;以及服务器获取变换梯度并更新模型参数集

基于联邦学习的模型训练方法和联邦学习系统.pdf

公开了一种基于联邦学习的模型训练方法和联邦学习系统。所述方法应用于包括服务器与N个节点的联邦学习系统,N>1,并且包括:在模型训练的第i次操作中,执行:服务器将模型参数集合下发给M<base:Sub>i</base:Sub>个节点,其中,M<base:Sub>i</base:Sub>≤N,M<base:Sub>i</base:Sub>个节点各自使用本地训练样本执行梯度计算以获取原始梯度,并且对与所述原始梯度相关的性能维持指标和隐私保护指标进行联合优化,以求取变换梯度;以及服务器获取变换梯度并更新模型参数集

基于联邦学习的模型训练方法及系统、存储介质.pdf

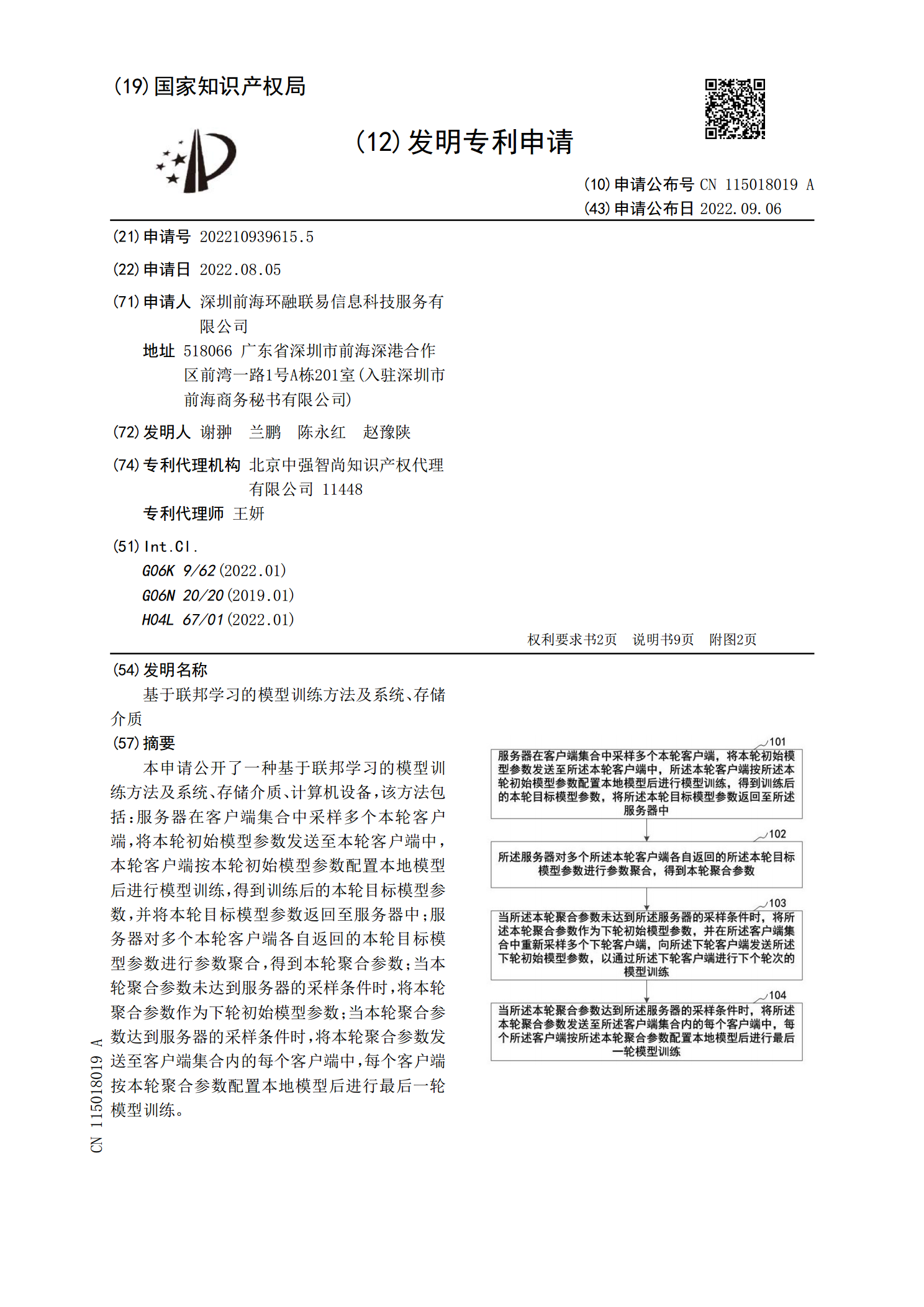

本申请公开了一种基于联邦学习的模型训练方法及系统、存储介质、计算机设备,该方法包括:服务器在客户端集合中采样多个本轮客户端,将本轮初始模型参数发送至本轮客户端中,本轮客户端按本轮初始模型参数配置本地模型后进行模型训练,得到训练后的本轮目标模型参数,并将本轮目标模型参数返回至服务器中;服务器对多个本轮客户端各自返回的本轮目标模型参数进行参数聚合,得到本轮聚合参数;当本轮聚合参数未达到服务器的采样条件时,将本轮聚合参数作为下轮初始模型参数;当本轮聚合参数达到服务器的采样条件时,将本轮聚合参数发送至客户端集合内

一种基于联邦学习的模型训练方法.pdf

公开了一种基于联邦学习的模型训练方法。在一次训练迭代中,节点可以通过差分隐私保护操作,实现对梯度的加噪混淆,服务端可以获得加噪混淆后的梯度之和,进行模型参数的更新。