em算法及其改进.ppt

胜利****实阿

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

em算法及其改进.ppt

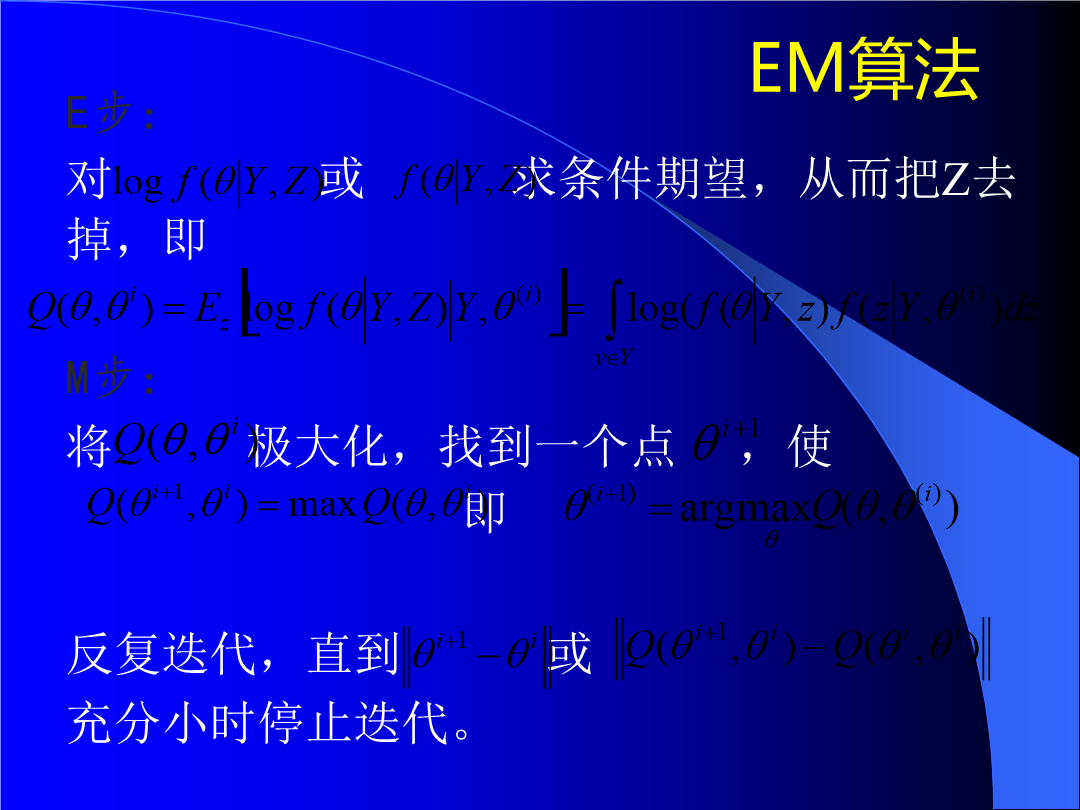

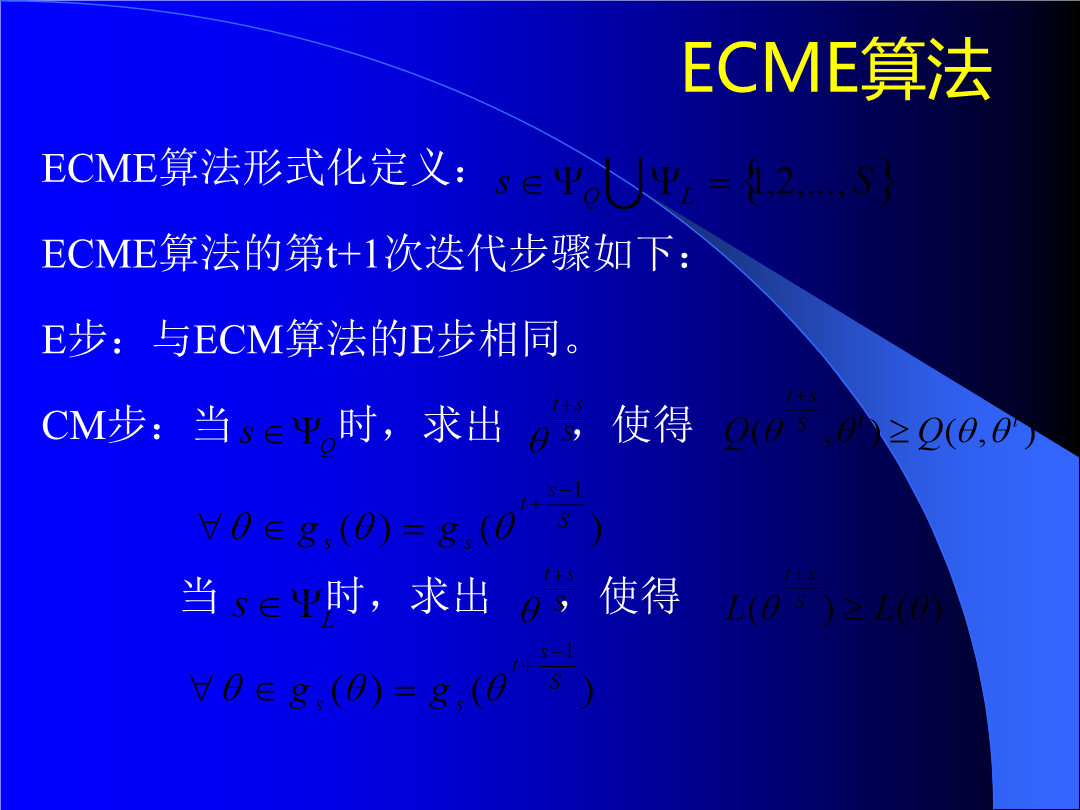

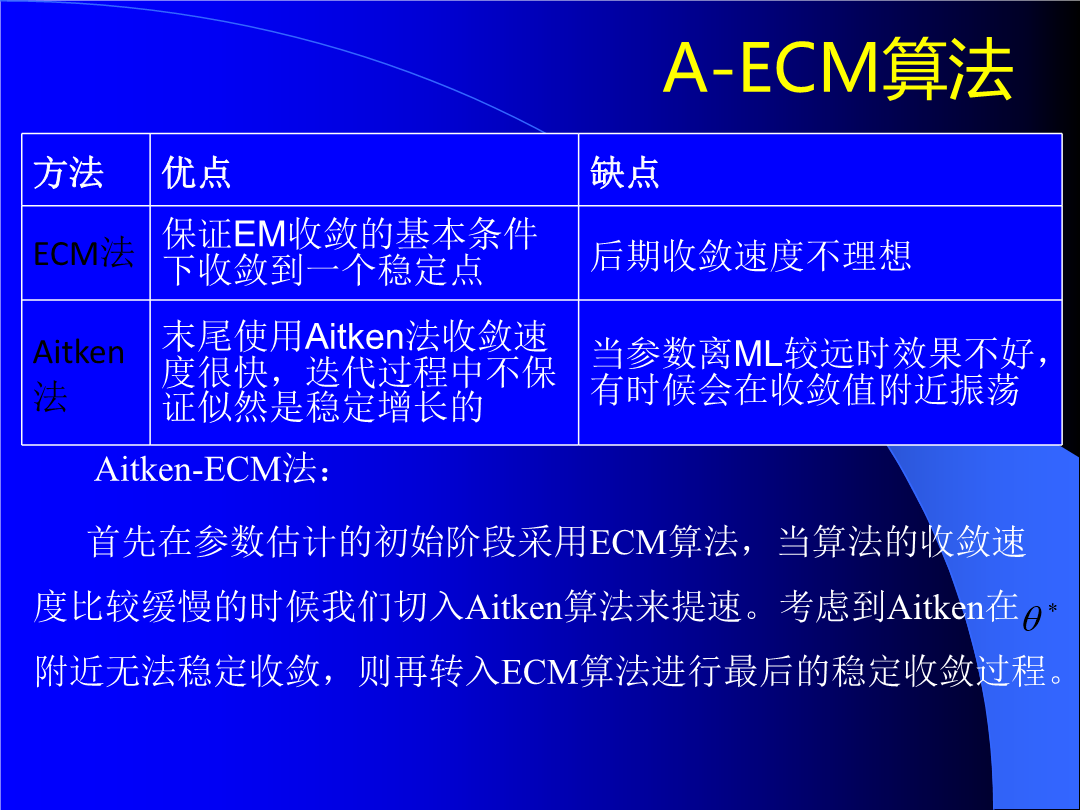

EM算法及其改进E步:对或求条件期望,从而把Z去掉,即M步:将极大化,找到一个点,使即反复迭代,直到或充分小时停止迭代。优点:其一,M步仅涉及完全数据极大似然,通常计算比较简单;其二,它的收敛是稳定的,因为每次迭代似然函数是不断增加的.缺点:当缺失的信息量很大或完全数据对数似然的估计本身比较复杂时,EM算法的收敛速度将很缓慢。基于EM算法的缺点产生了各种改进的算法,这些改进的算法都着眼于改善收敛速度和保证收敛性质。在很多问题中,若对参数施加一定的函数约束,可以使完全数据极大似然估计变得相对简单。ECM算法

EM算法及其应用.docx

EM算法及其应用EM算法及其应用摘要:EM算法(ExpectationMaximizationAlgorithm)是一种在统计学中广泛应用的参数估计算法。其原理是通过迭代更新来估计未观测变量的参数,并在每次迭代中计算出观测变量的期望值。本论文将对EM算法的基本原理进行介绍,并探讨其在机器学习、图像处理和自然语言处理等领域中的应用。一、引言EM算法是由Dempster等人于1977年提出的,是一种通过迭代更新来估计潜在变量的参数的方法。EM算法在很多领域都有着广泛的应用,如机器学习、图像处理和自然语言处理等

EM算法及其应用的中期报告.docx

EM算法及其应用的中期报告EM算法,全称为期望最大化算法(Expectation-Maximizationalgorithm),是一种常用的概率统计模型参数估计方法,广泛应用于机器学习、自然语言处理、信号处理、图像处理等领域。EM算法的基本思想是:通过观测数据推断出潜在变量,进而求解模型的参数。具体而言,EM算法是一种迭代式求解方法,其迭代步骤通常包括以下两个过程:1.E步骤(Expectationstep):计算当前参数下,所有潜在变量的后验分布。这一步骤通常采用贝叶斯公式计算潜在变量的后验概率,使得其

基于EM改进算法的高斯混合模型参数估计.docx

基于EM改进算法的高斯混合模型参数估计基于EM改进算法的高斯混合模型参数估计摘要高斯混合模型(GMM)是一种常用的概率模型,它通常被用于聚类和密度估计等任务。在GMM中,每个观测值都被看作是由多个高斯分布组成的混合产生的。参数估计是GMM的关键问题之一,因为GMM的性能主要依赖于准确的参数估计。然而,由于GMM的参数估计问题是一个非凸的优化问题,传统的参数估计方法往往容易陷入局部最优。为了解决这个问题,本文提出了一种基于EM改进算法的高斯混合模型参数估计方法。在该方法中,我们引入了一个新的停止准则和一个自

一种半监督机器学习的EM算法改进方法.pptx

汇报人:CONTENTSPARTONEPARTTWO定义和原理常见应用场景传统EM算法的局限性PARTTHREE定义和特点半监督学习的应用场景半监督学习的挑战和解决方法PARTFOUR结合半监督学习的特点进行改进改进的EM算法流程改进算法的优势和局限性PARTFIVE数据预处理初始化参数迭代优化过程算法收敛判定PARTSIX实验数据集和对比方法实验过程和结果结果分析和讨论PARTSEVEN改进EM算法在半监督学习中的效果总结对未来研究的建议和展望汇报人: