一种基于时频域生成对抗网络的语音增强方法.pdf

俊英****22

亲,该文档总共16页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于时频域生成对抗网络的语音增强方法.pdf

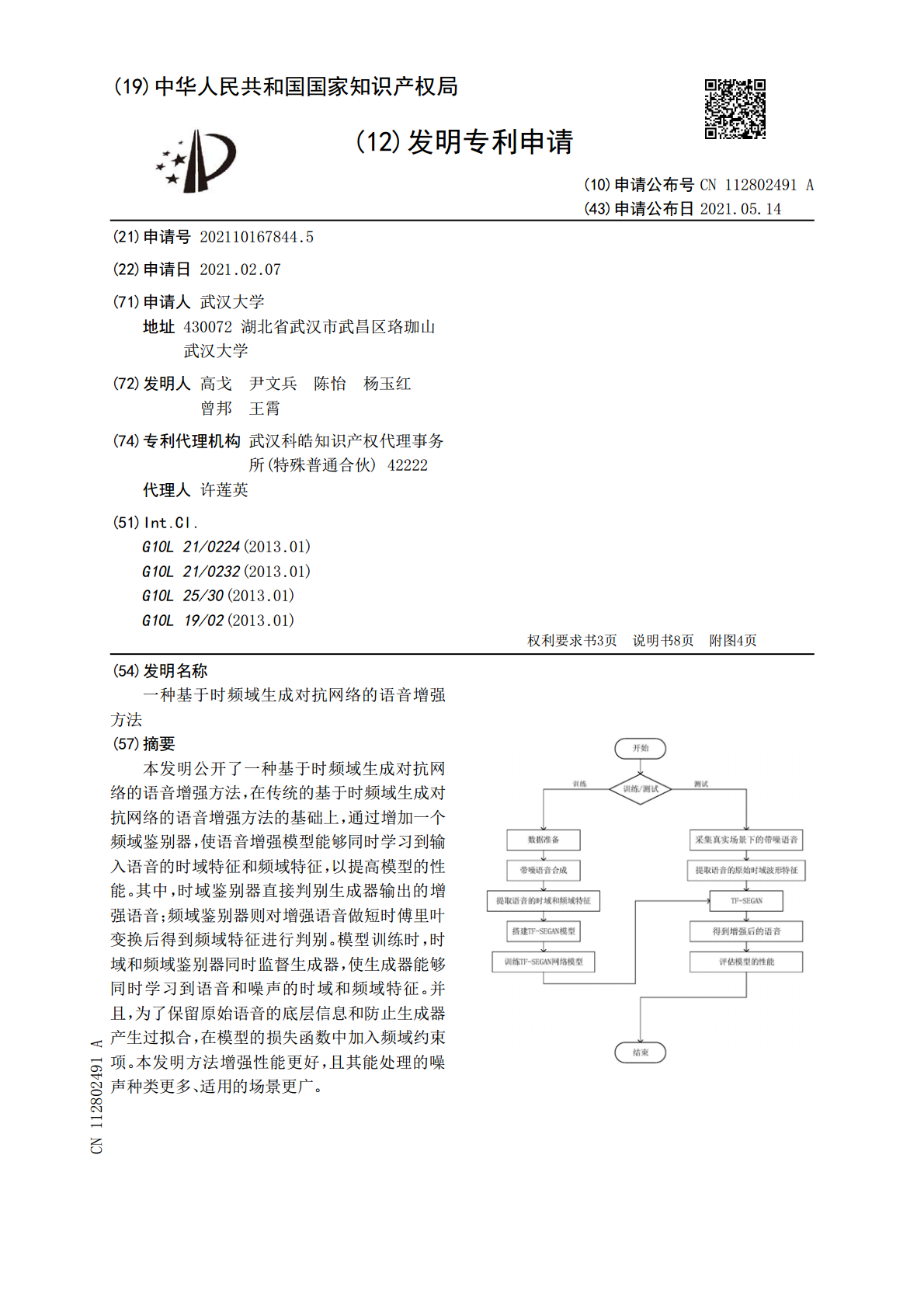

本发明公开了一种基于时频域生成对抗网络的语音增强方法,在传统的基于时频域生成对抗网络的语音增强方法的基础上,通过增加一个频域鉴别器,使语音增强模型能够同时学习到输入语音的时域特征和频域特征,以提高模型的性能。其中,时域鉴别器直接判别生成器输出的增强语音;频域鉴别器则对增强语音做短时傅里叶变换后得到频域特征进行判别。模型训练时,时域和频域鉴别器同时监督生成器,使生成器能够同时学习到语音和噪声的时域和频域特征。并且,为了保留原始语音的底层信息和防止生成器产生过拟合,在模型的损失函数中加入频域约束项。本发明方法

基于生成对抗网络合成噪声的语音增强方法研究.docx

基于生成对抗网络合成噪声的语音增强方法研究标题:基于生成对抗网络合成噪声的语音增强方法研究摘要:语音增强是一项重要的任务,其目的是改善语音质量并提高语音识别的性能。然而,现有的传统语音增强方法仍然存在一些挑战,如难以处理复杂的噪声环境和保持语音细节等。为了解决这些问题,本文提出了一种基于生成对抗网络(GAN)的语音增强方法,该方法通过训练一个生成器模型来合成噪声,并将其应用于语音信号中,从而实现语音的增强效果。1.引言语音增强是一个重要的任务,在许多语音相关的应用中都起到了至关重要的作用。然而,由于复杂的

一种基于生成式对抗网络的语音生成方法.pdf

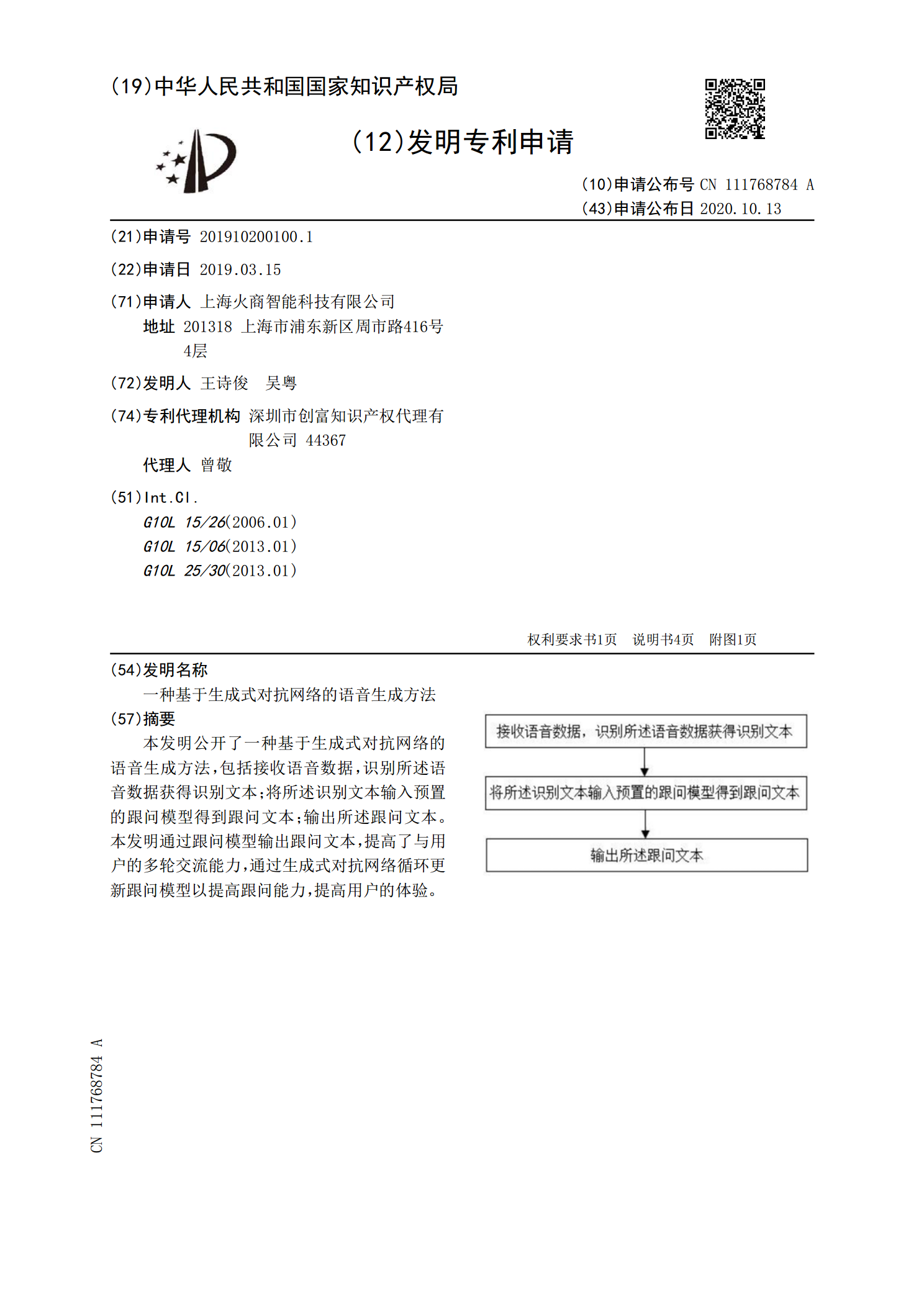

本发明公开了一种基于生成式对抗网络的语音生成方法,包括接收语音数据,识别所述语音数据获得识别文本;将所述识别文本输入预置的跟问模型得到跟问文本;输出所述跟问文本。本发明通过跟问模型输出跟问文本,提高了与用户的多轮交流能力,通过生成式对抗网络循环更新跟问模型以提高跟问能力,提高用户的体验。

基于听觉掩蔽生成对抗网络的单通道语音增强方法.pptx

基于听觉掩蔽生成对抗网络的单通道语音增强方法目录添加目录项标题引言语音增强的背景和意义传统单通道语音增强方法的局限性基于听觉掩蔽生成对抗网络的优势听觉掩蔽生成对抗网络的基本原理听觉掩蔽技术生成对抗网络的基本原理听觉掩蔽生成对抗网络的设计思路基于听觉掩蔽生成对抗网络的单通道语音增强方法训练过程生成对抗网络中的判别器设计生成器设计训练策略和优化方法实验结果与分析实验设置和数据集实验结果及对比分析方法性能评估和讨论结论与展望本研究的贡献与亮点存在的不足与局限性对未来研究的建议和展望感谢观看

基于自动编码生成对抗网络的语音增强算法.docx

基于自动编码生成对抗网络的语音增强算法基于自动编码生成对抗网络的语音增强算法摘要:语音增强是一个重要的音频处理任务,旨在改善语音信号的质量和清晰度。本文提出了一种基于自动编码生成对抗网络的语音增强算法。首先,我们介绍了自动编码器和生成对抗网络的基本原理。然后,我们详细描述了我们的提出的语音增强算法。最后,我们进行了一系列实验,结果表明我们的算法能够有效地提高语音信号的质量和清晰度。1.引言语音增强是在实际应用中广泛使用的一种音频处理技术,它可以用于改善语音信号的质量和清晰度,并提高语音识别系统的性能。传统