基于深度学习的图像特征学习和分类方法的研究及应用.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于深度学习的图像特征学习和分类方法的研究及应用.docx

基于深度学习的图像特征学习和分类方法的研究及应用基于深度学习的图像特征学习和分类方法的研究及应用摘要:随着深度学习技术的快速发展,图像特征学习和分类方法已取得了巨大的突破。本论文主要探讨了深度学习在图像特征学习和分类方面的研究现状,并探讨了应用于图像分类任务的一些常用方法。首先,介绍了深度学习的基础概念和基本原理,接着,探讨了深度卷积神经网络(CNN)在图像特征学习和分类中的应用,包括网络结构、训练过程以及常用的优化算法等。接着,介绍了一些扩展的CNN模型,如残差网络(ResNet)、注意力机制(Atte

基于深度学习的图像分类方法研究与应用的开题报告.docx

基于深度学习的图像分类方法研究与应用的开题报告一、研究背景及意义随着计算机技术的不断发展,机器学习(机器学习,MachineLearning)成为了当前研究领域中的热门话题。深度学习(DeepLearning)是机器学习的一种,也是当前最流行和最成功的机器学习方法之一。它利用神经网络中的多层结构对输入数据进行特征提取和分类。图像分类是深度学习在计算机视觉领域的一个重要应用,也是深度学习的研究热点之一。人类视觉系统可以通过感知不同的视觉特征,如颜色、纹理、形状等,来对图像进行分类。深度学习算法可以模仿这一过

基于深度学习的图像分类方法研究.docx

基于深度学习的图像分类方法研究基于深度学习的图像分类方法研究摘要:随着计算机视觉和深度学习的迅猛发展,图像分类已成为研究热点之一。本文基于深度学习技术,对图像分类方法进行研究。首先介绍了深度学习的基本原理和常见的神经网络结构,然后详细介绍了卷积神经网络(CNN)的原理和应用于图像分类的过程。接着讨论了数据预处理和数据增强对图像分类性能的影响。最后,通过实验验证了基于深度学习的图像分类方法在不同数据集上的准确率和鲁棒性。关键词:深度学习;图像分类;卷积神经网络;数据预处理;数据增强1.引言随着计算机视觉和深

基于判别特征学习和熵的深度半监督图像分类方法.pdf

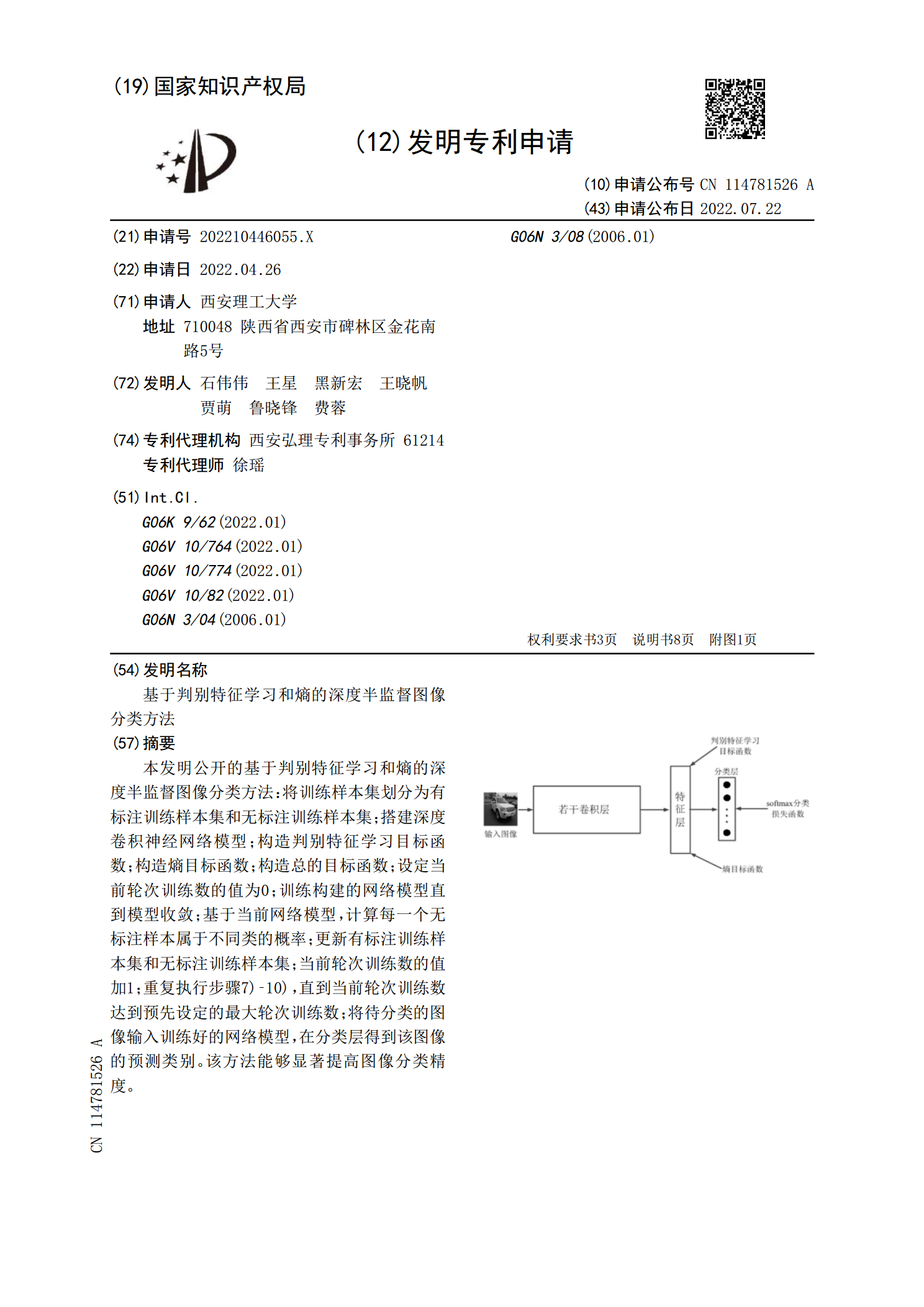

本发明公开的基于判别特征学习和熵的深度半监督图像分类方法:将训练样本集划分为有标注训练样本集和无标注训练样本集;搭建深度卷积神经网络模型;构造判别特征学习目标函数;构造熵目标函数;构造总的目标函数;设定当前轮次训练数的值为0;训练构建的网络模型直到模型收敛;基于当前网络模型,计算每一个无标注样本属于不同类的概率;更新有标注训练样本集和无标注训练样本集;当前轮次训练数的值加1;重复执行步骤7)?10),直到当前轮次训练数达到预先设定的最大轮次训练数;将待分类的图像输入训练好的网络模型,在分类层得到该图像的预

基于深度学习的图像分类方法研究与应用的任务书.docx

基于深度学习的图像分类方法研究与应用的任务书一、任务背景图像分类是计算机视觉领域中的一个重要研究方向,其目的是将输入的图像进行分类,即将图像分类为已知的几个或多个类别之一。在实际应用中,图像分类的应用场景包括但不限于人脸识别、文本字符识别、场景识别、医学图像分类等。近年来,随着深度学习技术的发展,基于深度学习的图像分类方法取得了很大的进展,成为当前最先进的图像分类方法之一。本次课题旨在研究基于深度学习的图像分类方法,以提高图像分类的准确性和效率,实现应用于实际场景中的图像分类任务。二、任务目标本次研究的任