基于特征相关的偏最小二乘特征选择方法.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于特征相关的偏最小二乘特征选择方法.docx

基于特征相关的偏最小二乘特征选择方法基于特征相关的偏最小二乘特征选择方法特征选择在机器学习和模式识别领域中起到了至关重要的作用。通过选择最相关的特征,可以减少计算复杂度并提高分类或回归模型的准确性。偏最小二乘回归(PartialLeastSquaresRegression,PLSR)是一种经典的多元线性回归算法,它在特征选择中也扮演了重要角色。现在,我们将介绍基于特征相关的偏最小二乘特征选择方法。一、偏最小二乘回归偏最小二乘回归是一种经典的多元线性回归算法,它可以在处理多特征数据时起到重要作用。PLSR是

基于特征子集相关度和偏最小二乘法的特征选择策略.docx

基于特征子集相关度和偏最小二乘法的特征选择策略基于特征子集相关度和偏最小二乘法的特征选择策略摘要:特征选择是数据预处理中的关键步骤,它旨在从原始特征中选择出最具有代表性和有效性的特征子集,从而提高模型的性能和减少计算复杂度。本文提出一种基于特征子集相关度和偏最小二乘法的特征选择策略,通过综合考虑特征之间的相关性和预测的目标变量,来选择最佳的特征子集。实验结果表明,该策略在不降低模型性能的同时,可以大大减少特征数量,提高模型的运行效率。1.引言随着数据时代的到来,我们面临着海量的数据和复杂的模型。在这种情况

基于模糊偏最小二乘的特征抽取方法研究的任务书.docx

基于模糊偏最小二乘的特征抽取方法研究的任务书一、课题背景在机器学习领域中,特征抽取是一个非常关键的环节。在许多分类和回归任务中,原始数据往往难以被直接应用,需要通过特征抽取的方式将数据进行转换。特征抽取的主要目的是将数据转换为更具可解释性、更加丰富的特征表示,进而提高算法的鲁棒性和预测性能。在特征抽取的过程中,模糊偏最小二乘(FPLS)方法是一种有效的特征选择方法。FPLS方法采用了模糊数学的思想,并结合了偏最小二乘(PLS)方法和信息熵理论,能够在保证特征相关性的同时,最大化特征的信息量。FPLS方法已

基于非线性偏最小二乘的特征提取方法研究的中期报告.docx

基于非线性偏最小二乘的特征提取方法研究的中期报告这是一份基于非线性偏最小二乘的特征提取方法研究的中期报告,主要介绍了研究的背景、目的和进展情况。一、研究背景在机器学习和模式识别领域,特征提取是关键问题之一。传统的特征提取方法主要是线性的,即通过一些线性变换将原始数据转化为一组更有表征性的特征。但是,线性方法在处理非线性数据时存在局限性,因此非线性特征提取方法逐渐受到关注。二、研究目的本研究旨在探究一种基于非线性偏最小二乘的特征提取方法,用于解决非线性数据分析问题。具体包括以下几个方面:1.理解非线性偏最小

基于偏最小二乘的变量选择方法.pdf

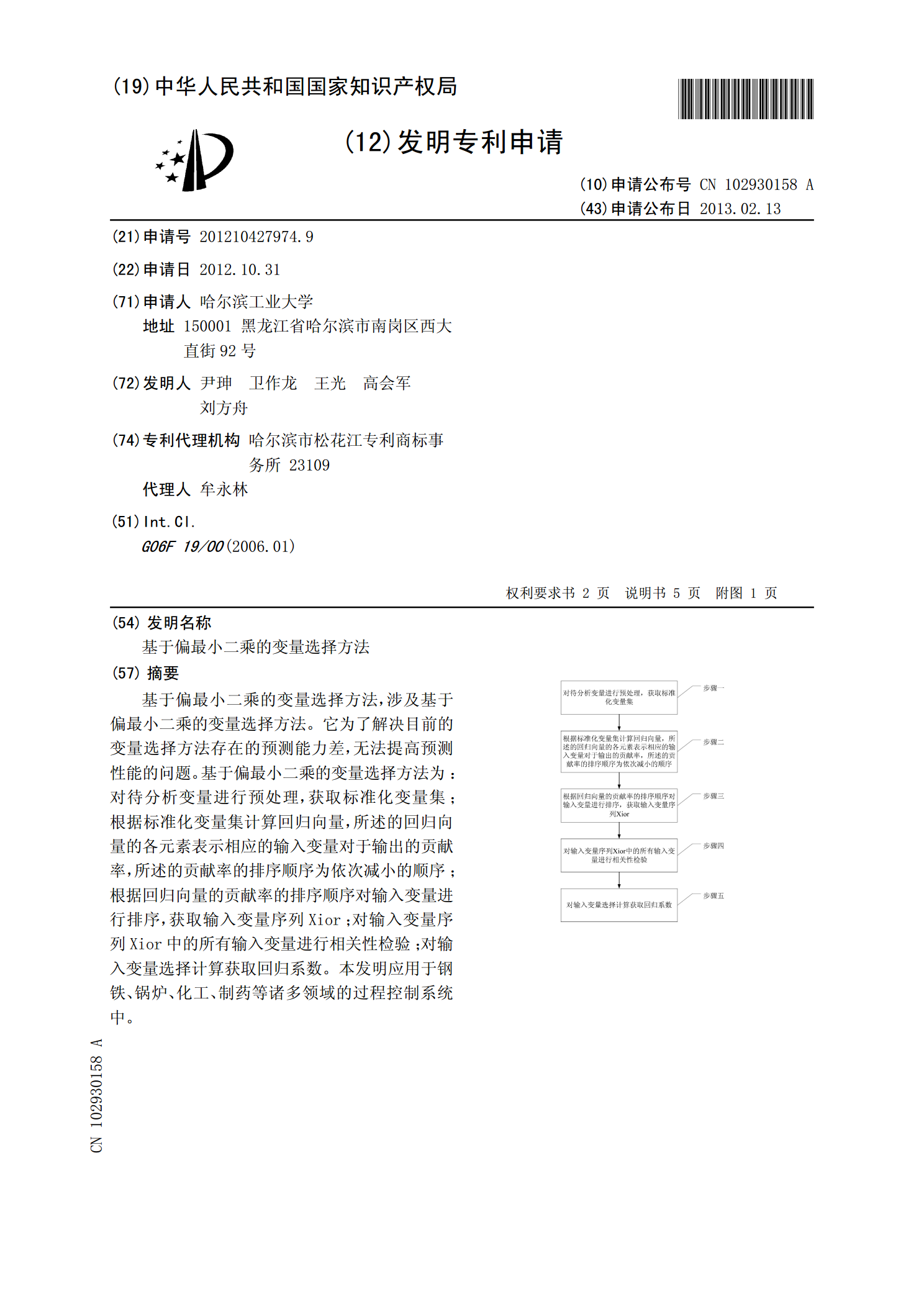

基于偏最小二乘的变量选择方法,涉及基于偏最小二乘的变量选择方法。它为了解决目前的变量选择方法存在的预测能力差,无法提高预测性能的问题。基于偏最小二乘的变量选择方法为:对待分析变量进行预处理,获取标准化变量集;根据标准化变量集计算回归向量,所述的回归向量的各元素表示相应的输入变量对于输出的贡献率,所述的贡献率的排序顺序为依次减小的顺序;根据回归向量的贡献率的排序顺序对输入变量进行排序,获取输入变量序列Xior;对输入变量序列Xior中的所有输入变量进行相关性检验;对输入变量选择计算获取回归系数。本发明应用于