基于RNN的时序数据多步预测方法的研究与应用.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于RNN的时序数据多步预测方法的研究与应用.docx

基于RNN的时序数据多步预测方法的研究与应用基于RNN的时序数据多步预测方法的研究与应用摘要:时序数据的多步预测在许多领域中具有重要的应用价值,例如气象预测、股票市场预测等。RNN(RecurrentNeuralNetwork,循环神经网络)是一种广泛应用于时序数据处理中的机器学习算法。本文主要研究了基于RNN的时序数据多步预测方法,并将其应用于股票市场预测中,取得了较好的效果。本文首先介绍了RNN的基本原理,然后详细介绍了基于RNN的多步预测方法,包括数据预处理、模型设计和训练过程等。最后,通过实验验证

基于RNN的时序数据多步预测方法的研究与应用的任务书.docx

基于RNN的时序数据多步预测方法的研究与应用的任务书任务书任务名称:基于RNN的时序数据多步预测方法的研究与应用任务背景:随着计算机技术的快速发展与数据收集技术的不断提高,大量的时序数据不断涌现,时序数据的分析与预测越来越成为一项重要的任务。其中时序数据的预测更是至关重要,因为预测准确与否直接影响到决策的结果。然而,时序数据预测泛指依据过去的数据预测未来一段时间内的数据,这也就需要考虑序列的相关性。因此,递归神经网络(RNN)在时序预测中表现出了优异的效果。任务内容:本任务主要是研究与应用RNN模型实现时

基于多时间尺度RNN的时序数据预测.docx

基于多时间尺度RNN的时序数据预测基于多时间尺度RNN的时序数据预测摘要:时序数据预测是一项重要的任务,广泛应用于金融预测、天气预报、股票价格预测等领域。近年来,基于循环神经网络(RNN)的模型在时序数据预测中取得了显著的成果。然而,传统的RNN模型对于长期依赖关系的建模能力较弱,容易陷入梯度消失或梯度爆炸问题。为了解决这一问题,本文提出了一种基于多时间尺度RNN的时序数据预测方法,该方法通过在RNN模型中引入多个RNN层以及注意力机制,能够有效地捕捉不同时间尺度下的特征,提高预测准确性。1.引言时序数据

基于DA-RNN的畜禽舍内环境多步滚动预测方法.pdf

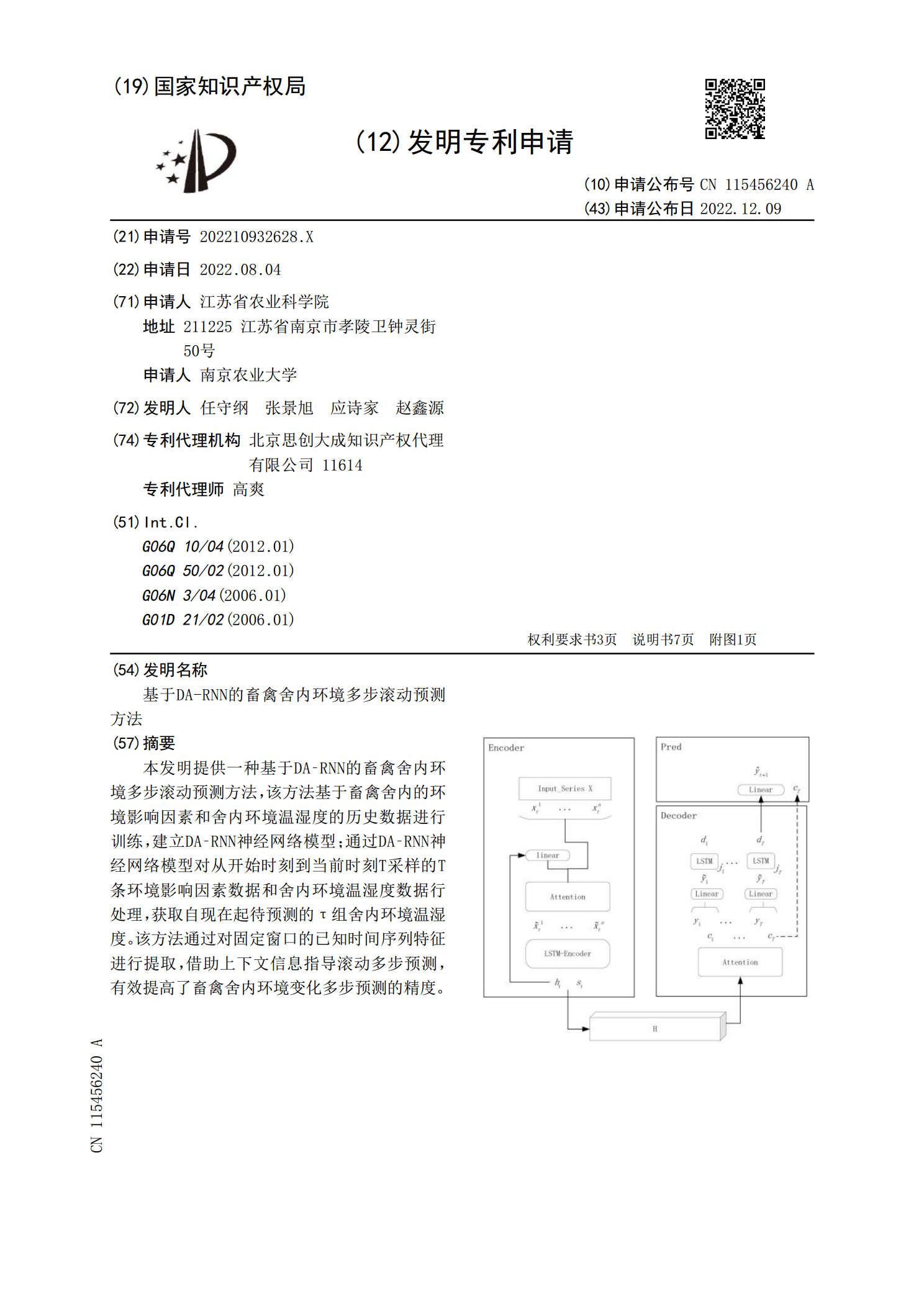

本发明提供一种基于DA‑RNN的畜禽舍内环境多步滚动预测方法,该方法基于畜禽舍内的环境影响因素和舍内环境温湿度的历史数据进行训练,建立DA‑RNN神经网络模型;通过DA‑RNN神经网络模型对从开始时刻到当前时刻T采样的T条环境影响因素数据和舍内环境温湿度数据行处理,获取自现在起待预测的τ组舍内环境温湿度。该方法通过对固定窗口的已知时间序列特征进行提取,借助上下文信息指导滚动多步预测,有效提高了畜禽舍内环境变化多步预测的精度。

基于时序模型的高炉煤气发生量多步预测对比.pptx

基于时序模型的高炉煤气发生量多步预测对比目录添加目录项标题时序模型介绍时序模型的定义和原理时序模型的分类和应用场景时序模型在预测高炉煤气发生量中的重要性高炉煤气发生量多步预测方法多步预测方法的原理和流程基于时序模型的多步预测方法其他多步预测方法介绍和比较实验设计和数据准备数据来源和预处理实验环境和参数设置实验数据集的划分和评估指标实验结果对比和分析基于不同时序模型的预测结果对比不同多步预测方法的预测结果对比预测结果的准确性和稳定性分析预测结果的可解释性和应用价值分析结论和建议基于时序模型的高炉煤气发生量多