基于潜变量优化选择的偏最小二乘回归算法研究.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于潜变量优化选择的偏最小二乘回归算法研究.docx

基于潜变量优化选择的偏最小二乘回归算法研究基于潜变量优化选择的偏最小二乘回归算法研究摘要:在机器学习和数据分析领域,回归分析是一种常用的统计方法,用于预测一个或多个自变量与因变量之间的关系。偏最小二乘回归(partialleastsquaresregression,PLSR)是一种多元线性回归分析方法,广泛应用于多领域的科学研究和实际应用中。本文将针对PLSR算法进行深入研究,并提出基于潜变量优化选择的改进算法。通过实验证明,新算法相比传统PLSR算法在预测准确率和模型解释性方面均取得了显著的提升。关键词

基于潜变量优化选择的偏最小二乘回归算法研究的开题报告.docx

基于潜变量优化选择的偏最小二乘回归算法研究的开题报告一、选题背景及意义近年来,数据挖掘技术已经成为科学研究、工业制造、金融投资、医疗健康等领域的重要工具之一,其应用越来越广泛。在大量数据中发现规律、提取特征、预测结果是数据挖掘技术的主要任务之一。回归分析是一种常见的数据挖掘技术,在许多领域都能得到广泛应用。偏最小二乘回归算法是一种典型的回归分析方法,可以同时考虑自变量和因变量之间的关系,且优化结果具有很高的精度。然而,随着数据规模的增加和数据维度的增加,先进的回归分析方法在运算效率和稳定性上都有一定的局限

基于偏最小二乘的变量选择方法.pdf

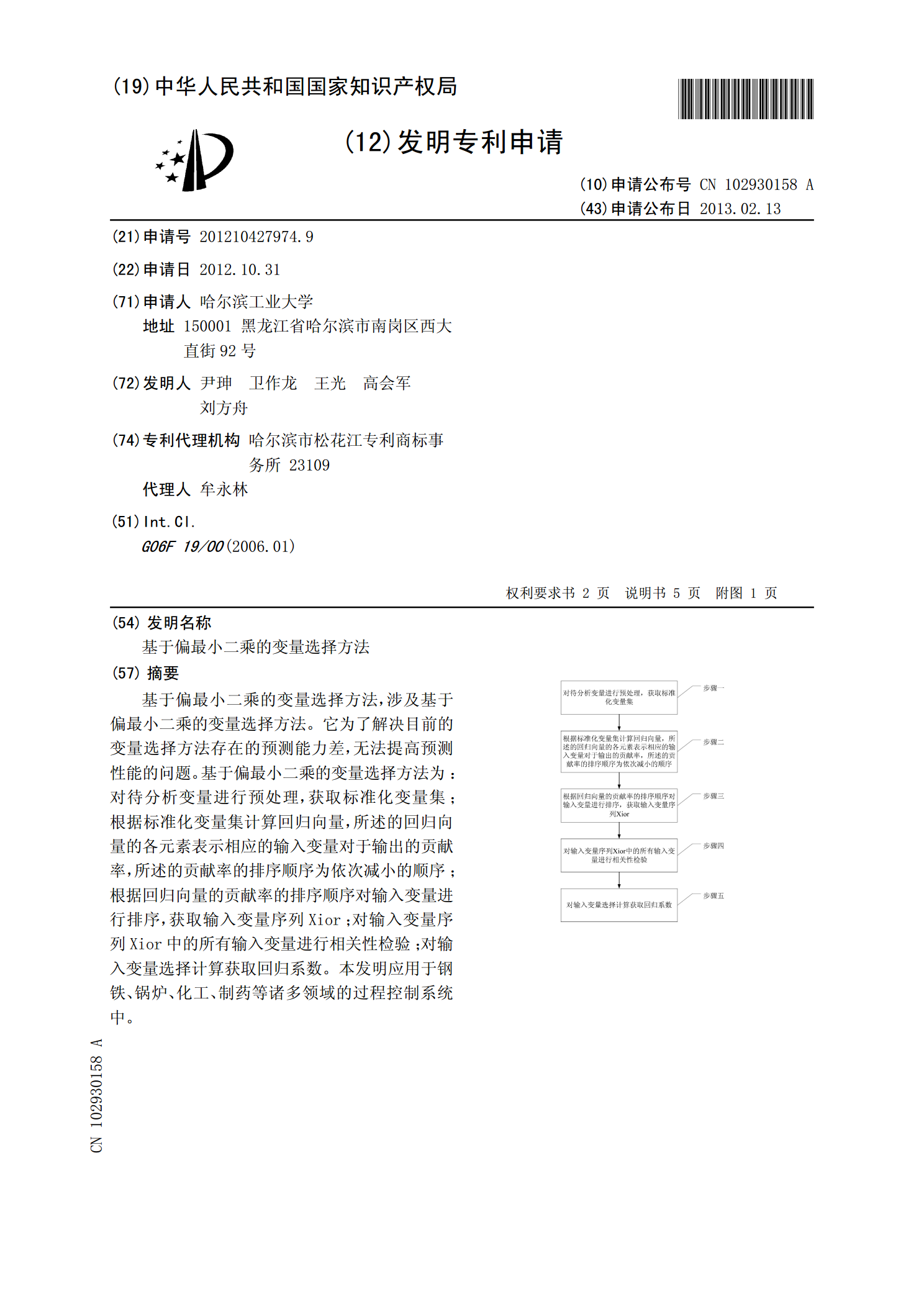

基于偏最小二乘的变量选择方法,涉及基于偏最小二乘的变量选择方法。它为了解决目前的变量选择方法存在的预测能力差,无法提高预测性能的问题。基于偏最小二乘的变量选择方法为:对待分析变量进行预处理,获取标准化变量集;根据标准化变量集计算回归向量,所述的回归向量的各元素表示相应的输入变量对于输出的贡献率,所述的贡献率的排序顺序为依次减小的顺序;根据回归向量的贡献率的排序顺序对输入变量进行排序,获取输入变量序列Xior;对输入变量序列Xior中的所有输入变量进行相关性检验;对输入变量选择计算获取回归系数。本发明应用于

基于变量筛选的偏最小二乘回归方法及其应用.docx

基于变量筛选的偏最小二乘回归方法及其应用背景和意义在实际问题中,我们通常遇到自变量和因变量之间存在高维度和多重共线性的情况。在这种情况下,线性模型的拟合效果通常很差,需要采用特殊的方法来降低变量的维度,同时避免信息丢失。基于变量筛选的偏最小二乘回归方法(variableselectionpartialleastsquaresregression,VSPLS)就是一种可以应对这类问题的方法。本论文旨在介绍VSPLS的基本原理和实现方法,同时提供一个具体的应用案例。该案例研究采用VSPLS来分析医疗影像数据,

偏最小二乘回归的研究.docx

偏最小二乘回归的研究偏最小二乘回归(partialleastsquaresregression,PLS)是一种应用于多元回归分析的统计方法,它可以用来构建一个线性模型,同时考虑多个自变量之间的相关性和影响。相对于传统的线性回归方法,PLS在特征选择和变量筛选上更加优秀,因此广泛应用于化学、生物、医学等领域。一、偏最小二乘回归的基本原理1.背景PLS源于20世纪70年代,最初是为了解决光谱学中存在的数据高度共线性的问题,后来被广泛应用于多元分析领域中。与传统的多元回归方法不同,PLS能够同时考虑多个自变量之