基于深度学习和边缘检测的动态场景下鲁棒SLAM.docx

骑着****猪猪

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于深度学习和边缘检测的动态场景下鲁棒SLAM.docx

基于深度学习和边缘检测的动态场景下鲁棒SLAM摘要本文针对动态场景下鲁棒SLAM的研究进行探讨,综述了现有的一些方法,并提出一种基于深度学习和边缘检测的鲁棒SLAM方法。该方法利用深度学习技术提取场景特征,结合边缘检测算法实现鲁棒的特征匹配和姿态估计。实验表明,该方法可以在动态场景下实现良好的鲁棒性和可靠性。关键词:鲁棒SLAM;深度学习;边缘检测;动态场景AbstractThispaperexploresthestudyofrobustSLAMindynamicscenes,summarizessome

基于深度学习的动态场景语义SLAM研究.docx

基于深度学习的动态场景语义SLAM研究基于深度学习的动态场景语义SLAM研究摘要:近年来,随着机器学习和深度学习的发展,语义SLAM(SimultaneousLocalizationandMapping)成为了人们关注的热点领域之一。传统的SLAM算法主要是利用传感器融合技术对静态环境进行建模定位和地图构建。然而,在动态环境中,传统的SLAM算法往往无法准确地识别和建模动态物体。本文提出了一种基于深度学习的动态场景语义SLAM方法,该方法可以实时地跟踪和识别动态物体,并将其加入到地图构建和定位过程中。实验

基于深度学习的动态场景语义SLAM研究的任务书.docx

基于深度学习的动态场景语义SLAM研究的任务书一、任务背景动态场景语义SLAM(SimultaneousLocalizationandMapping)是指在动态场景下,通过利用相机等传感器数据和深度学习等技术,综合实现机器人在无人区间、室内、城市环境等场景中自动导航、定位、建图和物品识别等任务的技术。该技术已被应用于无人驾驶汽车、智能家居、工业自动化和机器人领域,是未来智能化发展的重要方向。二、任务目标本研究旨在探究基于深度学习的动态场景语义SLAM技术,以提高机器人在复杂场景下的自主性和感知能力,解决动

基于语义信息和边缘一致性的鲁棒SLAM算法.docx

基于语义信息和边缘一致性的鲁棒SLAM算法基于语义信息和边缘一致性的鲁棒SLAM算法摘要:随着视觉导航和增强现实等领域的快速发展,同时也提出了对鲁棒性和准确性的更高要求。SLAM(SimultaneousLocalizationandMapping)算法作为一种可以实时获取相机自身位姿和环境地图的技术,在这些应用中起到了至关重要的作用。然而,传统的SLAM算法在复杂的场景中往往会遭遇到标记点稀疏、遮挡问题以及对动态物体的处理困难等挑战。为了解决这些问题,本论文提出了一种基于语义信息和边缘一致性的鲁棒SLA

一种动态场景下基于目标检测和几何概率的视觉SLAM方法.pdf

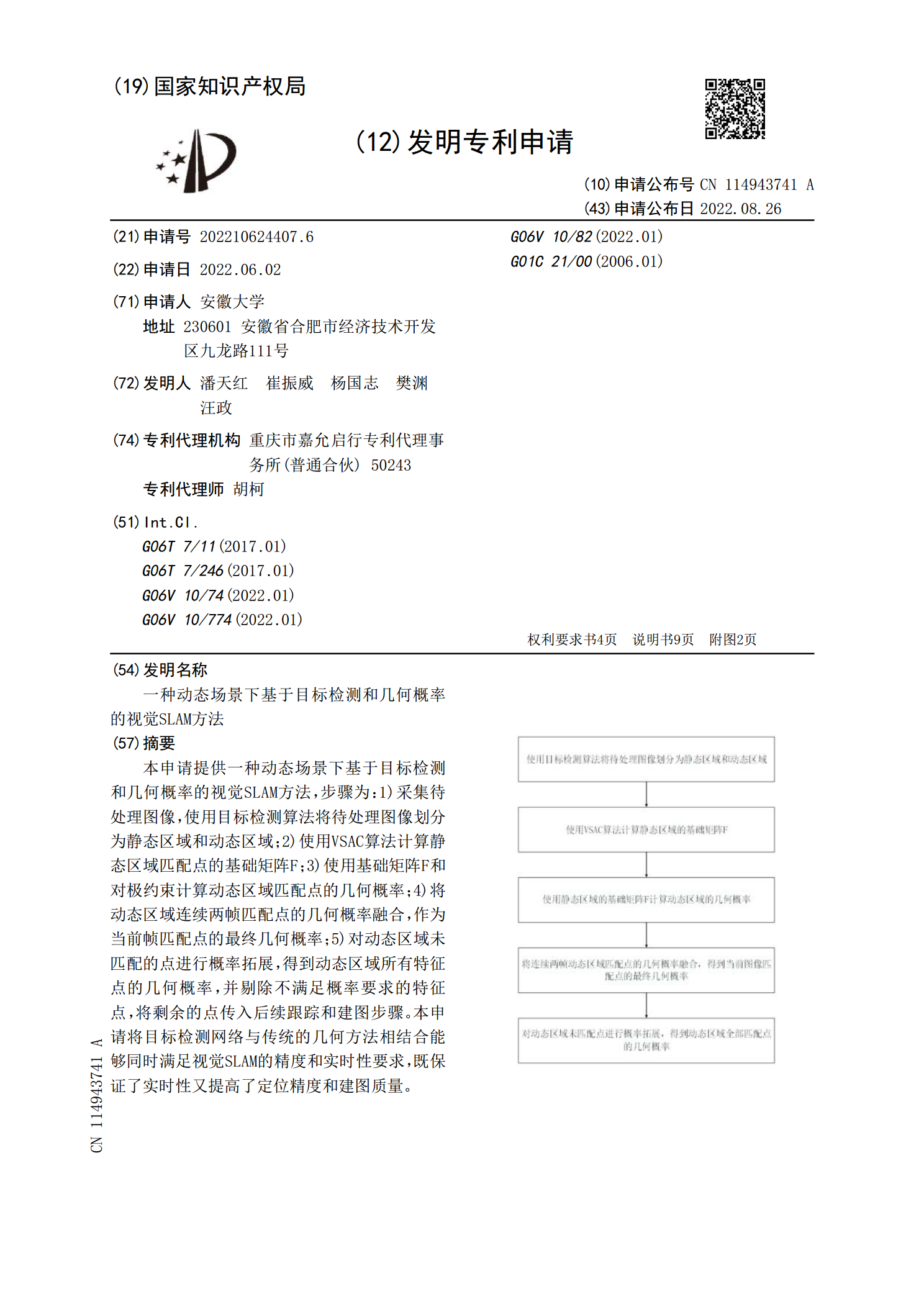

本申请提供一种动态场景下基于目标检测和几何概率的视觉SLAM方法,步骤为:1)采集待处理图像,使用目标检测算法将待处理图像划分为静态区域和动态区域;2)使用VSAC算法计算静态区域匹配点的基础矩阵F;3)使用基础矩阵F和对极约束计算动态区域匹配点的几何概率;4)将动态区域连续两帧匹配点的几何概率融合,作为当前帧匹配点的最终几何概率;5)对动态区域未匹配的点进行概率拓展,得到动态区域所有特征点的几何概率,并剔除不满足概率要求的特征点,将剩余的点传入后续跟踪和建图步骤。本申请将目标检测网络与传统的几何方法相结