基于残差级联网络的图像分类方法研究的开题报告.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于残差级联网络的图像分类方法研究的开题报告.docx

基于残差级联网络的图像分类方法研究的开题报告摘要:图像分类是计算机视觉领域的重要研究方向之一,应用广泛。近年来,深度学习模型的出现引领了计算机视觉领域的发展,并在图像分类任务上取得了显著的表现。基于残差级联网络的图像分类方法,是目前深度学习模型中的一种重要方法,能够有效地解决深度学习模型中的梯度消失和模型退化等问题。本文将从残差级联网络的基本原理、相关技术及其在图像分类中的应用,进行研究,以期探究其效果和优化方法。关键词:深度学习;残差级联网络;图像分类;梯度消失;模型退化一、研究背景图像分类是计算机视觉

基于残差神经网络的图像分类方法.pdf

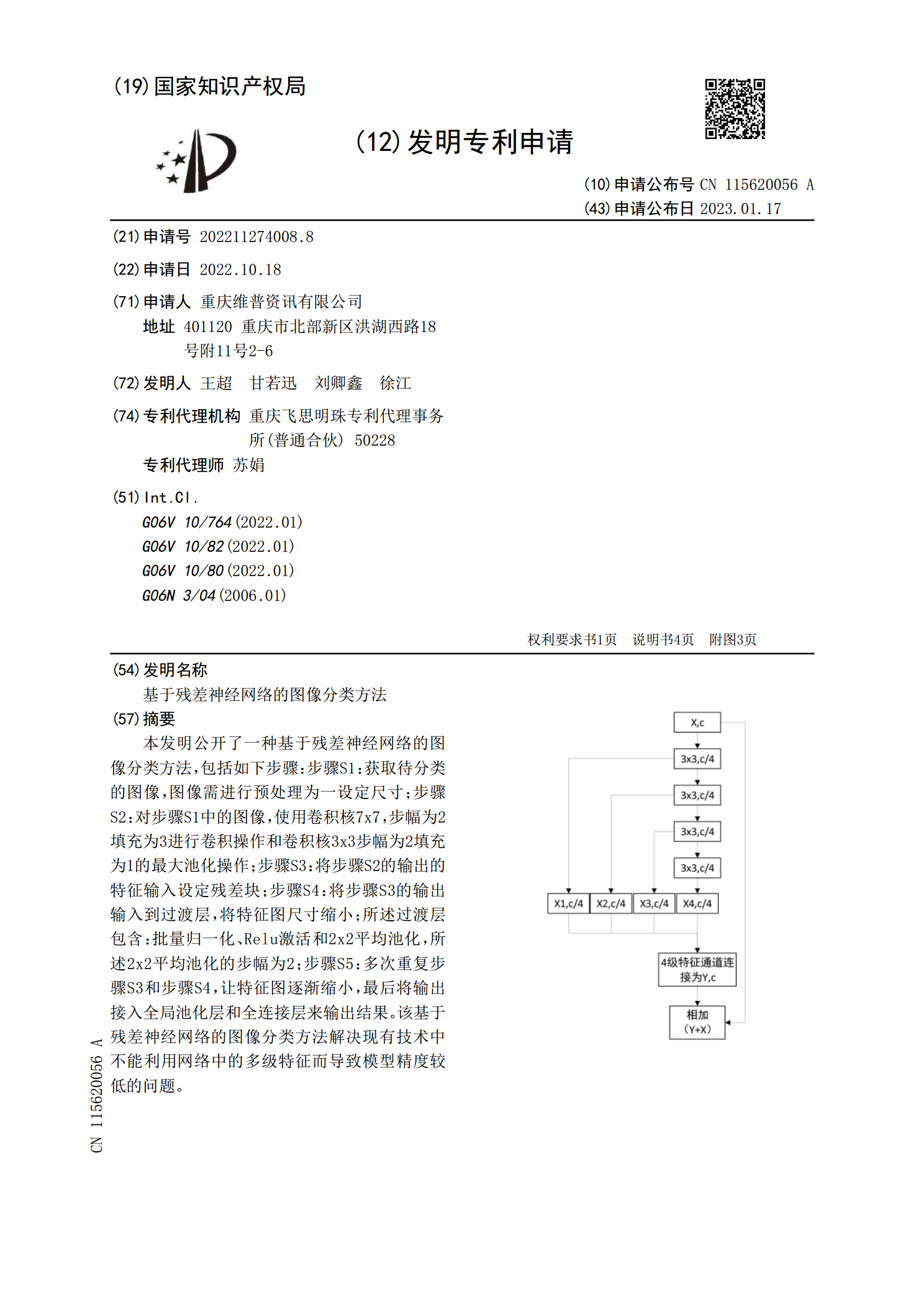

本发明公开了一种基于残差神经网络的图像分类方法,包括如下步骤:步骤S1:获取待分类的图像,图像需进行预处理为一设定尺寸;步骤S2:对步骤S1中的图像,使用卷积核7x7,步幅为2填充为3进行卷积操作和卷积核3x3步幅为2填充为1的最大池化操作;步骤S3:将步骤S2的输出的特征输入设定残差块;步骤S4:将步骤S3的输出输入到过渡层,将特征图尺寸缩小;所述过渡层包含:批量归一化、Relu激活和2x2平均池化,所述2x2平均池化的步幅为2;步骤S5:多次重复步骤S3和步骤S4,让特征图逐渐缩小,最后将输出接入全局

基于残差网络的虹膜图像性别分类.pptx

基于残差网络的虹膜图像性别分类目录残差网络的基本原理残差块的基本结构残差网络的优势残差网络在虹膜图像性别分类中的应用虹膜图像预处理图像采集图像预处理步骤数据增强基于残差网络的虹膜图像性别分类模型模型构建模型训练过程模型评估指标实验结果与分析实验数据集实验结果展示结果分析对比其他算法结论与展望研究结论研究不足与展望THANKYOU

基于残差网络的高光谱图像分类算法研究与应用.docx

基于残差网络的高光谱图像分类算法研究与应用基于残差网络的高光谱图像分类算法研究与应用摘要:高光谱图像分类是一项重要的研究领域,它在农业、环境监测、遥感等领域具有广泛的应用潜力。传统的高光谱图像分类算法存在着提取特征困难、分类准确性差等问题。为了解决传统算法的局限性,本文提出了一种基于残差网络的高光谱图像分类算法。实验结果表明,该算法能够有效提高图像分类准确率,具有较高的应用价值。1.引言高光谱图像具有大量的光谱波段,能够提供丰富的光谱信息和空间分辨率,因此在农业、环境监测、遥感等领域具有广泛的应用。高光谱

基于改进深度残差网络的矿井图像分类.pptx

,CONTENTS01.02.深度残差网络介绍残差块结构深度残差网络的优势03.引入注意力机制使用不同的激活函数增加网络深度或宽度优化训练策略04.矿井环境特点图像分类的难点分类需求与目标05.数据预处理模型结构设计模型训练与优化模型评估与对比06.实验设置与数据集实验结果展示结果分析性能对比07.研究成果总结未来研究方向感谢您的观看!