基于计算听觉场景分析的单声道语音分离的中期报告.docx

快乐****蜜蜂

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

基于计算听觉场景分析的单声道语音分离的中期报告.docx

基于计算听觉场景分析的单声道语音分离的中期报告1.研究背景和目的单声道语音分离是指从混合语音中分离出目标说话者的语音信号。在实际场景中,混合语音的干扰因素很多,例如说话者重叠、环境噪声、房间共鸣等,这会给语音信号分离带来很大的挑战。为了解决这个问题,基于计算听觉场景分析的单声道语音分离被提出。本文旨在探讨如何利用计算机算法对听觉场景进行分析,并将分析结果应用于单声道语音分离中,以提高分离效果。2.实验设计本次实验使用了TESS数据集,该数据集包含了两个说话人的语音片段,并在一定程度上模拟了现实场景中的噪声

基于计算听觉场景分析的混合语音信号分离算法研究的中期报告.docx

基于计算听觉场景分析的混合语音信号分离算法研究的中期报告本研究旨在探究基于计算听觉场景分析的混合语音信号分离算法。本中期报告将介绍已完成的工作,并讨论未来的研究方向。I.已完成的工作1.收集数据集。我们使用了TIMIT语音数据库,其中包含了多种语音性质、多说话人和多方言的语音数据。2.实现基于计算听觉场景分析的算法。我们使用了两种方法进行混合语音信号分离:单通道盲源分离(SC-BSS)和多通道盲源分离(MC-BSS)。特别地,我们采用了计算听觉场景分析来提取语音信号的特征,并使用了稀疏编码和重构技术来分离

一种基于计算听觉场景分析的单通道语音盲分离方法.pdf

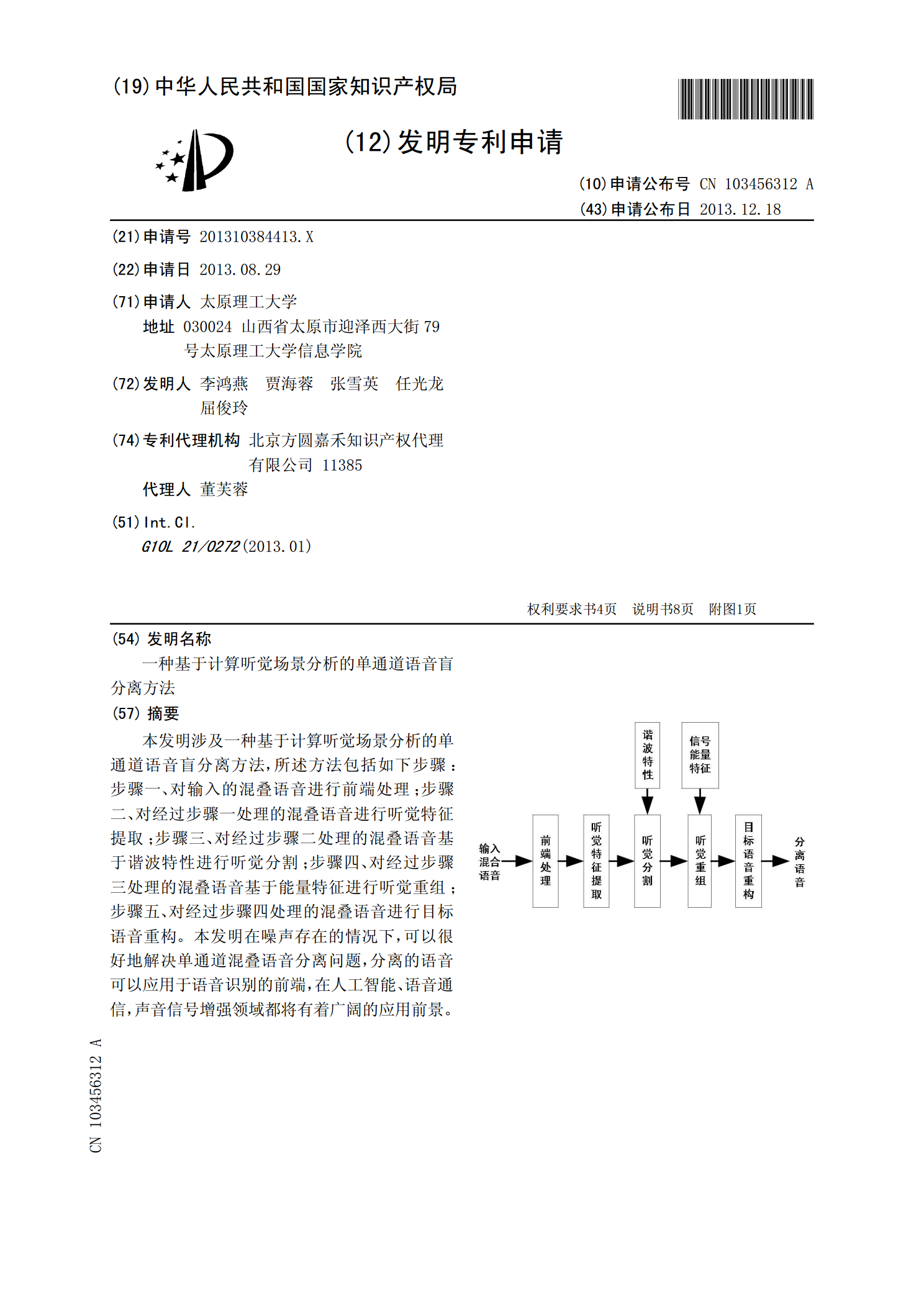

本发明涉及一种基于计算听觉场景分析的单通道语音盲分离方法,所述方法包括如下步骤:步骤一、对输入的混叠语音进行前端处理;步骤二、对经过步骤一处理的混叠语音进行听觉特征提取;步骤三、对经过步骤二处理的混叠语音基于谐波特性进行听觉分割;步骤四、对经过步骤三处理的混叠语音基于能量特征进行听觉重组;步骤五、对经过步骤四处理的混叠语音进行目标语音重构。本发明在噪声存在的情况下,可以很好地解决单通道混叠语音分离问题,分离的语音可以应用于语音识别的前端,在人工智能、语音通信,声音信号增强领域都将有着广阔的应用前景。

基于计算听觉场景分析的混合语音信号分离算法研究的任务书.docx

基于计算听觉场景分析的混合语音信号分离算法研究的任务书一、选题背景混合语音信号是指多个语音信号混合在一起,导致难以分辨每个语音信号的内容。混合语音信号在许多领域都有着广泛的应用,比如人类的语音交流、电话会议、语音识别等。然而,在混合语音信号的处理过程中,如何对信号进行分离是一个重要的问题,需要借助计算机技术进行处理。目前,常用的混合语音信号分离算法有基于盲源分离的方法、基于模型的方法、基于深度学习的方法等。其中,基于深度学习的方法在分离效果和计算效率方面表现出优势,成为了当前研究的热点。本项目旨在基于计算

基于听觉特性的语音增强算法研究的中期报告.docx

基于听觉特性的语音增强算法研究的中期报告一、研究背景和意义语音增强算法是语音处理领域的热门研究方向,其主要目的是提高语音信号的质量和可懂度,从而更好地应用于语音识别、语音合成、语音通信和语音翻译等领域。传统的语音增强算法主要基于时间域或频域的方法,然而这些方法并不能充分利用人类听觉系统的特性,限制了语音增强算法的性能和效果。基于听觉特性的语音增强算法是近年来的研究热点之一,该方法结合了听觉神经生理学与信号处理的理论,以人类听觉系统的特性为基础,建立起了一系列新的处理模型和算法,以获取更好的语音增强效果和听