基于多尺度融合轻量化深度学习卷积网络的目标检测方法.pdf

羽沫****魔王

亲,该文档总共11页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于多尺度融合轻量化深度学习卷积网络的目标检测方法.pdf

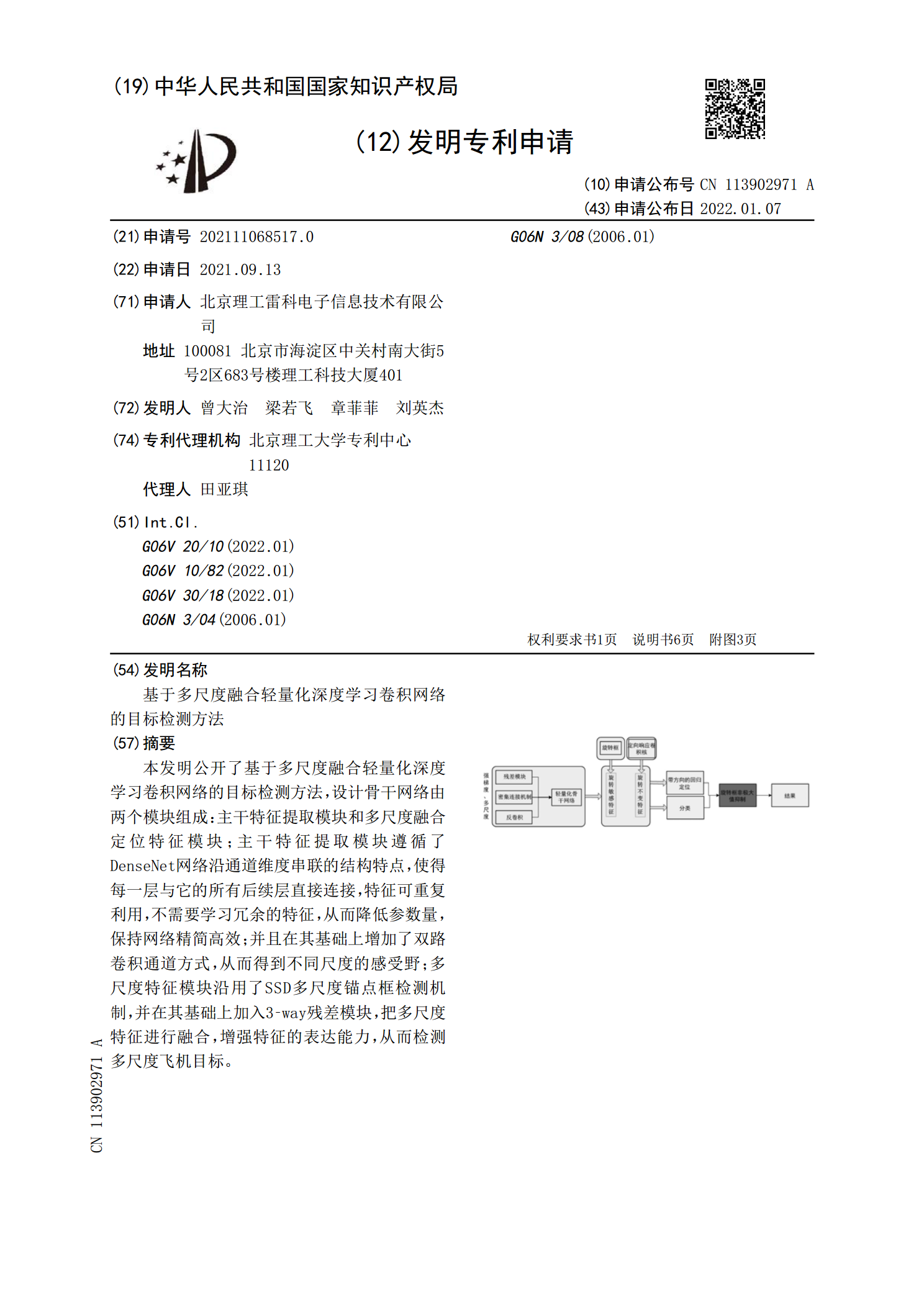

本发明公开了基于多尺度融合轻量化深度学习卷积网络的目标检测方法,设计骨干网络由两个模块组成:主干特征提取模块和多尺度融合定位特征模块;主干特征提取模块遵循了DenseNet网络沿通道维度串联的结构特点,使得每一层与它的所有后续层直接连接,特征可重复利用,不需要学习冗余的特征,从而降低参数量,保持网络精简高效;并且在其基础上增加了双路卷积通道方式,从而得到不同尺度的感受野;多尺度特征模块沿用了SSD多尺度锚点框检测机制,并在其基础上加入3‑way残差模块,把多尺度特征进行融合,增强特征的表达能力,从而检测多

基于深度融合模型的多尺度目标检测方法研究.docx

基于深度融合模型的多尺度目标检测方法研究基于深度融合模型的多尺度目标检测方法研究摘要:目标检测技术在计算机视觉领域中具有重要的应用价值。传统的目标检测方法在处理不同尺度目标时存在一定的局限性。为此,本文提出了基于深度融合模型的多尺度目标检测方法,通过融合不同尺度的特征信息来提升目标检测的性能。首先,介绍了目标检测的相关背景和研究现状。然后,分析了传统目标检测方法在处理多尺度目标时面临的挑战。接着,详细介绍了基于深度融合模型的多尺度目标检测方法的设计和实现。最后,通过实验验证了所提方法的有效性和性能优势。关

基于3D卷积的多尺度注意力深度卷积网络的遥感图像融合方法.pdf

本发明公开了一种基于3D卷积的多尺度注意力深度卷积网络的遥感图像融合方法,将多光谱图像中拥有的高光谱分辨率与全色图像中拥有的高空间分辨率相融合,以获得高空间分辨率高光谱分辨率的多光谱图像。利用深度学习中U‑Net网络结构框架,设计了3D多尺度注意力深度卷积网络模型(MSAC‑Net)。为了保留多光谱中的光谱分辨率,模型整体使用3D卷积,对光谱维度上的信息进行特征提取;为了捕捉更多的空间细节,在模型的跳跃连接处引入了注意力机制,来学习区域细节。在模型的解码阶段,引入多个包含多尺度空间信息的重建层来计算重建结

基于轻量化网络的遥感影像多尺度目标检测识别方法.pdf

本发明公开了一种基于轻量化网络的遥感影像多尺度目标检测识别方法,包括以下步骤:对获取的遥感图像进行预处理;基于深度可分离卷积替换特征提取主干和检测分枝中的标准卷积过程,并将处理后的图像输入卷积神经网络进行特征提取;采用特征金字塔,从卷积神经网络不同层抽取不同尺度特征图像进行预测,融合不同层检测结果,得到多尺度融合特征图;在特征图上设置候选框,生成预测张量,基于此预测目标所属类别的置信度及位置信息。通过引入深度可分离卷积,减少模型参数,提升网络检测速度;提取多个尺度特征图,满足不同尺度目标检测需求;将语义信

基于深度融合模型的多尺度目标检测方法研究的开题报告.docx

基于深度融合模型的多尺度目标检测方法研究的开题报告一、选题背景目标检测是计算机视觉领域中的一个重要问题。在现实生活中,图像和视频中的目标实体数量和种类非常繁多,涵盖了很多领域,如视频监控、交通管理、医疗应用等。基于深度学习的目标检测方法凭借其高准确性和高效性在近年受到了广泛关注,其中基于深度融合模型(如FasterR-CNN、YOLO等)的目标检测方法成为了当前的主流方法。尽管基于深度学习的目标检测方法在很多情况下表现良好,但是在一些场景中仍然存在一些问题。例如,在检测视频中的目标时,由于视频场景中目标的