基于单目RGB-D特征和强化学习的端到端自动驾驶决策方法.pdf

秋花****姐姐

亲,该文档总共21页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于单目RGB-D特征和强化学习的端到端自动驾驶决策方法.pdf

本发明公开了基于单目RGB‑D特征和强化学习的端到端自动驾驶决策方法,包括:获取RGB图像,将RGB图像输入至预先训练好的图像特征提取网络和预先训练好的单目深度特征提取网络;预先训练好的图像特征提取网络对RGB图像进行特征提取得到第一图像特征,预先训练好单目深度特征提取网络对RGB图像进行特征提取得到第一深度特征;对图像特征和深度特征进行RGB‑D特征融合,得到融合后的第一特征向量;将融合后的第一特征向量和预先存储的历史动作向量拼接得到第一状态向量,并将第一状态向量输入至预先训练好的智能体网络得到Q值,根

联合图像与单目深度特征的强化学习端到端自动驾驶决策方法.pptx

添加副标题目录PART01图像特征提取单目深度特征提取特征融合方法特征融合效果评估PART02强化学习基本原理深度强化学习算法自动驾驶决策模型模型训练与优化PART03端到端决策方法的优势联合图像与单目深度特征在决策中的作用决策模型与车辆控制系统的集成实验验证与结果分析PART04自动驾驶技术的发展趋势本方法在自动驾驶领域的应用前景未来研究方向与挑战感谢您的观看

基于深度强化学习的端到端自动驾驶技术研究.docx

基于深度强化学习的端到端自动驾驶技术研究标题:基于深度强化学习的端到端自动驾驶技术研究摘要:自动驾驶技术正引领着智能交通系统的未来发展,而深度强化学习作为一种强大的机器学习方法,已被广泛应用于自动驾驶领域。本论文旨在探索基于深度强化学习的端到端自动驾驶技术。首先,我们将介绍深度强化学习的基本原理和自动驾驶的发展现状。接着,我们详细阐述了端到端自动驾驶技术的优势和挑战,并分析了深度强化学习在端到端自动驾驶中的应用。最后,我们提出了一种基于深度强化学习的端到端自动驾驶系统,并对其进行实验验证。关键词:深度强化

一种基于驾驶先验知识的端到端自动驾驶决策方法.pdf

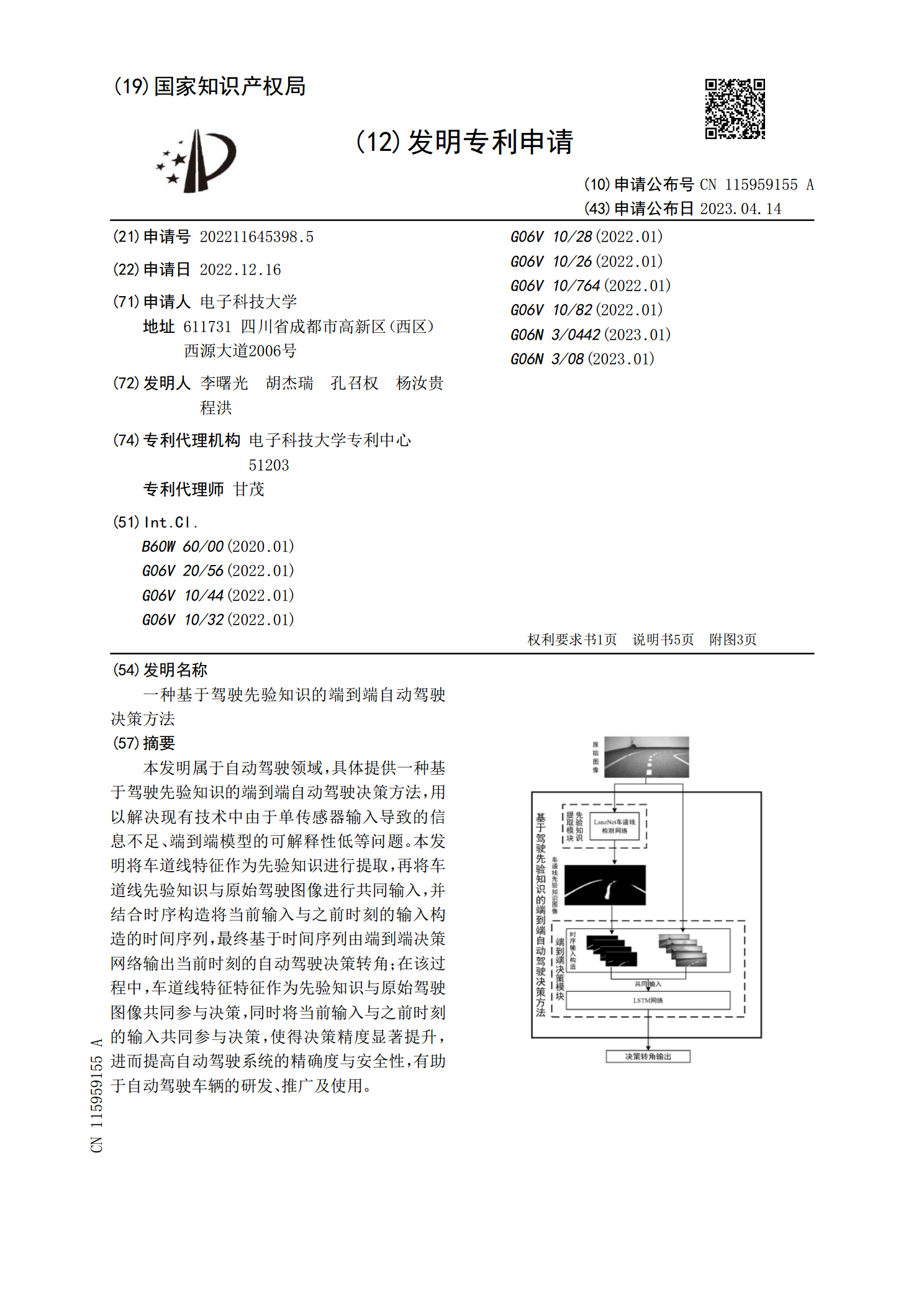

本发明属于自动驾驶领域,具体提供一种基于驾驶先验知识的端到端自动驾驶决策方法,用以解决现有技术中由于单传感器输入导致的信息不足、端到端模型的可解释性低等问题。本发明将车道线特征作为先验知识进行提取,再将车道线先验知识与原始驾驶图像进行共同输入,并结合时序构造将当前输入与之前时刻的输入构造的时间序列,最终基于时间序列由端到端决策网络输出当前时刻的自动驾驶决策转角;在该过程中,车道线特征特征作为先验知识与原始驾驶图像共同参与决策,同时将当前输入与之前时刻的输入共同参与决策,使得决策精度显著提升,进而提高自动驾

基于MM-STConv的端到端自动驾驶行为决策模型.docx

基于MM-STConv的端到端自动驾驶行为决策模型摘要:自动驾驶技术的快速发展促进了金融、物流、交通等领域的快速发展,成为未来发展的热点。在自动驾驶行为决策方面,端到端模型能够直接从传感器输入到决策输出,实现一站式的处理,具有快速、可靠的特点。本文基于MM-STConv提出了一种端到端自动驾驶行为决策模型,经过实验验证,该模型表现出了较好的决策性能,具有很好的应用前景。关键词:端到端模型,自动驾驶,行为决策,MM-STConv1.介绍自动驾驶技术的快速发展使得它成为了一个热门的话题。自动驾驶技术不仅有助于