网络模型训练方法、装置和计算机可读存储介质.pdf

一吃****仕龙

亲,该文档总共18页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

网络模型训练方法、装置和计算机可读存储介质.pdf

本发明公开了网络模型训练方法、装置和计算机可读存储介质,通过对预训练模型依次进行自监督预训练、领域数据微调和知识蒸馏,即使用海量数据无监督预训练超大规模神经网络模型,利用有限标注样本对预训练模型进行微调,使用知识蒸馏方法将微调后的超大模型压缩为目标模型,即满足目标设备的部署要求。基于此,可以减少对标注数据的依赖,降低人工标注的成本,可以解决人工标注数据成本高的问题,并可以提高模型的通用性和泛化性,使得本发明输出的目标模型在目标任务上的精度超越了原定制化模型。

分类模型的训练方法,装置和计算机可读存储介质.pdf

本公开涉及一种分类模型的训练方法,装置和计算机可读存储介质,涉及人工智能技术领域。本公开的方法包括:将用于训练的样本划分为多个子批,其中,每个子批包括一个或多个样本;将每个子批的样本输入分类模型,确定每个子批对应的分类误差相对于分类模型的初始化参数的梯度向量;根据每个子批对应的梯度向量,确定目标函数的值,其中,目标函数与分类模型的分类损失负相关;在目标函数的值未达到最大值的情况下,根据目标函数调整分类模型的初始化参数;直至目标函数的值达到最大值,将分类模型的初始化参数作为优化后的初始化参数,并对具有优化后

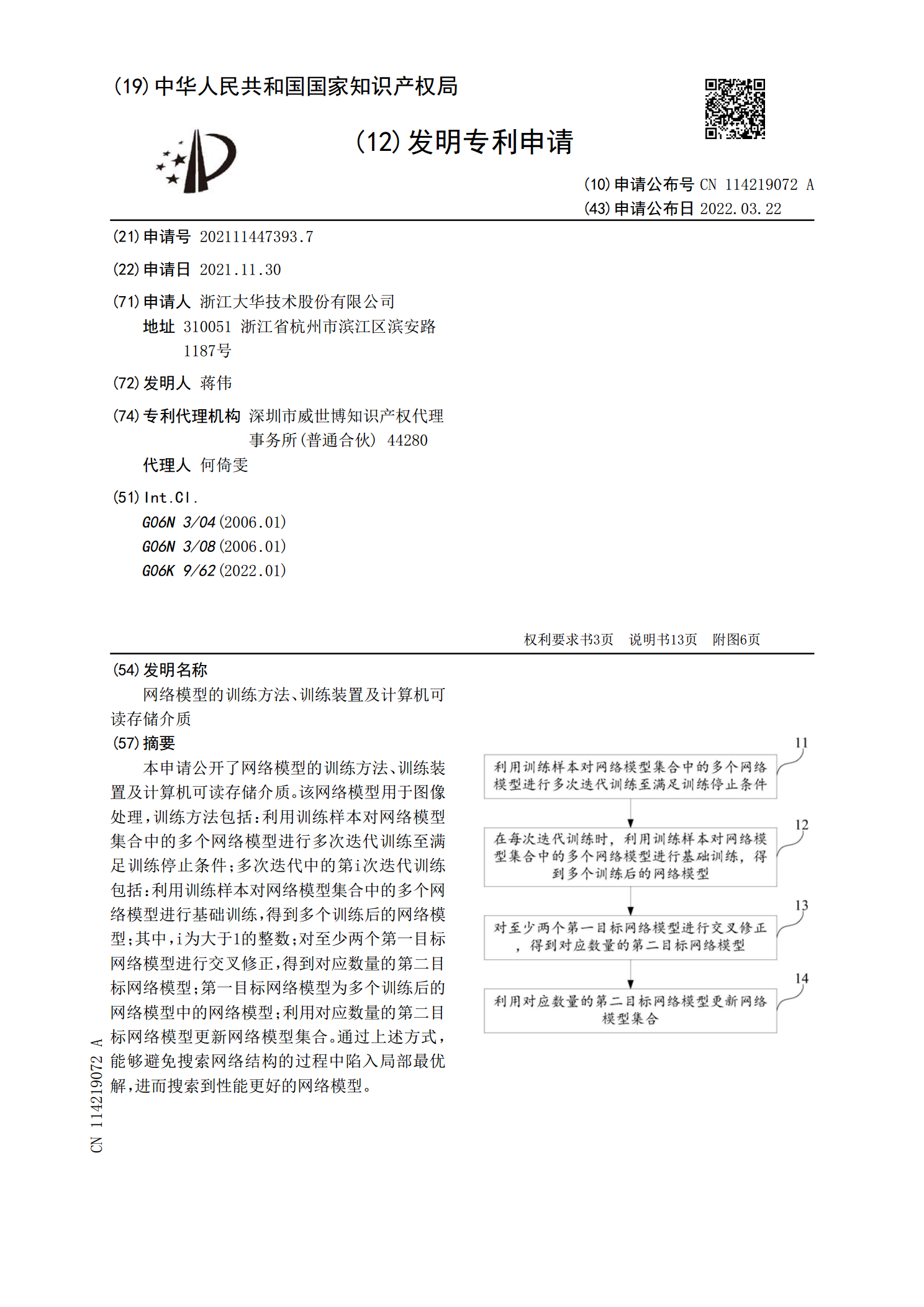

网络模型的训练方法、训练装置及计算机可读存储介质.pdf

本申请公开了网络模型的训练方法、训练装置及计算机可读存储介质。该网络模型用于图像处理,训练方法包括:利用训练样本对网络模型集合中的多个网络模型进行多次迭代训练至满足训练停止条件;多次迭代中的第i次迭代训练包括:利用训练样本对网络模型集合中的多个网络模型进行基础训练,得到多个训练后的网络模型;其中,i为大于1的整数;对至少两个第一目标网络模型进行交叉修正,得到对应数量的第二目标网络模型;第一目标网络模型为多个训练后的网络模型中的网络模型;利用对应数量的第二目标网络模型更新网络模型集合。通过上述方式,能够避免

神经网络模型训练方法、计算机可读存储介质和设备.pdf

本发明提供一种用于检测脑部CTA图像中血管病灶的神经网络模型训练方法,包括:获取多个患者的脑部CTA图像和脑部DSA图像;获得各所述脑部DSA图像的第一血管病灶信息;获得各所述脑部CTA图像和脑部DSA图像的空间位置映射关系;根据所述空间位置映射关系将所述第一血管病灶信息映射到所述脑部CTA图像上,获得各所述脑部CTA图像的目标血管病灶信息;获取训练样本,所述训练样本包括各所述脑部CTA图像和各所述脑部CTA图像的目标血管病灶信息;获取初始神经网络模型,将各所述脑部CTA图像作为输入样本,将各所述目标血管

模型的训练方法、装置、计算设备及计算机可读存储介质.pdf

本说明书一个或多个实施例提供了一种模型的训练方法、装置、计算设备及计算机可读存储介质。在一种实施例中,一种模型的训练方法所训练的模型包括三个子模型,训练样本包括存储于存储空间中的有标签样本集和无标签样本集,在计算设备执行每一轮模型训练的过程中,针对每个子模型,利用有标签样本集和该子模型对应的伪标签样本集对该子模型进行训练,利用该子模型以外的其它两个子模型针对测试样本集的测试结果和针对无标签样本集的预测结果,更新该子模型的伪标签样本集,直到每个伪标签样本集中均不再有新的样本加入时,模型训练结束,得到最终的模