特效视频的生成方法、装置、设备及存储介质.pdf

灵波****ng

亲,该文档总共15页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

特效视频的生成方法、装置、设备及存储介质.pdf

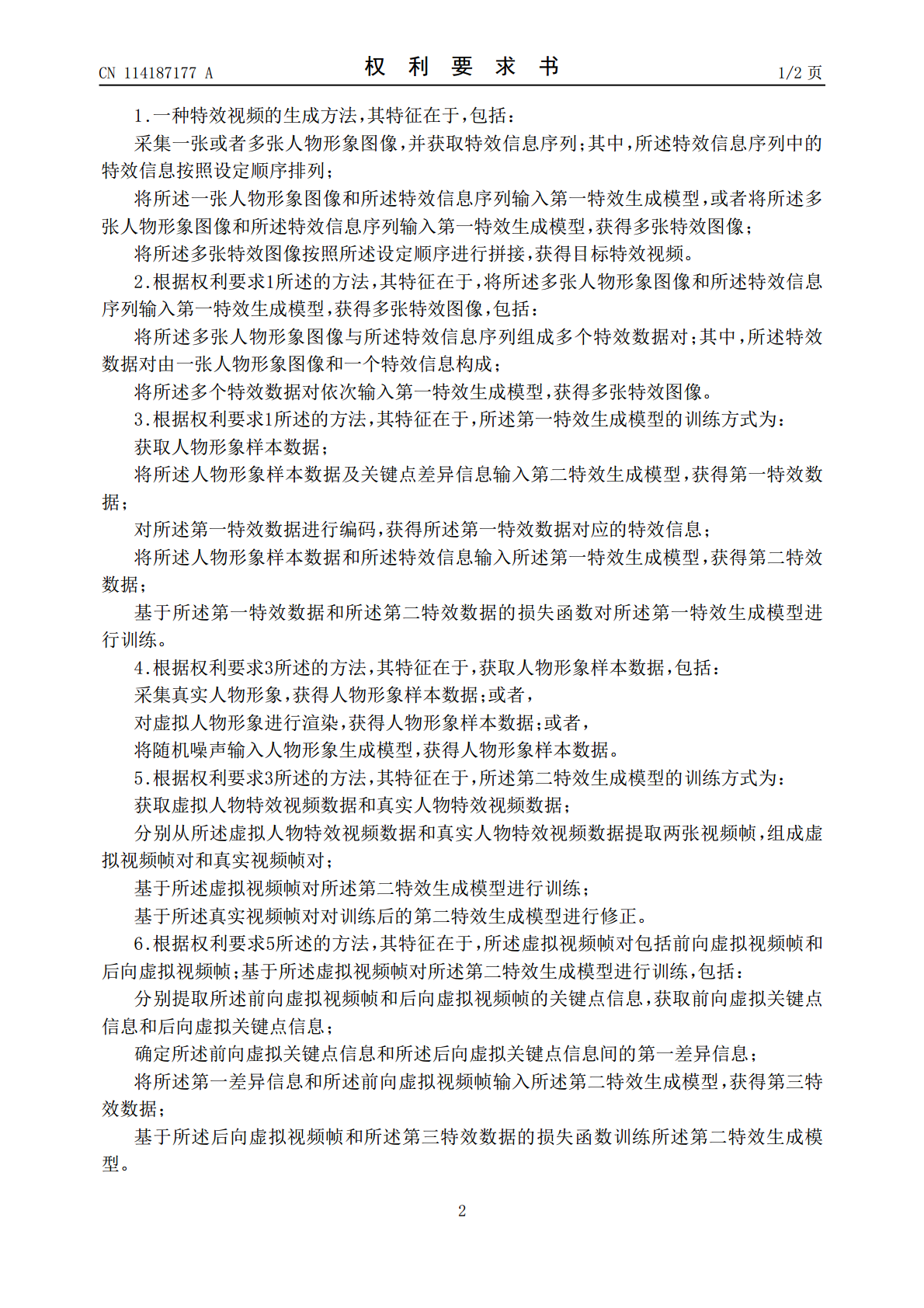

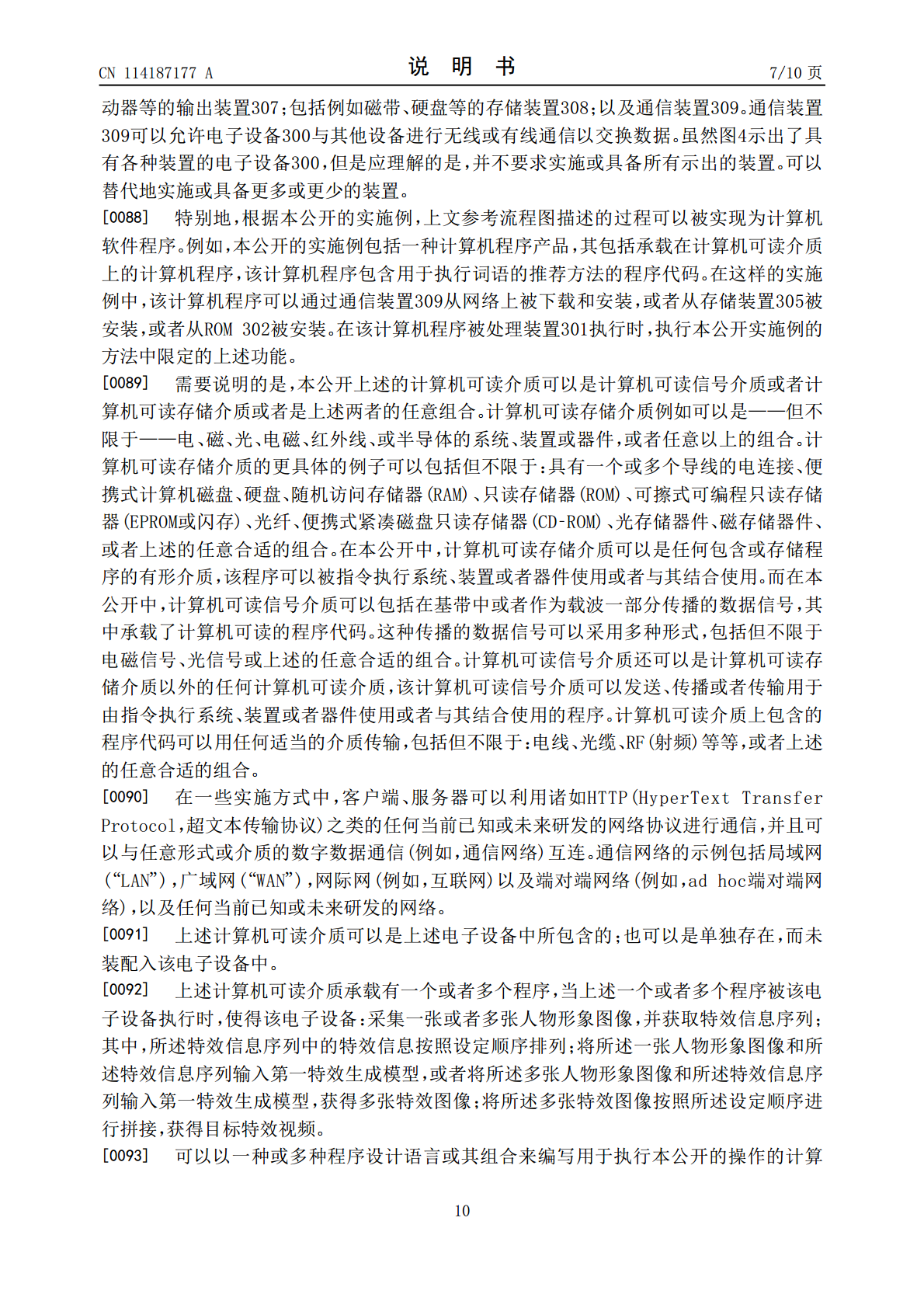

本公开实施例公开了一种特效视频的生成方法、装置、设备及存储介质。采集一张或者多张人物形象图像,并获取特效信息序列;将所述一张人物形象图像和所述特效信息序列输入第一特效生成模型,或者将所述多张人物形象图像和所述特效信息序列输入第一特效生成模型,获得多张特效图像;将所述多张特效图像按照所述设定顺序进行拼接,获得目标特效视频。本公开实施例提供的特效视频的生成方法,将所述一张人物形象图像和所述特效信息序列输入第一特效生成模型,或者将所述多张人物形象图像和所述特效信息序列输入第一特效生成模型,获得特效图像,从而获得

特效视频生成方法、装置、设备及存储介质.pdf

本公开实施例公开了一种特效视频生成方法、装置、设备及存储介质。确定虚拟流体在当前帧的运动信息及虚拟流体表面在上一帧的第一状态信息;其中,所述虚拟流体放置于虚拟容器中;基于所述运动信息及所述第一状态信息确定所述虚拟流体表面在当前帧的第二状态信息;其中,所述第二状态信息包括第二流体表面朝向信息及第二扰动信息;根据所述第二流体表面朝向信息和所述第二扰动信息对当前帧的流体表面状态进行渲染,获得当前帧对应的流体运动特效图。本公开实施例通过当前帧的第二流体表面朝向信息和第二扰动信息对流体表面状态进行渲染,获得当前帧对

视频特效包的生成方法、装置、设备及存储介质.pdf

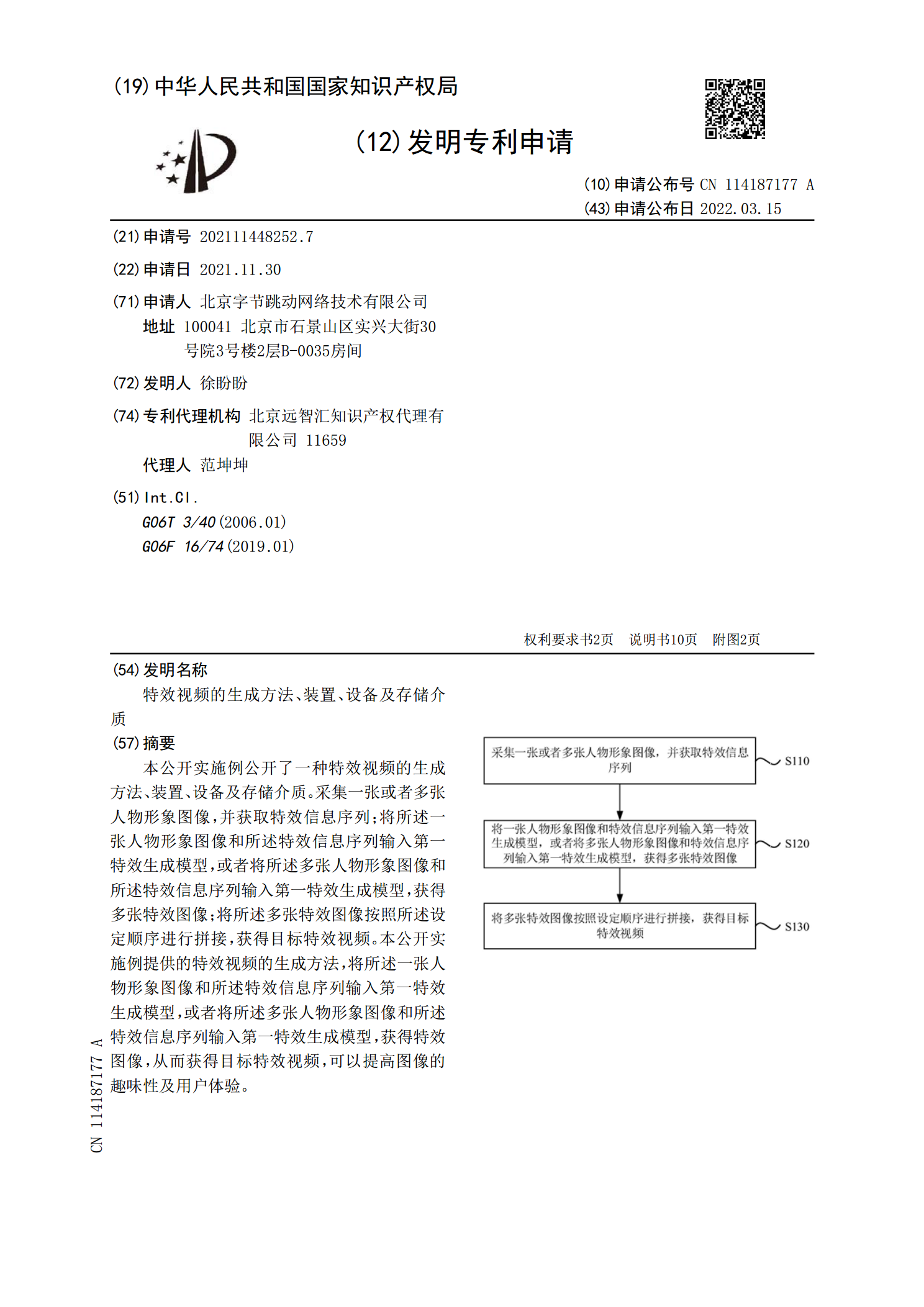

本公开实施例公开了一种视频特效包的生成方法、装置、设备及存储介质。获取通用特效面板中有一个输入为空的特效控件,确定为目标特效控件;获取所述目标特效控件中的特效信息,并切换至脚本特效面板;在所述脚本特效面板中根据用户触发的创建操作创建所述特效信息对应的获取控件、抓帧控件、选择控件及所述脚本信息对应的设置控件;将所述获取控件、抓帧控件、选择控件及所述设置控件依次相连,以将抓取到的视频帧输入所述目标特效控件,以生成视频特效包。本公开实施例提供的视频特效包的生成方法,可以基于节点系统生成抓帧特效包,提高特效包的生

特效视频帧的生成方法、装置、电子设备及存储介质.pdf

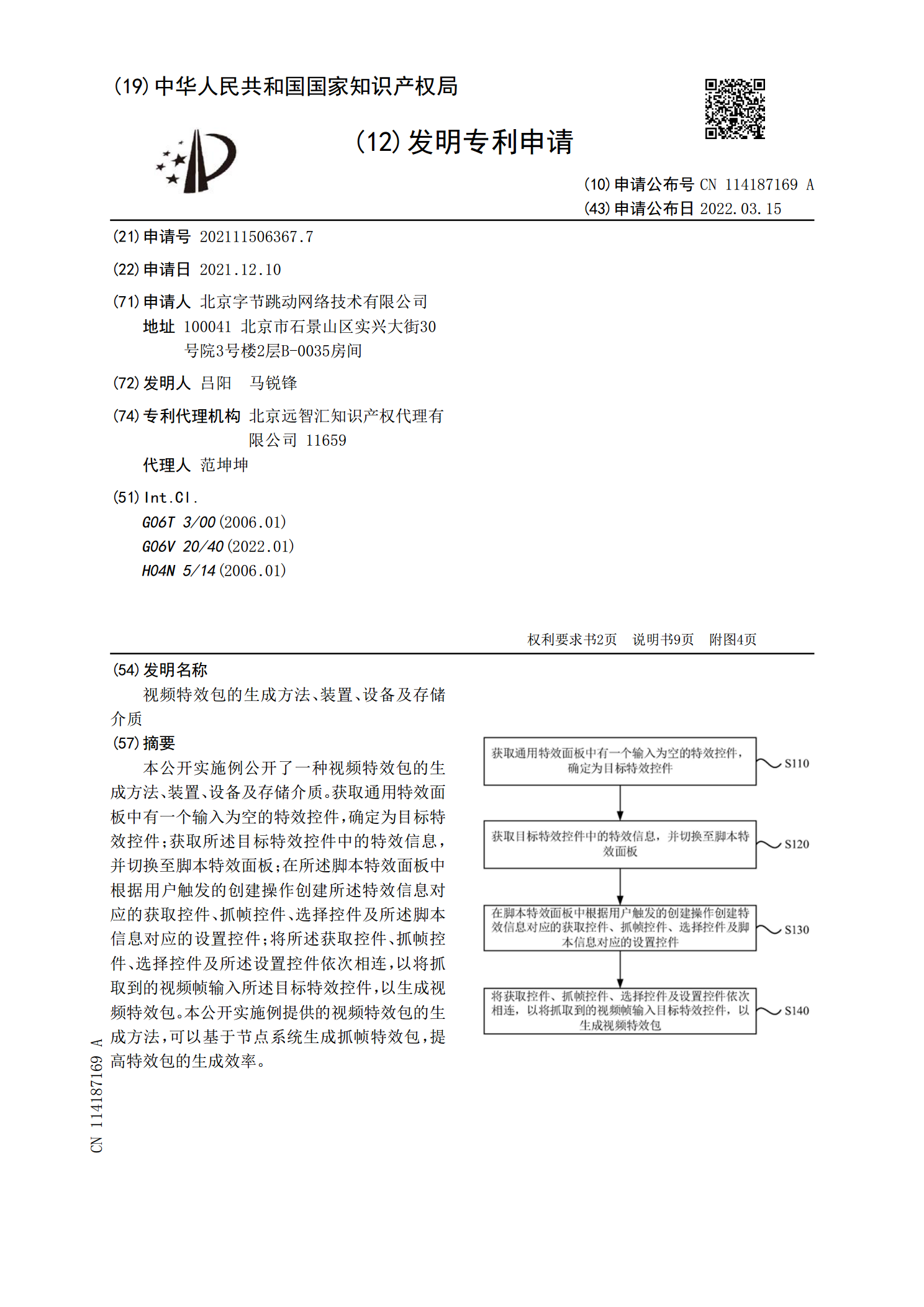

本公开实施例提供了一种特效视频帧的生成方法、装置、电子设备及存储介质。其中,该方法包括:响应于特效视频生成指令,在当前视频帧中显示至少两个运动的特效元素;根据当前视频帧中是否包括目标对象,确定特效元素的运动特征信息;基于运动特征信息,确定运动参数调整方式,以基于运动参数调整方式确定相应特效元素所对应的目标运动参数;基于特效元素的目标运动参数控制相应特效元素进行运动,以得到特效视频帧。本公开实施例的技术方案,实现了基于目标对象与特效元素之间的交互,确定特效元素的运动特征信息,以基于运动特征信息对特效元素进行

视频特效软件及其生成方法、装置、设备和存储介质.pdf

本发明提供一种视频特效软件及其生成方法、装置、设备及存储介质,其中的软件包括渲染引擎、虚拟机和脚本库;所述渲染引擎包括若干特效组件;所述脚本库包括脚本文件;所述虚拟机,用于实现所述渲染引擎和所述脚本文件之间的相互调用;所述渲染引擎,用于在收到用于触发特效生成的特效指令时,驱动所述虚拟机加载并执行与所述特效指令关联的脚本文件;所述脚本文件,用于在被执行的过程中,调用与所述特效指令对应的特效组件,以使被调用的特效组件组合渲染出与所述特效指令对应的特效效果。