基于可微分采样器和渐进学习的卷积神经网络架构搜索方法.pdf

诗文****仙女

亲,该文档总共16页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

基于可微分采样器和渐进学习的卷积神经网络架构搜索方法.pdf

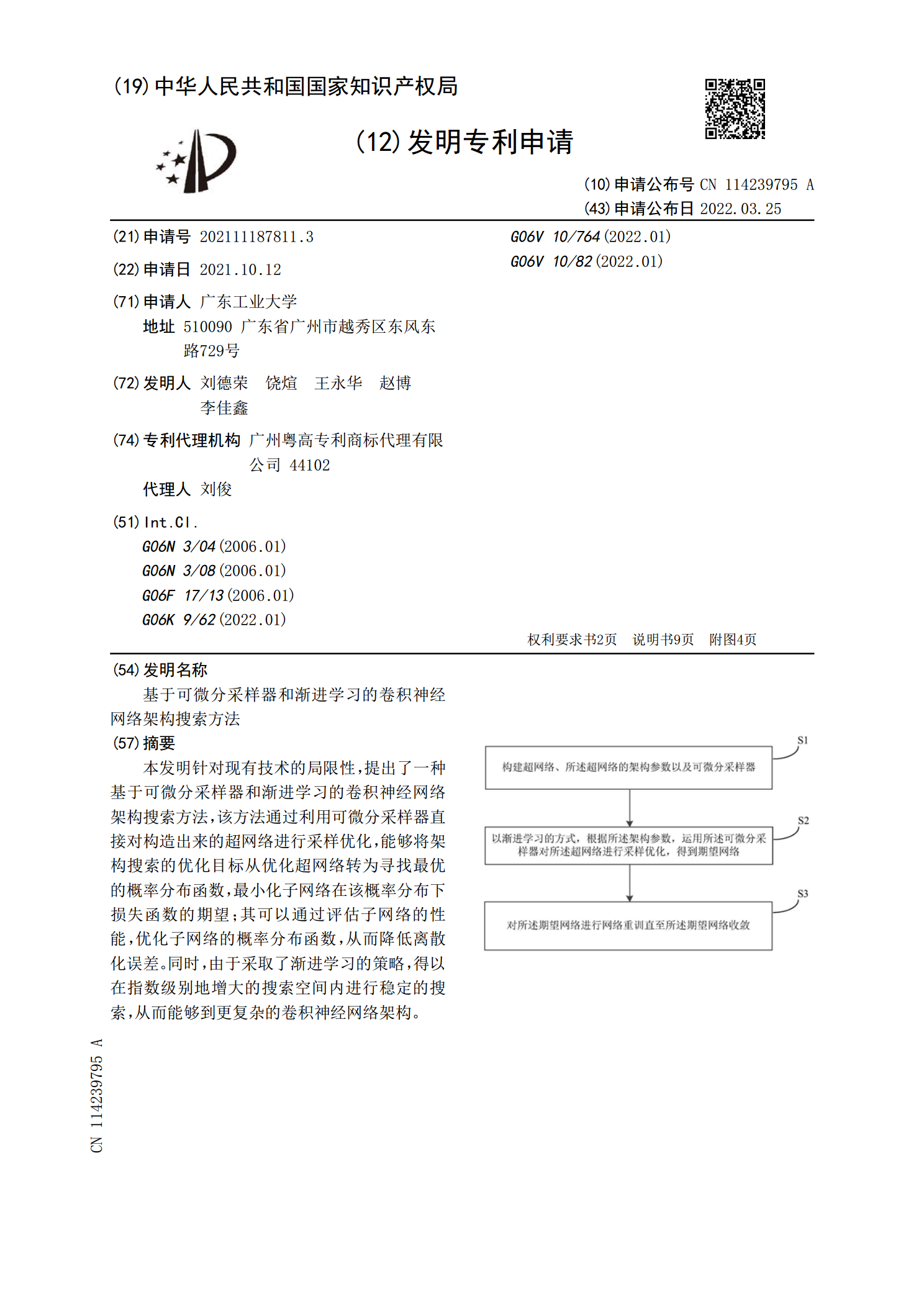

本发明针对现有技术的局限性,提出了一种基于可微分采样器和渐进学习的卷积神经网络架构搜索方法,该方法通过利用可微分采样器直接对构造出来的超网络进行采样优化,能够将架构搜索的优化目标从优化超网络转为寻找最优的概率分布函数,最小化子网络在该概率分布下损失函数的期望;其可以通过评估子网络的性能,优化子网络的概率分布函数,从而降低离散化误差。同时,由于采取了渐进学习的策略,得以在指数级别地增大的搜索空间内进行稳定的搜索,从而能够到更复杂的卷积神经网络架构。

一种高效的基于可微分的神经网络架构搜索方法.pdf

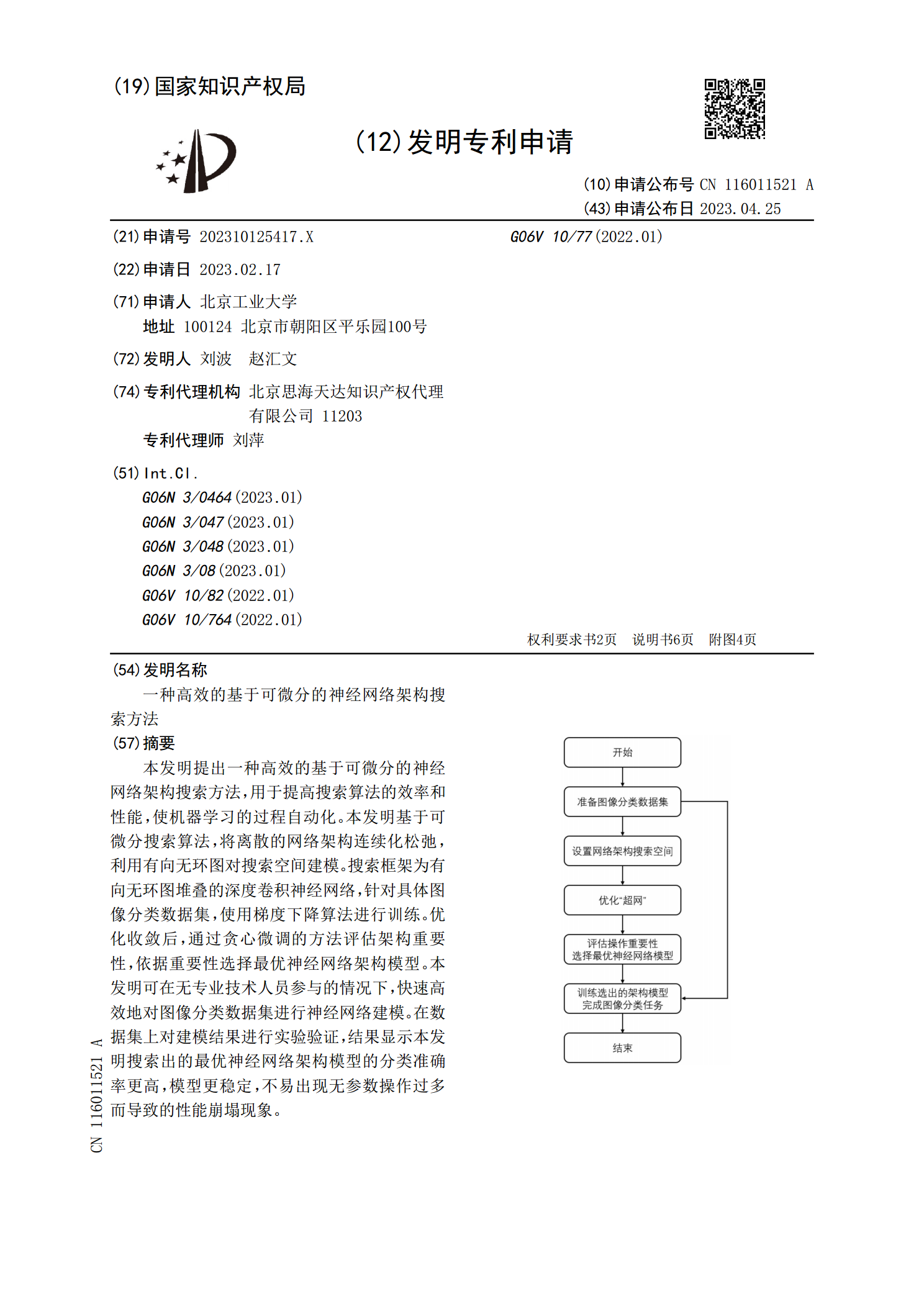

本发明提出一种高效的基于可微分的神经网络架构搜索方法,用于提高搜索算法的效率和性能,使机器学习的过程自动化。本发明基于可微分搜索算法,将离散的网络架构连续化松弛,利用有向无环图对搜索空间建模。搜索框架为有向无环图堆叠的深度卷积神经网络,针对具体图像分类数据集,使用梯度下降算法进行训练。优化收敛后,通过贪心微调的方法评估架构重要性,依据重要性选择最优神经网络架构模型。本发明可在无专业技术人员参与的情况下,快速高效地对图像分类数据集进行神经网络建模。在数据集上对建模结果进行实验验证,结果显示本发明搜索出的最优

一种并行可微分神经网络架构搜索方法.pdf

本发明公开了一种并行可微分神经网络架构搜索方法,首先构建带有二进制门的双路径超级网络;然后利用sigmoid函数,进行搜索空间连续化;接下来运用梯度下降的方式对所述超级网络进行优化,得到最优基本单元,包括普通单元和归约单元;最后利用得到的基本单元进行堆叠,得到所需的深度神经网络,对深度神经网络进行重训练至网络收敛。通过设计快速并行的可微分神经网络架构搜索方法,显著提高了神经网络架构搜索的速度和性能。

基于贝叶斯卷积神经网络的进化神经架构搜索方法及系统.pdf

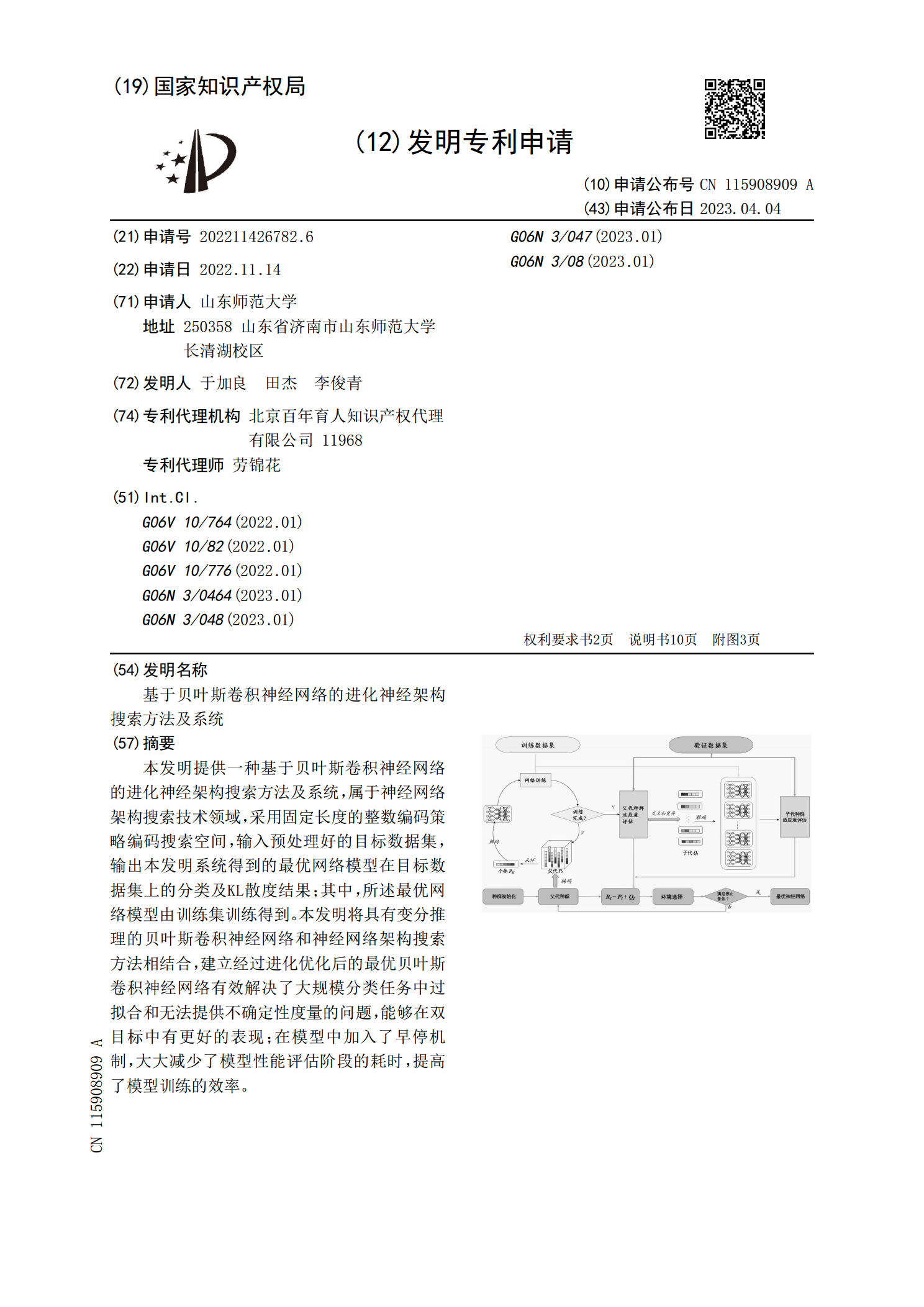

本发明提供一种基于贝叶斯卷积神经网络的进化神经架构搜索方法及系统,属于神经网络架构搜索技术领域,采用固定长度的整数编码策略编码搜索空间,输入预处理好的目标数据集,输出本发明系统得到的最优网络模型在目标数据集上的分类及KL散度结果;其中,所述最优网络模型由训练集训练得到。本发明将具有变分推理的贝叶斯卷积神经网络和神经网络架构搜索方法相结合,建立经过进化优化后的最优贝叶斯卷积神经网络有效解决了大规模分类任务中过拟合和无法提供不确定性度量的问题,能够在双目标中有更好的表现;在模型中加入了早停机制,大大减少了模型

基于图卷积和强化学习的可重构计算架构映射方法和装置.pdf

本申请提出了一种基于图卷积和强化学习的可重构计算架构映射方法,包括:获取数据依赖图和粗粒度可重构阵列,并计算得到数据依赖图的最小启动间隔,根据最小启动间隔对数据依赖图进行预处理,根据粗粒度可重构阵列的结构,精简得到硬件模型资源图,将硬件模型资源图的节点集合作为动作空间,采用基于图卷积网络的强化学习模型对预处理后的数据依赖图进行映射,得到硬件模型资源图上的数据依赖图节点的映射结果,计算映射结果的奖励值,并在根据奖励值判断映射结果满足成功映射条件时,输出映射结果。本申请利用图卷积和强化学习优化循环在可重构计算