语音合成方法、模型训练方法、设备及存储介质.pdf

Ch****91

亲,该文档总共24页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

语音合成方法、模型训练方法、设备及存储介质.pdf

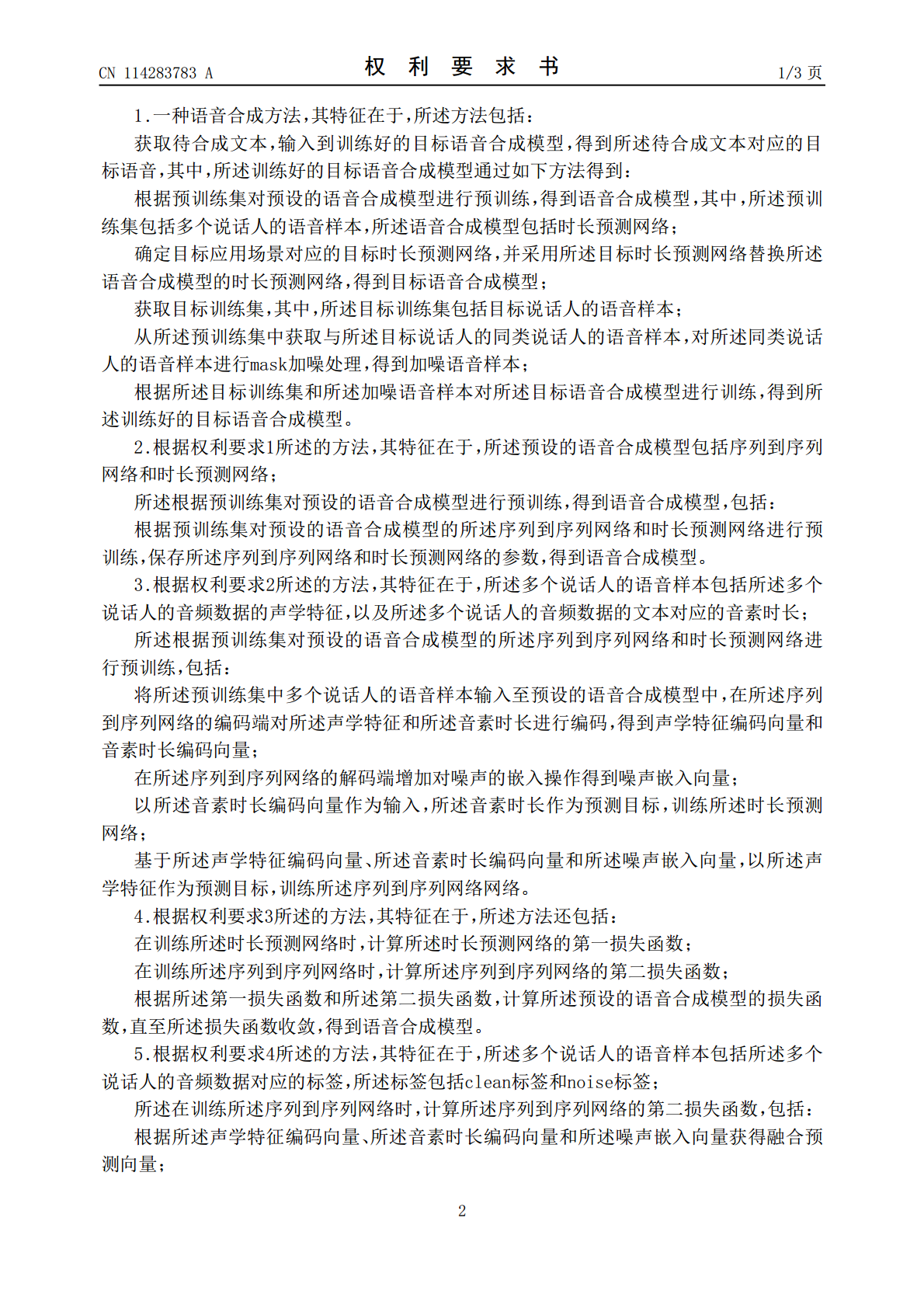

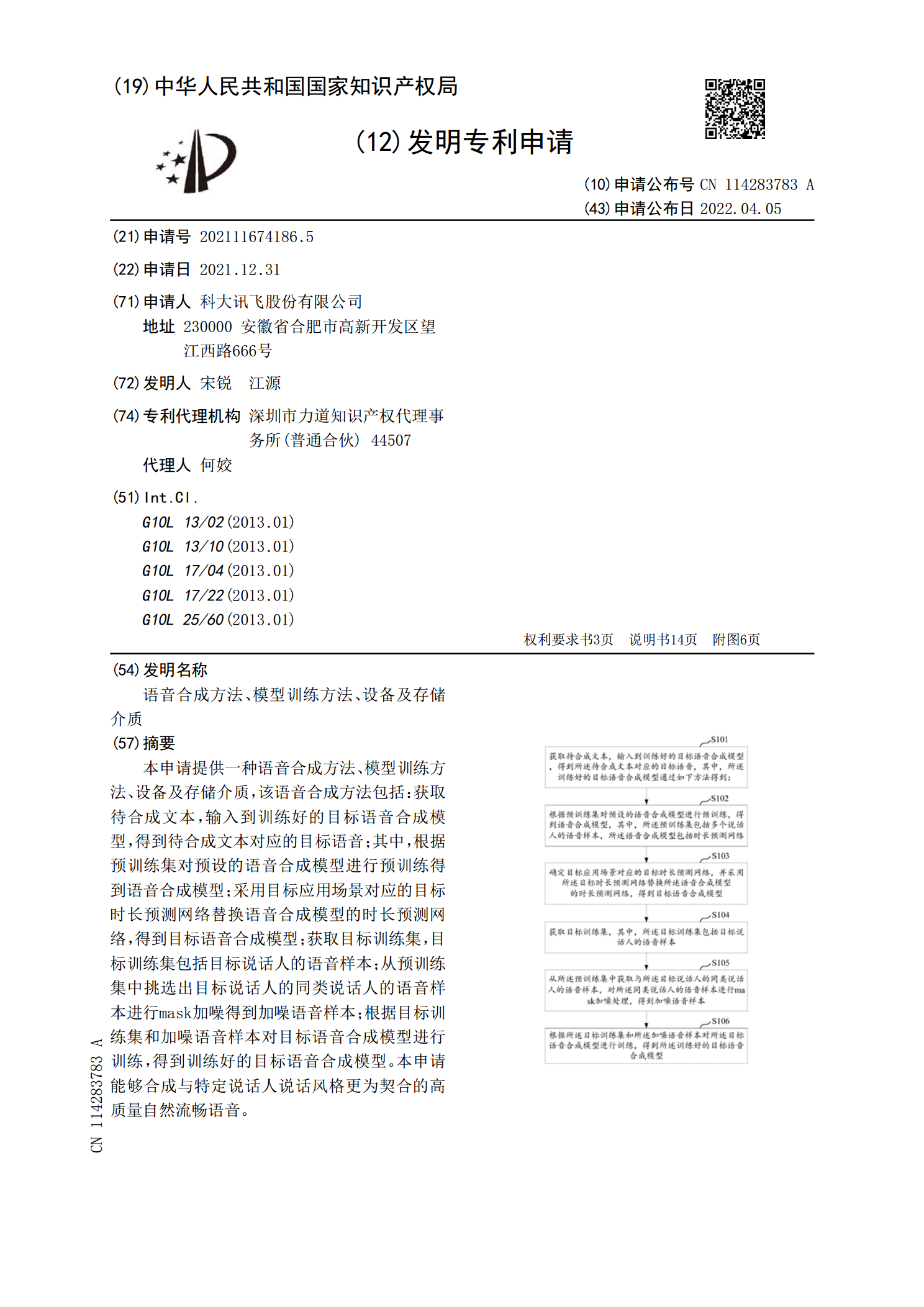

本申请提供一种语音合成方法、模型训练方法、设备及存储介质,该语音合成方法包括:获取待合成文本,输入到训练好的目标语音合成模型,得到待合成文本对应的目标语音;其中,根据预训练集对预设的语音合成模型进行预训练得到语音合成模型;采用目标应用场景对应的目标时长预测网络替换语音合成模型的时长预测网络,得到目标语音合成模型;获取目标训练集,目标训练集包括目标说话人的语音样本;从预训练集中挑选出目标说话人的同类说话人的语音样本进行mask加噪得到加噪语音样本;根据目标训练集和加噪语音样本对目标语音合成模型进行训练,得到

语音合成模型的训练方法、装置、电子设备及存储介质.pdf

本公开提供了一种语音合成模型的训练方法、装置、电子设备及存储介质,所述方法包括:将第一语音样本对应的音乐信息,输入至时长提取模块,获取乐谱样本嵌入值;将乐谱样本嵌入值和乐谱样本嵌入值对应的音高样本嵌入值输入至线性变换模块,进行降维;将线性变换模块的输出,作为框架网络模块的输入,获取音乐信息对应的第一预测样本特征;获取第一语音样本对应的隐特征;将隐特征输入至解码器中,获取隐特征对应的预测语音样本;基于第一语音样本和所述预测语音样本,调整解码器的参数;基于第一预测样本特征和隐特征,调整所述线性变换模块和框架网

语音合成模型的训练方法、装置、电子设备及存储介质.pdf

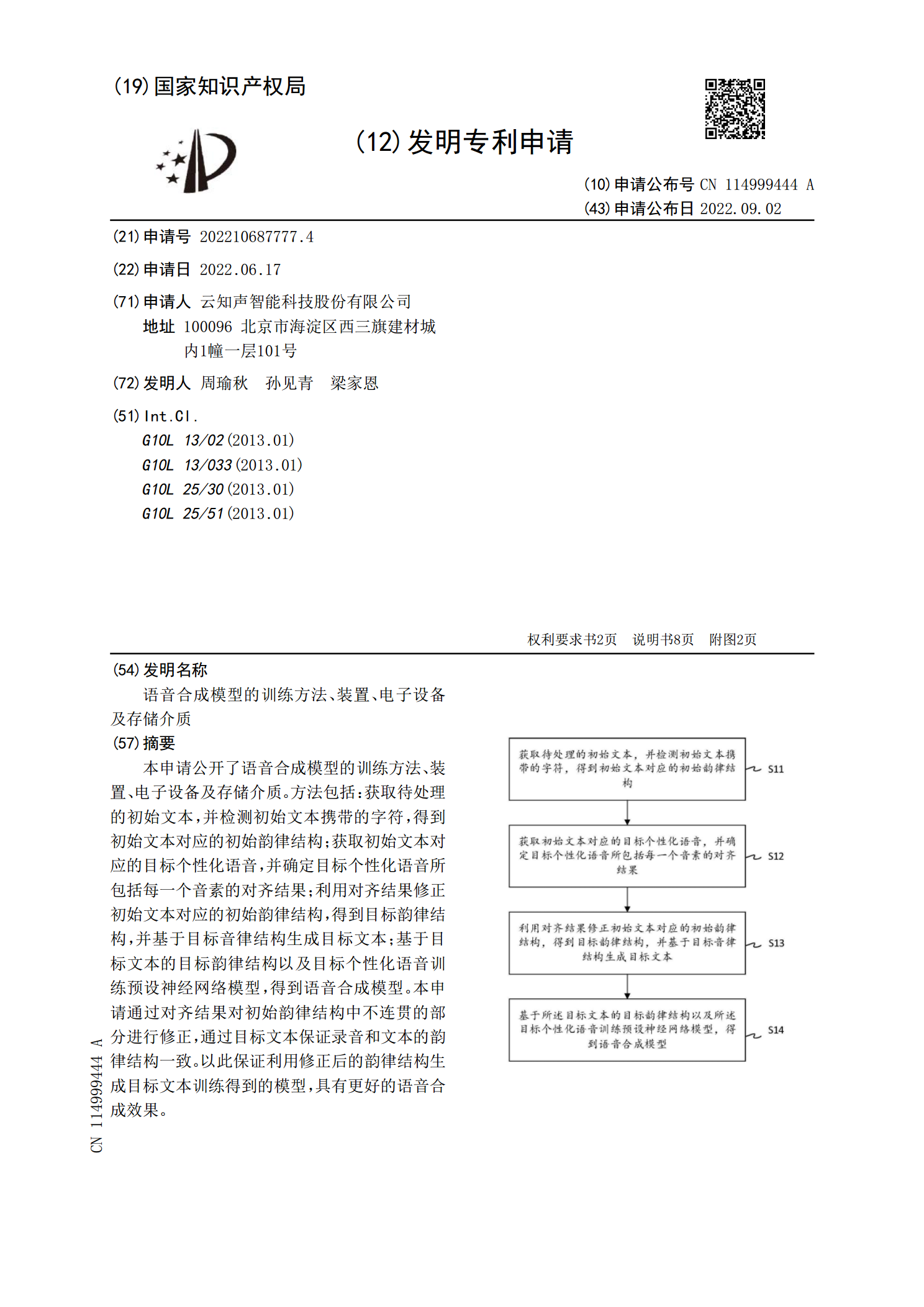

本申请公开了语音合成模型的训练方法、装置、电子设备及存储介质。方法包括:获取待处理的初始文本,并检测初始文本携带的字符,得到初始文本对应的初始韵律结构;获取初始文本对应的目标个性化语音,并确定目标个性化语音所包括每一个音素的对齐结果;利用对齐结果修正初始文本对应的初始韵律结构,得到目标韵律结构,并基于目标音律结构生成目标文本;基于目标文本的目标韵律结构以及目标个性化语音训练预设神经网络模型,得到语音合成模型。本申请通过对齐结果对初始韵律结构中不连贯的部分进行修正,通过目标文本保证录音和文本的韵律结构一致。

一种语音合成模型的训练方法、装置、设备以及存储介质.pdf

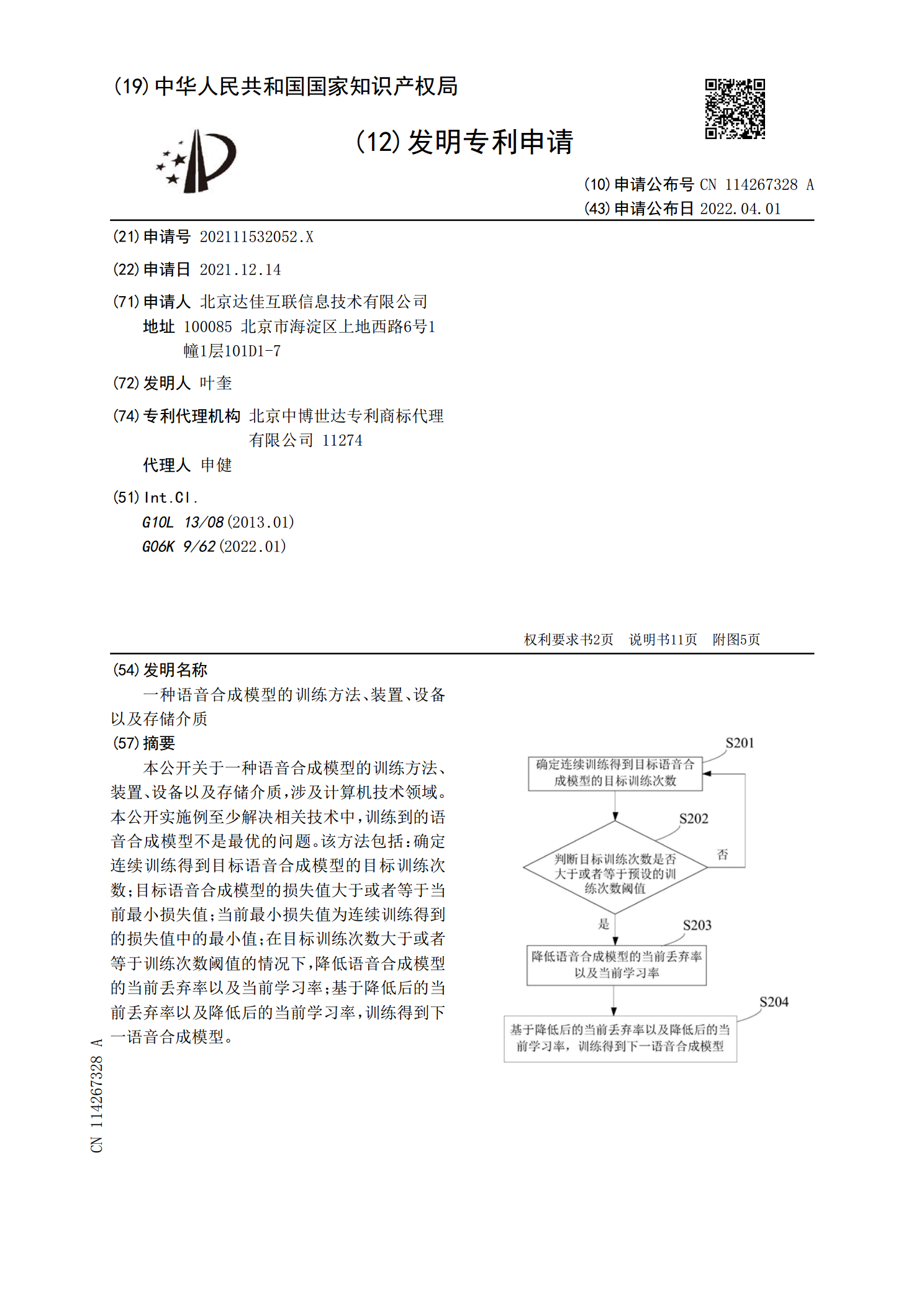

本公开关于一种语音合成模型的训练方法、装置、设备以及存储介质,涉及计算机技术领域。本公开实施例至少解决相关技术中,训练到的语音合成模型不是最优的问题。该方法包括:确定连续训练得到目标语音合成模型的目标训练次数;目标语音合成模型的损失值大于或者等于当前最小损失值;当前最小损失值为连续训练得到的损失值中的最小值;在目标训练次数大于或者等于训练次数阈值的情况下,降低语音合成模型的当前丢弃率以及当前学习率;基于降低后的当前丢弃率以及降低后的当前学习率,训练得到下一语音合成模型。

语音识别模型的训练方法、装置、设备及存储介质.pdf

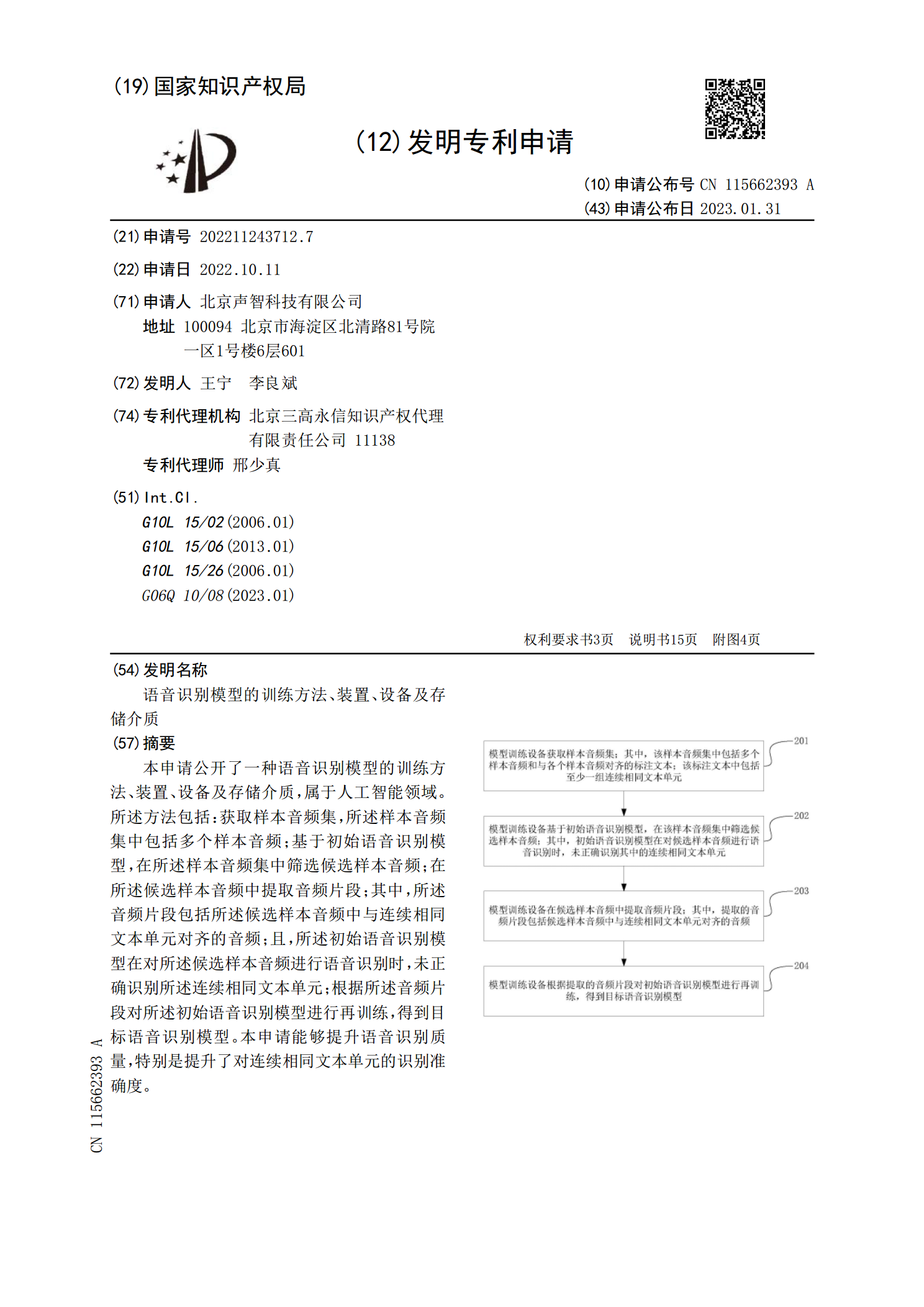

本申请公开了一种语音识别模型的训练方法、装置、设备及存储介质,属于人工智能领域。所述方法包括:获取样本音频集,所述样本音频集中包括多个样本音频;基于初始语音识别模型,在所述样本音频集中筛选候选样本音频;在所述候选样本音频中提取音频片段;其中,所述音频片段包括所述候选样本音频中与连续相同文本单元对齐的音频;且,所述初始语音识别模型在对所述候选样本音频进行语音识别时,未正确识别所述连续相同文本单元;根据所述音频片段对所述初始语音识别模型进行再训练,得到目标语音识别模型。本申请能够提升语音识别质量,特别是提升了