一种基于权重压缩的高效联邦学习方法及系统.pdf

论文****轩吖

亲,该文档总共16页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于权重压缩的高效联邦学习方法及系统.pdf

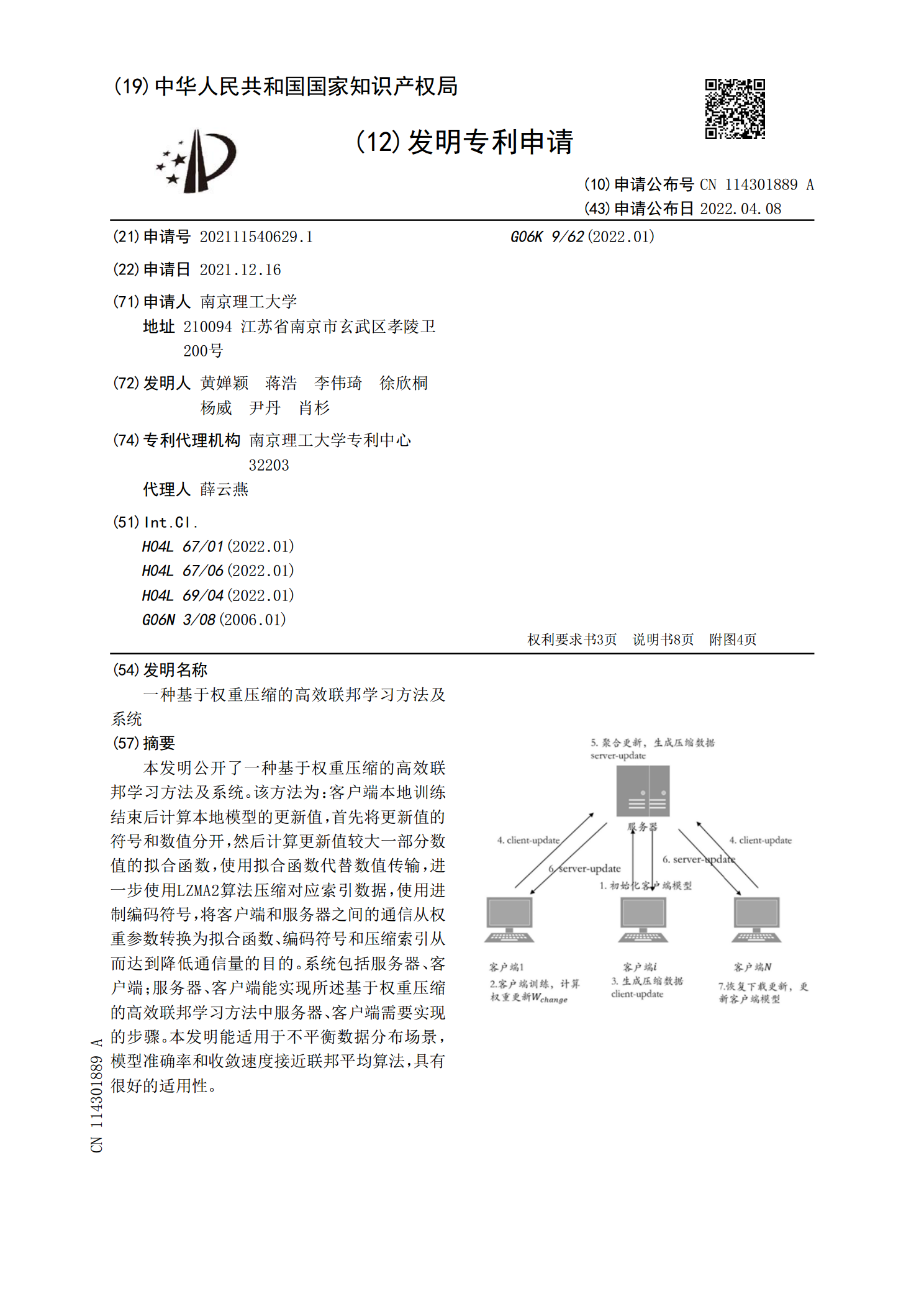

本发明公开了一种基于权重压缩的高效联邦学习方法及系统。该方法为:客户端本地训练结束后计算本地模型的更新值,首先将更新值的符号和数值分开,然后计算更新值较大一部分数值的拟合函数,使用拟合函数代替数值传输,进一步使用LZMA2算法压缩对应索引数据,使用进制编码符号,将客户端和服务器之间的通信从权重参数转换为拟合函数、编码符号和压缩索引从而达到降低通信量的目的。系统包括服务器、客户端;服务器、客户端能实现所述基于权重压缩的高效联邦学习方法中服务器、客户端需要实现的步骤。本发明能适用于不平衡数据分布场景,模型准确

基于压缩感知的通信高效联邦学习方法.pdf

本发明提供了一种基于压缩感知的通信高效联邦学习方法,可概括为如下步骤:首先使用服务器持有的准验证数据集执行字典学习,以学习模型参数的稀疏表示;然后采用自适应压缩比选择算法根据模型训练损失来确定合适的压缩比,最后在服务器端利用压缩的线性,将全局模型恢复的计算成本从n次减少到重构算法的1次执行;此外通过分层压缩降低了压缩的计算成本。通过本发明,可以有效地压缩和精确地重建非稀疏模型参数,不仅支持上下行压缩,还可以在不降低测试精度的情况下降低总体通信成本。通过在三个图像分类任务上的实验证明我们的方法始终优于现有的

基于客户端权重评价的联邦学习方法和系统.pdf

本发明公开了一种基于客户端权重评价的联邦学习方法,包括以下步骤:参与联邦学习的客户端与中心服务器建立安全通信通道,并进行联邦学习的初始化;客户端利用本地数据对本地模型进行参数优化后,上传当前轮次的本地模型信息至中心服务器,其中,本地模型信息包括本地模型参数和/或模型梯度;中心服务器依据本地模型信息并采用消融假设评估本地模型对联邦学习的贡献率,依据贡献率赋予本地模型的聚合权重,依据聚合权重聚合本地模型信息,以得到当前轮次的全局模型,当前轮次的全局模型下传至客户端以进行下一轮的联邦学习,该方法可以提升联邦学习

一种联邦学习方法及联邦学习系统.pdf

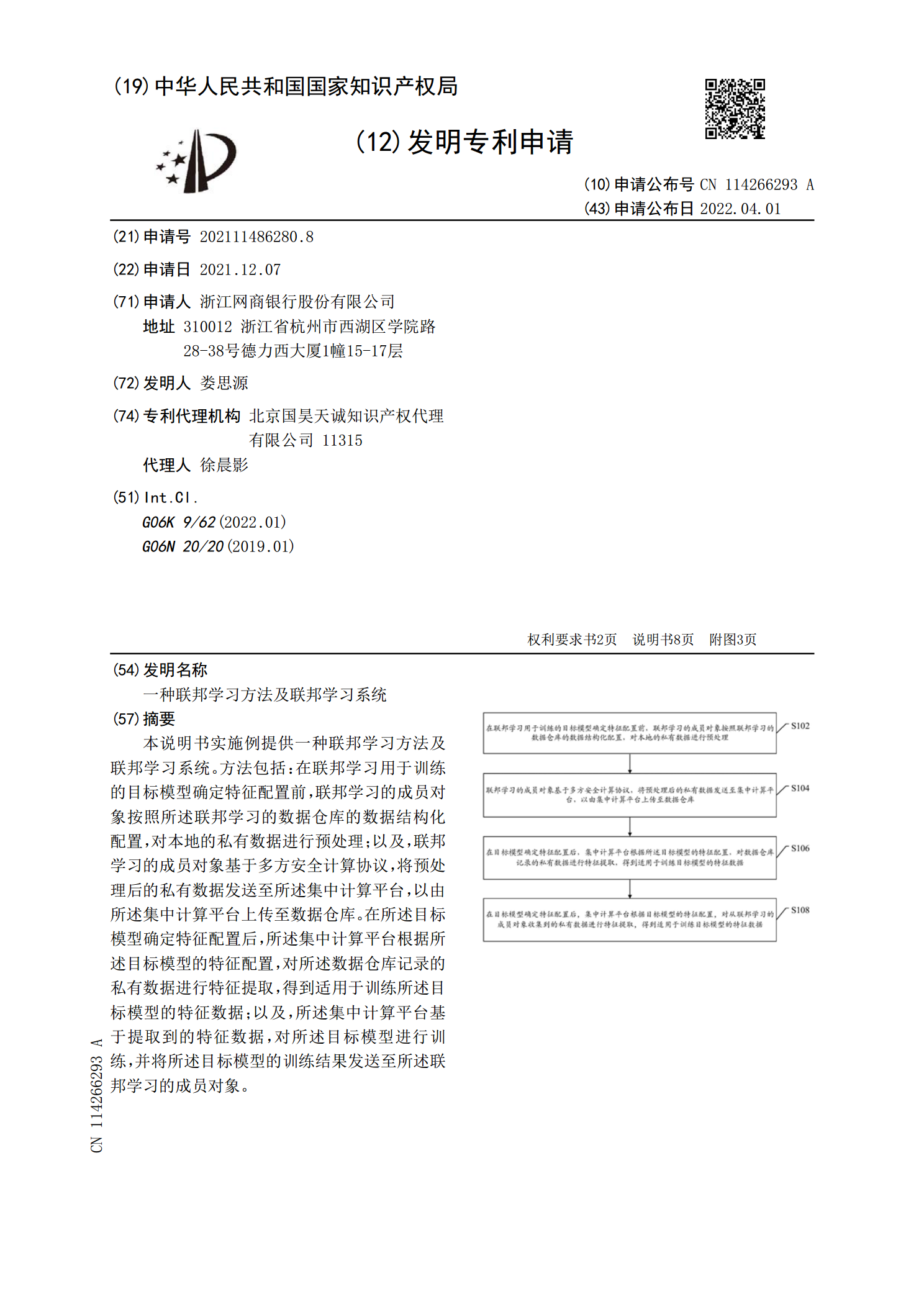

本说明书实施例提供一种联邦学习方法及联邦学习系统。方法包括:在联邦学习用于训练的目标模型确定特征配置前,联邦学习的成员对象按照所述联邦学习的数据仓库的数据结构化配置,对本地的私有数据进行预处理;以及,联邦学习的成员对象基于多方安全计算协议,将预处理后的私有数据发送至所述集中计算平台,以由所述集中计算平台上传至数据仓库。在所述目标模型确定特征配置后,所述集中计算平台根据所述目标模型的特征配置,对所述数据仓库记录的私有数据进行特征提取,得到适用于训练所述目标模型的特征数据;以及,所述集中计算平台基于提取到的特

一种基于图计算的联邦学习方法和系统.pdf

本发明公开了一种基于图计算的联邦学习方法和系统,包括模型构建模块、模型运行模块和模型评估模块,所述模型运行模块包括图神经网络组件、机器学习组件和连接组件,所述模型运行模块包括模型参数配置单元、模型运行单元和模型运行结果及日志查看单元,所述模型评估模块包括模型下载单元和模型预测单元。本发明中,通过发起方、协助方和协调方组建一个联合模型,协作方各自本体保留自己的本地模型,从多方数据源获取图神经网络模型需要的点边特征数据,但数据在各自节点的物理机上并且在模型训练过程中不会传输原数据,并且在进行多方数据对齐时,通