一种端到端的声纹识别方法、装置、存储介质及设备.pdf

斌斌****公主

亲,该文档总共27页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种端到端的声纹识别方法、装置、存储介质及设备.pdf

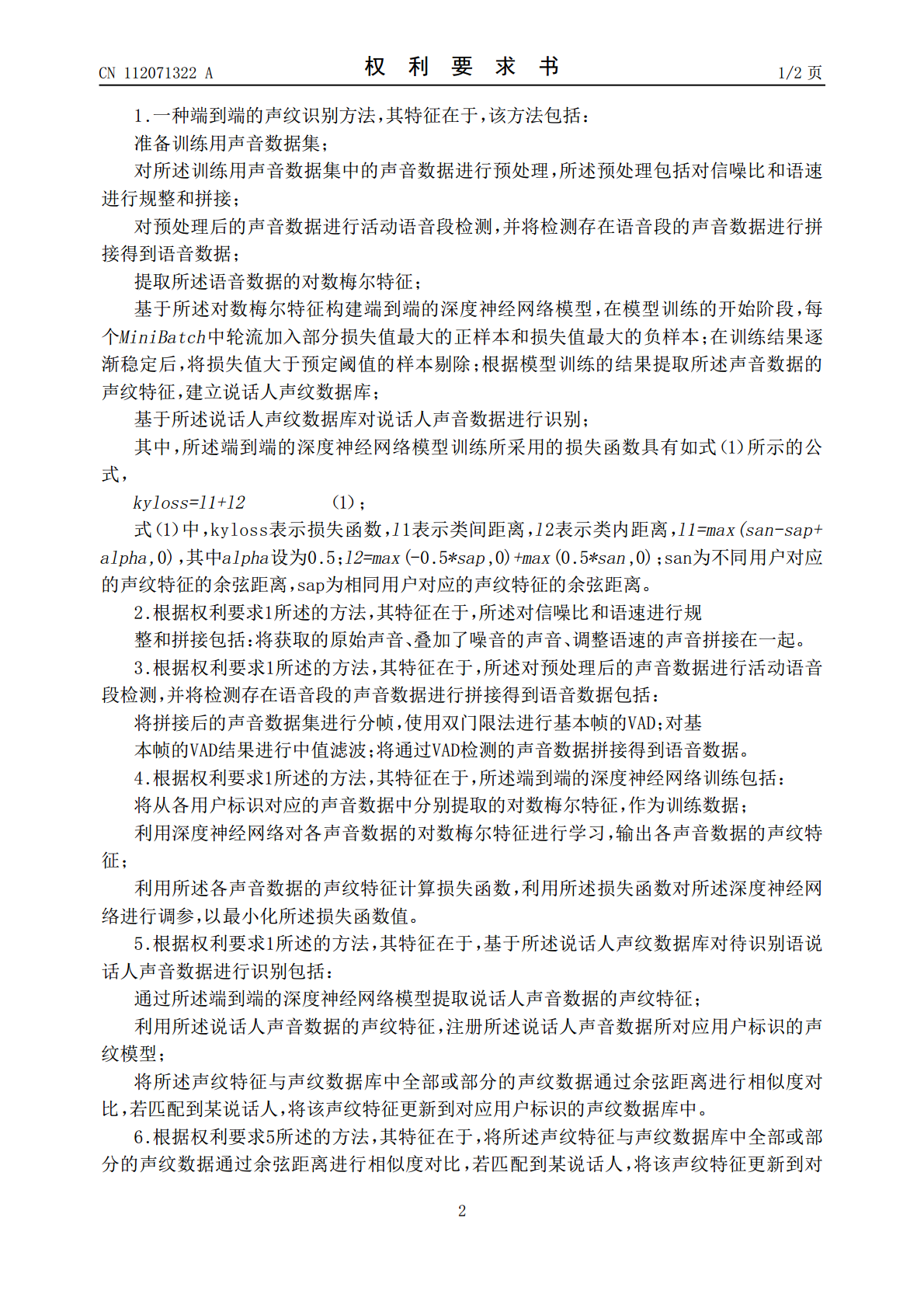

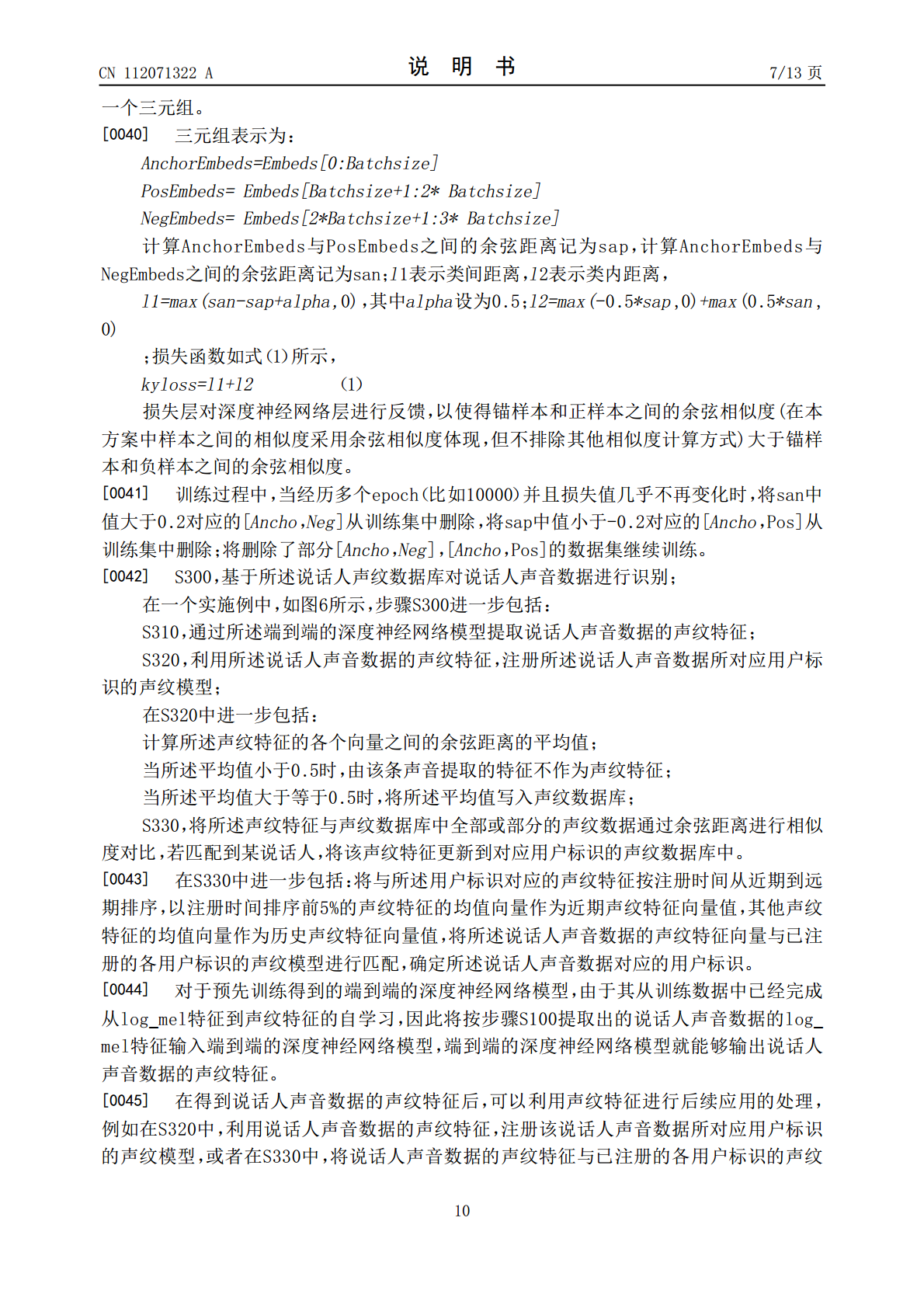

本方案公开了一种端到端的声纹识别方法、装置、存储介质及设备,方法包括准备训练用声音数据集;所述训练用声音数据集中的声音数据进行预处理;对预处理后的声音数据进行活动语音段检测,并将检测存在语音段的声音数据进行拼接得到语音数据;提取所述语音数据的对数梅尔特征;基于所述对数梅尔特征构建端到端的深度神经网络模型;根据模型训练的结果提取所述声音数据的声纹特征,建立说话人声纹数据库;基于所述说话人声纹数据库对说话人声音数据进行识别。本方案从数据预处理、端到端的模型、损失函数的改进、训练过程的改进、匹配算法的改进等方面

端到端的声纹识别方法和声纹识别装置.pdf

公开了一种端到端的声纹识别方法和声纹识别装置。所述声纹识别方法包括:基于接收的输入语音,使用端到端深度学习网络的说话人语音提取模块执行说话人语音提取任务,以提取目标说话人的语音特征;基于目标说话人的语音特征,使用端到端深度学习网络的说话人识别模块执行说话人识别任务,以在接收的输入语音中识别目标说话人。

端到端切片创建方法、装置、设备及存储介质.pdf

本发明提供了端到端切片创建方法、装置、设备及存储介质,该方法包括:采用协议报文中的Sub‑TLV来定义Flex‑Algo算法,Sub‑TLV包括带宽约束类型值、约束的FlexE带宽以及约束的FlexE带宽的字段长度;为本地的FlexE接口设置带宽标记,所述带宽标记指示该FlexE接口的的物理带宽大小;根据各节点定义Flex‑Algo算法,更新节点拓扑;根据所更新的节点拓扑,计算源节点至目的节点的路径;根据所计算的路径创建源节点至目的节点的FlexE切片。本发明在设备节点自动创建端到端FlexE切片,无需管

一种端到端业务测试方法、系统、装置、设备和介质.pdf

本发明提供了一种端到端业务测试方法、系统、装置、设备和介质,涉及网络技术与安全技术领域,根据实体业务设备具有的硬件资源,在云资源平台内部署虚拟业务设备;然后建立虚拟业务设备、多个中间设备、以及核心网设备之间的通信通道;再向核心网设备下发测试任务,测试任务用于测试虚拟业务设备、经由多个中间设备发送至核心网设备的业务数据流量;最后获得核心网设备输出的测试结果。通过署虚拟业务设备,反向打通承载网与核心网的通信通道,通过在云资源平台内批量部虚拟业务设备,实现批量端到端业务测试,提高了测试效率。测试过程不需占用现网

一种端到端的车辆行为检测方法、系统、设备及存储介质.pdf

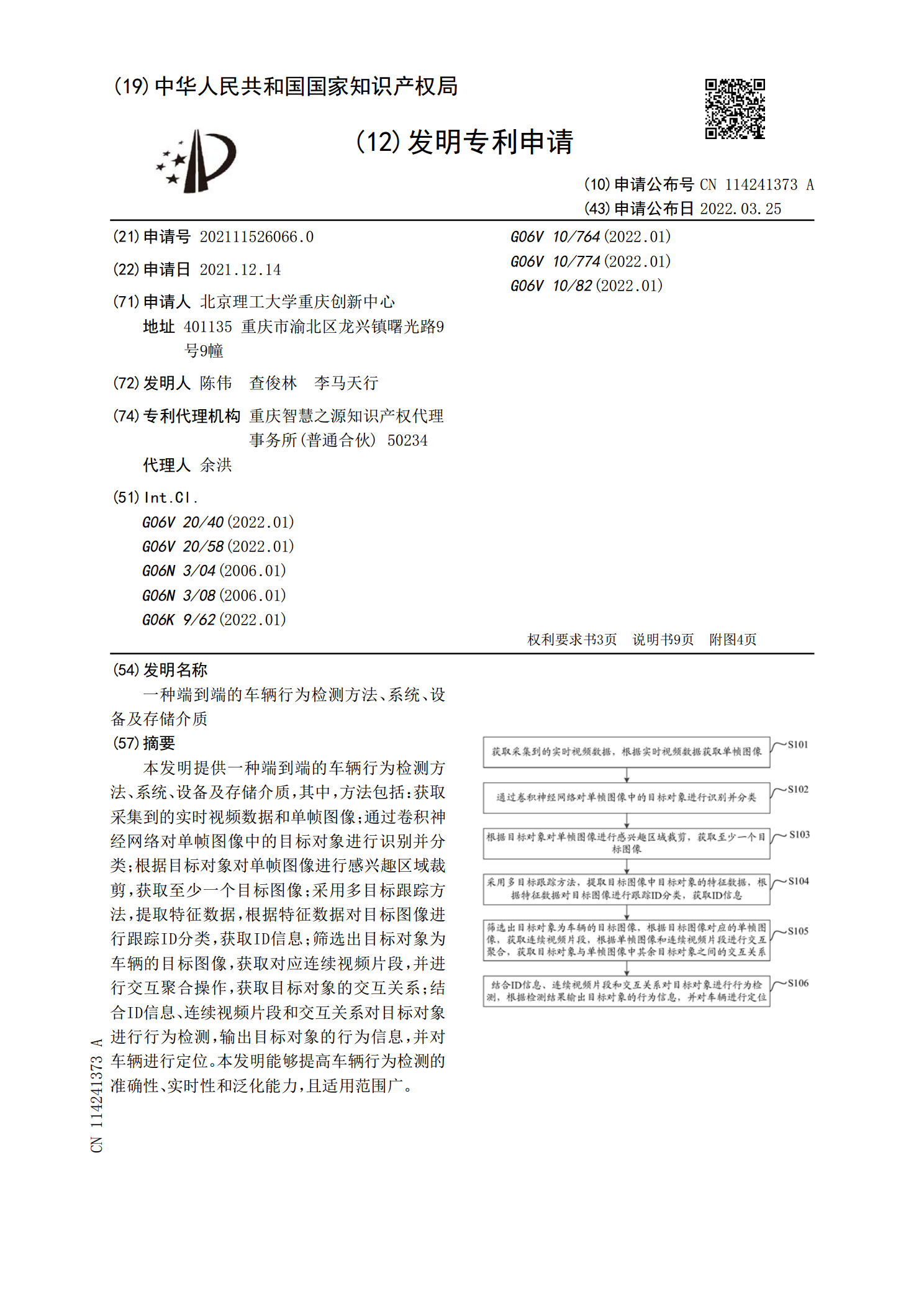

本发明提供一种端到端的车辆行为检测方法、系统、设备及存储介质,其中,方法包括:获取采集到的实时视频数据和单帧图像;通过卷积神经网络对单帧图像中的目标对象进行识别并分类;根据目标对象对单帧图像进行感兴趣区域裁剪,获取至少一个目标图像;采用多目标跟踪方法,提取特征数据,根据特征数据对目标图像进行跟踪ID分类,获取ID信息;筛选出目标对象为车辆的目标图像,获取对应连续视频片段,并进行交互聚合操作,获取目标对象的交互关系;结合ID信息、连续视频片段和交互关系对目标对象进行行为检测,输出目标对象的行为信息,并对车辆