一种分布式多源异构数据融合应用方法.pdf

志信****pp

亲,该文档总共20页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种分布式多源异构数据融合应用方法.pdf

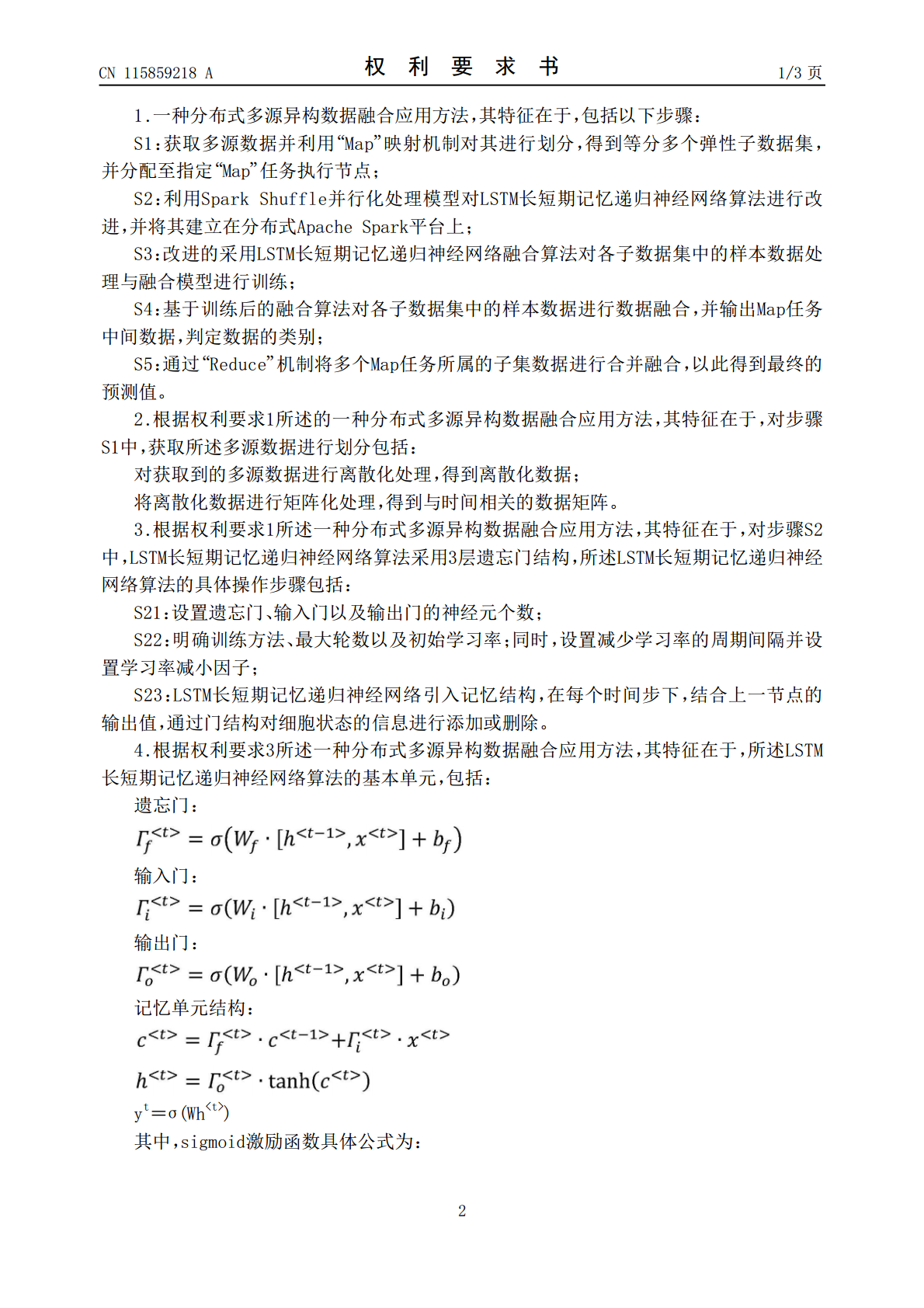

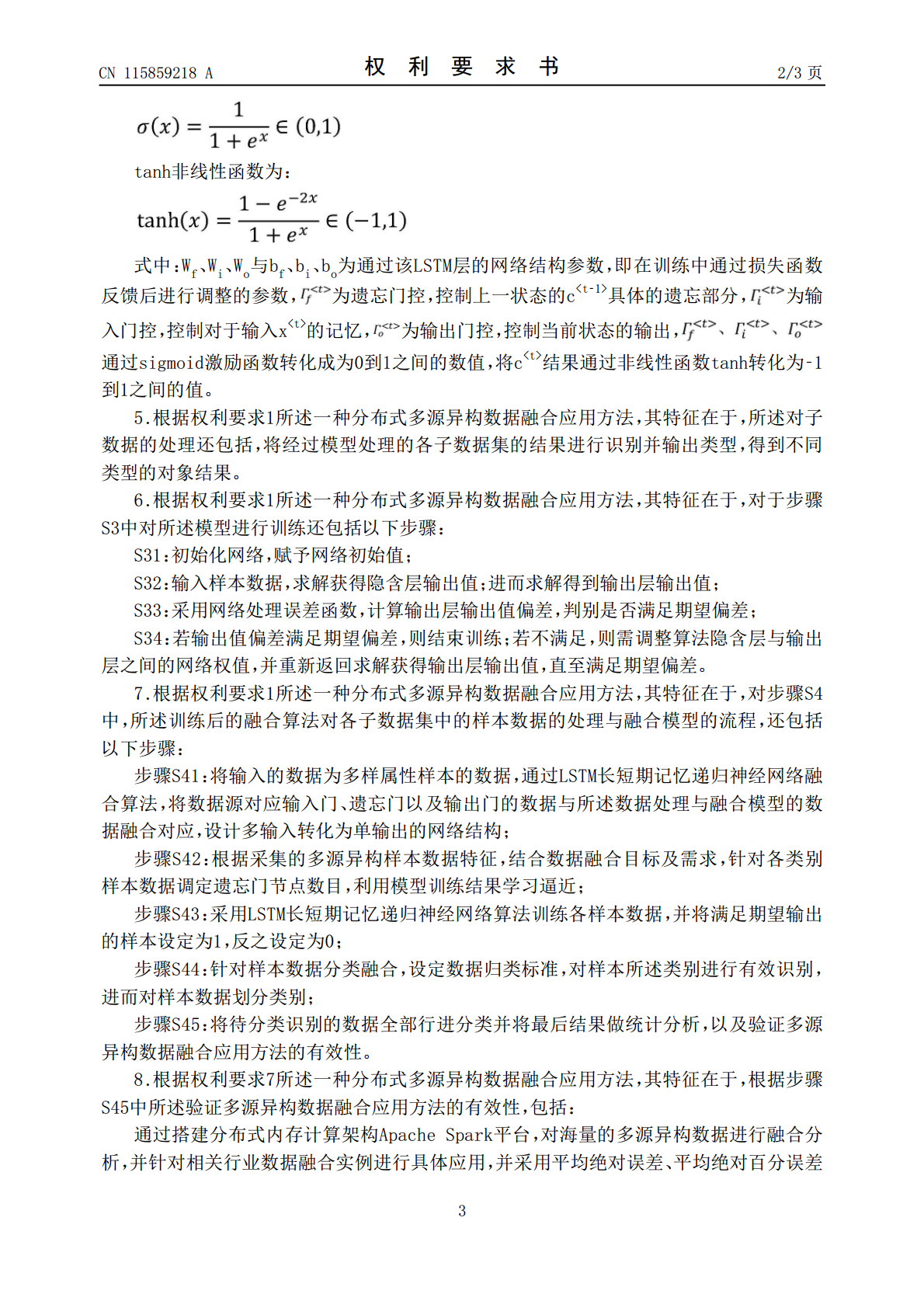

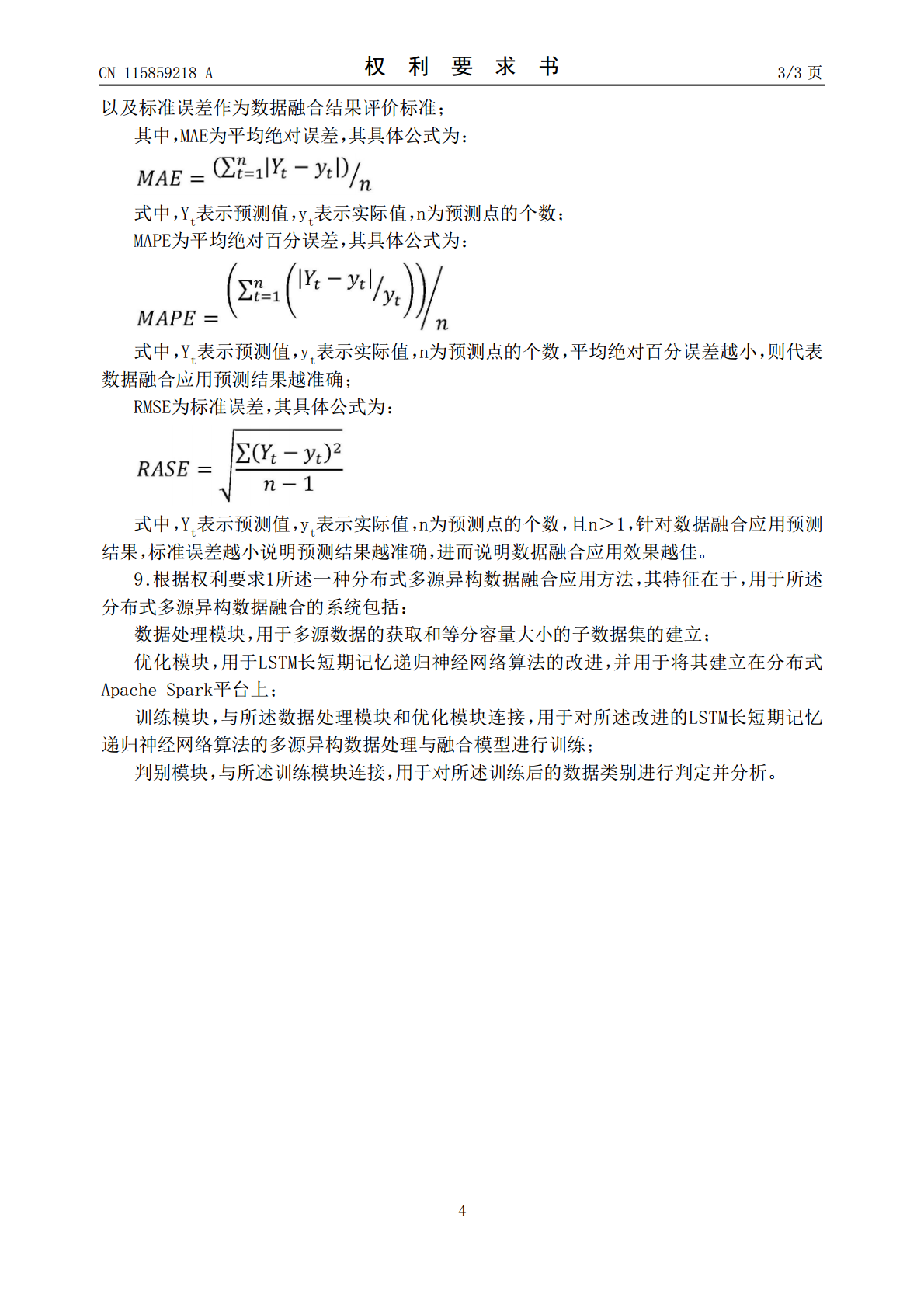

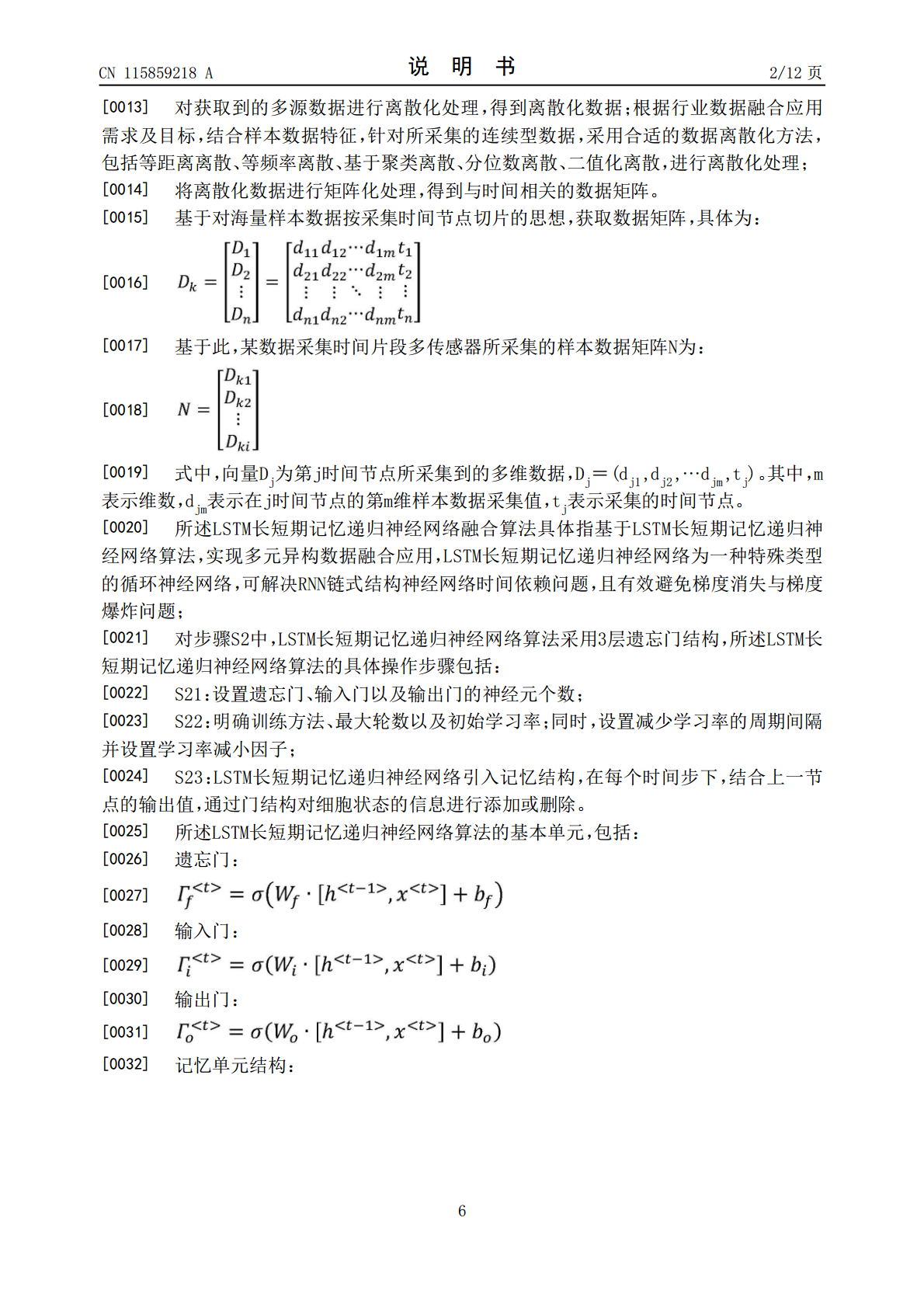

本发明涉及一种分布式多源异构数据融合应用方法,方法包括:获取多源数据并对其进行划分,得到等分多个弹性子数据集;利用SparkShuffle并行化处理模型对LSTM长短期记忆递归神经网络算法进行改进,并将其建立在分布式ApacheSpark平台上;改进的网络融合算法对各子数据集中的样本数据处理与融合模型进行训练;对各子数据集中的样本数据进行数据融合,并输出Map任务中间数据,判定数据的类别,以此得到最终的预测值。本发明可广泛适用于大数据时代背景下各行业海量的多源异构数据的融合应用,并可有效提高海量数据融

一种多源异构的数据融合方法及装置.pdf

本申请涉及一种多源异构的数据融合方法及装置,涉及数据处理技术领域,方法包括:获取待融合数据,对待融合数据中各字段赋予不同的权重算子,根据预先设定的数据关联规则和待融合数据中各字段的权重算子对待融合数据进行关联融合,得到待处理数据,最后对待处理数据进行标准化处理。本申请中综合考虑多种因素,对待融合数据中各字段赋予不同的权重算子,如对预期准确度高的字段赋予相对较高的权重算子,对预期准确度低的字段赋予相对较低的权重算子,在进行关联融合时使融合数据对数据的紧密依赖程度更高,从而得到的融合数据更加准确、可靠。

多源异构数据融合优化方法.pdf

本发明公开了一种多源异构数据融合优化方法,包括如下步骤:A)对数据实例、类别和属性进行提取和分析,建立词库和短文本库;B)从互联网获取多源异构数据;C)对多源异构数据进行规范化处理,生成短文本;短文本有多个词构成,规范化处理包括分词和去除停用词;D)将短文本作为待匹配短文本,将待匹配短文本与短文本库中存储的短文本进行匹配,得到短文本匹配结果;E)根据短文本匹配结果对数据进行融合,建立大数据内容模型,得到数据融合结果;F)对数据融合结果进行评价,得到评价结果;评价结果包括优、良、中和差。本发明能建立完整性、

一种基于FC-SAE的多源异构数据融合方法.pdf

本发明公开了一种基于FC‑SAE的多源异构数据融合方法,包括FC‑SAE数据融合模型,所述的FC‑SAE数据融合模型包括文本特征提取模块、时间序列建模模块以及异构数据特征融合模块,所述的文本特征提取模块包括GloVe词嵌入模型和卷积神经网络,所述的时间序列建模模块使用多层全连接神经网络进行建模,所述的异构数据特征融合模块包括稀疏自动编码器。本发明优点在于:本申请在对时间序列数据进行去趋势的基础上,采用FC对时间序列进行建模,减小在某些时间序列预测问题上的误差,通过深度稀疏自动编码器作为融合模型,在保留最大

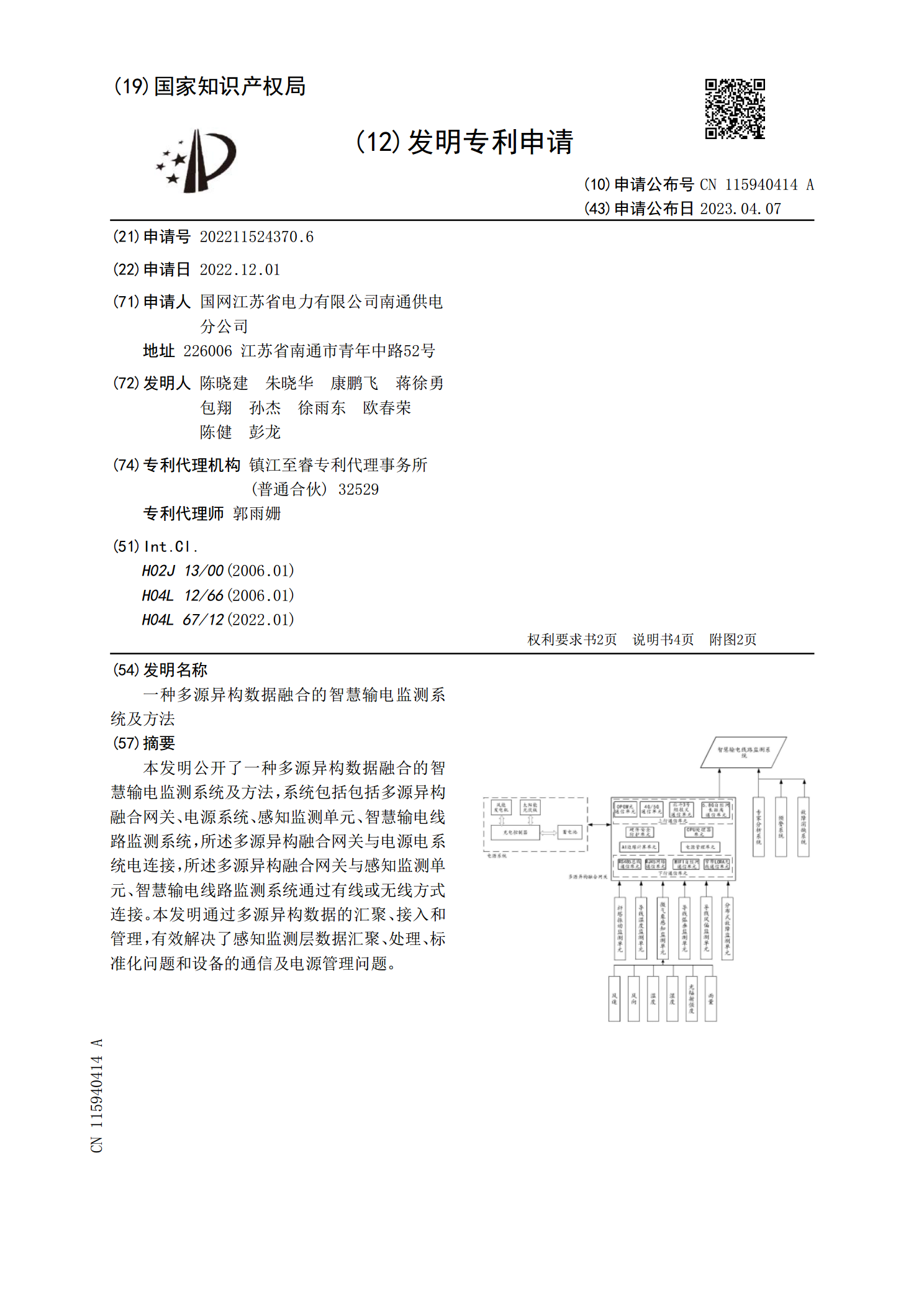

一种多源异构数据融合的智慧输电监测系统及方法.pdf

本发明公开了一种多源异构数据融合的智慧输电监测系统及方法,系统包括包括多源异构融合网关、电源系统、感知监测单元、智慧输电线路监测系统,所述多源异构融合网关与电源电系统电连接,所述多源异构融合网关与感知监测单元、智慧输电线路监测系统通过有线或无线方式连接。本发明通过多源异构数据的汇聚、接入和管理,有效解决了感知监测层数据汇聚、处理、标准化问题和设备的通信及电源管理问题。