一种基于位置注意力机制的编解码结构语义分割模型.pdf

一吃****仪凡

亲,该文档总共13页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于位置注意力机制的编解码结构语义分割模型.pdf

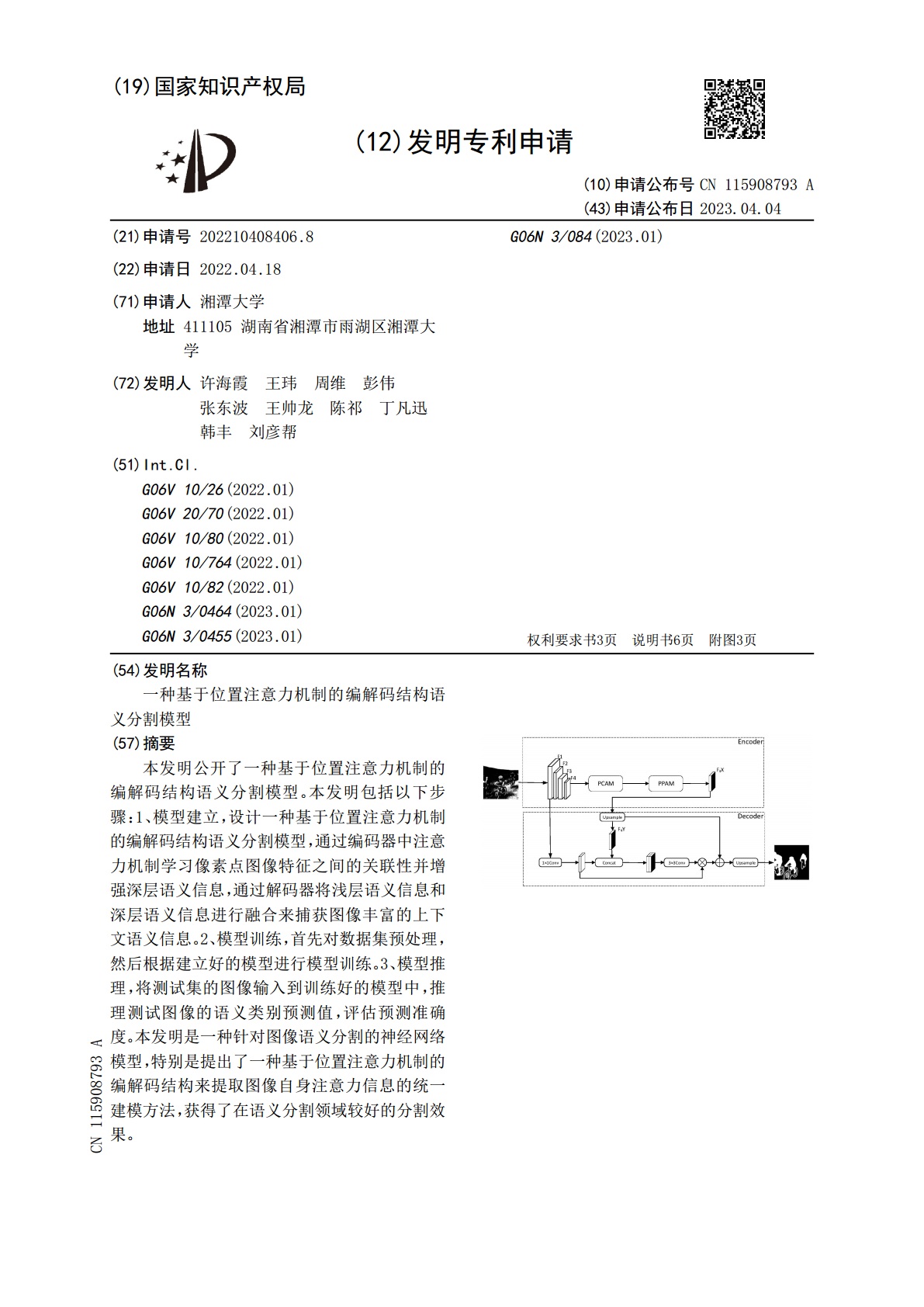

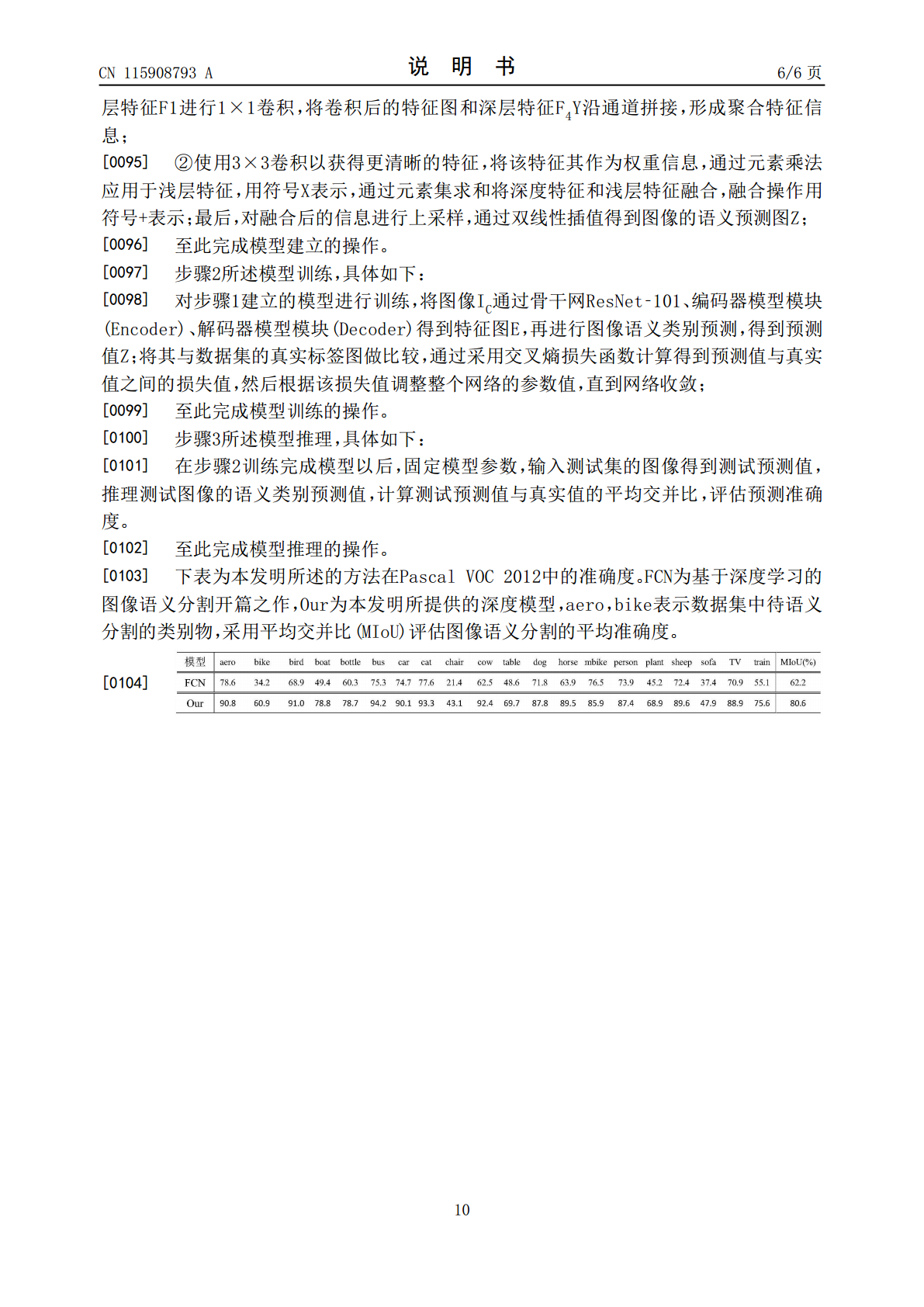

本发明公开了一种基于位置注意力机制的编解码结构语义分割模型。本发明包括以下步骤:1、模型建立,设计一种基于位置注意力机制的编解码结构语义分割模型,通过编码器中注意力机制学习像素点图像特征之间的关联性并增强深层语义信息,通过解码器将浅层语义信息和深层语义信息进行融合来捕获图像丰富的上下文语义信息。2、模型训练,首先对数据集预处理,然后根据建立好的模型进行模型训练。3、模型推理,将测试集的图像输入到训练好的模型中,推理测试图像的语义类别预测值,评估预测准确度。本发明是一种针对图像语义分割的神经网络模型,特别是

一种基于注意力机制的盲道语义分割方法.pdf

本发明涉及图像分割领域,具体为一种基于注意力机制的盲道语义分割方法,包括以下具体步骤:S1、获取数据,获得盲道语义分割数据集C;其中,盲道语义分割数据集包括训练集和验证集;S2、建立基于注意力机制的盲道语义分割网络;S3、利用训练集中的图像数据训练盲道语义分割网络,得到盲道语义分割网络模型;S4、将需要分割的图像,输入盲道语义分割网络模型中,输出语义分割效果图。本发明提供的盲道语义分割方法能有效地提高了分割网络的特征表达能力,改善了网络的性能,提高了盲道语义分割的准确度。

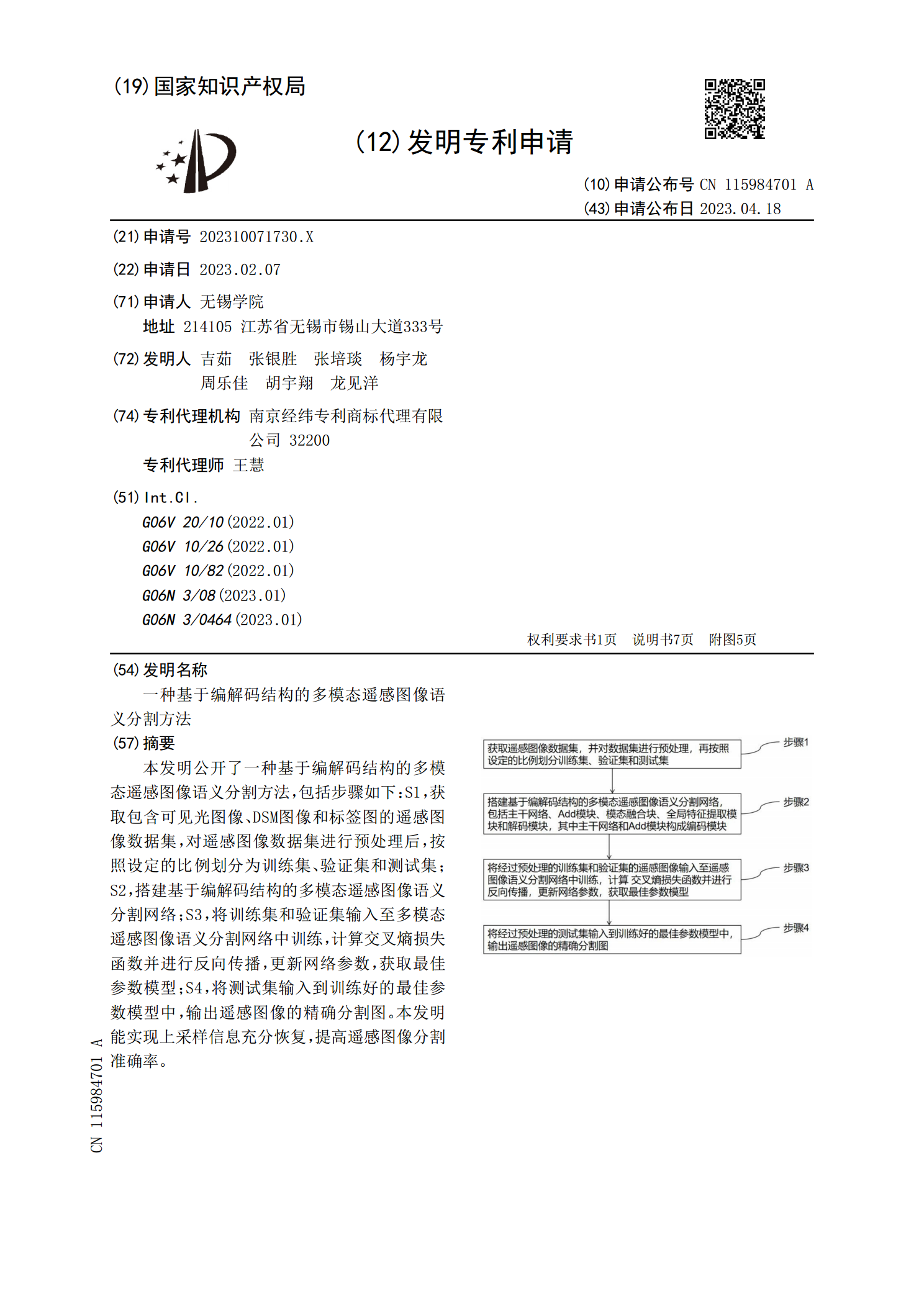

一种基于编解码结构的多模态遥感图像语义分割方法.pdf

本发明公开了一种基于编解码结构的多模态遥感图像语义分割方法,包括步骤如下:S1,获取包含可见光图像、DSM图像和标签图的遥感图像数据集,对遥感图像数据集进行预处理后,按照设定的比例划分为训练集、验证集和测试集;S2,搭建基于编解码结构的多模态遥感图像语义分割网络;S3,将训练集和验证集输入至多模态遥感图像语义分割网络中训练,计算交叉熵损失函数并进行反向传播,更新网络参数,获取最佳参数模型;S4,将测试集输入到训练好的最佳参数模型中,输出遥感图像的精确分割图。本发明能实现上采样信息充分恢复,提高遥感图像分割

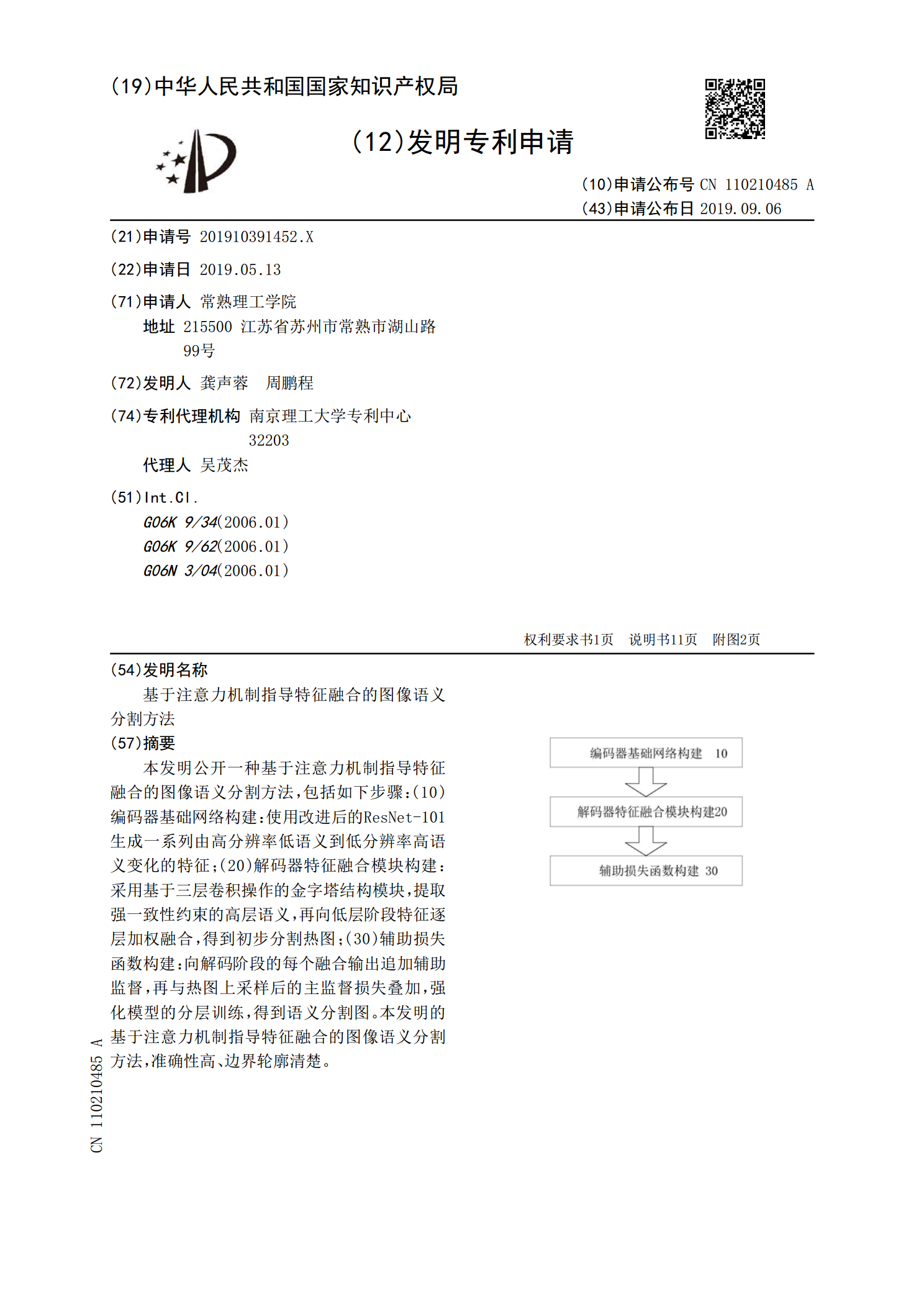

基于注意力机制指导特征融合的图像语义分割方法.pdf

本发明公开一种基于注意力机制指导特征融合的图像语义分割方法,包括如下步骤:(10)编码器基础网络构建:使用改进后的ResNet‑101生成一系列由高分辨率低语义到低分辨率高语义变化的特征;(20)解码器特征融合模块构建:采用基于三层卷积操作的金字塔结构模块,提取强一致性约束的高层语义,再向低层阶段特征逐层加权融合,得到初步分割热图;(30)辅助损失函数构建:向解码阶段的每个融合输出追加辅助监督,再与热图上采样后的主监督损失叠加,强化模型的分层训练,得到语义分割图。本发明的基于注意力机制指导特征融合的图像语

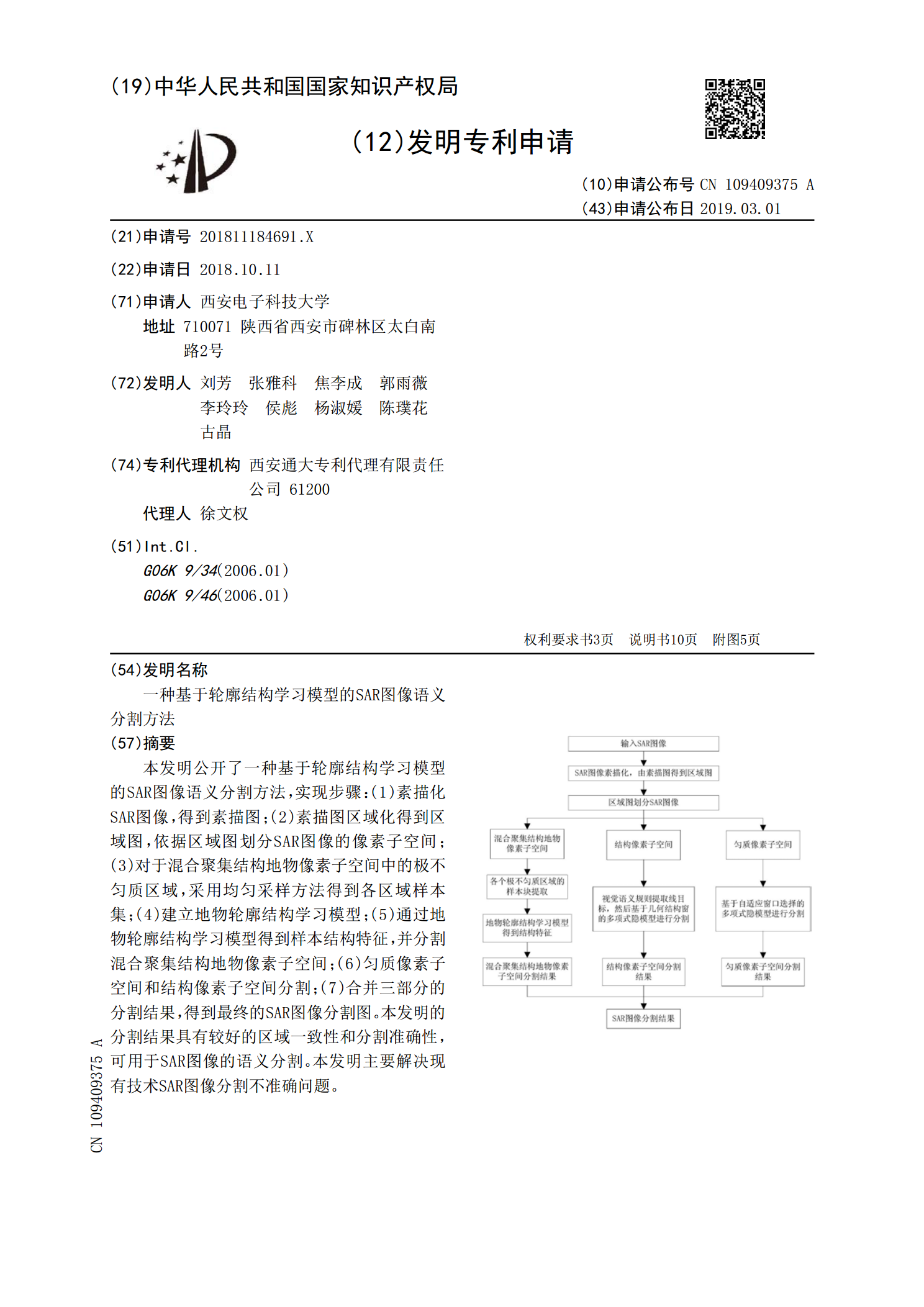

一种基于轮廓结构学习模型的SAR图像语义分割方法.pdf

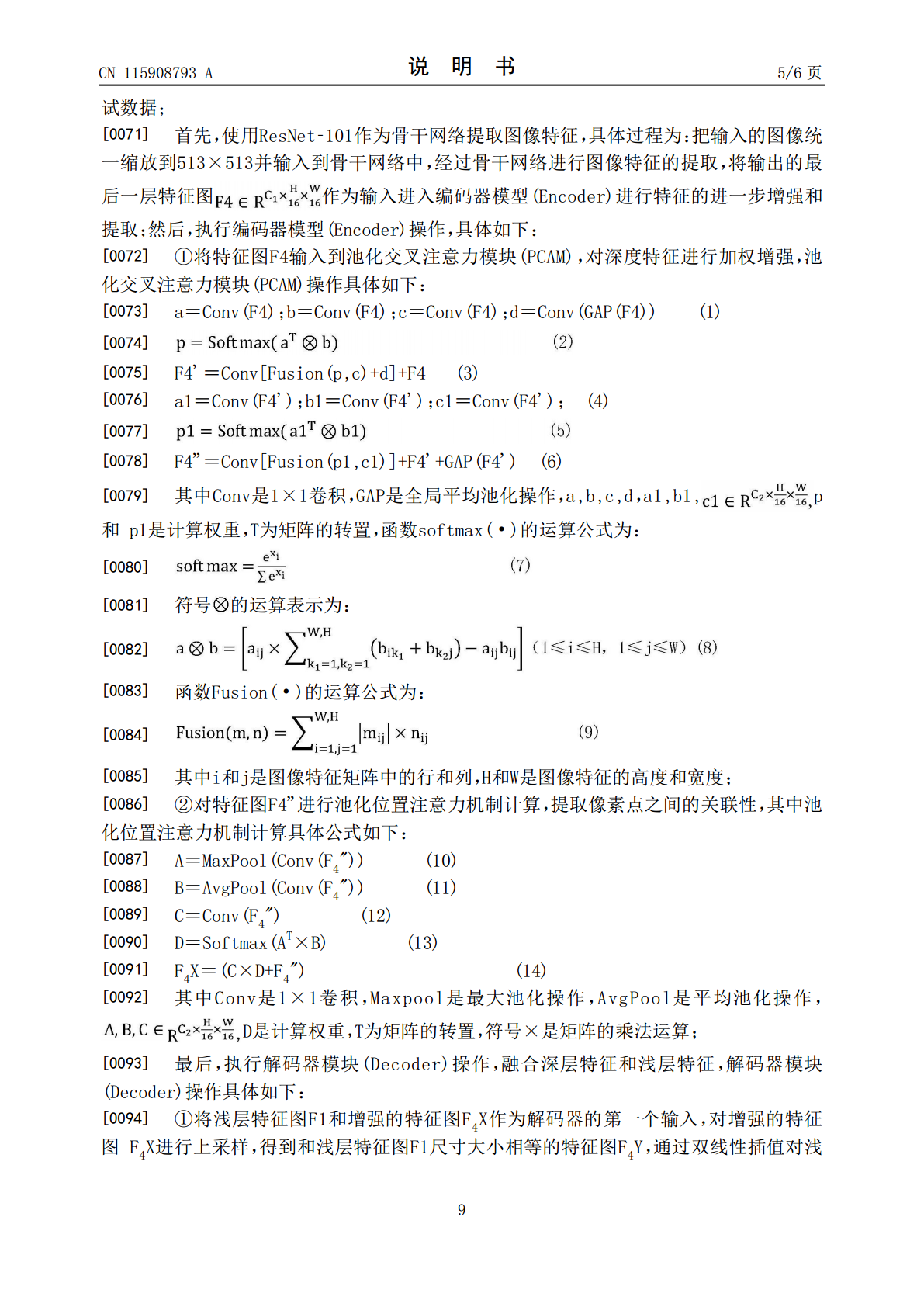

本发明公开了一种基于轮廓结构学习模型的SAR图像语义分割方法,实现步骤:(1)素描化SAR图像,得到素描图;(2)素描图区域化得到区域图,依据区域图划分SAR图像的像素子空间;(3)对于混合聚集结构地物像素子空间中的极不匀质区域,采用均匀采样方法得到各区域样本集;(4)建立地物轮廓结构学习模型;(5)通过地物轮廓结构学习模型得到样本结构特征,并分割混合聚集结构地物像素子空间;(6)匀质像素子空间和结构像素子空间分割;(7)合并三部分的分割结果,得到最终的SAR图像分割图。本发明的分割结果具有较好的区域一致