一种基于多源聚合神经网络的知识图谱补全方法.pdf

睿德****找我

亲,该文档总共11页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于多源聚合神经网络的知识图谱补全方法.pdf

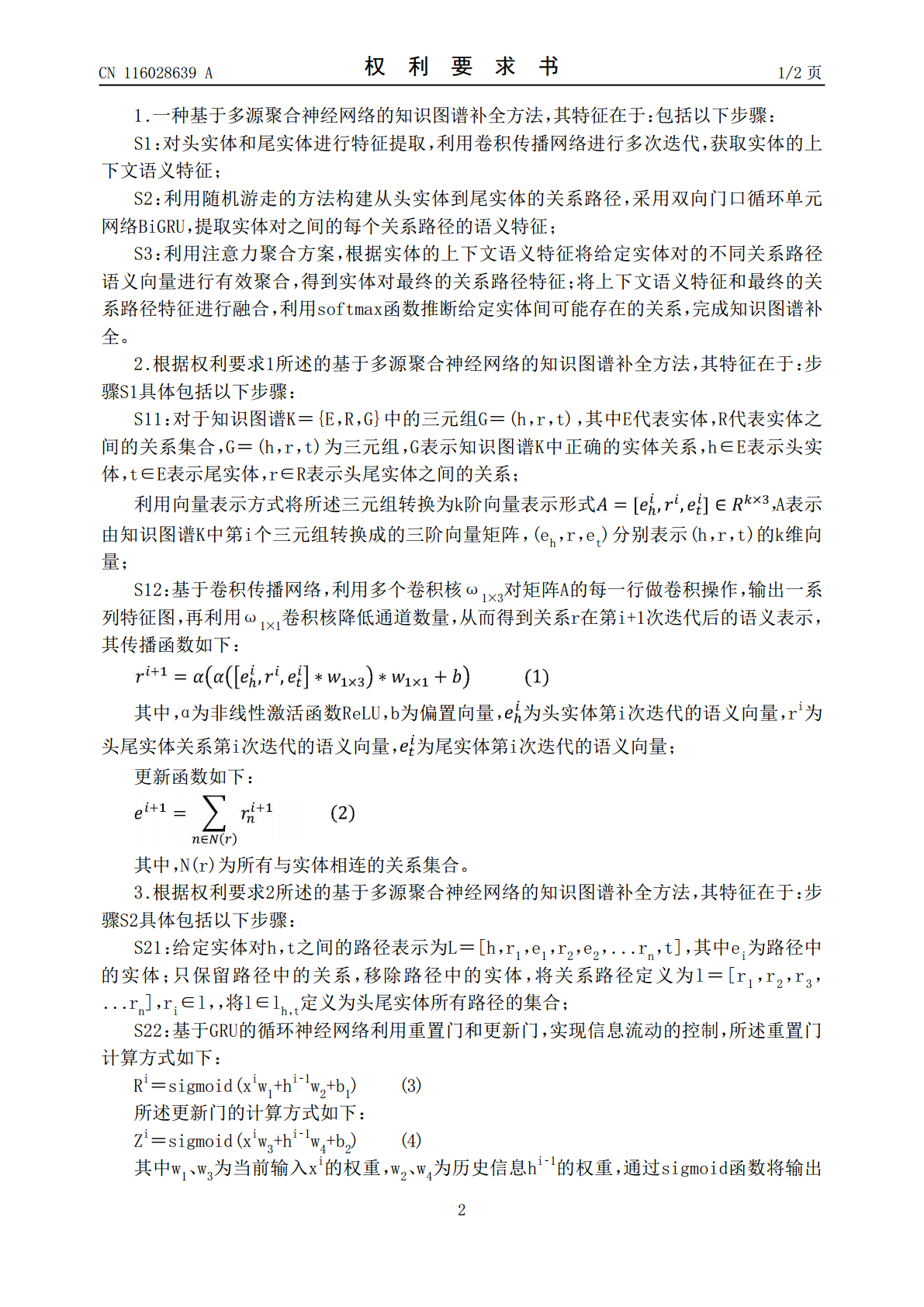

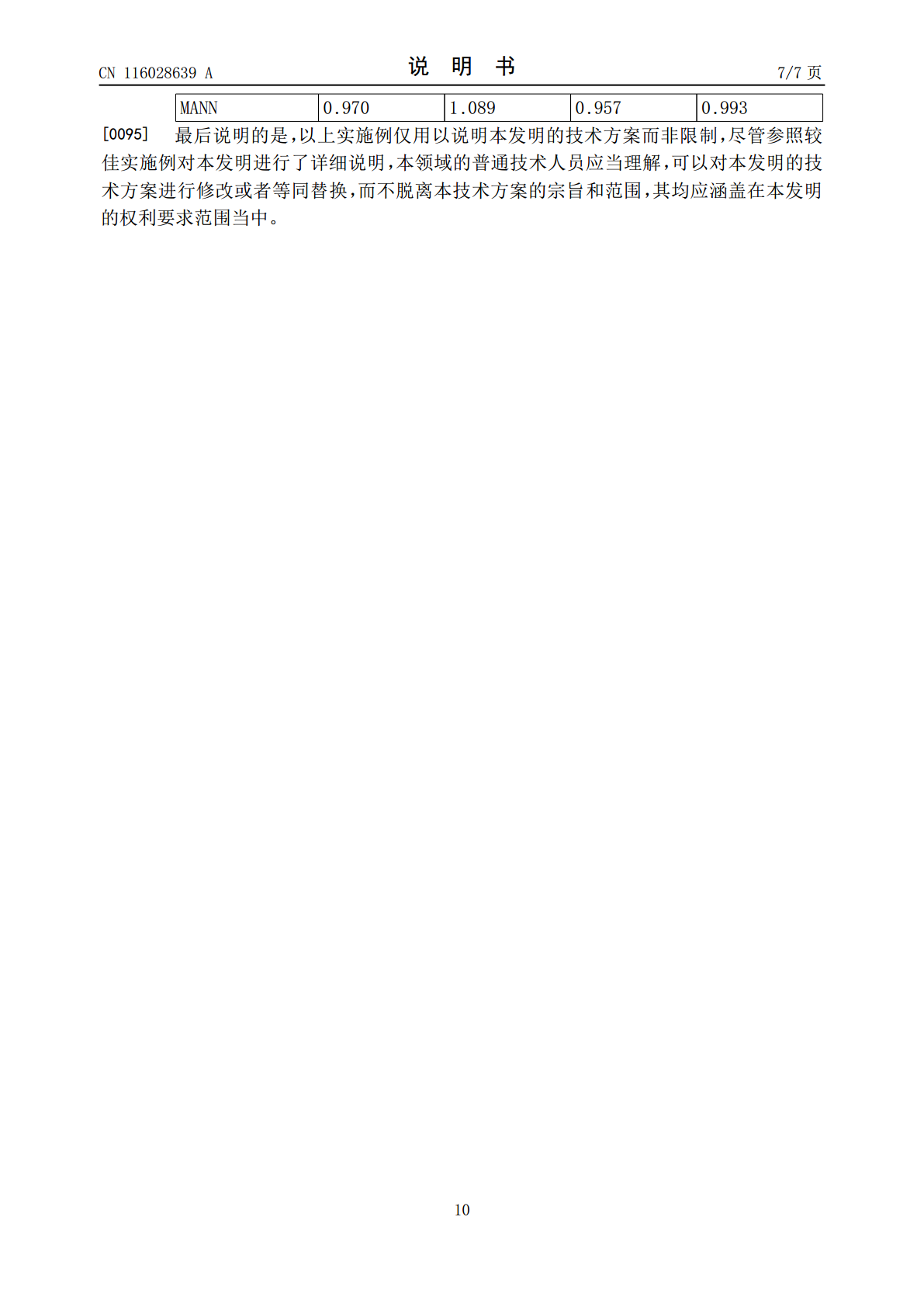

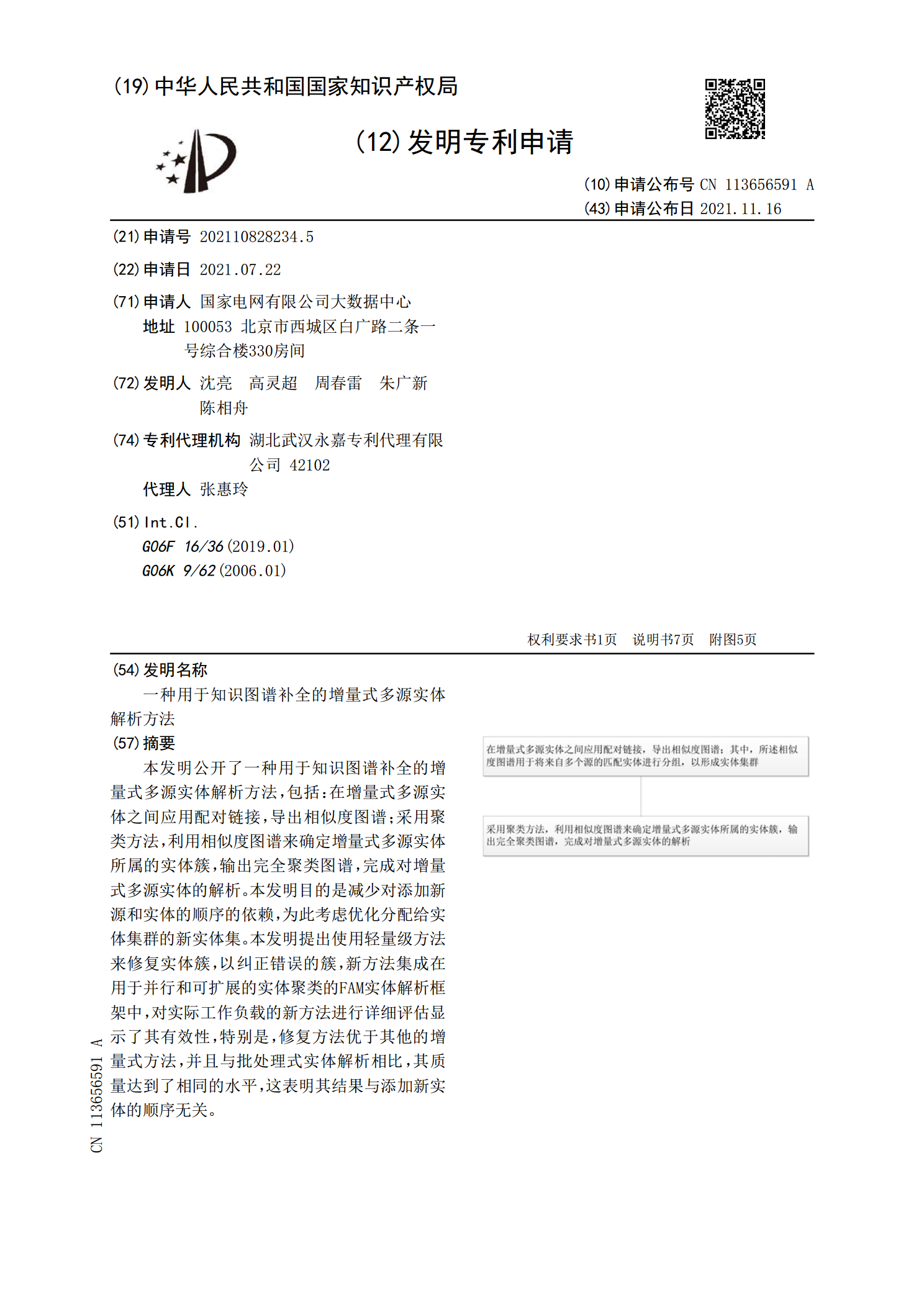

本发明涉及一种基于多源聚合神经网络的知识图谱补全方法,属于自然语言处理领域,包括以下步骤:S1:对头实体和尾实体进行特征提取,利用卷积传播网络进行多次迭代,获取实体的上下文语义特征;S2:利用随机游走的方法构建从头实体到尾实体的关系路径,采用双向门口循环单元网络BiGRU,提取实体对之间的每个关系路径的语义特征;S3:利用注意力聚合方案,根据实体的上下文语义特征将给定实体对的不同关系路径语义向量进行有效聚合,得到实体对最终的关系路径特征;将上下文语义特征和最终的关系路径特征进行融合,利用softmax函数

一种用于知识图谱补全的增量式多源实体解析方法.pdf

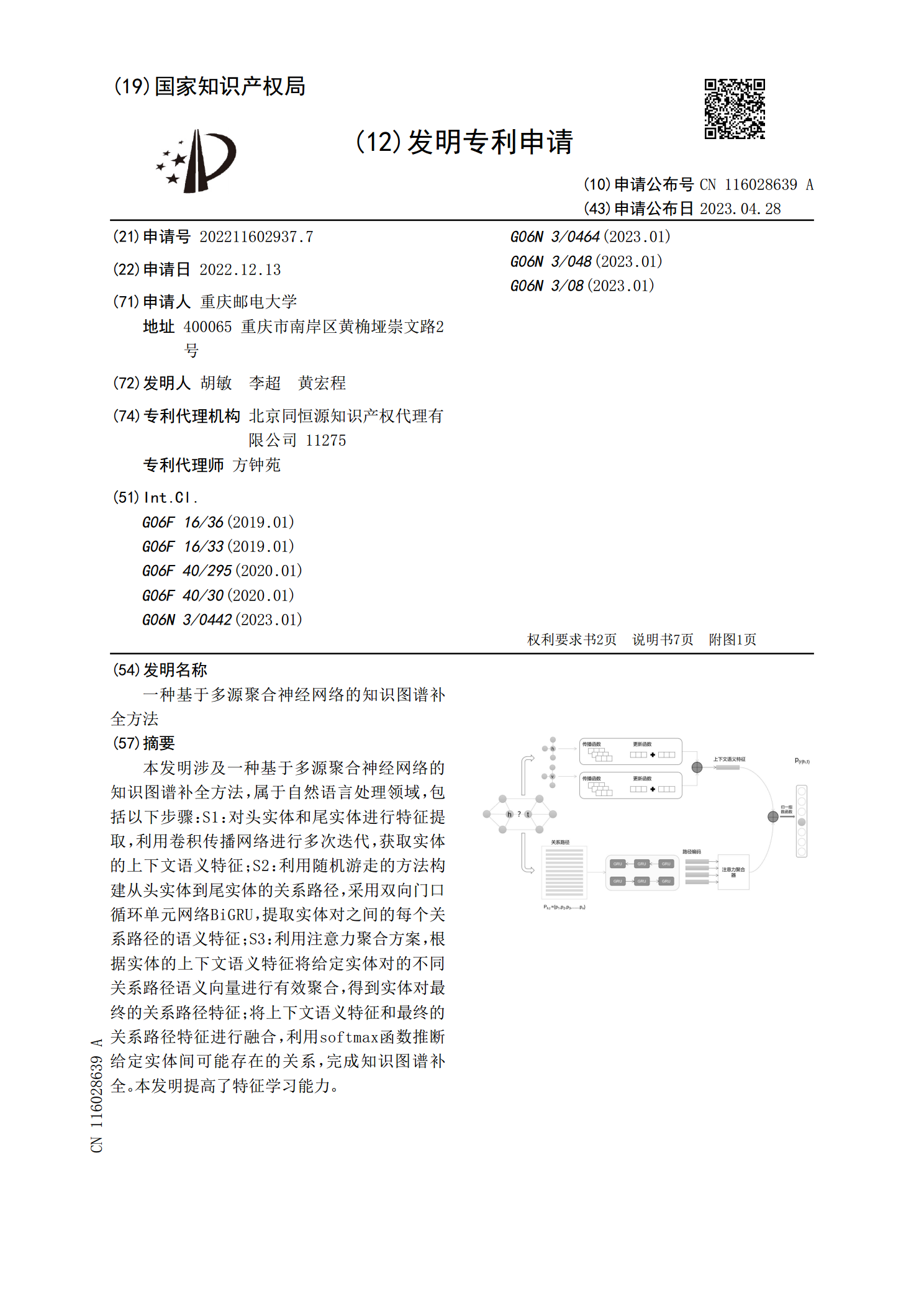

本发明公开了一种用于知识图谱补全的增量式多源实体解析方法,包括:在增量式多源实体之间应用配对链接,导出相似度图谱;采用聚类方法,利用相似度图谱来确定增量式多源实体所属的实体簇,输出完全聚类图谱,完成对增量式多源实体的解析。本发明目的是减少对添加新源和实体的顺序的依赖,为此考虑优化分配给实体集群的新实体集。本发明提出使用轻量级方法来修复实体簇,以纠正错误的簇,新方法集成在用于并行和可扩展的实体聚类的FAM实体解析框架中,对实际工作负载的新方法进行详细评估显示了其有效性,特别是,修复方法优于其他的增量式方法,

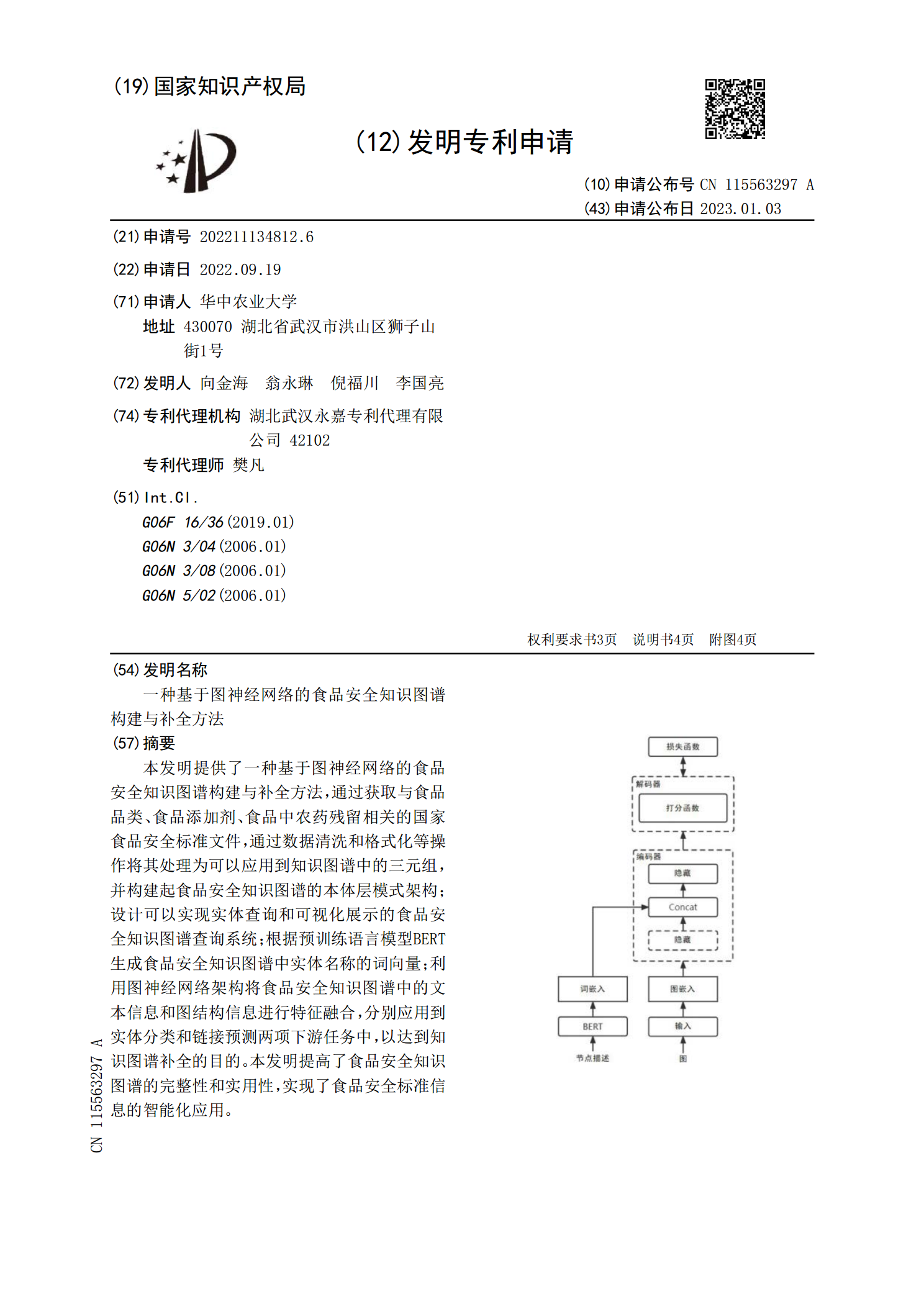

一种基于图神经网络的食品安全知识图谱构建与补全方法.pdf

本发明提供了一种基于图神经网络的食品安全知识图谱构建与补全方法,通过获取与食品品类、食品添加剂、食品中农药残留相关的国家食品安全标准文件,通过数据清洗和格式化等操作将其处理为可以应用到知识图谱中的三元组,并构建起食品安全知识图谱的本体层模式架构;设计可以实现实体查询和可视化展示的食品安全知识图谱查询系统;根据预训练语言模型BERT生成食品安全知识图谱中实体名称的词向量;利用图神经网络架构将食品安全知识图谱中的文本信息和图结构信息进行特征融合,分别应用到实体分类和链接预测两项下游任务中,以达到知识图谱补全的

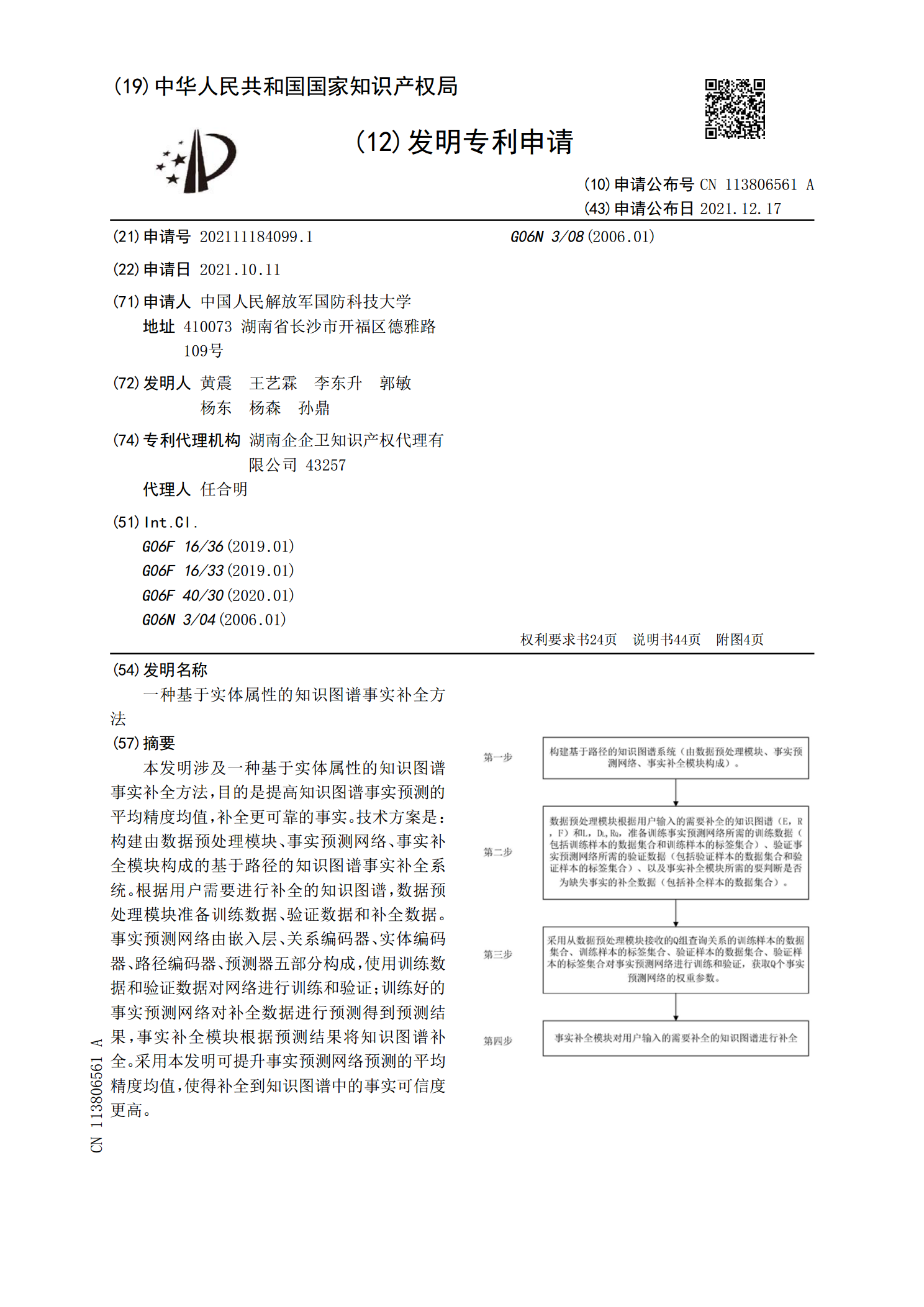

一种基于实体属性的知识图谱事实补全方法.pdf

本发明涉及一种基于实体属性的知识图谱事实补全方法,目的是提高知识图谱事实预测的平均精度均值,补全更可靠的事实。技术方案是:构建由数据预处理模块、事实预测网络、事实补全模块构成的基于路径的知识图谱事实补全系统。根据用户需要进行补全的知识图谱,数据预处理模块准备训练数据、验证数据和补全数据。事实预测网络由嵌入层、关系编码器、实体编码器、路径编码器、预测器五部分构成,使用训练数据和验证数据对网络进行训练和验证;训练好的事实预测网络对补全数据进行预测得到预测结果,事实补全模块根据预测结果将知识图谱补全。采用本发明

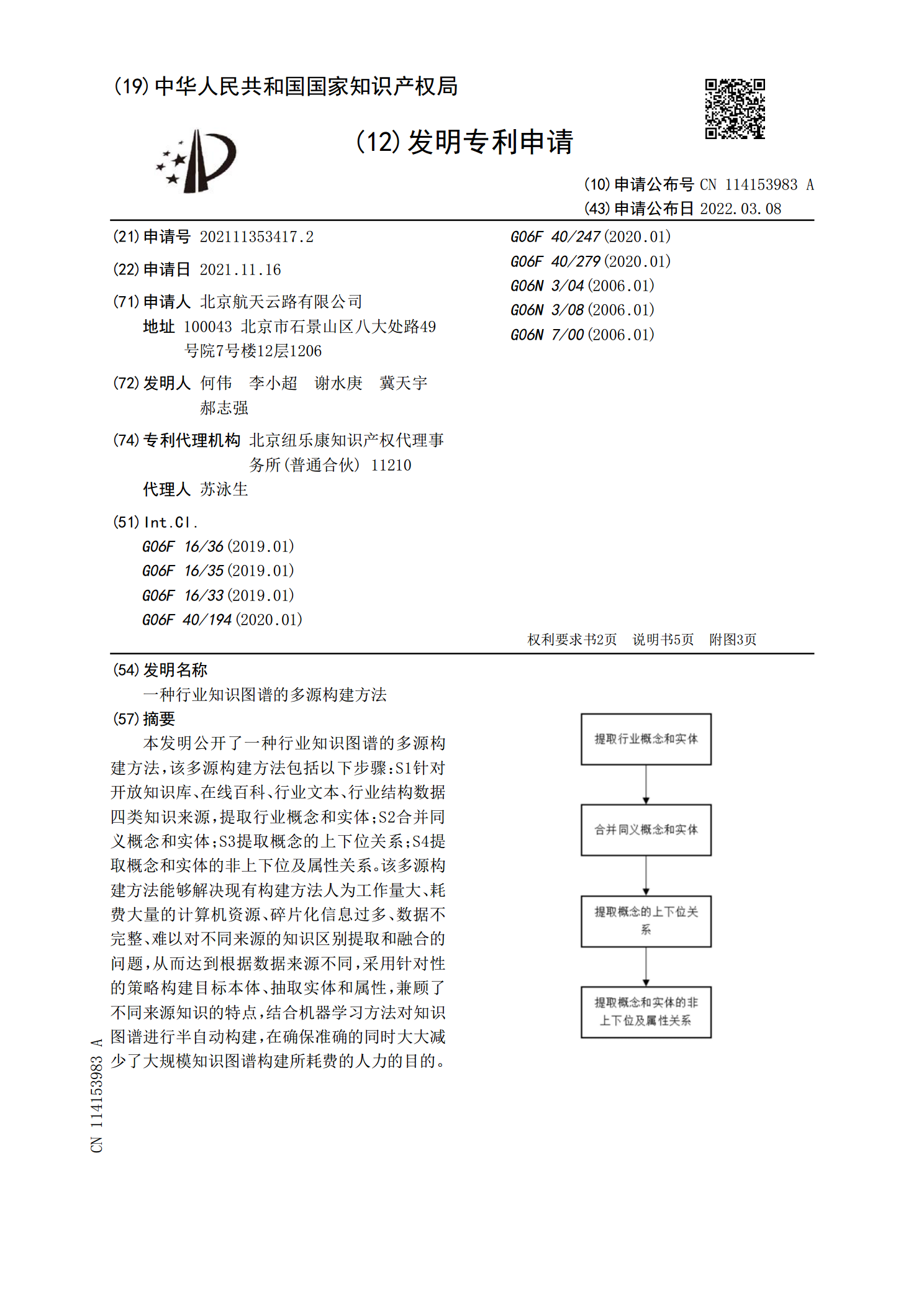

一种行业知识图谱的多源构建方法.pdf

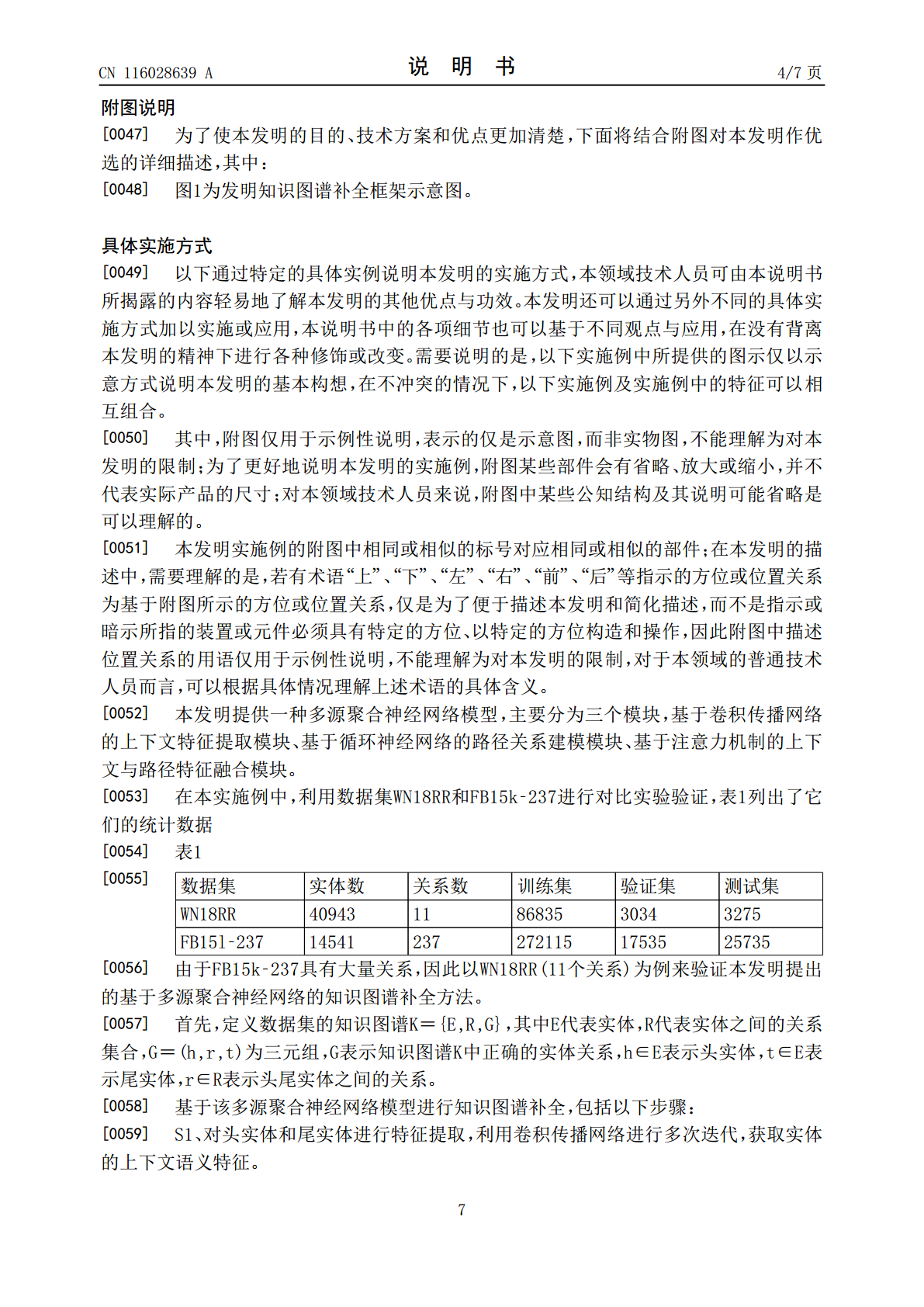

本发明公开了一种行业知识图谱的多源构建方法,该多源构建方法包括以下步骤:S1针对开放知识库、在线百科、行业文本、行业结构数据四类知识来源,提取行业概念和实体;S2合并同义概念和实体;S3提取概念的上下位关系;S4提取概念和实体的非上下位及属性关系。该多源构建方法能够解决现有构建方法人为工作量大、耗费大量的计算机资源、碎片化信息过多、数据不完整、难以对不同来源的知识区别提取和融合的问题,从而达到根据数据来源不同,采用针对性的策略构建目标本体、抽取实体和属性,兼顾了不同来源知识的特点,结合机器学习方法对知识图