一种基于生成对抗网络的视线估计方法.pdf

文阁****23

在线预览结束,喜欢就下载吧,查找使用更方便

相关资料

一种基于生成对抗网络的视线估计方法.pdf

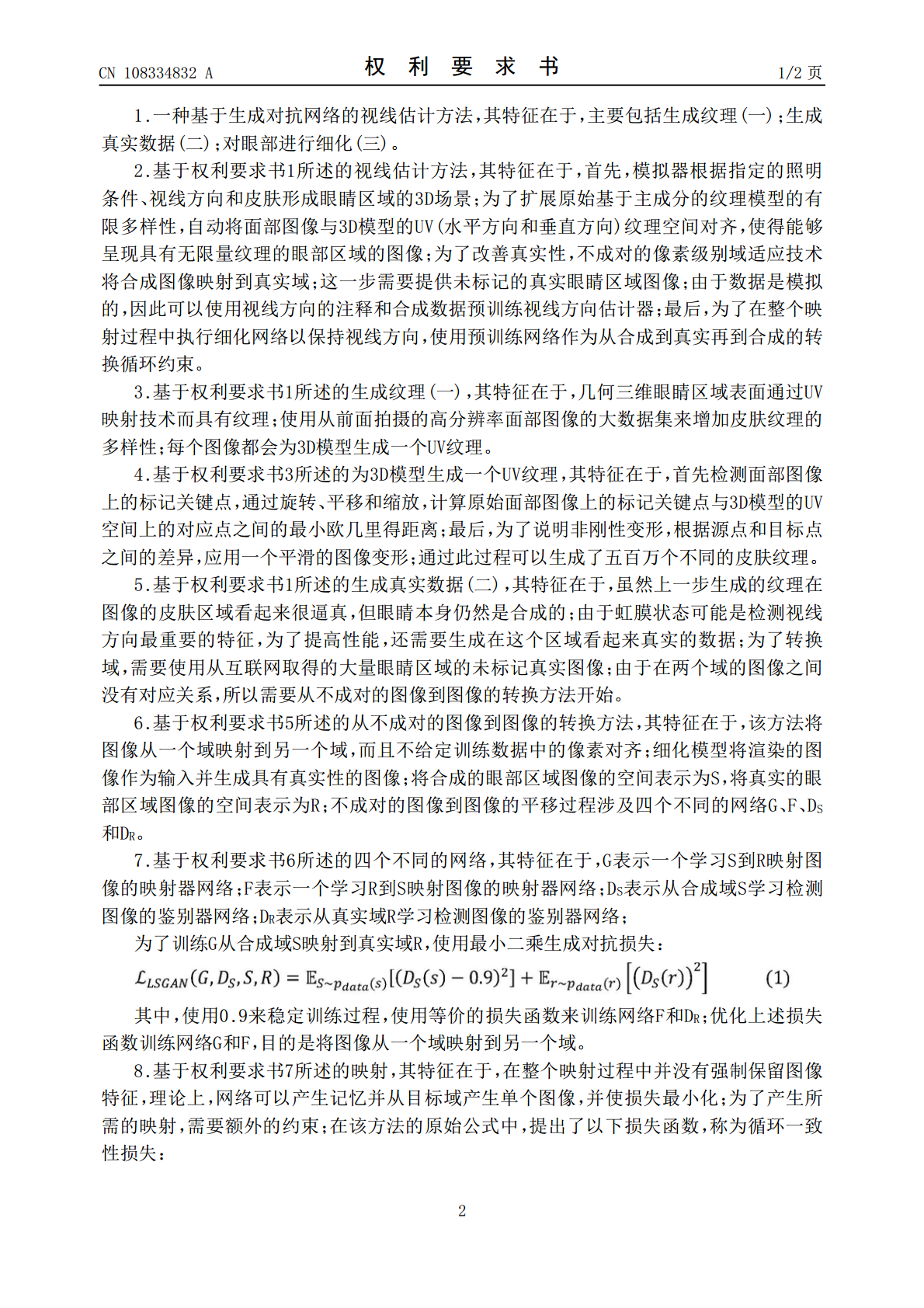

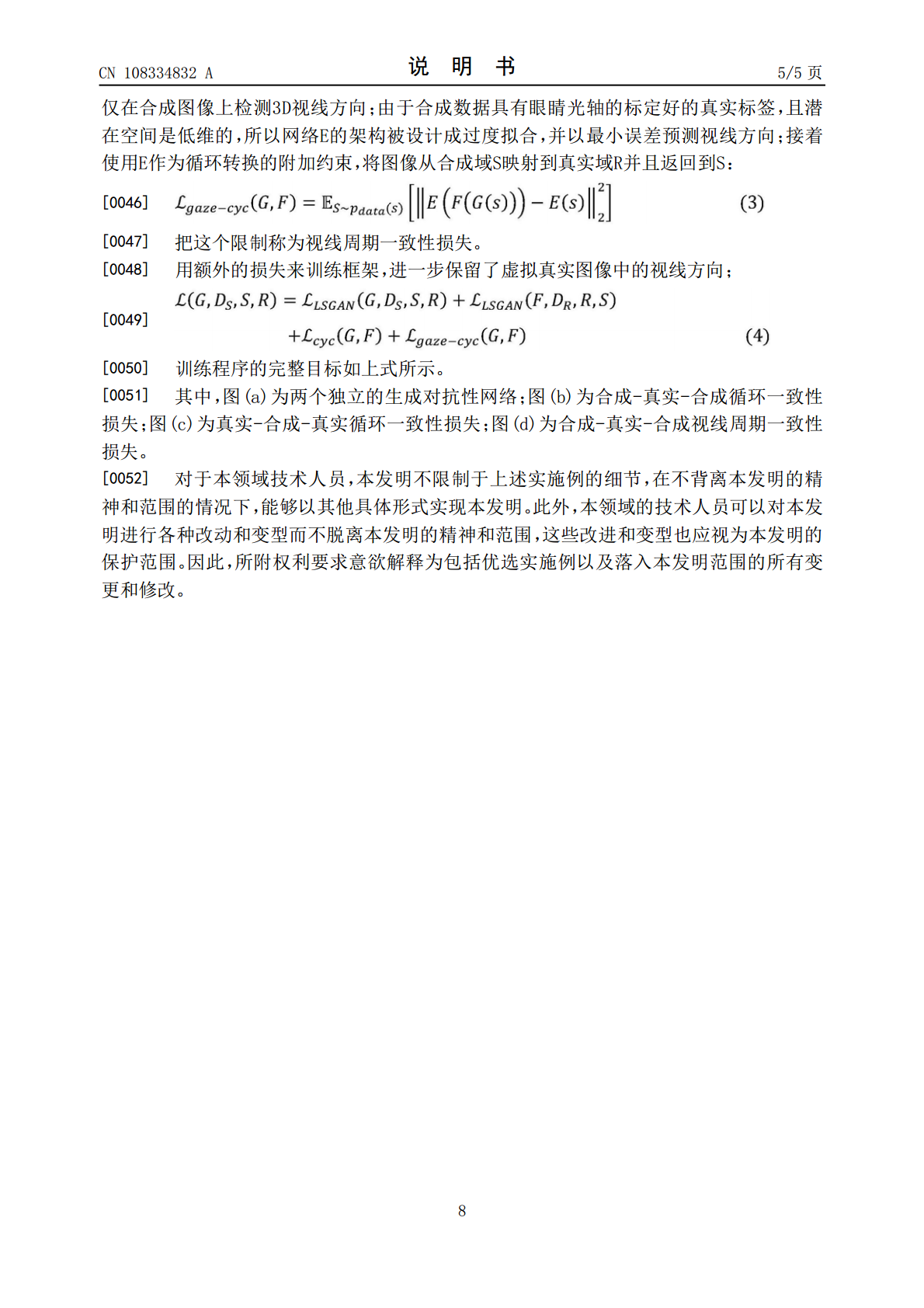

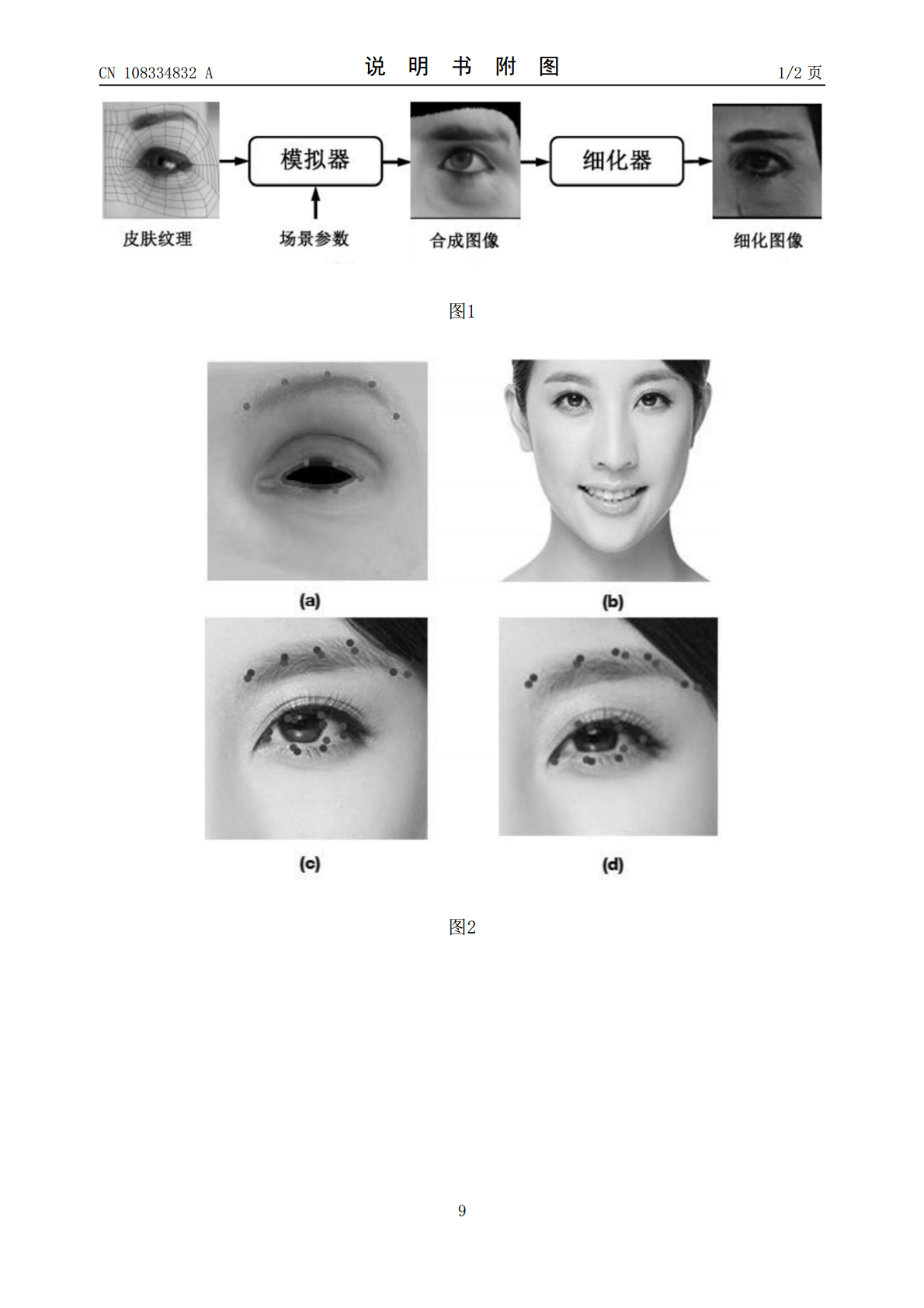

本发明中提出的一种基于生成对抗网络的视线估计方法,其主要内容包括:生成纹理、生成真实数据和对眼部进行细化,其过程为,先自动将面部图像与3D模型的水平方向和垂直方向的纹理空间对齐,然后不成对的像素级别域适应技术将合成图像映射到真实域,再使用视线方向的注释和合成数据预训练视线方向估计器,最后在整个映射过程中执行细化网络以保持视线方向,使用预训练网络作为从合成到真实再到合成的转换循环约束。本发明使用新颖的对抗训练方法,将渲染的合成图像映射到逼真的域,可以在实际图像上获得更准确的视线估计,而不需要使用任何来自真实

一种基于分布估计的条件生成对抗网络文本生成图像方法.pdf

本发明公开了一种基于分布估计的条件生成对抗网络文本生成图像方法用。本发明步骤如下:步骤(1)、数据预处理,提取文本数据的特征;步骤(2)、建立多阶段的无条件和有条件联合生成对抗神经网络和损失函数;步骤(3)、引入基于分布估计的损失函数;步骤(4)、模型训练;根据得到的新的损失函数,在训练过程中对判别器D<base:Sub>i</base:Sub>和生成器G<base:Sub>i</base:Sub>进行交替训练。本发明损失隐式地体现了单个文本生成无限次图像的影响,优化的目标为单个文本描述生成图像的特征分布

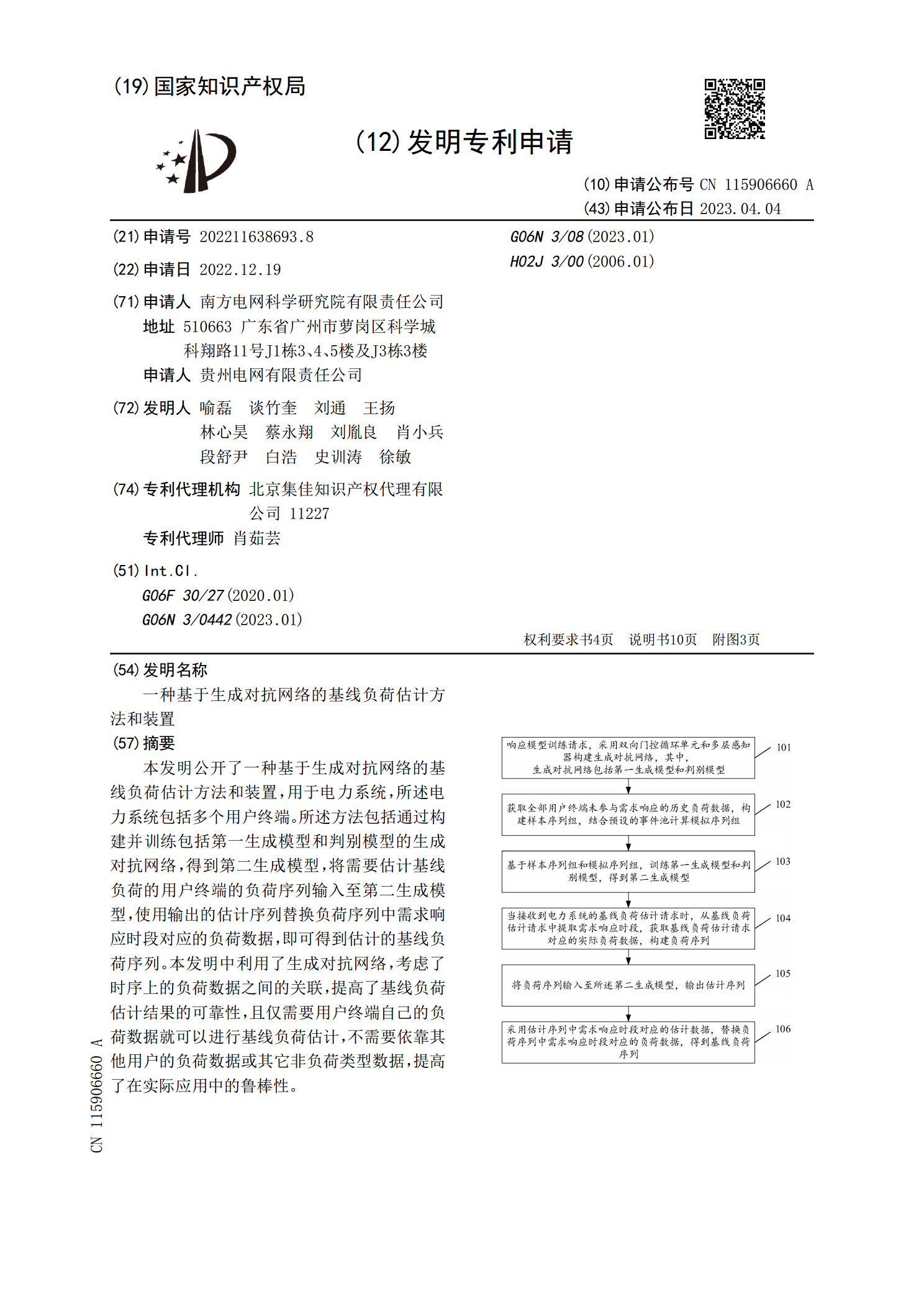

一种基于生成对抗网络的基线负荷估计方法和装置.pdf

本发明公开了一种基于生成对抗网络的基线负荷估计方法和装置,用于电力系统,所述电力系统包括多个用户终端。所述方法包括通过构建并训练包括第一生成模型和判别模型的生成对抗网络,得到第二生成模型,将需要估计基线负荷的用户终端的负荷序列输入至第二生成模型,使用输出的估计序列替换负荷序列中需求响应时段对应的负荷数据,即可得到估计的基线负荷序列。本发明中利用了生成对抗网络,考虑了时序上的负荷数据之间的关联,提高了基线负荷估计结果的可靠性,且仅需要用户终端自己的负荷数据就可以进行基线负荷估计,不需要依靠其他用户的负荷数据

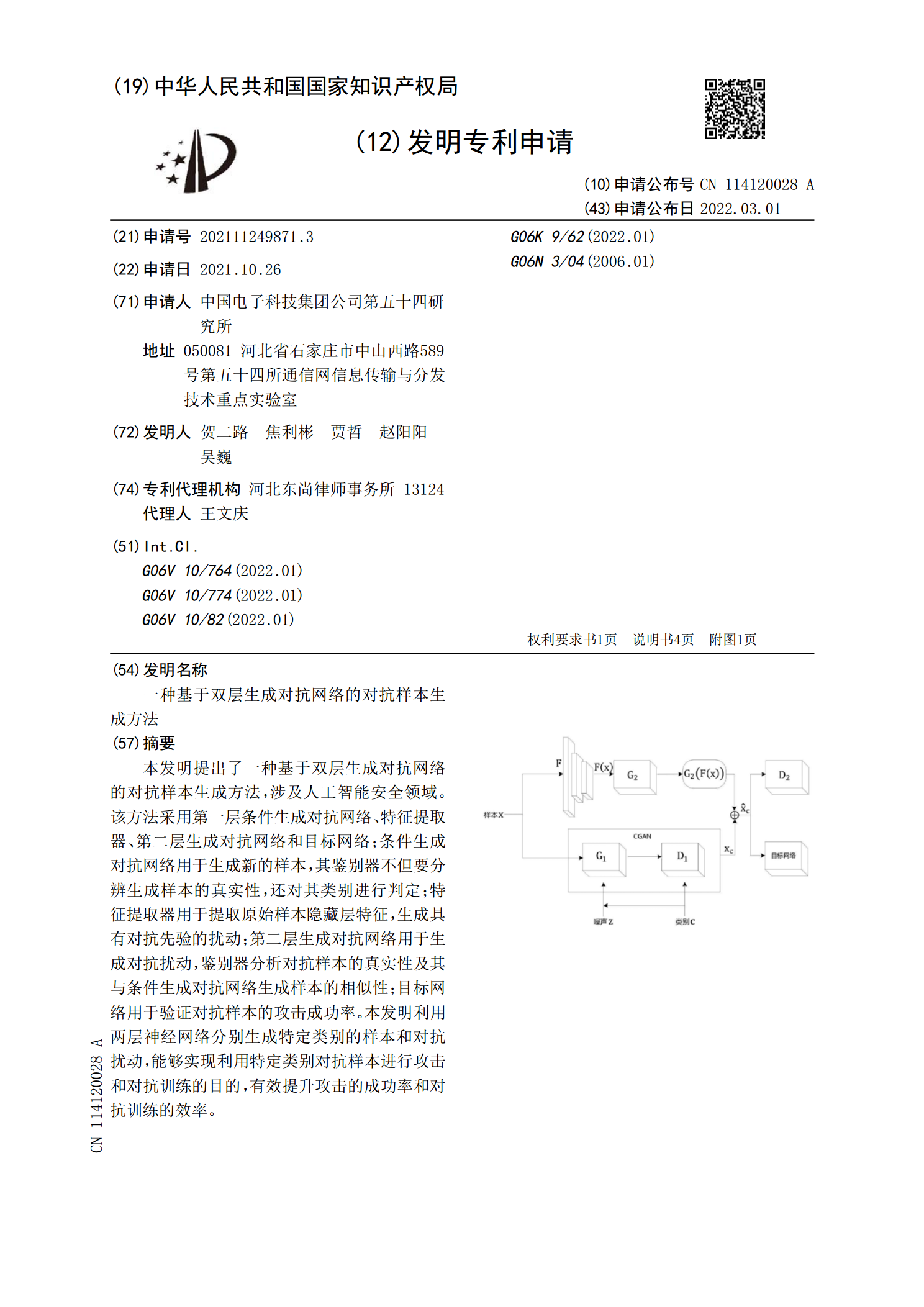

一种基于双层生成对抗网络的对抗样本生成方法.pdf

本发明提出了一种基于双层生成对抗网络的对抗样本生成方法,涉及人工智能安全领域。该方法采用第一层条件生成对抗网络、特征提取器、第二层生成对抗网络和目标网络;条件生成对抗网络用于生成新的样本,其鉴别器不但要分辨生成样本的真实性,还对其类别进行判定;特征提取器用于提取原始样本隐藏层特征,生成具有对抗先验的扰动;第二层生成对抗网络用于生成对抗扰动,鉴别器分析对抗样本的真实性及其与条件生成对抗网络生成样本的相似性;目标网络用于验证对抗样本的攻击成功率。本发明利用两层神经网络分别生成特定类别的样本和对抗扰动,能够实现

一种基于生成对抗网络的旋律生成方法.pdf

本发明公开了一种基于生成对抗网络的旋律生成方法,包括:数据预处理,从原始MIDI文件中提取出旋律轨道的事件序列;生成器训练,应用生成对抗网络对事件序列进行训练得到GAN生成器模型;音乐生成,利用GAN生成器模型生成音乐。采用对抗生成网络生成旋律,通过生成对抗模型的显著特征,即不断的在生成和判别之间进行博弈优化的特点,得到优质的旋律,帮助作曲家生成原始的旋律,有助于艺术创作。在判别器前增加增强判别器,增加领域知识的判断,更有利于训练过程中判别器快速收敛迭代,缩短训练时间。