一种基于改进型卷积神经网络口罩佩戴状态检测方法.pdf

猫巷****提格

亲,该文档总共12页,到这已经超出免费预览范围,如果喜欢就直接下载吧~

相关资料

一种基于改进型卷积神经网络口罩佩戴状态检测方法.pdf

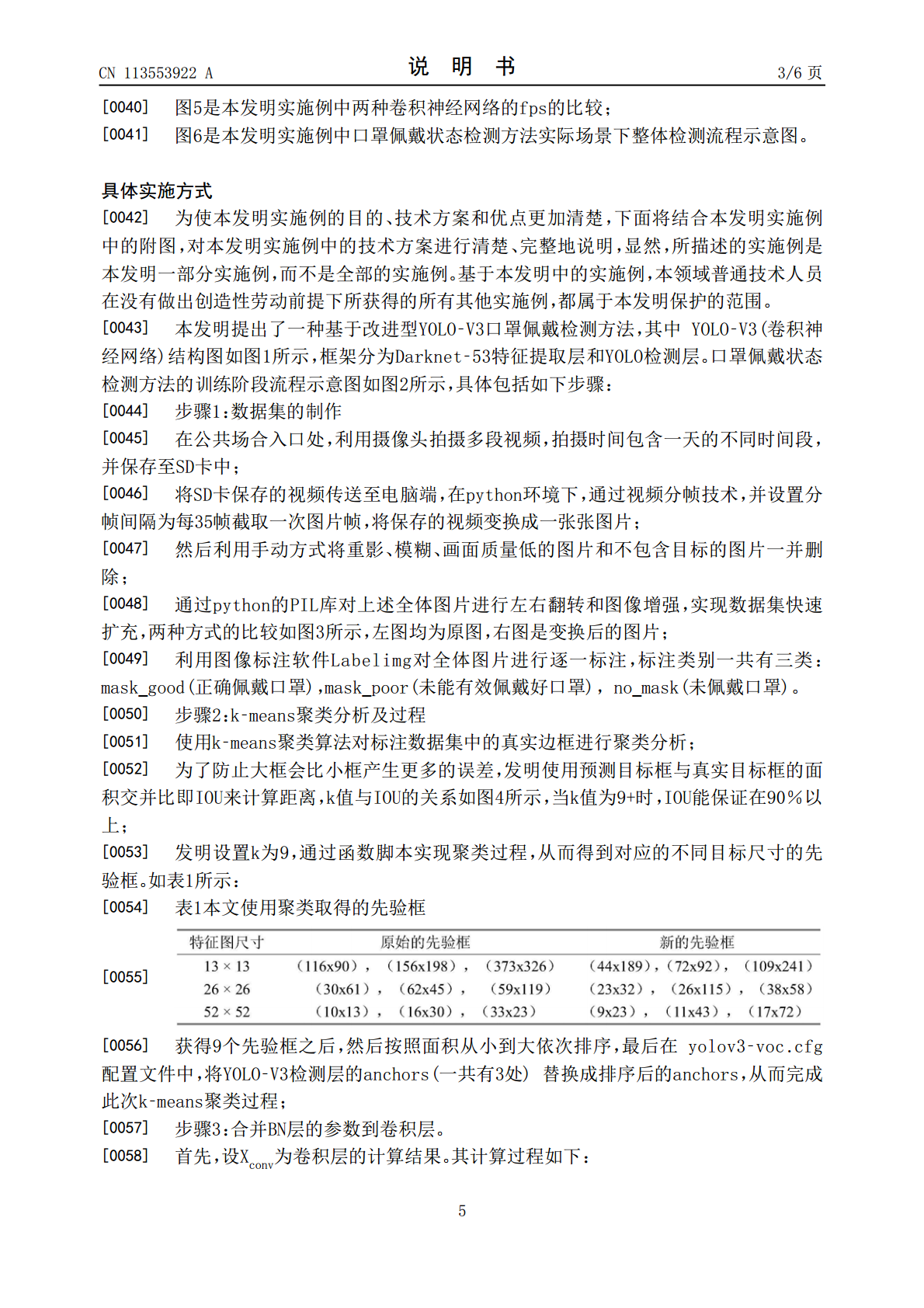

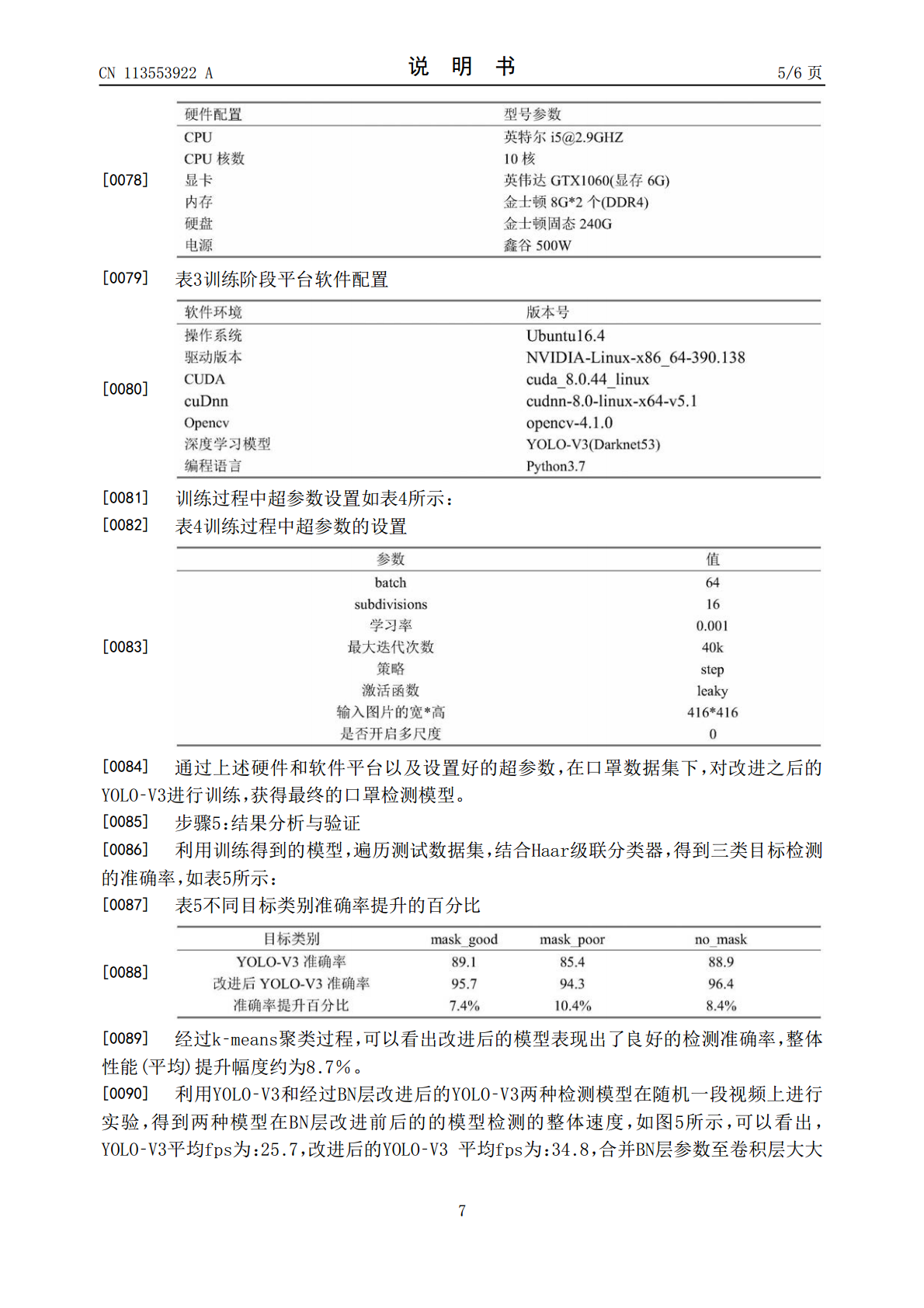

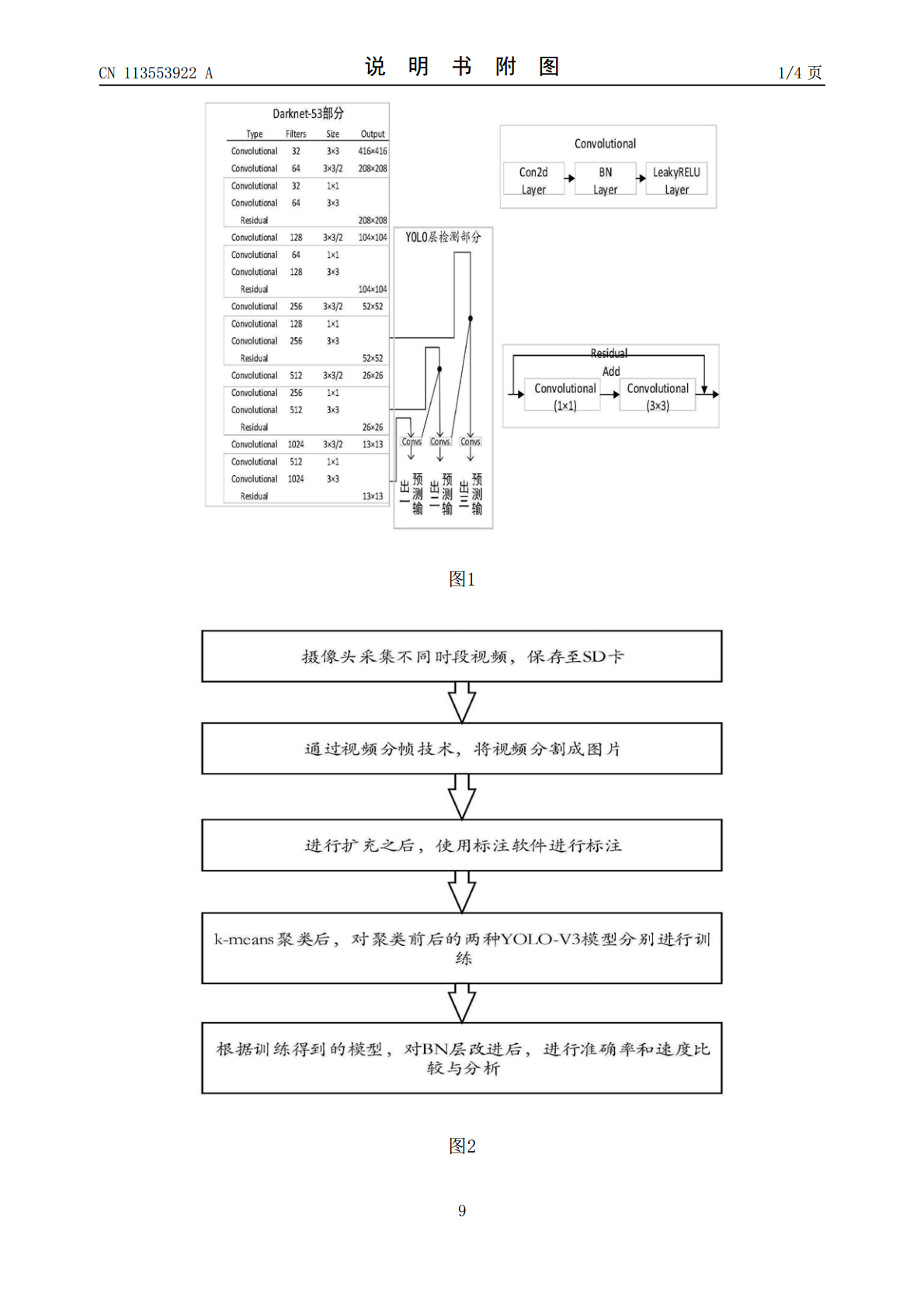

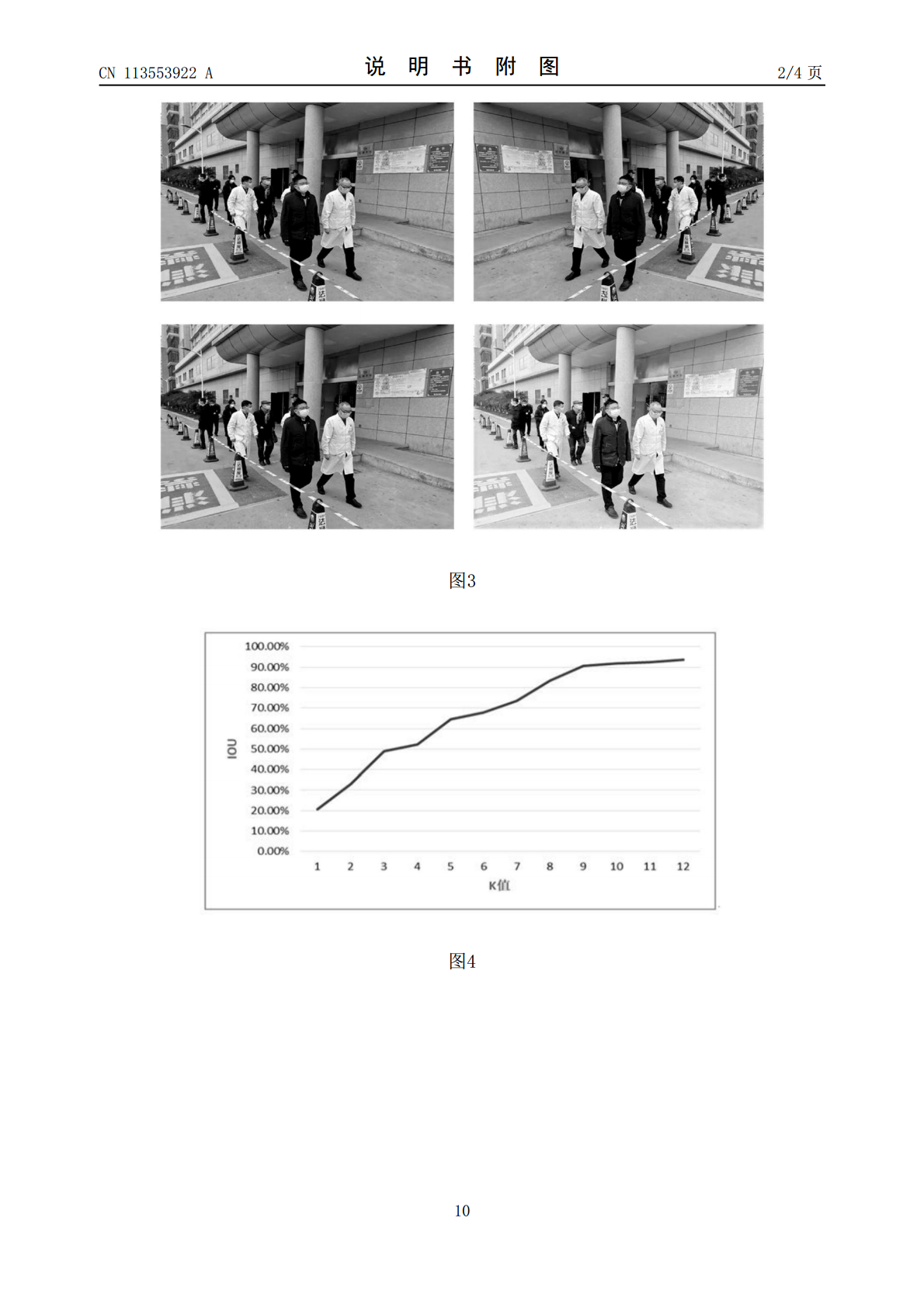

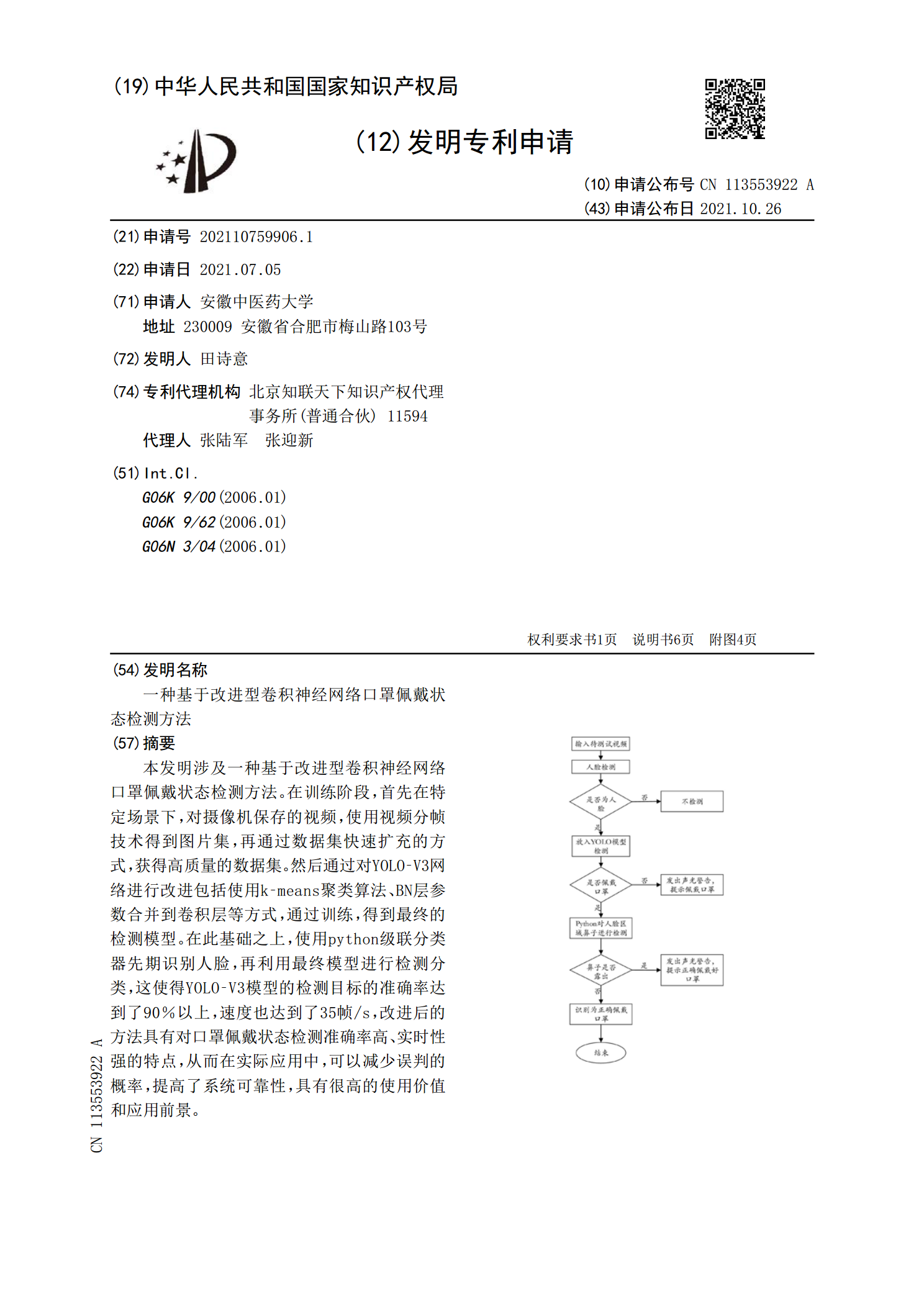

本发明涉及一种基于改进型卷积神经网络口罩佩戴状态检测方法。在训练阶段,首先在特定场景下,对摄像机保存的视频,使用视频分帧技术得到图片集,再通过数据集快速扩充的方式,获得高质量的数据集。然后通过对YOLO‑V3网络进行改进包括使用k‑means聚类算法、BN层参数合并到卷积层等方式,通过训练,得到最终的检测模型。在此基础之上,使用python级联分类器先期识别人脸,再利用最终模型进行检测分类,这使得YOLO‑V3模型的检测目标的准确率达到了90%以上,速度也达到了35帧/s,改进后的方法具有对口罩佩戴状态检

一种基于深度学习的人员口罩佩戴状态检测识别方法.pdf

本发明公开了一种基于深度学习的人员口罩佩戴状态检测识别方法。主要步骤包括:获取数据集;设计人脸检测网络,并在网络中添加第一特征向量输出;将检测到的口罩人脸区域通过比例随机裁剪输入第二深度学习网络模型的第一网络部分,第二网络部分和第三网络部分以获得三个代表全局、局部和细粒度特征的特征图;将三个特征图进行特征融合得到第二特征向量;将第一特征向量和第二特征向量融合,最后使用机器学习模型识别人脸口罩佩戴状态。这样,基于优化设计的神经网络,提取不同层次的深度特征并融合,能大幅提高人脸口罩佩戴状态识别的准确率。

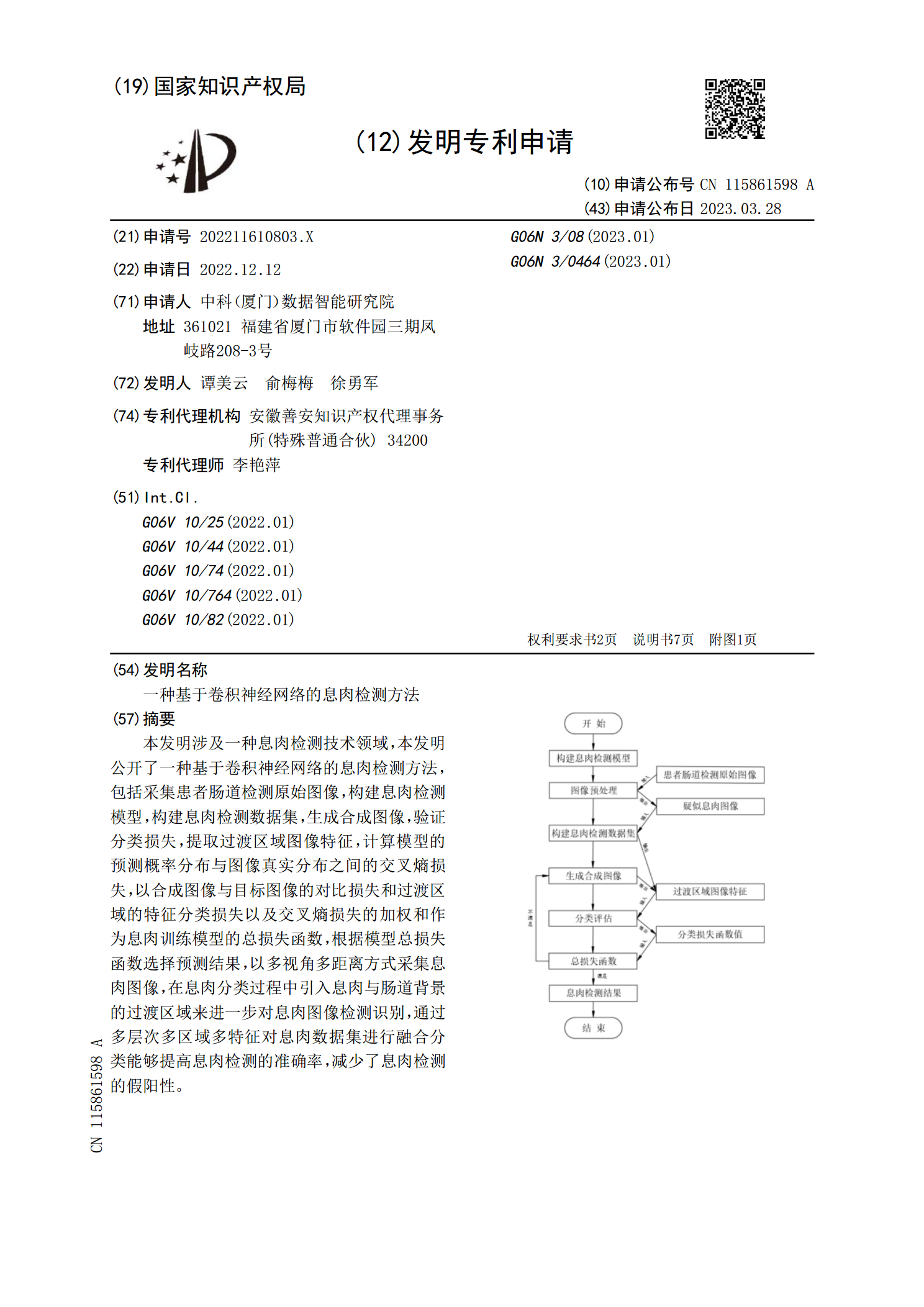

一种基于卷积神经网络的息肉检测方法.pdf

本发明涉及一种息肉检测技术领域,本发明公开了一种基于卷积神经网络的息肉检测方法,包括采集患者肠道检测原始图像,构建息肉检测模型,构建息肉检测数据集,生成合成图像,验证分类损失,提取过渡区域图像特征,计算模型的预测概率分布与图像真实分布之间的交叉熵损失,以合成图像与目标图像的对比损失和过渡区域的特征分类损失以及交叉熵损失的加权和作为息肉训练模型的总损失函数,根据模型总损失函数选择预测结果,以多视角多距离方式采集息肉图像,在息肉分类过程中引入息肉与肠道背景的过渡区域来进一步对息肉图像检测识别,通过多层次多区域

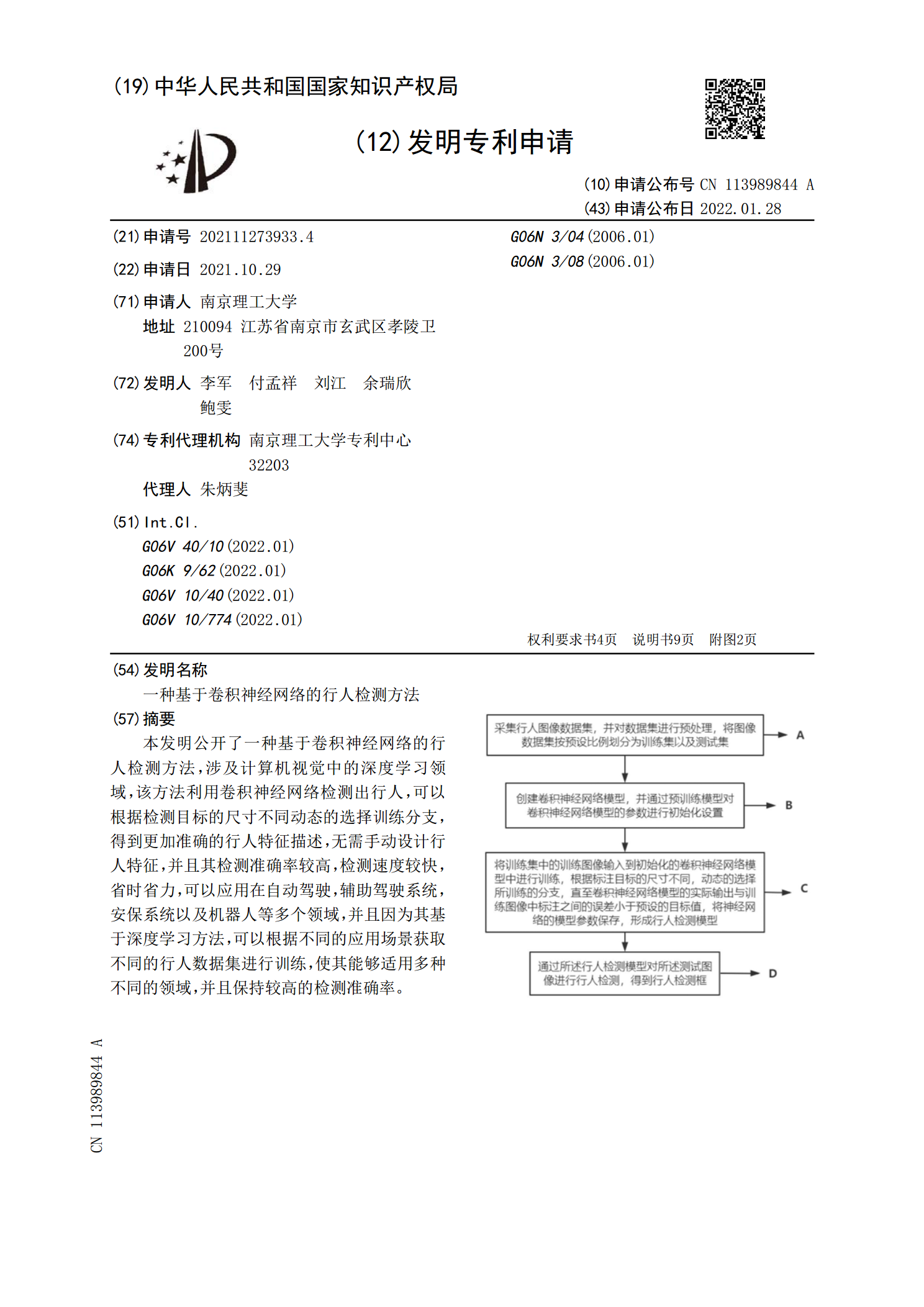

一种基于卷积神经网络的行人检测方法.pdf

本发明公开了一种基于卷积神经网络的行人检测方法,涉及计算机视觉中的深度学习领域,该方法利用卷积神经网络检测出行人,可以根据检测目标的尺寸不同动态的选择训练分支,得到更加准确的行人特征描述,无需手动设计行人特征,并且其检测准确率较高,检测速度较快,省时省力,可以应用在自动驾驶,辅助驾驶系统,安保系统以及机器人等多个领域,并且因为其基于深度学习方法,可以根据不同的应用场景获取不同的行人数据集进行训练,使其能够适用多种不同的领域,并且保持较高的检测准确率。

一种基于深度学习的人脸口罩佩戴检测方法.pdf

本发明公开了一种基于深度学习的人脸口罩佩戴检测方法,包括如下步骤:S1、数据准备并制作训练集;S2、构建YOLOV4目标检测模型;S3、人脸口罩佩戴检测模型进行视频流实时检测;S4、通过YOLOV4的特征提取网络,提取三个特征层,三个特征层的预测结果分别对应三个边界框的位置;通过先验框对边界框的预测与回归,就可以获得多个边界框的信息,通过非极大值抑制算法,保留置信分最高的边界框作为目标的检测框,从而确定检测框的最终位置,检测识别未佩戴口罩人员。本发明实现了对佩戴口罩和未佩戴口罩人员的检测识别,通过采用YO